Pytanie 1

Na zdjęciu widoczny jest

Wynik: 39/40 punktów (97,5%)

Wymagane minimum: 20 punktów (50%)

Na zdjęciu widoczny jest

W przypadku adresacji IPv6, zastosowanie podwójnego dwukropka służy do

Jakie urządzenie powinno być zainstalowane w serwerze, aby umożliwić automatyczne archiwizowanie danych na taśmach magnetycznych?

Do wyświetlenia daty w systemie Linux można wykorzystać polecenie

Która edycja systemu operacyjnego Windows Server 2008 charakteryzuje się najuboższym interfejsem graficznym?

Jaka jest nominalna moc wyjściowa (ciągła) zasilacza o parametrach zapisanych w tabeli?

| Napięcie wyjściowe | +5 V | +3.3 V | +12 V1 | +12 V2 | -12 V | +5 VSB |

| Prąd wyjściowy | 18,0 A | 22,0 A | 18,0 A | 17,0 A | 0,3 A | 2,5 A |

| Moc wyjściowa | 120 W | 336W | 3,6 W | 12,5 W |

Dobrze zaprojektowana sieć komputerowa powinna zapewniać możliwość rozbudowy, czyli charakteryzować się

Jakim protokołem jest realizowana kontrola poprawności transmisji danych w sieciach Ethernet?

W IPv6 odpowiednikiem adresu pętli zwrotnej jest adres

W ustawieniach karty graficznej w sekcji Zasoby znajduje się jeden z zakresów pamięci tej karty, który wynosi od A0000h do BFFFFh. Ta wartość odnosi się do obszaru pamięci wskazanego adresem fizycznym

Poprawę jakości skanowania można osiągnąć poprzez zmianę

Jakie zastosowanie ma polecenie md w systemie Windows?

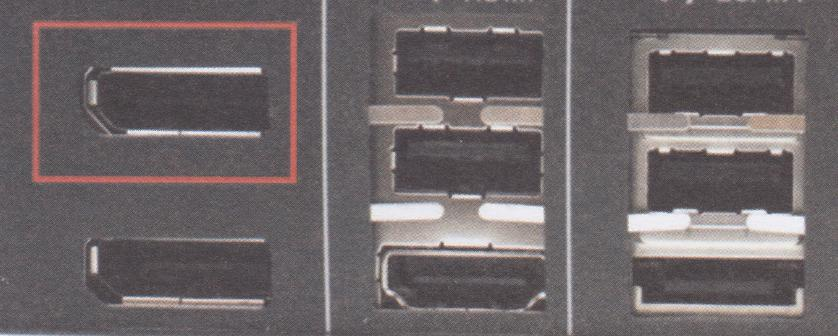

Na ilustracji, złącze monitora zaznaczone czerwoną ramką, będzie kompatybilne z płytą główną, która ma interfejs

Urządzenie peryferyjne, które jest kontrolowane przez komputer i wykorzystywane do obsługi dużych, płaskich powierzchni, a do produkcji druków odpornych na czynniki zewnętrzne używa farb rozpuszczalnikowych, to ploter

Jaki jest standard 1000Base-T?

Podane dane katalogowe odnoszą się do routera z wbudowaną pamięcią masową

| CPU | AtherosAR7161 680MHz |

| Memory | 32MB DDR SDRAM onboard memory |

| Boot loader | RouterBOOT |

| Data storage | 64MB onboard NAND memory chip |

| Ethernet | One 10/100 Mbit/s Fast Ethernet port with Auto-MDI/X |

| miniPCI | One MiniPCI Type IIIA/IIIB slot One MiniPCIe slot for 3G modem only (onboard SIM connector) |

| Wireless | Built in AR2417 802. 11 b/g wireless, 1x MMCX connector |

| Expansion | One USB 2.0 ports (without powering, needs power adapter, available separately) |

| Serial port | One DB9 RS232C asynchronous serial port |

| LEDs | Power, NAND activity, 5 user LEDs |

| Power options | Power over Ethernet: 10..28V DC (except power over datalines). Power jack: 10..28V DC. Includes voltage monitor |

| Dimensions | 105 mm x 105 mm, Weight: 82 g |

| Power consumption | Up to 5W with wireless at full activity |

| Operating System | MikroTik RouterOS v3, Level4 license |

Zgodnie z aktualnymi przepisami BHP, odległość oczu od ekranu monitora powinna wynosić

Komunikat "BIOS checksum error" pojawiający się w trakcie startu komputera zazwyczaj wskazuje na

W specyfikacji IEEE 802.3af opisano technologię dostarczania energii elektrycznej do różnych urządzeń sieciowych jako

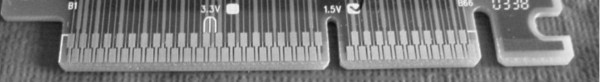

Na ilustracji przedstawiono fragment karty graficznej ze złączem

Jakim poleceniem w systemie Linux można ustawić powłokę domyślną użytkownika egzamin na sh?

Jakim parametrem definiuje się stopień zmniejszenia mocy sygnału w danej parze przewodów po przejściu przez cały tor kablowy?

Jakie narzędzie w wierszu poleceń służy do testowania oraz diagnostyki serwerów DNS?

Jaką najwyższą liczbę urządzeń można przypisać w sieci z adresacją IPv4 klasy C?

Z jaką minimalną efektywną częstotliwością taktowania mogą działać pamięci DDR2?

Analiza tłumienia w torze transmisyjnym na kablu umożliwia ustalenie

Ile sieci obejmują komputery z adresami IP i maskami sieci podanymi w tabeli?

| Adres IPv4 | Maska |

|---|---|

| 10.120.16.10 | 255.255.0.0 |

| 10.120.18.16 | 255.255.0.0 |

| 10.110.16.18 | 255.255.255.0 |

| 10.110.16.14 | 255.255.255.0 |

| 10.130.16.12 | 255.255.255.0 |

Na rysunku można zobaczyć schemat topologii fizycznej, która jest kombinacją topologii

Program CHKDSK jest wykorzystywany do

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Która z konfiguracji RAID opiera się na replikacji danych pomiędzy dwoma lub większą liczbą dysków fizycznych?

Rysunek obrazuje zasadę działania drukarki

Które z metod szyfrowania wykorzystywanych w sieciach bezprzewodowych jest najsłabiej zabezpieczone przed łamaniem haseł?

Wskaź 24-pinowe lub 29-pinowe złącze żeńskie, które jest w stanie przesyłać skompresowany sygnał cyfrowy do monitora?

Parametr pamięci RAM określany czasem jako opóźnienie definiuje się jako

Komputer jest połączony z myszą bezprzewodową, a kursor w trakcie używania nie porusza się płynnie, tylko "skacze" po ekranie. Możliwą przyczyną awarii urządzenia może być

Użytkownik chce tak zmodernizować komputer, aby działały na nim gry wymagające DirectX12. Jaki system operacyjny powinien zakupić do modernizowanego komputera, aby wspierał DX12?

Który układ mikroprocesora jest odpowiedzialny między innymi za pobieranie rozkazów z pamięci oraz generowanie sygnałów sterujących?

Ustalenie adresów fizycznych MAC na podstawie adresów logicznych IP jest efektem działania protokołu

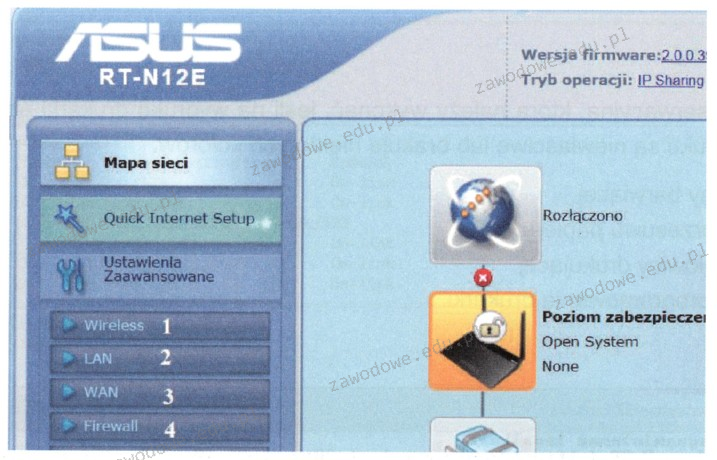

Aby skonfigurować ruter i wprowadzić parametry połączenia od dostawcy internetowego, którą sekcję oznaczoną numerem należy wybrać?