Pytanie 1

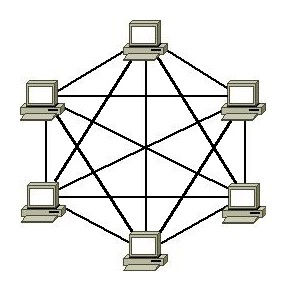

Jakiego rodzaju fizyczna topologia sieci komputerowej jest zobrazowana na rysunku?

Wynik: 7/40 punktów (17,5%)

Wymagane minimum: 20 punktów (50%)

Jakiego rodzaju fizyczna topologia sieci komputerowej jest zobrazowana na rysunku?

Jakim poleceniem w systemie Linux można ustalić trasę pakietu do celu?

Do realizacji iloczynu logicznego z negacją należy użyć funktora

Wskaż usługę, którą należy skonfigurować na serwerze aby blokować ruch sieciowy?

Jaki jest adres rozgłoszeniowy (broadcast) dla hosta z adresem IP 192.168.35.202 oraz maską 26 bitową?

W jakim systemie występuje jądro hybrydowe (kernel)?

Jaki zakres adresów IPv4 jest prawidłowo przypisany do danej klasy?

Usługi na serwerze są konfigurowane za pomocą

W systemie Windows, który wspiera przydziały dyskowe, użytkownik o nazwie Gość

Jakie stwierdzenie o routerach jest poprawne?

Jaki rodzaj routingu jest najbardziej odpowiedni w dużych, szybko zmieniających się sieciach?

Wskaż standard protokołu wykorzystywanego do kablowego połączenia dwóch urządzeń

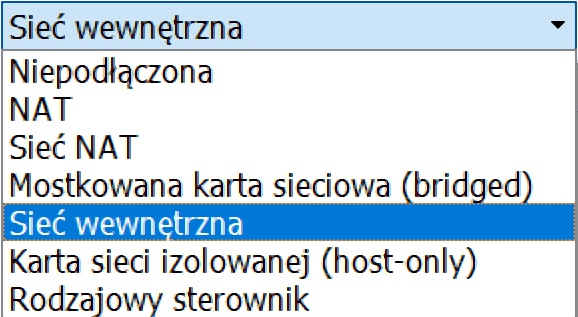

Na ilustracji przedstawiono opcje karty sieciowej w oprogramowaniu VirtualBox. Ustawienie na wartość sieć wewnętrzna, spowoduje, że

Który z wymienionych adresów należy do klasy C?

Jaka jest maksymalna liczba hostów, które można przypisać w sieci o adresie IP klasy B?

Analiza tłumienia w torze transmisyjnym na kablu umożliwia ustalenie

Do interfejsów pracujących równolegle należy interfejs

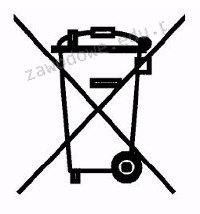

Symbol zaprezentowany powyżej, używany w dokumentacji technicznej, wskazuje na

Obniżenie ilości jedynek w masce pozwala na zaadresowanie

Jakie rozwiązanie techniczne pozwala na transmisję danych z szybkością 1 Gb/s z zastosowaniem światłowodu?

Użytkownik systemu Windows napotyka komunikaty o zbyt małej ilości pamięci wirtualnej. W jaki sposób można rozwiązać ten problem?

Narzędzie pokazane na ilustracji służy do

Użycie którego z urządzeń może prowadzić do wzrostu liczby kolizji pakietów w sieci?

Jeśli adres IP komputera roboczego przyjmuje formę 176.16.50.10/26, to jaki jest adres rozgłoszeniowy oraz maksymalna liczba hostów w tej sieci?

Aby przekształcić serwer w kontroler domeny w systemach Windows Server, konieczne jest użycie komendy

Jakiego portu używa protokół FTP (File transfer Protocol)?

Drukarka została zainstalowana w systemie Windows. Aby ustawić między innymi domyślną orientację wydruku, liczbę stron na arkusz oraz kolorystykę, podczas jej konfiguracji należy skorzystać z opcji

W wyniku wykonania przedstawionych poleceń systemu Linux interfejs sieciowy eth0 otrzyma:

ifconfig eth0 10.0.0.100 netmask 255.255.255.0 broadcast 10.0.0.255 up route add default gw 10.0.0.10

Jak nazywa się licencja oprogramowania pozwalająca na bezpłatne dystrybucję aplikacji?

Ile maksymalnie kanałów z dostępnego pasma kanałów w standardzie 802.11b może być używanych w Polsce?

Do jakich celów powinno się aktywować funkcję RMON (Remote Network Monitoring) w przełączniku?

Jest to najnowsza edycja klienta wieloplatformowego, docenianego przez użytkowników na całym świecie, serwera wirtualnej sieci prywatnej, umożliwiającego nawiązanie połączenia między hostem a komputerem lokalnym, obsługującego uwierzytelnianie z wykorzystaniem kluczy, certyfikatów, nazwy użytkownika oraz hasła, a także, w wersji dla Windows, dodatkowych zakładek. Który z programów został wcześniej opisany?

W topologii fizycznej w kształcie gwiazdy, wszystkie urządzenia działające w sieci są

Cechą oprogramowania służącego do monitorowania zdarzeń metodą Out-Of-Band w urządzeniach sieciowych jest

Na podstawie tabeli wskaż, który model przełącznika Cisco Catalyst, zawiera 48 portów i możliwość doposażenia o wkładki światłowodowe.

| Configurations of Cisco Catalyst 2960 Series Switches with LAN Base Software | ||

|---|---|---|

| Cisco Catalyst 2960 Switch Model | Description | Uplinks |

| 1 Gigabit Uplinks with 10/100 Ethernet Connectivity | ||

| Cisco Catalyst 2960-48PST-L | 48 Ethernet 10/100 PoE ports | 2 One Gigabit Ethernet SFP ports and 2 fixed Ethernet 10/100/1000 ports |

| Cisco Catalyst 2960-24PC-L | 24 Ethernet 10/100 PoE ports | 2 dual-purpose ports (10/100/1000 or SFP) |

| Cisco Catalyst 2960-24LT-L | 24 Ethernet 10/100 ports | 2 Ethernet 10/100/1000 ports |

| Cisco Catalyst 2960-24TC-L | 24 Ethernet 10/100 ports | 2 dual-purpose ports |

| Cisco Catalyst 2960-48TC-L | 48 Ethernet 10/100 ports | 2 dual-purpose ports (10/100/1000 or SFP) |

| Cisco Catalyst 2960-24TT-L | 24 Ethernet 10/100 ports | 2 Ethernet 10/100/1000 ports |

| Cisco Catalyst 2960-48TT-L | 48 Ethernet 10/100 ports | 2 Ethernet 10/100/1000 ports |

Która z usług pozwala na zdalne zainstalowanie systemu operacyjnego?

Jakie jest ciało odpowiedzialne za publikację dokumentów RFC (Request For Comments), które określają zasady rozwoju Internetu?

CommView oraz WireShark to aplikacje wykorzystywane do

Po wykonaniu eksportu klucza HKCR zostanie zapisana kopia rejestru, zawierająca informacje dotyczące konfiguracji

W systemie Windows można zweryfikować parametry karty graficznej, używając następującego polecenia