Pytanie 1

Użytkownik systemu Windows doświadcza komunikatów o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?

Wynik: 6/40 punktów (15,0%)

Wymagane minimum: 20 punktów (50%)

Użytkownik systemu Windows doświadcza komunikatów o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?

Termin określający wyrównanie tekstu do prawego i lewego marginesu to

Jakie narzędzie w systemie Windows służy do przeglądania informacji dotyczących problemów z systemem?

Najefektywniejszym zabezpieczeniem danych firmy, której siedziby znajdują się w różnych, odległych od siebie lokalizacjach, jest zastosowanie

W sieciach opartych na standardzie, jaką metodę dostępu do medium wykorzystuje CSMA/CA?

Do przechowywania fragmentów dużych plików programów oraz danych, które nie mieszczą się w całości w pamięci, wykorzystywany jest

Aby zwiększyć lub zmniejszyć wielkość ikony na pulpicie, należy obracać kółkiem myszy, trzymając jednocześnie klawisz:

Tworzenie zaszyfrowanych połączeń pomiędzy hostami przez publiczną sieć Internet, wykorzystywane w rozwiązaniach VPN (Virtual Private Network), to

Według modelu TCP/IP protokoły DNS, FTP i SMTP są przypisane do warstwy

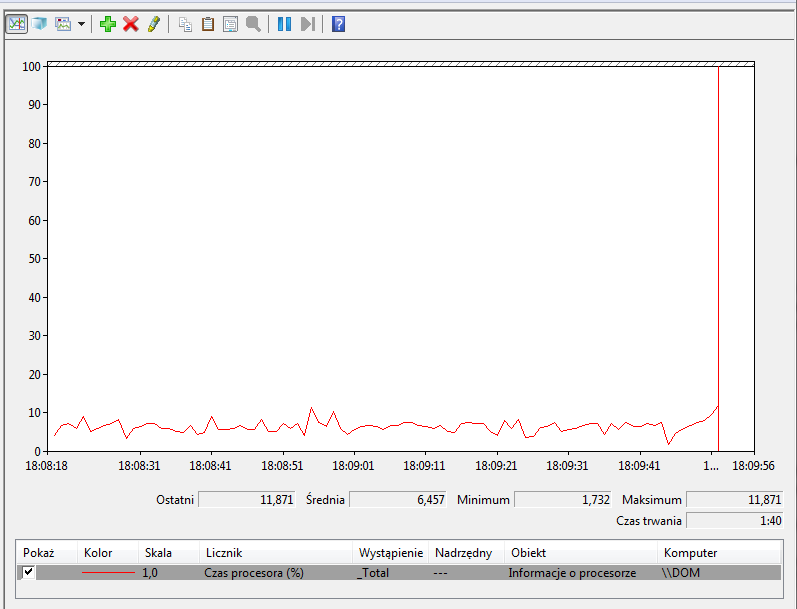

By uruchomić w systemie Windows oprogramowanie narzędziowe monitorujące wydajność komputera przedstawione na rysunku, należy uruchomić

Obudowa oraz wyświetlacz drukarki fotograficznej są bardzo brudne. Jakie środki należy zastosować, aby je wyczyścić?

Program "VirtualPC", dostępny do pobrania z witryny Microsoft, jest przeznaczony do korzystania:

Jeśli adres IP komputera roboczego przyjmuje formę 176.16.50.10/26, to jaki jest adres rozgłoszeniowy oraz maksymalna liczba hostów w tej sieci?

Który standard implementacji sieci Ethernet określa sieć wykorzystującą kabel koncentryczny, z maksymalną długością segmentu wynoszącą 185 m?

Optyczna rozdzielczość to jeden z właściwych parametrów

Jaką funkcję serwera trzeba dodać w systemach z rodziny Windows Server, aby było możliwe utworzenie nowej witryny FTP?

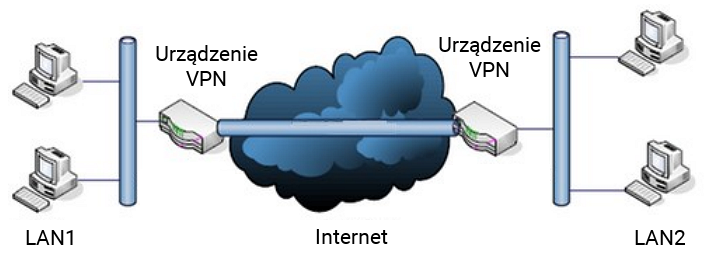

Schemat ilustruje sposób funkcjonowania sieci VPN noszącej nazwę

Aby zrealizować transfer danych pomiędzy siecią w pracowni a siecią ogólnoszkolną, która ma inną adresację IP, należy zastosować

Wynikiem działania funkcji logicznej XOR na dwóch liczbach binarnych \( 1010_2 \) i \( 1001_2 \) jest czterobitowa liczba

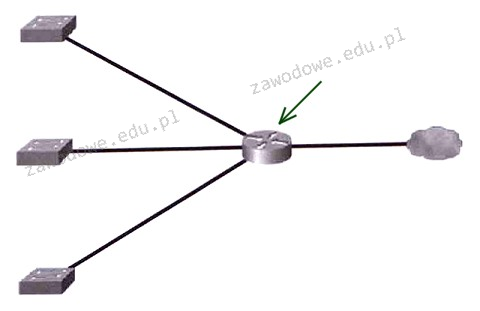

Jaki symbol urządzenia jest pokazany przez strzałkę na rysunku?

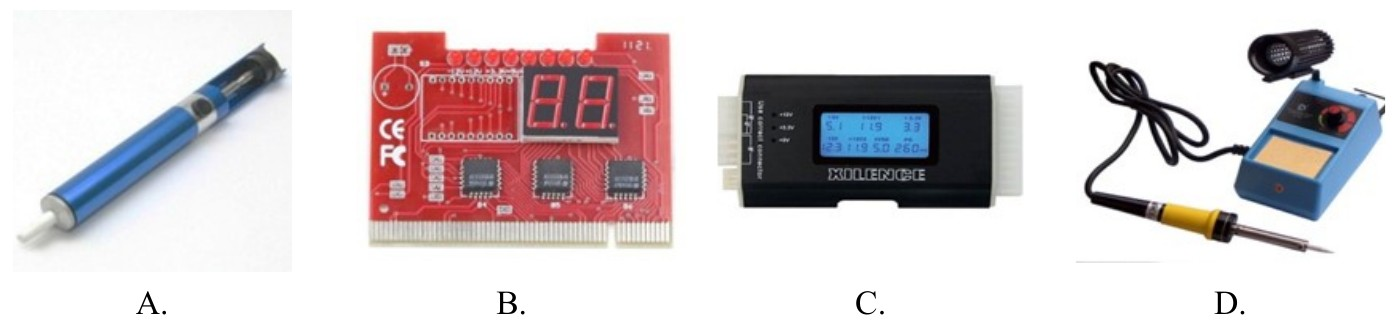

Jakie narzędzie powinno być użyte do zbadania wyników testu POST dla modułów na płycie głównej?

Który z poniższych protokołów nie jest wykorzystywany do konfiguracji wirtualnej sieci prywatnej?

Którą maskę należy zastosować, aby podzielić sieć o adresie 172.16.0.0/16 na podsieci o maksymalnej liczbie 62 hostów?

Jakie narzędzie służy do obserwacji zdarzeń w systemie Windows?

Które bity w 48-bitowym adresie MAC identyfikują producenta?

Jaki rodzaj dysków jest podłączany do złącza IDE na płycie głównej komputera?

Który rodzaj złącza nie występuje w instalacjach światłowodowych?

Jakie narzędzie w systemie Windows umożliwia kontrolę prób logowania do systemu?

Jeśli rozdzielczość myszki wynosi 200 dpi, a rozdzielczość monitora to Full HD, to aby przesunąć kursor w poziomie po ekranie, należy przemieścić mysz o

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Czym jest kopia różnicowa?

Funkcja failover usługi DHCP umożliwia

Aby zapewnić komputerowi otrzymanie konkretnego adresu IP od serwera DHCP, należy na serwerze ustalić

Zamiana taśmy barwiącej jest związana z eksploatacją drukarki

Aby umożliwić jedynie wybranym urządzeniom dostęp do sieci WiFi, konieczne jest w punkcie dostępowym

Skrót określający translację adresów w sieciach to

Jaką rolę pełni serwer plików w sieciach komputerowych LAN?

Na podstawie tabeli wskaż, który model przełącznika Cisco Catalyst, zawiera 48 portów i możliwość doposażenia o wkładki światłowodowe.

| Configurations of Cisco Catalyst 2960 Series Switches with LAN Base Software | ||

|---|---|---|

| Cisco Catalyst 2960 Switch Model | Description | Uplinks |

| 1 Gigabit Uplinks with 10/100 Ethernet Connectivity | ||

| Cisco Catalyst 2960-48PST-L | 48 Ethernet 10/100 PoE ports | 2 One Gigabit Ethernet SFP ports and 2 fixed Ethernet 10/100/1000 ports |

| Cisco Catalyst 2960-24PC-L | 24 Ethernet 10/100 PoE ports | 2 dual-purpose ports (10/100/1000 or SFP) |

| Cisco Catalyst 2960-24LT-L | 24 Ethernet 10/100 ports | 2 Ethernet 10/100/1000 ports |

| Cisco Catalyst 2960-24TC-L | 24 Ethernet 10/100 ports | 2 dual-purpose ports |

| Cisco Catalyst 2960-48TC-L | 48 Ethernet 10/100 ports | 2 dual-purpose ports (10/100/1000 or SFP) |

| Cisco Catalyst 2960-24TT-L | 24 Ethernet 10/100 ports | 2 Ethernet 10/100/1000 ports |

| Cisco Catalyst 2960-48TT-L | 48 Ethernet 10/100 ports | 2 Ethernet 10/100/1000 ports |

Jakie wbudowane narzędzie w systemie Windows służy do identyfikowania problemów związanych z animacjami w grach oraz odtwarzaniem filmów?

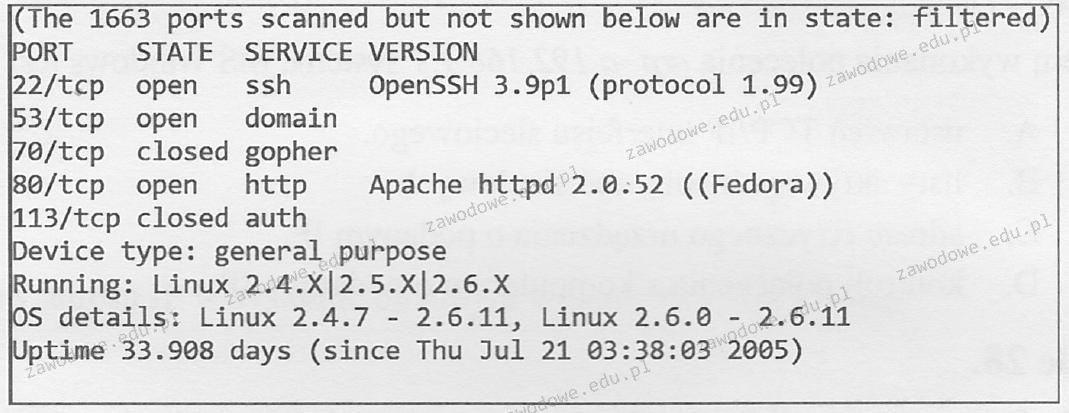

Jaki program został wykorzystany w systemie Linux do szybkiego skanowania sieci?