Pytanie 1

Aby uzyskać uprawnienia administratora w systemie Linux, należy w terminalu wpisać polecenie

Wynik: 4/40 punktów (10,0%)

Wymagane minimum: 20 punktów (50%)

Aby uzyskać uprawnienia administratora w systemie Linux, należy w terminalu wpisać polecenie

Który przyrząd należy wykorzystać do uzyskania wyników testu POST dla modułów płyty głównej?

Zasada dostępu do medium CSMA/CA jest wykorzystywana w sieci o specyfikacji

Ile sieci obejmują adresy IPv4 pokazane w tabeli?

| Adres IPv4 | Maska sieci |

|---|---|

| 10.10.10.10 | 255.255.0.0 |

| 10.10.20.10 | 255.255.0.0 |

| 10.10.20.20 | 255.255.0.0 |

| 10.10.30.30 | 255.255.0.0 |

| 10.20.10.10 | 255.255.0.0 |

| 10.20.20.10 | 255.255.0.0 |

| 10.20.20.30 | 255.255.0.0 |

Który typ drukarki powinien być wykorzystany w dziale sprzedaży hurtowni materiałów budowlanych do tworzenia faktur na papierze samokopiującym, aby uzyskać kopie wydruku?

Podstawowym zadaniem mechanizmu Plug and Play jest

Liczba \( 10_{D} \) w systemie uzupełnień do dwóch jest równa

Brak odpowiedzi na to pytanie.

Aby zwiększyć efektywność komputera, można w nim zainstalować procesor wspierający technologię Hyper-Threading, co umożliwia

Brak odpowiedzi na to pytanie.

Wskaż nazwę programu stosowanego w systemie Linux do przekrojowego monitorowania parametrów, między innymi takich jak obciążenie sieci, zajętość systemu plików, statystyki partycji, obciążenie CPU czy statystyki IO.

Brak odpowiedzi na to pytanie.

Funkcja systemu Windows Server, umożliwiająca zdalną instalację systemów operacyjnych na komputerach kontrolowanych przez serwer, to

Brak odpowiedzi na to pytanie.

Aby bezpośrednio połączyć dwa komputery w przewodowej sieci LAN, należy zastosować

Brak odpowiedzi na to pytanie.

Pojemność pamięci 100 GiB odpowiada zapisowi

Brak odpowiedzi na to pytanie.

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który wymusza jego automatyczne aktualizacje, są

Brak odpowiedzi na to pytanie.

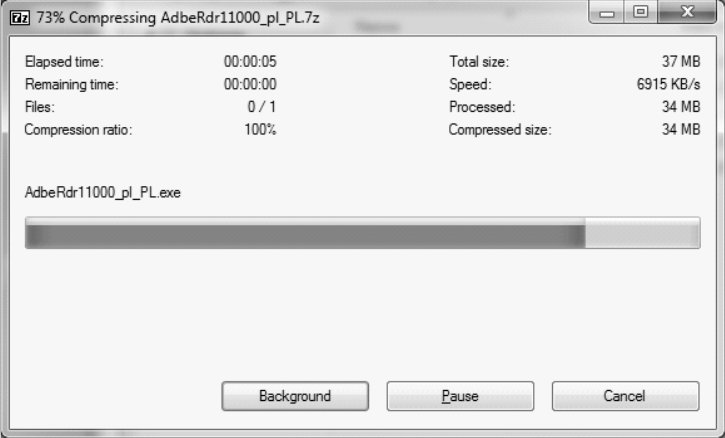

Na dołączonym obrazku ukazano proces

Brak odpowiedzi na to pytanie.

Jaką zmianę sygnału realizuje konwerter RAMDAC?

Brak odpowiedzi na to pytanie.

Norma TIA/EIA-568-B.2 definiuje szczegóły dotyczące parametrów transmisji

Brak odpowiedzi na to pytanie.

Komputer jest połączony z myszą bezprzewodową, a kursor w trakcie używania nie porusza się płynnie, tylko "skacze" po ekranie. Możliwą przyczyną awarii urządzenia może być

Brak odpowiedzi na to pytanie.

Zgodnie z normą PN-EN 50174, okablowanie poziome w systemie okablowania strukturalnego to segment okablowania pomiędzy

Brak odpowiedzi na to pytanie.

Który standard IEEE 802.3 powinien być użyty w sytuacji z zakłóceniami elektromagnetycznymi, jeżeli odległość między punktem dystrybucyjnym a punktem abonenckim wynosi 200 m?

Brak odpowiedzi na to pytanie.

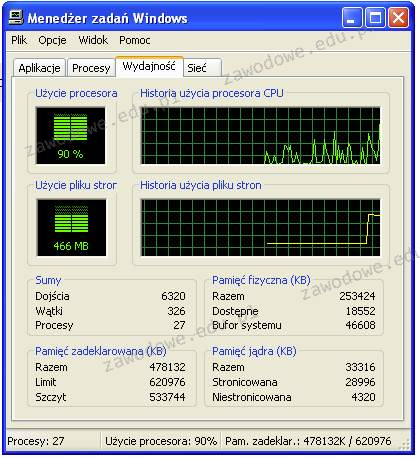

Przyglądając się przedstawionemu obrazkowi, można dostrzec, że deklarowany limit pamięci wynosi 620976 KB. Zauważamy również, że zainstalowana pamięć fizyczna w badanym systemie jest mniejsza niż pamięć zadeklarowana. Który typ pamięci wpływa na podniesienie limitu pamięci zadeklarowanej powyżej rozmiaru zainstalowanej pamięci fizycznej?

Brak odpowiedzi na to pytanie.

Za pomocą narzędzia diagnostycznego Tracert można ustalić trasę do punktu docelowego. Przez ile routerów przeszedł pakiet wysłany dl hosta 172.16.0.99?

C:\>tracert 172.16.0.99 Trasa śledzenia do 172.16.0.99 z maksymalną liczbą przeskoków 30 | ||||

| 1 | 2 ms | 3 ms | 2 ms | 10.0.0.1 |

| 2 | 12 ms | 8 ms | 8 ms | 192.168.0.1 |

| 3 | 10 ms | 15 ms | 10 ms | 172.17.0.2 |

| 4 | 11 ms | 11 ms | 20 ms | 172.17.48.14 |

| 5 | 21 ms | 16 ms | 24 ms | 172.16.0.99 |

Śledzenie zakończone. | ||||

Brak odpowiedzi na to pytanie.

W systemie Windows, zainstalowanym w wersji obsługującej przydziały dyskowe, użytkownik o nazwie Gość

Brak odpowiedzi na to pytanie.

Menedżer urządzeń w systemie Windows umożliwia identyfikację

Brak odpowiedzi na to pytanie.

Który z protokołów jest używany do przesyłania plików na serwer?

Brak odpowiedzi na to pytanie.

Aktywacja opcji OCR podczas ustawiania skanera umożliwia

Brak odpowiedzi na to pytanie.

Okablowanie strukturalne klasyfikuje się jako część infrastruktury

Brak odpowiedzi na to pytanie.

Urządzenie sieciowe nazywane mostem (ang. bridge) to:

Brak odpowiedzi na to pytanie.

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Brak odpowiedzi na to pytanie.

Aby system operacyjny mógł szybciej uzyskiwać dostęp do plików na dysku twardym, należy wykonać

Brak odpowiedzi na to pytanie.

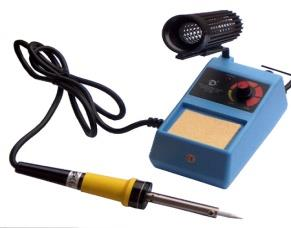

Jakie urządzenie jest pokazane na ilustracji?

Brak odpowiedzi na to pytanie.

Trollowanie w Internecie polega na

Brak odpowiedzi na to pytanie.

Protokół stosowany do rozgłaszania w grupie, dzięki któremu hosty informują o swoim członkostwie, to

Brak odpowiedzi na to pytanie.

Jak nazywa się topologia fizyczna sieci, która wykorzystuje fale radiowe jako medium transmisyjne?

Brak odpowiedzi na to pytanie.

Kable łączące poziome punkty dystrybucyjne z centralnym punktem dystrybucyjnym określa się jako

Brak odpowiedzi na to pytanie.

Które z metod szyfrowania wykorzystywanych w sieciach bezprzewodowych jest najsłabiej zabezpieczone przed łamaniem haseł?

Brak odpowiedzi na to pytanie.

Użytkownik napotyka trudności z uruchomieniem systemu Windows. W celu rozwiązania tego problemu skorzystał z narzędzia System Image Recovery, które

Brak odpowiedzi na to pytanie.

Administrator pragnie udostępnić w sieci folder c:\instrukcje tylko trzem użytkownikom z grupy Serwisanci. Jakie działanie powinien podjąć?

Brak odpowiedzi na to pytanie.

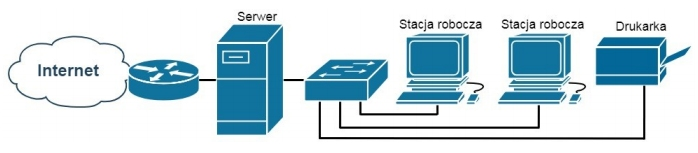

Która funkcja serwera Windows umożliwia użytkownikom końcowym sieci pokazanej na rysunku dostęp do Internetu?

Brak odpowiedzi na to pytanie.

Który element pasywny sieci powinien być użyty do połączenia okablowania ze wszystkich gniazd abonenckich z panelem krosowniczym umieszczonym w szafie rack?

Brak odpowiedzi na to pytanie.

W systemie Linux, aby przejść do głównego katalogu w strukturze drzewiastej, używa się komendy

Brak odpowiedzi na to pytanie.