Pytanie 1

Który zestaw zdjęć narządów klatki piersiowej należy wykonać u pacjenta z podejrzeniem lewostronnego zapalenia płuc?

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Który zestaw zdjęć narządów klatki piersiowej należy wykonać u pacjenta z podejrzeniem lewostronnego zapalenia płuc?

Brachyterapia polegająca na wielokrotnym wsuwaniu i wysuwaniu źródła promieniowania do tego samego aplikatora nosi nazwę

Które środki kontrastujące wykorzystywane są w diagnostyce rezonansem magnetycznym?

Który załamek w zapisie EKG odpowiada zjawisku depolaryzacji przedsionków mięśnia sercowego?

W medycznym przyspieszaczu liniowym jest generowana wiązka fotonów o energii w zakresie

W pozytonowej tomografii emisyjnej PET zostaje zarejestrowane promieniowanie powstające podczas

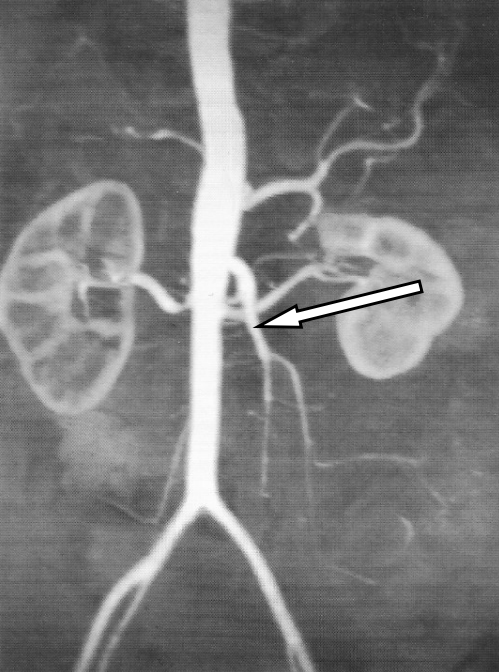

Którą tętnicę zaznaczono strzałką na obrazie MR?

Na radiogramie czaszki strzałką zaznaczono

Którym skrótem w badaniu spirometrycznym oznaczana jest pojemność życiowa płuc?

Osłony na gonady dla osób dorosłych powinny posiadać równoważnik osłabienia promieniowania nie mniejszy niż

Które ciało obce w obszarze badania nie stanowi przeciwwskazania do wykonania MR?

Na obrazie RM uwidoczniono odcinek kręgosłupa

Elementem systemu rejestracji obrazu, w którym fotony promieniowania X są bezpośrednio konwertowane na sygnał elektryczny, jest

Która struktura może być oknem akustycznym w badaniu ultrasonograficznym?

Droga przewodnictwa powietrznego fali akustycznej przebiega przez

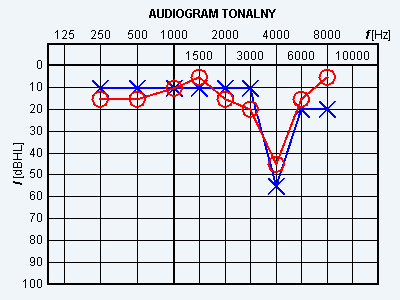

Wynik badania słuchu metodą audiometrii tonalnej wskazuje na

Koronarografia jest radiologicznym zabiegiem diagnostycznym pozwalającym ocenić drożność

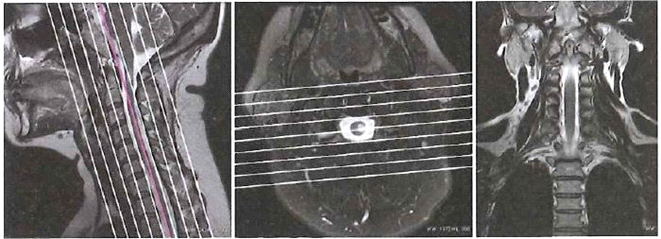

Obrazy MR kręgosłupa szyjnego przedstawiają etap planowania badania warstw

Która składowa prawidłowej krzywej EKG odpowiada powolnej repolaryzacji komór mięśnia sercowego?

Który parametr ekspozycji ma decydujący wpływ na kontrast obrazu rentgenowskiego?

Zdjęcie którego zęba górnego zlecił na skierowaniu lekarz stomatolog?

W badaniu EKG odprowadzenie I rejestruje różnicę potencjałów między

Wskaż roczną dawkę graniczną dla osób zatrudnionych w warunkach narażenia na promieniowanie jonizujące.

Kiedy w procesie terapii wykonuje się badanie CBCT (cone beam computed tomography)?

Promieniowanie jonizujące pośrednio to

Pozytywny środek cieniujący najczęściej stosowany w rentgenodiagnostyce powinien charakteryzować się

Parametr SNR w obrazowaniu MR oznacza

Kryterium rozpoznawczym dla fali δ (delta) w badaniu EKG jest

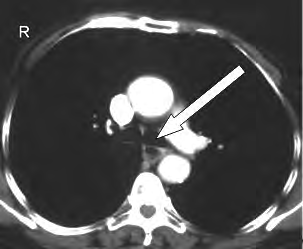

Na obrazie TK klatki piersiowej w przekroju poprzecznym strzałką oznaczono

Które znaczniki są wykorzystywane w scyntygrafii tarczycy?

W radiografii mianem SID określa się

Świeżo wynaczyniona krew na obrazach TK głowy bez podania środka kontrastowego ukazuje się jako obszar

W badaniu EKG różnice potencjałów pomiędzy lewym podudziem a lewym przedramieniem rejestruje odprowadzenie

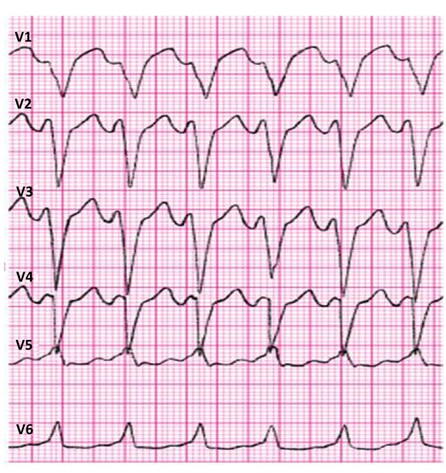

Które zaburzenie rytmu serca zarejestrowano na elektrokardiogramie?

Którą strukturę anatomiczną uwidoczniono na zamieszczonym obrazie USG?

Który radiofarmaceutyk należy podać pacjentowi w scyntygrafii perfuzyjnej mózgu?

Zwiększenie napięcia na lampie rentgenowskiej powoduje

Zadaniem technika elektroradiologa w pracowni naczyniowej jest

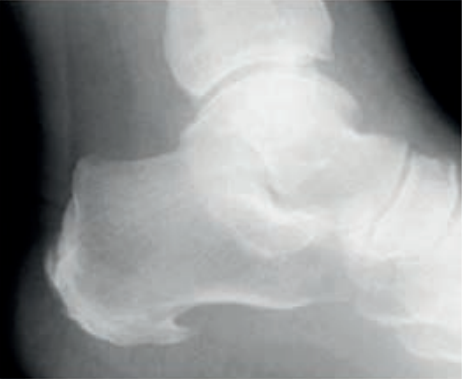

Co zostało uwidocznione na zamieszczonym radiogramie?

Rozpraszanie promieniowania X, w wyniku którego następuje zwiększenie długości fali promieniowania, to zjawisko