Pytanie 1

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Użytkownik uszkodził płytę główną z gniazdem dla procesora AM2. Płytę z uszkodzeniami można wymienić na model z gniazdem, nie zmieniając procesora oraz pamięci

Który z poniższych protokołów nie jest wykorzystywany do konfiguracji wirtualnej sieci prywatnej?

W jakiej topologii fizycznej sieci każde urządzenie ma dokładnie dwa połączenia, jedno z najbliższymi sąsiadami, a dane są przesyłane z jednego komputera do kolejnego w formie pętli?

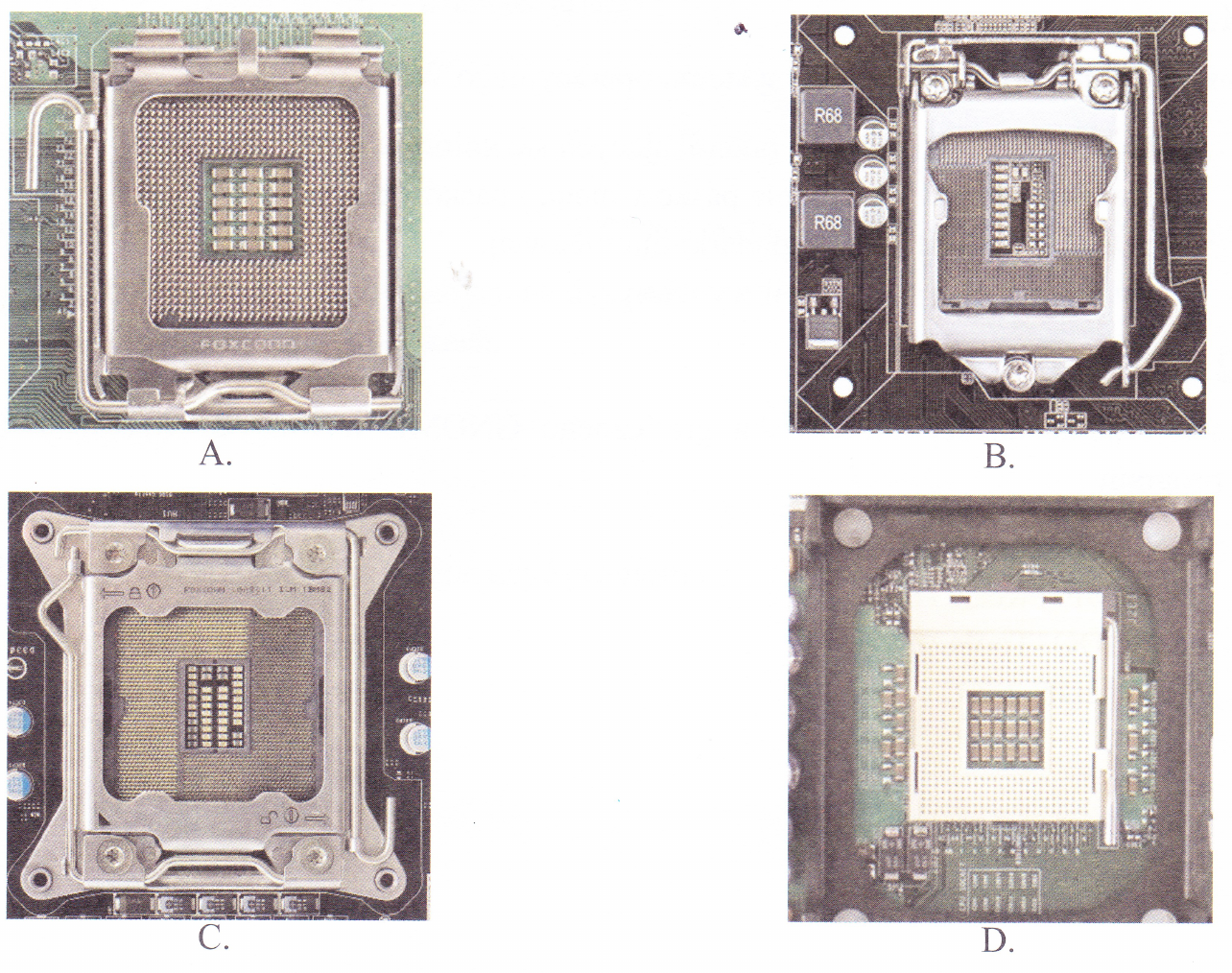

Zidentyfikuj urządzenie przedstawione na ilustracji

Jak nazywa się protokół bazujący na architekturze klient-serwer oraz na modelu żądanie-odpowiedź, który jest używany do transferu plików?

Zasadniczym sposobem zabezpieczenia danych przechowywanych na serwerze jest

Jakie urządzenie sieciowe umożliwia połączenie sieci LAN z WAN?

Złośliwe programy komputerowe, które potrafią replikować się same i wykorzystują luki w systemie operacyjnym, a także mają zdolność modyfikowania oraz uzupełniania swojej funkcjonalności, nazywamy

Który z poniższych zapisów stanowi właściwy adres w wersji IPv6?

Przedstawione narzędzie jest przeznaczone do

Jakie oprogramowanie służy do sprawdzania sterowników w systemie Windows?

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

Jak nazywa się serwer Windows, na którym zainstalowano usługę Active Directory?

W jakim gnieździe należy umieścić procesor INTEL CORE i3-4350- 3.60 GHz, x2/4, 4MB, 54W, HD 4600, BOX, s-1150?

Który interfejs bezprzewodowy, komunikacji krótkiego zasięgu pomiędzy urządzeniami elektronicznymi, korzysta z częstotliwości 2,4 GHz?

Pojemność pamięci 100 GiB odpowiada zapisowi

Jak nazywa się technika modyfikowania ramek sieciowych polegająca na oznaczaniu ich identyfikatorem sieci VLAN nadawcy według standardu IEEE 802.1Q?

Podczas realizacji projektu sieci LAN zastosowano medium transmisyjne zgodne ze standardem Ethernet 1000Base-T. Które z poniższych stwierdzeń jest prawdziwe?

Jak nazywa się proces dodawania do danych z warstwy aplikacji informacji powiązanych z protokołami funkcjonującymi na różnych poziomach modelu sieciowego?

Router przypisany do interfejsu LAN dysponuje adresem IP 192.168.50.1. Został on skonfigurowany w taki sposób, aby przydzielać komputerom wszystkie dostępne adresy IP w sieci 192.168.50.0 z maską 255.255.255.0. Jaką maksymalną liczbę komputerów można podłączyć w tej sieci?

Zgodnie z normą TIA/EIA-568-B.1 kabel UTP 5e z przeplotem powstaje poprzez zamianę lokalizacji w wtyczce 8P8C następujących par żył (odpowiednio według kolorów):

Jaką rolę pełni usługa NAT działająca na ruterze?

Aby zminimalizować wpływ zakłóceń elektromagnetycznych na przesyłany sygnał w projektowanej sieci komputerowej, co należy zastosować?

Które z poniższych zdań charakteryzuje protokół SSH (Secure Shell)?

Aby zminimalizować różnice w kolorach pomiędzy zeskanowanymi obrazami prezentowanymi na monitorze a ich wersjami oryginalnymi, należy przeprowadzić

W którym programie należy zmodyfikować ustawienia, aby użytkownik komputera mógł wybrać z menu i uruchomić jeden z kilku systemów operacyjnych zainstalowanych na jego komputerze?

W celu zainstalowania systemu openSUSE oraz dostosowania jego ustawień, można skorzystać z narzędzia

Jak nazywa się protokół oparty na architekturze klient-serwer oraz modelu żądanie-odpowiedź, wykorzystywany do przesyłania plików?

W systemie Linux polecenie chown służy do

Modułem pamięci RAM, kompatybilnym z płytą główną GIGABYTE GA-X99- ULTRA GAMING/ X99/ 8x DDR4 2133, ECC, max 128GB/ 4x PCI-E 16x/ RAID/ USB 3.1/ S-2011-V3/ATX, jest pamięć

Licencja oprogramowania open source oraz wolnego, to rodzaj licencji

Którego narzędzia można użyć, aby prześledzić trasę, którą pokonują pakiety w sieciach?

Pamięć, która nie traci danych, może być elektrycznie kasowana i programowana, znana jest pod skrótem

Jakie funkcje posiada program tar?

Cena wydrukowania jednej strony tekstu to 95 gr, a koszt przygotowania jednej płyty CD wynosi 1,54 zł. Jakie wydatki poniesie firma, tworząca płytę z prezentacjami oraz 120-stronicowy poradnik?

Scandisk to narzędzie, które wykorzystuje się do

Do utworzenia skompresowanego archiwum danych w systemie Linux można użyć polecenia

Która z kopii w trakcie archiwizacji plików pozostawia ślad archiwizacji?

Jak należy postąpić z wiadomością e-mail od nieznanej osoby, która zawiera podejrzany załącznik?