Pytanie 1

Kto jest odpowiedzialny za alokację czasu procesora dla konkretnych zadań?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Kto jest odpowiedzialny za alokację czasu procesora dla konkretnych zadań?

Jakie parametry można śledzić w przypadku urządzenia przy pomocy S.M.A.R.T.?

Urządzeniem peryferyjnym wykorzystywanym w fabrykach odzieżowych do wycinania elementów ubrań jest ploter

Na stronie wydrukowanej w drukarce atramentowej pojawiają się smugi, kropki, kleksy i plamy. Aby rozwiązać problemy z jakością wydruku, należy

Kondygnacyjny punkt dystrybucji jest połączony z

Oprogramowanie, które jest przypisane do konkretnego komputera lub jego komponentu i nie pozwala na reinstalację na nowszym sprzęcie zakupionym przez tego samego użytkownika, nosi nazwę

Ile par przewodów w standardzie 100Base-TX jest używanych do przesyłania danych w obie strony?

W jakiej topologii sieci komputerowej każdy węzeł ma bezpośrednie połączenie z każdym innym węzłem?

Zidentyfikuj powód pojawienia się komunikatu, który został pokazany na ilustracji

Jakie urządzenie powinno być użyte w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

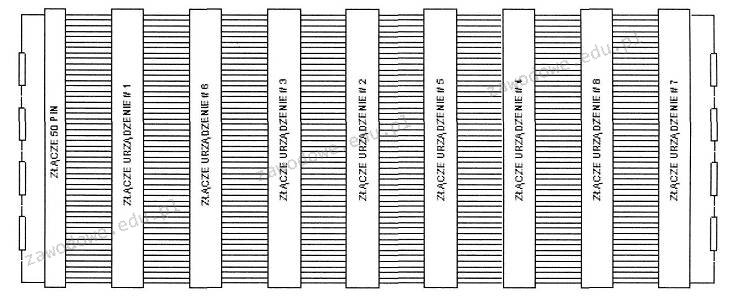

Za pomocą taśmy 60-pinowej pokazanej na ilustracji łączy się z płytą główną komputera

Która z licencji pozwala na darmowe korzystanie z programu, pod warunkiem, że użytkownik zadba o ekologię?

Który program pozwoli na zarządzanie zasobami i czasem oraz stworzenie harmonogramu prac montażowych zgodnie z projektem sieci lokalnej w budynku?

Instalacja systemów Linux oraz Windows 7 przebiegła bez żadnych problemów. Systemy zainstalowały się poprawnie z domyślnymi ustawieniami. Na tym samym komputerze, przy tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Jaki port na tylnym panelu płyty głównej jest w dokumentacji określany jako port zgodny z normą RS232C?

Polecenie do zmiany adresu MAC karty sieciowej w systemie Linux to

Do przeprowadzenia aktualizacji systemów Linux można zastosować aplikacje

Jaką wartość ma liczba 5638 zapisana w systemie szesnastkowym?

Zjawisko crosstalk, które występuje w sieciach komputerowych, polega na

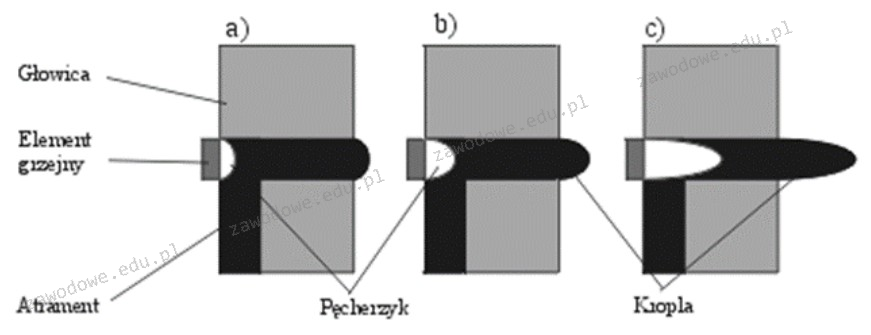

Rysunek ilustruje sposób działania drukarki

Które z metod szyfrowania wykorzystywanych w sieciach bezprzewodowych jest najsłabiej zabezpieczone przed łamaniem haseł?

Aby odzyskać dane ze sformatowanego dysku twardego, należy wykorzystać program

Który typ drukarki stosuje metodę przenoszenia stałego pigmentu z taśmy na papier odporny na wysoką temperaturę?

Podaj prefiks, który identyfikuje adresy globalne w protokole IPv6?

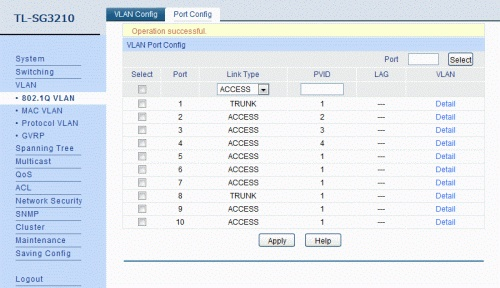

Na ilustracji przedstawiono konfigurację przełącznika z utworzonymi sieciami VLAN. Którymi portami można przesyłać oznaczone ramki z różnych sieci VLAN?

Typ systemu plików, który nie obsługuje tworzenia wewnętrznego rejestru zmian, zwanego księgowaniem, to

Bęben działający na zasadzie reakcji fotochemicznych jest wykorzystywany w drukarkach

Aby system operacyjny był skutecznie chroniony przed atakami złośliwego oprogramowania, po zainstalowaniu programu antywirusowego należy

Jaki adres IP należy do grupy A?

Która usługa opracowana przez Microsoft, pozwala na konwersję nazw komputerów na adresy URL?

Na płycie głównej z chipsetem Intel 865G

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?

Dysk zewnętrzny 3,5" o pojemności 5 TB, służący do przechowywania lub tworzenia kopii zapasowych, posiada obudowę z czterema interfejsami komunikacyjnymi do wyboru. Który z tych interfejsów należy wykorzystać do połączenia z komputerem, aby uzyskać największą prędkość transmisji?

Jakie polecenie w systemie Linux pozwala na zweryfikowanie adresu IP przypisanego do interfejsu sieciowego?

Ile sieci obejmują komputery z adresami IP przedstawionymi w tabeli oraz standardową maską sieci?

| Komputer 1 | 172.16.15.5 |

| Komputer 2 | 172.18.15.6 |

| Komputer 3 | 172.18.16.7 |

| Komputer 4 | 172.20.16.8 |

| Komputer 5 | 172.20.16.9 |

| Komputer 6 | 172.21.15.10 |

Wskaż standard protokołu wykorzystywanego do kablowego połączenia dwóch urządzeń

Aby utworzyć obraz dysku twardego, można skorzystać z programu

Kiedy wygasa autorskie prawo majątkowe dotyczące programu komputerowego, stworzonego przez kilku programistów, którzy jako jego autorzy podpisali aplikację swoimi imionami i nazwiskami?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Sieć, w której funkcjonuje komputer o adresie IP 192.168.100.50/28, została podzielona na 4 podsieci. Jakie są poprawne adresy tych podsieci?