Pytanie 1

Pierwszym krokiem, który należy podjąć, aby chronić ruter przed nieautoryzowanym dostępem do jego panelu administracyjnego, jest

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Pierwszym krokiem, który należy podjąć, aby chronić ruter przed nieautoryzowanym dostępem do jego panelu administracyjnego, jest

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue press DEL to setup. Naciśnięcie klawisza DEL spowoduje

W systemie Linux dane dotyczące okresu ważności hasła są przechowywane w pliku

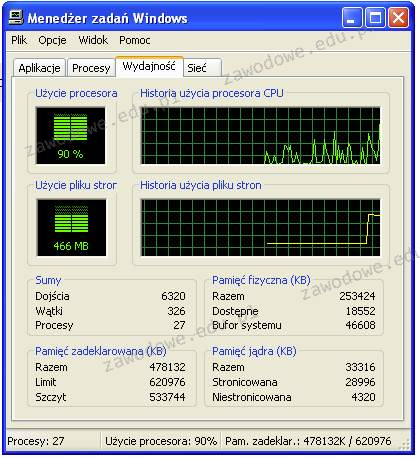

Przyglądając się przedstawionemu obrazkowi, można dostrzec, że deklarowany limit pamięci wynosi 620976 KB. Zauważamy również, że zainstalowana pamięć fizyczna w badanym systemie jest mniejsza niż pamięć zadeklarowana. Który typ pamięci wpływa na podniesienie limitu pamięci zadeklarowanej powyżej rozmiaru zainstalowanej pamięci fizycznej?

Jakie polecenie jest używane do ustawienia konfiguracji interfejsu sieciowego w systemie Linux?

Adres IP 192.168.2.0/24 został podzielony na cztery mniejsze podsieci. Jaką maskę mają te nowe podsieci?

Aby zweryfikować indeks stabilności systemu Windows Server, należy zastosować narzędzie

Jakie zastosowanie ma narzędzie tracert w systemach operacyjnych rodziny Windows?

Użytkownik systemu Linux, który pragnie usunąć konto innej osoby wraz z jej katalogiem domowym, powinien użyć polecenia

W której warstwie modelu ISO/OSI odbywa się segmentacja danych, komunikacja w trybie połączeniowym z użyciem protokołu TCP oraz komunikacja w trybie bezpołączeniowym z zastosowaniem UDP?

Jakie polecenie jest używane do monitorowania statystyk protokołów TCP/IP oraz bieżących połączeń sieciowych w systemach operacyjnych z rodziny Windows?

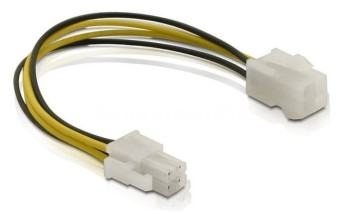

Wskaż złącze, które należy wykorzystać do podłączenia wentylatora, którego parametry przedstawiono w tabeli.

| Wymiar radiatora | 123 x 133 x 163 mm |

| Wentylator | 120 mm + 135 mm |

| Złącze | 4-pin PWM |

| Napięcie zasilające | 12V |

| Żywotność | 300 000h |

Aby poprawić bezpieczeństwo prywatnych danych sesji na stronie internetowej, zaleca się dezaktywację w ustawieniach przeglądarki

Administrator Active Directory w domenie firma.local pragnie skonfigurować profil mobilny dla wszystkich użytkowników. Profil ma być zapisywany na serwerze serwer1, w folderze pliki, udostępnionym w sieci jako dane$. Który z parametrów w ustawieniach profilu użytkownika spełnia te wymagania?

Aby zapobiec uszkodzeniu sprzętu podczas modernizacji laptopa, która obejmuje wymianę modułów pamięci RAM, należy

Aby zmienić port drukarki zainstalowanej w systemie Windows, która funkcja powinna zostać użyta?

Aby przeprowadzić aktualizację zainstalowanego systemu operacyjnego Linux Ubuntu, należy wykorzystać komendę

Ile par kabli jest używanych w standardzie 100Base-TX do obustronnej transmisji danych?

Jaką maskę powinno się zastosować, aby podzielić sieć z adresem 192.168.1.0 na 4 podsieci?

Jednym z narzędzi zabezpieczających system przed oprogramowaniem, które bez wiedzy użytkownika pozyskuje i wysyła jego autorowi dane osobowe, numery kart płatniczych, informacje o adresach stron WWW odwiedzanych przez użytkownika, hasła i używane adresy mailowe, jest program

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Podczas testowania kabla sieciowego zakończonego wtykami RJ45 przy użyciu diodowego testera okablowania, diody LED zapalały się w odpowiedniej kolejności, z wyjątkiem diod oznaczonych numerami 2 i 3, które świeciły równocześnie na jednostce głównej testera, natomiast na jednostce zdalnej nie świeciły wcale. Jaka mogła być tego przyczyna?

Wskaż urządzenie wyjścia.

Interfejs SATA 2 (3Gb/s) oferuje prędkość transferu

Adres IP komputera wyrażony sekwencją 172.16.0.1 jest zapisany w systemie

Co to jest urządzenie sieciowe most (ang. bridge)?

Firma uzyskała zakres adresów 10.10.10.0/16. Po podzieleniu na podsieci zawierające 510 hostów, jakie są adresy podsieci z zastosowaną maską?

Aby sygnały pochodzące z dwóch routerów w sieci WiFi pracującej w standardzie 802.11g nie wpływały na siebie nawzajem, należy skonfigurować kanały o numerach

W którym systemie operacyjnym może pojawić się komunikat podczas instalacji sterowników dla nowego urządzenia?

| System.......nie może zweryfikować wydawcy tego sterownika. Ten sterownik nie ma podpisu cyfrowego albo podpis nie został zweryfikowany przez urząd certyfikacji. Nie należy instalować tego sterownika, jeżeli nie pochodzi z oryginalnego dysku producenta lub od administratora systemu. |

Jaki będzie najniższy koszt zakupu kabla UTP, potrzebnego do okablowania kategorii 5e, aby połączyć panel krosowniczy z dwoma podwójnymi gniazdami natynkowymi 2 x RJ45, które są oddalone odpowiednio o 10 m i 20 m od panelu, jeśli cena 1 m kabla wynosi 1,20 zł?

Dysk zewnętrzny 3,5" o pojemności 5 TB, służący do przechowywania lub tworzenia kopii zapasowych, posiada obudowę z czterema interfejsami komunikacyjnymi do wyboru. Który z tych interfejsów należy wykorzystać do połączenia z komputerem, aby uzyskać największą prędkość transmisji?

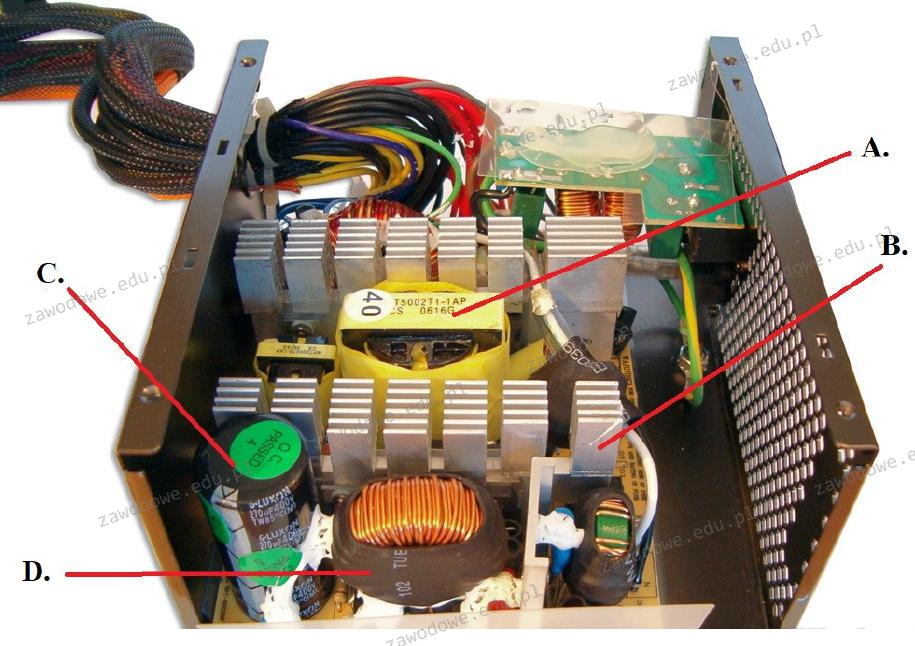

W przedstawionym zasilaczu transformator impulsowy oznaczono symbolami

Ile maksymalnie urządzeń, wliczając w nie huby oraz urządzenia końcowe, może być podłączonych do interfejsu USB za pomocą magistrali utworzonej przy użyciu hubów USB?

Oprogramowanie OEM (Original Equipment Manufacturer) jest związane z

Jakie polecenie powinien wydać root w systemie Ubuntu Linux, aby zaktualizować wszystkie pakiety (cały system) do najnowszej wersji, łącznie z nowym jądrem?

Który z protokołów powinien być zastosowany do pobierania wiadomości e-mail z własnego serwera?

Aby w przeglądarce internetowej wyczyścić dane dotyczące adresów przeglądanych witryn, należy między innymi podać

Jakie środowisko powinien wybrać administrator sieci, aby zainstalować serwer dla stron WWW w systemie Linux?

Jakie polecenie w systemie Linux rozpoczyna weryfikację dysku oraz pozwala na usunięcie jego usterek?

Jak nazywa się protokół, który pozwala na ściąganie wiadomości e-mail z serwera?