Pytanie 1

W komputerach stacjonarnych zamontowane są karty sieciowe Ethernet 10/100/1000 z gniazdem RJ45. Jakie medium transmisyjne powinno się zastosować w celu zbudowania sieci komputerowej zapewniającej najwyższą przepustowość?

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

W komputerach stacjonarnych zamontowane są karty sieciowe Ethernet 10/100/1000 z gniazdem RJ45. Jakie medium transmisyjne powinno się zastosować w celu zbudowania sieci komputerowej zapewniającej najwyższą przepustowość?

Jakie medium transmisyjne powinno być użyte do połączenia dwóch punktów dystrybucyjnych oddalonych od siebie o 600m?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aby zabezpieczyć system przed atakami z sieci nazywanymi phishingiem, nie powinno się

Najskuteczniejszym zabezpieczeniem sieci bezprzewodowej jest

Wskaż błędny podział dysku MBR na partycje?

Jakiego protokołu używa się do ściągania wiadomości e-mail z serwera pocztowego na komputer użytkownika?

W systemie Linux, aby wyświetlić informację o nazwie bieżącego katalogu roboczego, należy zastosować polecenie

W komputerach obsługujących wysokowydajne zadania serwerowe, konieczne jest użycie dysku z interfejsem

ARP (Address Resolution Protocol) to protokół, który pozwala na konwersję

Który podzespół nie jest kompatybilny z płytą główną MSI A320M Pro-VD-S socket AM4, 1 x PCI-Ex16, 2 x PCI-Ex1, 4 x SATA III, 2 x DDR4- max 32 GB, 1 x D-SUB, 1x DVI-D, ATX?

W systemie Linux istnieją takie prawa dostępu do konkretnego pliku rwxr--r--. Jakie polecenie użyjemy, aby zmienić je na rwxrwx---?

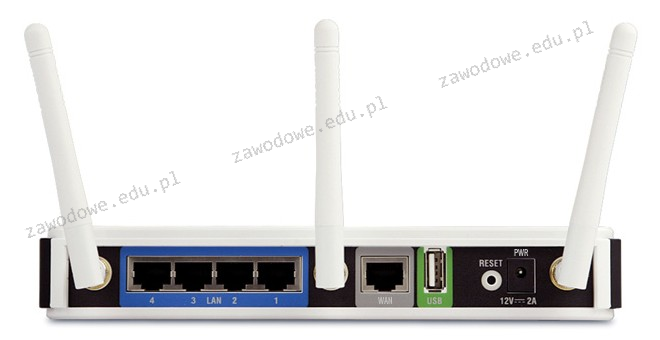

Do jakiego portu należy podłączyć kabel sieciowy zewnętrzny, aby uzyskać pośredni dostęp do sieci Internet?

Aby w systemie Windows, przy użyciu wiersza poleceń, zmienić partycję FAT na NTFS bez utraty danych, powinno się zastosować polecenie

Wskaż urządzenie, które powinno być użyte do połączenia dwóch komputerów z siecią Internet poprzez lokalną sieć Ethernet, gdy dysponujemy jedynie jednym adresem IP

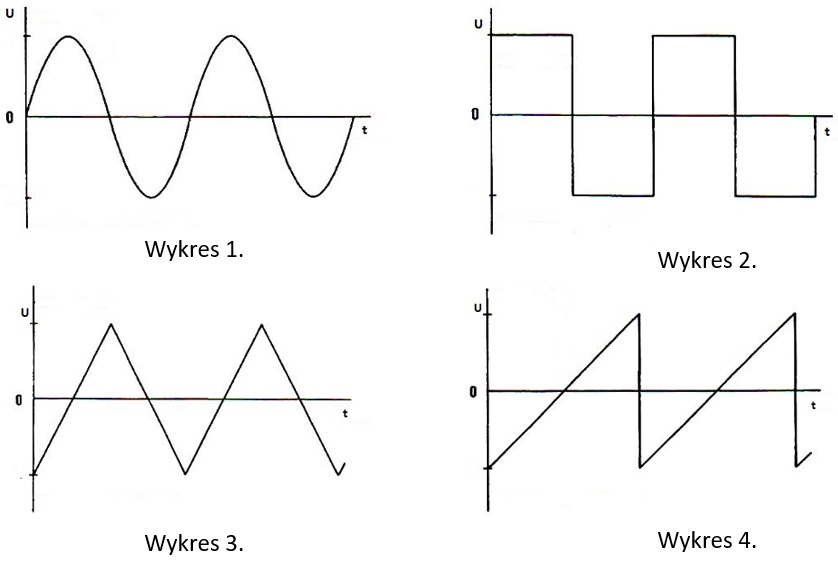

Na którym wykresie przedstawiono przebieg piłokształtny?

Aby naprawić zasilacz laptopa poprzez wymianę kondensatorów, jakie narzędzie powinno się wykorzystać?

Jaką maksymalną liczbę hostów można przypisać w lokalnej sieci, dysponując jedną klasą C adresów IPv4?

Jaką maksymalną ilość rzeczywistych danych można przesłać w ciągu 1 sekundy przez łącze synchroniczne o wydajności 512 kbps, bez użycia sprzętowej i programowej kompresji?

Co nie ma wpływu na utratę danych z dysku HDD?

Najefektywniejszym zabezpieczeniem danych firmy, której siedziby znajdują się w różnych, odległych od siebie lokalizacjach, jest zastosowanie

Najbardziej nieinwazyjnym, a zarazem efektywnym sposobem naprawy komputera zainfekowanego wirusem typu rootkit jest

Firma planuje stworzenie lokalnej sieci komputerowej, która będzie obejmować serwer, drukarkę oraz 10 stacji roboczych bez kart bezprzewodowych. Internet będzie udostępniany przez ruter z modemem ADSL i czterema portami LAN. Które z wymienionych elementów sieciowych jest konieczne, aby sieć mogła prawidłowo działać i uzyskać dostęp do Internetu?

Jaką fizyczną topologię sieci komputerowej przedstawiono na załączonym rysunku?

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się działania usuwania starych plików oraz dodawania nowych plików, doświadcza

Ile maksymalnie hostów można przydzielić w sieci o masce 255.255.255.192?

Jakie narzędzie należy zastosować do podłączenia zaszycia kabla w module Keystone?

Jakie cyfry należy wprowadzić na klawiaturze telefonu podłączonego do bramki VoIP po wcześniejszym wpisaniu *** aby ustalić adres bramy domyślnej sieci?

| Aby wejść w tryb konfiguracji należy wprowadzić *** po podniesieniu słuchawki. | ||

| Tabela przedstawia wszystkie parametry oraz ich opis | ||

| Parametr | Informacja | Opcje |

|---|---|---|

| Menu główne po wprowadzeniu *** | Wejście w tryb programowania | - następna opcja + powrót do menu głównego Należy wybrać parametr 01-05, 07, 12-17, 47 lub 99 |

| 01 | „DHCP" lub „statyczny IP" | Używając cyfry „9" przełączanie pomiędzy : statycznym i dynamicznym adresem. |

| 02 | Statyczny adres IP | Zostanie wyemitowany komunikat z adresem IP Należy wprowadzić nowy adres 12 cyfrowy za pomocą klawiatury numerycznej. |

| 03 | Maska podsieci + adres | Tak samo jak w przypadku 02 |

| 04 | Brama domyślna + adres | Tak samo jak w przypadku 02 |

| 05 | Adres serwera DNS | Tak samo jak w przypadku 02 |

W systemie Windows przypadkowo zlikwidowano konto użytkownika, lecz katalog domowy pozostał nietknięty. Czy możliwe jest odzyskanie nieszyfrowanych danych z katalogu domowego tego użytkownika?

Na których urządzeniach do przechowywania danych uszkodzenia mechaniczne są najczęściej spotykane?

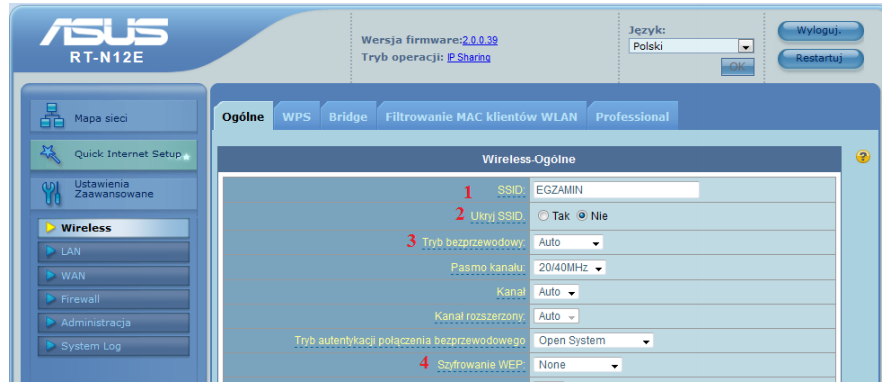

Aby zablokować widoczność identyfikatora sieci Wi-Fi, konieczne jest dokonanie zmian w ustawieniach rutera w sekcji oznaczonej numerem

Prawo majątkowe przysługujące twórcy programu komputerowego

Który z systemów operacyjnych przeznaczonych do pracy w sieci jest dostępny na podstawie licencji GNU?

Jakie jest połączenie używane do wymiany informacji pomiędzy urządzeniami mobilnymi, które stosuje cyfrową transmisję optyczną w trybie bezprzewodowym do przesyłania danych na stosunkowo krótką odległość?

W systemie Windows 7 konfigurację interfejsu sieciowego można przeprowadzić, używając rozwinięcia polecenia

Układy sekwencyjne stworzone z grupy przerzutników, najczęściej synchronicznych typu D, które mają na celu przechowywanie danych, to

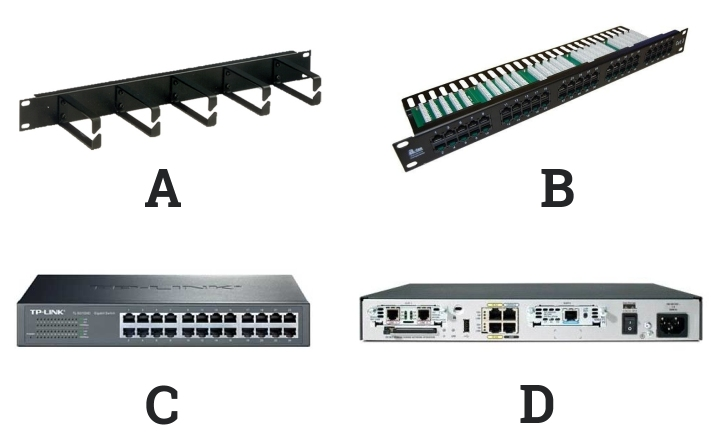

Na którym schemacie znajduje się panel krosowniczy?

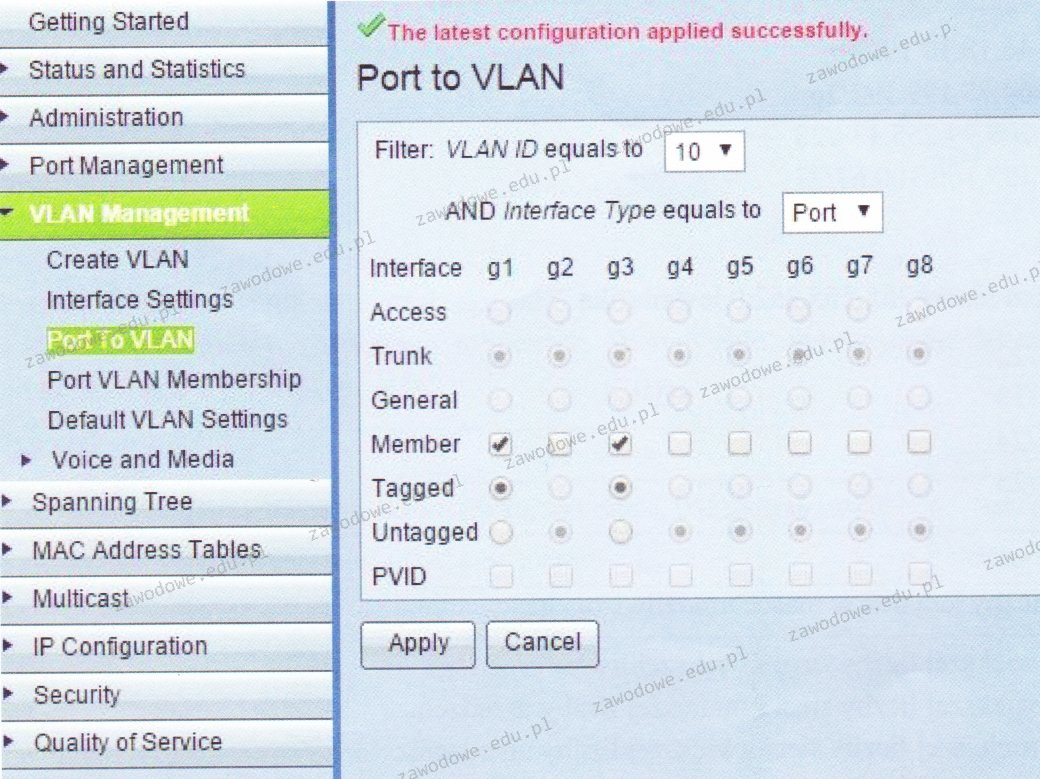

Na ilustracji przedstawiona jest konfiguracja

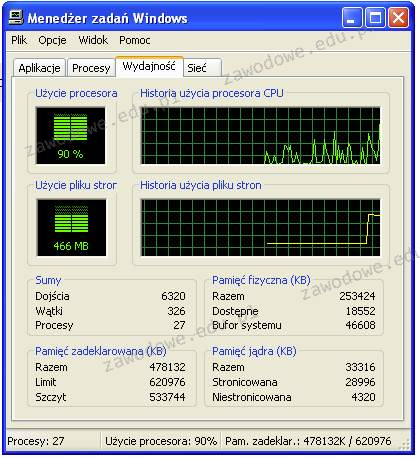

Przyglądając się przedstawionemu obrazkowi, można dostrzec, że deklarowany limit pamięci wynosi 620976 KB. Zauważamy również, że zainstalowana pamięć fizyczna w badanym systemie jest mniejsza niż pamięć zadeklarowana. Który typ pamięci wpływa na podniesienie limitu pamięci zadeklarowanej powyżej rozmiaru zainstalowanej pamięci fizycznej?

Na zdjęciu widać kartę