Pytanie 1

Po stwierdzeniu przypadkowego usunięcia ważnych danych na dysku twardym, aby odzyskać usunięte pliki, najlepiej

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Po stwierdzeniu przypadkowego usunięcia ważnych danych na dysku twardym, aby odzyskać usunięte pliki, najlepiej

Komunikat tekstowy KB/Interface error, wyświetlony na ekranie komputera z BIOS POST firmy AMI, informuje o błędzie

Program typu recovery, w warunkach domowych, pozwala na odzyskanie danych z dysku twardego w przypadku

Jaką przepustowość określa standard Ethernet IEEE 802.3z?

W systemie Linux, żeby ustawić domyślny katalog domowy dla nowych użytkowników na katalog /users/home/new, konieczne jest użycie polecenia

W sieciach opartych na standardzie, jaką metodę dostępu do medium wykorzystuje CSMA/CA?

Który adres IP jest zaliczany do klasy B?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Klient dostarczył wadliwy sprzęt komputerowy do serwisu. W trakcie procedury przyjmowania sprzętu, ale przed rozpoczęciem jego naprawy, serwisant powinien

Jakie polecenie w systemie Windows należy wpisać w miejsce kropek, aby uzyskać dane przedstawione na załączonym obrazku?

C:\Windows\system32> ................... Nazwa użytkownika Gość Pełna nazwa Komentarz Wbudowane konto do dostępu do komputera/domeny Komentarz użytkownika Kod kraju 000 (Domyślne ustawienia systemu) Konto jest aktywne Nie Wygasanie konta Nigdy Hasło ostatnio ustawiano 2019-11-23 10:55:12 Ważność hasła wygasa Nigdy Hasło może być zmieniane 2019-12-02 10:55:12 Wymagane jest hasło Nie Użytkownik może zmieniać hasło Nie Dozwolone stacje robocze Wszystkie Skrypt logowania Profil użytkownika Katalog macierzysty Ostatnie logowanie Nigdy Dozwolone godziny logowania Wszystkie Członkostwa grup lokalnych *Goście Członkostwa grup globalnych *None Polecenie zostało wykonane pomyślnie. C:\Windows\system32>

Wskaż usługę, którą należy skonfigurować na serwerze aby blokować ruch sieciowy?

Symbol "LGA 775" obecny w dokumentacji technicznej płyty głównej wskazuje na typ gniazda dla procesorów:

Ilustracja pokazuje rezultat testu sieci komputerowej za pomocą komendy

Jakie oprogramowanie chroni komputer przed niechcianym softwarem pochodzącym z sieci?

Do jakich celów powinno się aktywować funkcję RMON (Remote Network Monitoring) w przełączniku?

W systemie Linux polecenie chmod 321 start spowoduje nadanie następujących uprawnień plikowi start:

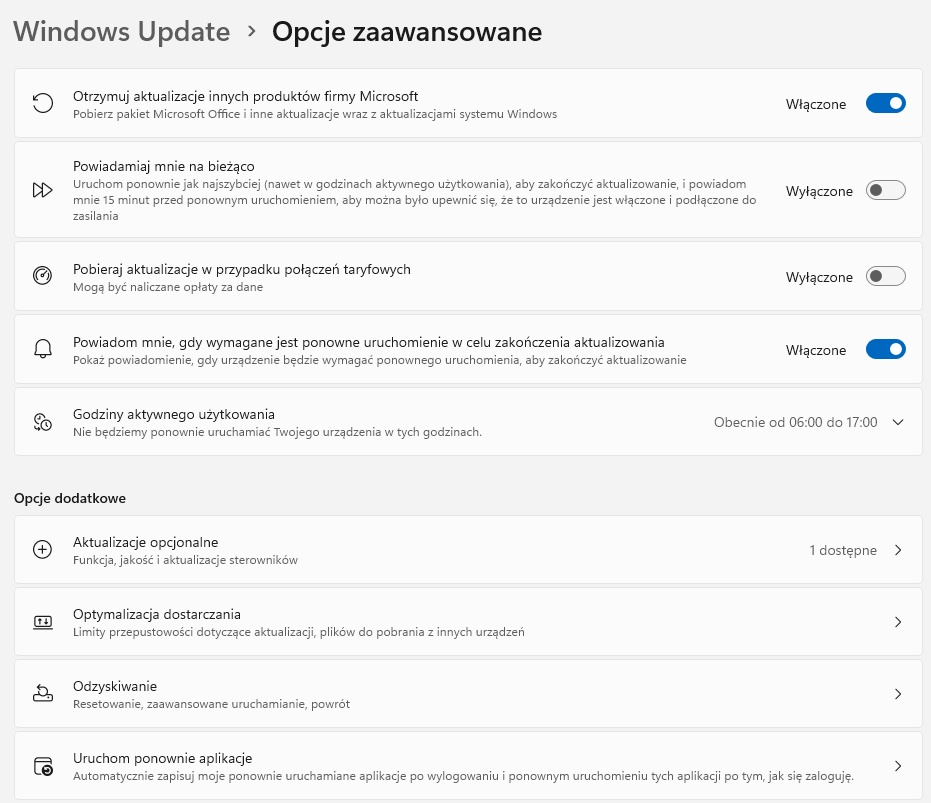

Biorąc pod uwagę konfigurację wykonywaną na ilustracji, administrator po zainstalowaniu systemu operacyjnego uznał za istotne, aby

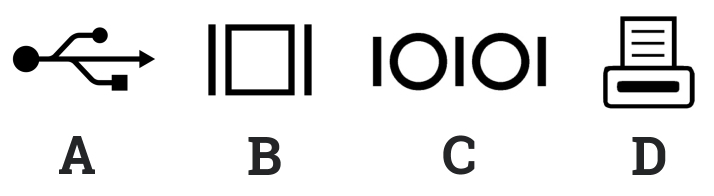

Wskaż ilustrację ilustrującą symbol stosowany do oznaczania portu równoległego LPT?

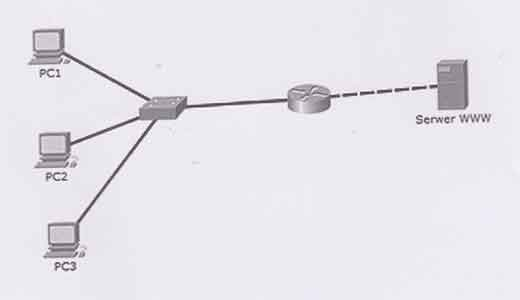

Użytkownicy w sieci lokalnej mogą się komunikować między sobą, lecz nie mają możliwości połączenia z serwerem WWW. Wynik polecenia ping z komputerów do bramy jest pozytywny. Który element sieci nie może być źródłem problemu?

Brak informacji o parzystości liczby lub o znaku wyniku operacji w ALU może sugerować problemy z funkcjonowaniem

Aby zweryfikować adresy MAC komputerów, które są połączone z przełącznikiem, można zastosować następujące polecenie

W trakcie instalacji systemu Windows Serwer 2022 istnieje możliwość instalacji w trybie Core. Oznacza to, że system zostanie zainstalowany

Osobom pracującym zdalnie, dostęp do serwera znajdującego się w prywatnej sieci za pośrednictwem publicznej infrastruktury, jaką jest Internet, umożliwia

Jak nazywa się protokół oparty na architekturze klient-serwer oraz modelu żądanie-odpowiedź, wykorzystywany do przesyłania plików?

Dobrze zaprojektowana sieć komputerowa powinna zapewniać możliwość rozbudowy, czyli charakteryzować się

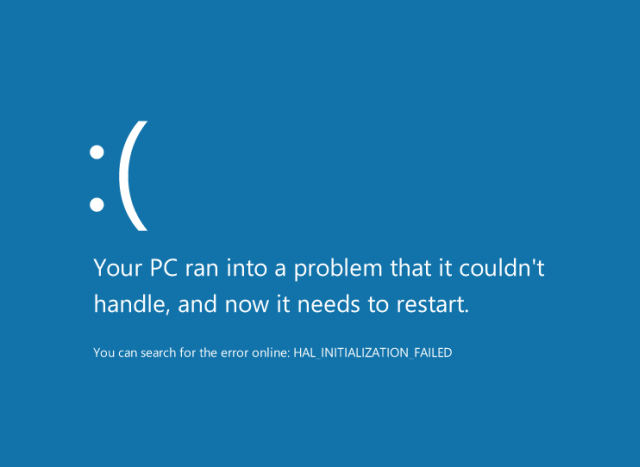

Zamieszczony komunikat tekstowy wyświetlony na ekranie komputera z zainstalowanym systemem Windows wskazuje na

Zjawisko przenikania, które ma miejsce w sieciach komputerowych, polega na

Poniżej zaprezentowano fragment pliku konfiguracyjnego serwera w systemie Linux. Jaką usługi dotyczy ten fragment?

option domain-name "meinheimnetz";

ddns-update-style none;

default-lease-time 14400;

subnet 192.168.1.0 netmask 255.255.255.0 {

range 192.168.1.10 192.168.1.20;

default-lease-time 14400;

max-lease-time 172800;

}Aby oczyścić zablokowane dysze kartridża drukarki atramentowej, co należy zrobić?

Jakie urządzenie sieciowe zostało pokazane na ilustracji?

Norma EN 50167 odnosi się do systemów okablowania

W architekturze ISO/OSI protokoły TCP oraz UDP funkcjonują w warstwie

Dane z HDD, którego sterownik silnika SM jest uszkodzony, można odzyskać

Jak nazywa się serwer Windows, na którym zainstalowano usługę Active Directory?

Jakie są prędkości przesyłu danych w sieciach FDDI (ang. Fiber Distributed Data Interface) wykorzystujących technologię światłowodową?

W jakiej logicznej topologii funkcjonuje sieć Ethernet?

Który z protokołów jest używany do przesyłania poczty elektronicznej?

Jak nazywa się topologia fizyczna, w której wszystkie urządzenia końcowe są bezpośrednio połączone z jednym punktem centralnym, takim jak koncentrator lub przełącznik?

W systemie Linux komenda tty pozwala na

Rejestr procesora, znany jako licznik rozkazów, przechowuje