Pytanie 1

W przypadku dysku twardego, w jakiej jednostce wyrażana jest wartość współczynnika MTBF (Mean Time Between Failure)?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

W przypadku dysku twardego, w jakiej jednostce wyrażana jest wartość współczynnika MTBF (Mean Time Between Failure)?

Symbol przedstawiony na ilustracji wskazuje na produkt

Przed dokonaniem zmian w rejestrze systemu Windows, w celu zapewnienia bezpieczeństwa pracy, należy najpierw

Zgodnie z normą PN-EN 50174, maksymalna długość kabla poziomego kategorii 6 pomiędzy punktem abonenckim a punktem dystrybucji w panelu krosowym wynosi

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

Jakie narzędzie jest używane w systemie Windows do przywracania właściwych wersji plików systemowych?

Aby chronić sieć WiFi przed nieautoryzowanym dostępem, należy między innymi

Protokół transportowy bez połączenia w modelu ISO/OSI to

Jak nazywa się interfejs wewnętrzny w komputerze?

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

Wykonując w konsoli systemu Windows Server komendę convert, co można zrealizować?

Usługa umożliwiająca przechowywanie danych na zewnętrznym serwerze, do którego dostęp możliwy jest przez Internet to

Protokół ARP (Address Resolution Protocol) służy do konwersji adresu IP na

Wskaż procesor współpracujący z przedstawioną płytą główną.

Producent wyświetlacza LCD stwierdził, że spełnia on wymagania klasy II według normy ISO 13406-2. Na podstawie danych przedstawionych w tabeli określ, ile pikseli z defektem typu 3 musi wystąpić na wyświetlaczu o naturalnej rozdzielczości 1280x800 pikseli, aby uznać go za uszkodzony?

| Klasa | Maksymalna liczba dopuszczalnych błędów na 1 milion pikseli | ||

|---|---|---|---|

| Typ 1 | Typ 2 | Typ 3 | |

| I | 0 | 0 | 0 |

| II | 2 | 2 | 5 |

| III | 5 | 15 | 50 |

| IV | 50 | 150 | 500 |

Aby przetestować w systemie Windows poprawność działania nowo zainstalowanej drukarki, należy

Aby w przeglądarce internetowej wyczyścić dane dotyczące adresów przeglądanych witryn, należy między innymi podać

Podczas wymiany uszkodzonej karty graficznej, która współpracowała z monitorem posiadającym jedynie wejście analogowe, jaką kartę należy wybrać?

W bezprzewodowej sieci firmowej aktywowano usługę, która zajmuje się tłumaczeniem nazw mnemonicznych. Co to za usługa?

Który z podanych adresów IP należy do kategorii adresów prywatnych?

Jakie jest kluczowe zadanie protokołu ICMP?

Jak nazywa się standard podstawki procesora bez nóżek?

Co należy zrobić, aby chronić dane przesyłane w sieci przed działaniem sniffera?

Obudowa oraz wyświetlacz drukarki fotograficznej są bardzo brudne. Jakie środki należy zastosować, aby je wyczyścić?

W której warstwie modelu ISO/OSI odbywa się segmentacja danych, komunikacja w trybie połączeniowym z użyciem protokołu TCP oraz komunikacja w trybie bezpołączeniowym z zastosowaniem UDP?

Jakie złącze powinna posiadać karta graficzna, aby umożliwić przesyłanie cyfrowego sygnału audio i wideo bez utraty jakości z komputera do zewnętrznego urządzenia, które jest podłączone do jej wyjścia?

Po wykonaniu podanego skryptu

| echo off |

| echo ola.txt >> ala.txt |

| pause |

Które z poniższych poleceń służy do naprawienia głównego rekordu rozruchowego dysku twardego w systemie Windows?

Jakie są różnice pomiędzy poleceniem ps a poleceniem top w systemie Linux?

Program do monitorowania, który umożliwia przechwytywanie, nagrywanie oraz dekodowanie różnych pakietów sieciowych to

Protokół, który pozwala urządzeniom na uzyskanie od serwera informacji konfiguracyjnych, takich jak adres IP bramy sieciowej, to

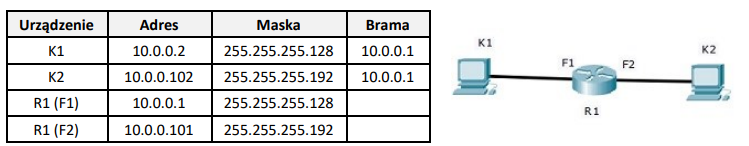

Komputery K1 i K2 nie są w stanie nawiązać komunikacji. Adresy urządzeń zostały przedstawione w tabeli. Co należy zmienić, aby przywrócić połączenie w sieci?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Który z systemów operacyjnych przeznaczonych do sieci jest dostępny na zasadach licencji GNU?

Która z wymienionych technologii pamięci RAM wykorzystuje oba zbocza sygnału zegarowego do przesyłania danych?

W hierarchicznym modelu sieci komputery użytkowników stanowią część warstwy

Obrazek ilustruje rezultat działania programu

│ ├── Checkbox_checked.svg │ └── Checkbox_unchecked.svg │ ├── revisions.txt │ ├── tools │ │ ├── howto.txt │ │ ├── Mangler │ │ │ ├── make.sh │ │ │ └── src │ │ │ └── Mangler.java │ │ └── WiFi101 │ │ ├── tool │ │ │ └── firmwares │ │ │ ├── 19.4.4 │ │ │ │ ├── m2m_aio_2b0.bin │ │ │ │ └── m2m_aio_3a0.bin │ │ │ └── 19.5.2 │ │ │ └── m2m_aio_3a0.bin │ │ └── WiFi101.jar │ ├── tools-builder │ │ └── ctags │ │ └── 5.8-arduino11 │ │ └── ctags │ └── uninstall.sh └── brother └── PTouch └── ql570 └── cupswrapper ├── brcupsconfpt1 └── cupswrapperql570pt1

Ilustracja pokazuje rezultat testu sieci komputerowej za pomocą komendy

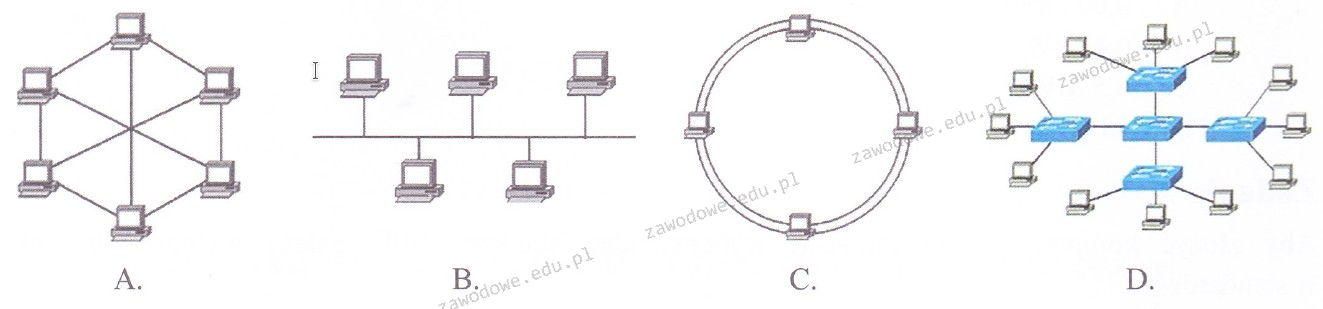

Na którym z przedstawionych rysunków ukazano topologię sieci typu magistrala?

Jaką maskę podsieci należy wybrać dla sieci numer 1 oraz sieci numer 2, aby urządzenia z podanymi adresami mogły komunikować się w swoich podsieciach?

| sieć nr 1 | sieć nr 2 | |

|---|---|---|

| 1 | 10.12.0.12 | 10.16.12.5 |

| 2 | 10.12.12.5 | 10.16.12.12 |

| 3 | 10.12.5.12 | 10.16.12.10 |

| 4 | 10.12.5.18 | 10.16.12.16 |

| 5 | 10.12.16.5 | 10.16.12.20 |