Pytanie 1

Jaką funkcję pełni punkt dostępowy, aby zabezpieczyć sieć bezprzewodową w taki sposób, aby jedynie urządzenia z wybranymi adresami MAC mogły się do niej łączyć?

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Jaką funkcję pełni punkt dostępowy, aby zabezpieczyć sieć bezprzewodową w taki sposób, aby jedynie urządzenia z wybranymi adresami MAC mogły się do niej łączyć?

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

Komunikat tekstowy KB/Interface error, wyświetlony na ekranie komputera z BIOS POST firmy AMI, informuje o błędzie

Osoba pragnąca jednocześnie drukować dokumenty w wersji oryginalnej oraz trzech kopiach na papierze samokopiującym, powinna nabyć drukarkę

Przedstawiony zestaw komputerowy jest niekompletny. Który element nie został uwzględniony w tabeli, a jest niezbędny do prawidłowego działania zestawu i należy go dodać?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Cooler Master obudowa komputerowa CM Force 500W czarna |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, TRAY/OEM |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Na dysku obok systemu Windows zainstalowano system Linux Ubuntu. W celu dostosowania kolejności uruchamiania systemów operacyjnych, należy zmienić zawartość

Jaki standard Ethernet należy wybrać przy bezpośrednim połączeniu urządzeń sieciowych, które dzieli odległość 1 km?

W jakiej topologii sieci fizycznej każdy komputer jest połączony z dokładnie dwoma sąsiadującymi komputerami, bez użycia dodatkowych urządzeń aktywnych?

Użytkownik systemu Windows doświadcza problemów z niewystarczającą pamięcią wirtualną. Jak można temu zaradzić?

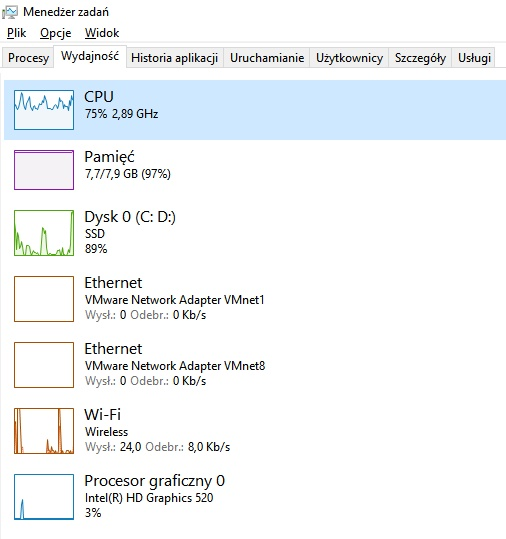

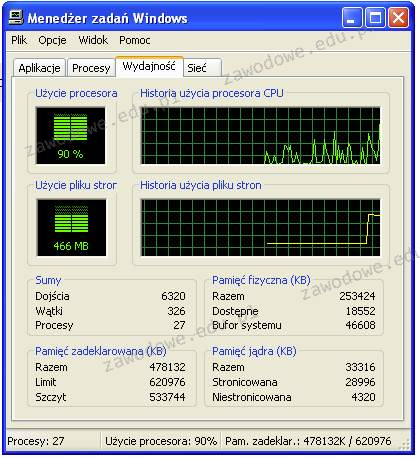

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

Wartości 1001 i 100 w pliku /etc/passwd wskazują na

| student:x:1001:100:Jan Kowalski:/home/student:/bin/bash |

Jakie medium transmisyjne w sieciach LAN zaleca się do użycia w budynkach zabytkowych?

Jakie urządzenie powinno zostać wykorzystane do podłączenia komputerów, aby mogły funkcjonować w odrębnych domenach rozgłoszeniowych?

W jakiej logicznej topologii działa sieć Ethernet?

Na ilustracji pokazano tylną część panelu

Aktualizacja systemów operacyjnych to proces, którego głównym zadaniem jest

Przedstawione na ilustracji narzędzie służy do

W drukarce laserowej do stabilizacji druku na papierze używane są

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

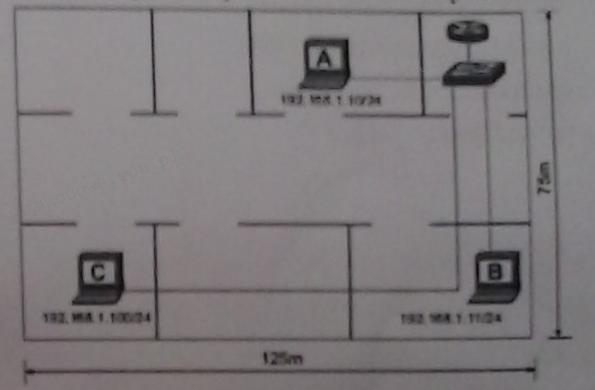

Na ilustracji przedstawiono sieć lokalną zbudowaną na kablach kat. 6. Stacja robocza "C" nie ma możliwości komunikacji z siecią. Jaki problem w warstwie fizycznej może powodować brak połączenia?

Optyczna rozdzielczość to jeden z atrybutów

Jakie właściwości topologii fizycznej sieci zostały przedstawione w poniższej ramce?

Jaką maksymalną liczbę podstawowych partycji na dysku twardym z tablicą MBR można utworzyć za pomocą narzędzia Zarządzanie dyskami dostępnego w systemie Windows?

Jaką funkcję pełni serwer FTP?

Do konfiguracji i personalizacji środowiska graficznego GNOME w różnych systemach Linux należy wykorzystać program

Notacja #108 oznacza zapis liczby w systemie

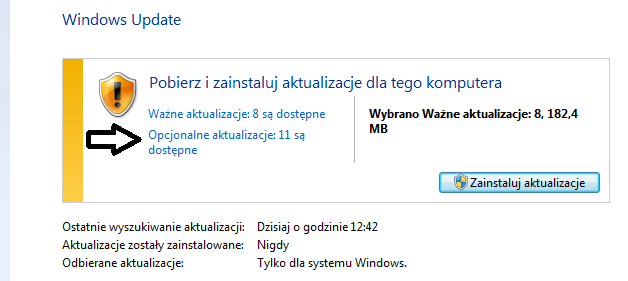

Jeśli użytkownik wybierze pozycję wskazaną strzałką, będzie mógł zainstalować aktualizacje

Przyglądając się przedstawionemu obrazkowi, można dostrzec, że deklarowany limit pamięci wynosi 620976 KB. Zauważamy również, że zainstalowana pamięć fizyczna w badanym systemie jest mniejsza niż pamięć zadeklarowana. Który typ pamięci wpływa na podniesienie limitu pamięci zadeklarowanej powyżej rozmiaru zainstalowanej pamięci fizycznej?

Jakie urządzenie wykorzystuje się do pomiaru napięcia w zasilaczu?

Zarządzaniem drukarkami w sieci, obsługiwaniem zadań drukowania oraz przyznawaniem uprawnień do drukarek zajmuje się serwer

Jakie parametry otrzyma interfejs sieciowy eth0 po wykonaniu poniższych poleceń w systemie Linux?

Na ilustracji zaprezentowano końcówkę kabla

Aby zapewnić możliwość odzyskania ważnych danych, należy regularnie

Po wykonaniu instalacji z domyślnymi parametrami system Windows XP NIE OBSŁUGUJE formatu systemu plików

Jak określić długość prefiksu adresu sieci w adresie IPv4?

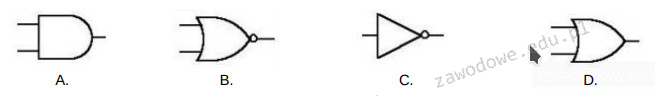

Wskaź rysunek ilustrujący symbol bramki logicznej NOT?

Program, który nie jest przeznaczony do analizy stanu komputera to

W systemie Linux narzędzie top pozwala na

Jak nazywa się protokół bazujący na architekturze klient-serwer oraz na modelu żądanie-odpowiedź, który jest używany do transferu plików?

Złocenie styków złącz HDMI ma na celu