Pytanie 1

Główna rola serwera FTP polega na

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Główna rola serwera FTP polega na

Aby w systemie Linux wykonać kopię zapasową określonych plików, należy wprowadzić w terminalu polecenie programu

Aby w przeglądarce internetowej wyczyścić dane dotyczące adresów przeglądanych witryn, należy między innymi podać

W skanerze z systemem CIS źródłem światła oświetlającym skanowany dokument jest

Jaką pamięć RAM można użyć z płytą główną GIGABYTE GA-X99-ULTRA GAMING/ X99/ 8x DDR4 2133, ECC, obsługującą maksymalnie 128GB, 4x PCI-E 16x, RAID, USB 3.1, S-2011-V3/ATX?

Czym jest licencja OEM?

Która topologia fizyczna umożliwia nadmiarowe połączenia pomiędzy urządzeniami w sieci?

W trakcie instalacji oraz konfiguracji serwera DHCP w systemach z rodziny Windows Server istnieje możliwość dodania zastrzeżeń adresów, które określą

Wskaż nieprawidłowy sposób podziału dysków MBR na partycje?

Ile maksymalnie urządzeń, wliczając w nie huby oraz urządzenia końcowe, może być podłączonych do interfejsu USB za pomocą magistrali utworzonej przy użyciu hubów USB?

Do obserwacji stanu urządzeń w sieci wykorzystywane jest oprogramowanie operujące na podstawie protokołu

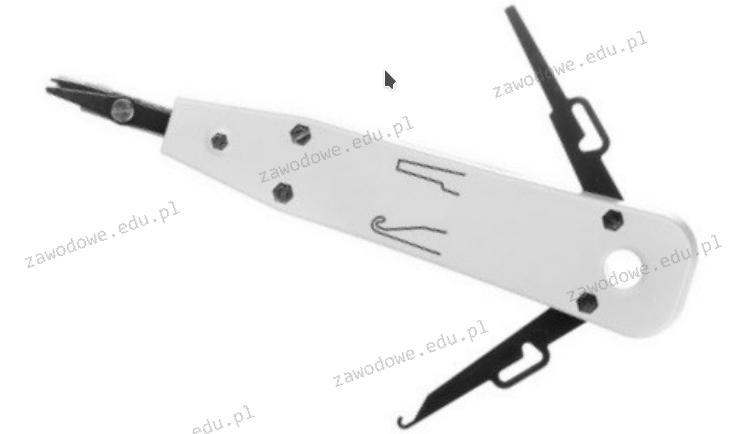

Urządzenie przedstawione na ilustracji oraz jego dane techniczne mogą być użyte do pomiarów rodzaju okablowania

Na skutek użycia polecenia ipconfig uzyskano konfigurację przedstawioną na ilustracji. Jaki jest adres IP stacji roboczej, która została poddana testom?

Sufiks DNS konkretnego połączenia :

Opis. . . . . . . . . . . . . . . : Realtek RTL8168C(P)/8111C(P)

PCI-E Gigabit Ethernet NIC

Adres fizyczny. . . . . . . . . . : 00-1F-D0-A5-0B-57

DHCP włączone . . . . . . . . . . : Tak

Autokonfiguracja włączona . . . . : Tak

Adres IP. . . . . . . . . . . . . : 192.168.0.11

Maska podsieci. . . . . . . . . . : 255.255.255.0

Brama domyślna. . . . . . . . . . : 192.168.0.1

Serwer DHCP . . . . . . . . . . . : 192.168.0.1

Serwery DNS . . . . . . . . . . . : 62.21.99.95Urządzenie pokazane na ilustracji służy do

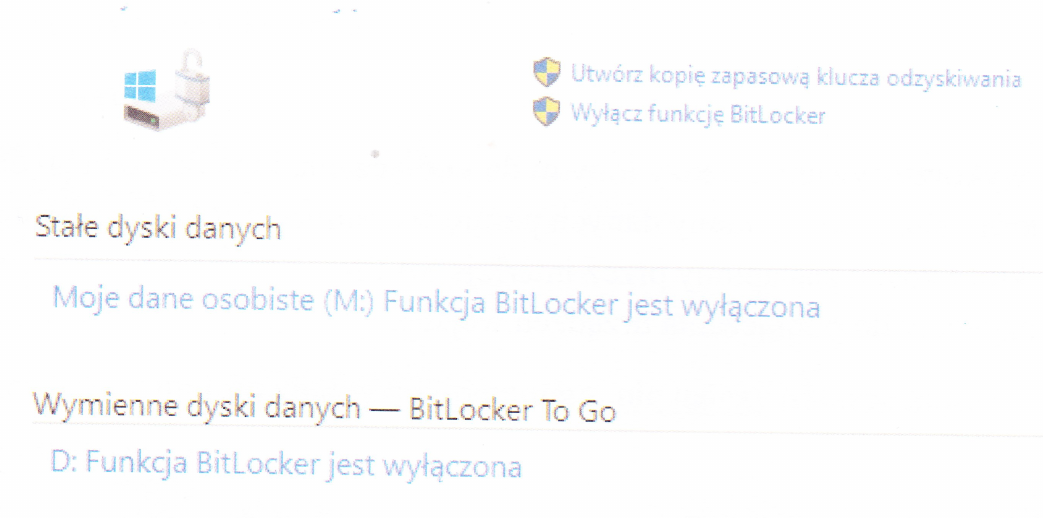

Wbudowane narzędzie dostępne w systemach Windows w edycji Enterprise lub Ultimate jest przeznaczone do

Jakie będzie rezultatem dodawania liczb 10011012 i 110012 w systemie binarnym?

W systemie Windows zastosowanie zaprezentowanego polecenia spowoduje chwilową modyfikację koloru

Microsoft Windows [Version 10.0.14393] (c) 2016 Microsoft Corporation. Wszelkie prawa zastrzeżone. C:\Users\ak>color 1

Karta dźwiękowa, która pozwala na odtwarzanie plików w formacie MP3, powinna być zaopatrzona w układ

Do wyświetlenia daty w systemie Linux można wykorzystać polecenie

Napięcie dostarczane do poszczególnych elementów komputera w zasilaczu komputerowym w standardzie ATX jest zmniejszane z wartości 230V między innymi do wartości

W systemie Windows można przeprowadzić analizę wpływu uruchomionych aplikacji na wydajność komputera, korzystając z polecenia

W systemie Linux program top umożliwia

W jednostce ALU do akumulatora została zapisana liczba dziesiętna 240. Jak wygląda jej reprezentacja w systemie binarnym?

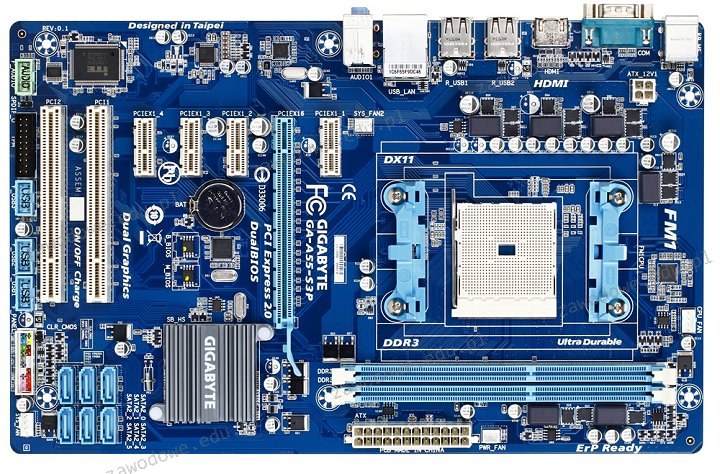

Jakim interfejsem można przesyłać dane między płyta główną, przedstawioną na ilustracji, a urządzeniem zewnętrznym, nie zasilając jednocześnie tego urządzenia przez ten interfejs?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Komputer A, który musi wysłać dane do komputera B znajdującego się w sieci z innym adresem IP, najpierw przekazuje pakiety do adresu IP

Które polecenie w systemie Linux służy do zakończenia procesu?

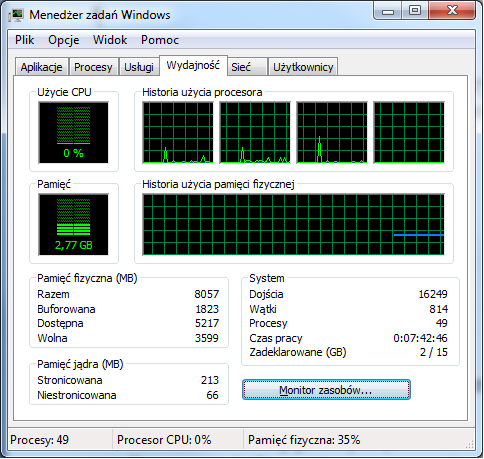

W systemie Windows do uruchomienia przedstawionego narzędzia należy użyć polecenia

Program, który nie jest przeznaczony do analizy stanu komputera to

Sprzęt, który pozwala na komunikację pomiędzy hostami w tej samej sieci a hostami w różnych sieciach, to

Po przeprowadzeniu eksportu klucza HKCR zostanie utworzona kopia rejestru, zawierająca dane dotyczące konfiguracji

Na przedstawionym rysunku widoczna jest karta rozszerzeń z systemem chłodzenia

Które z urządzeń używanych w sieciach komputerowych nie modyfikuje liczby kolizyjnych domen?

Na załączonym zdjęciu znajduje się

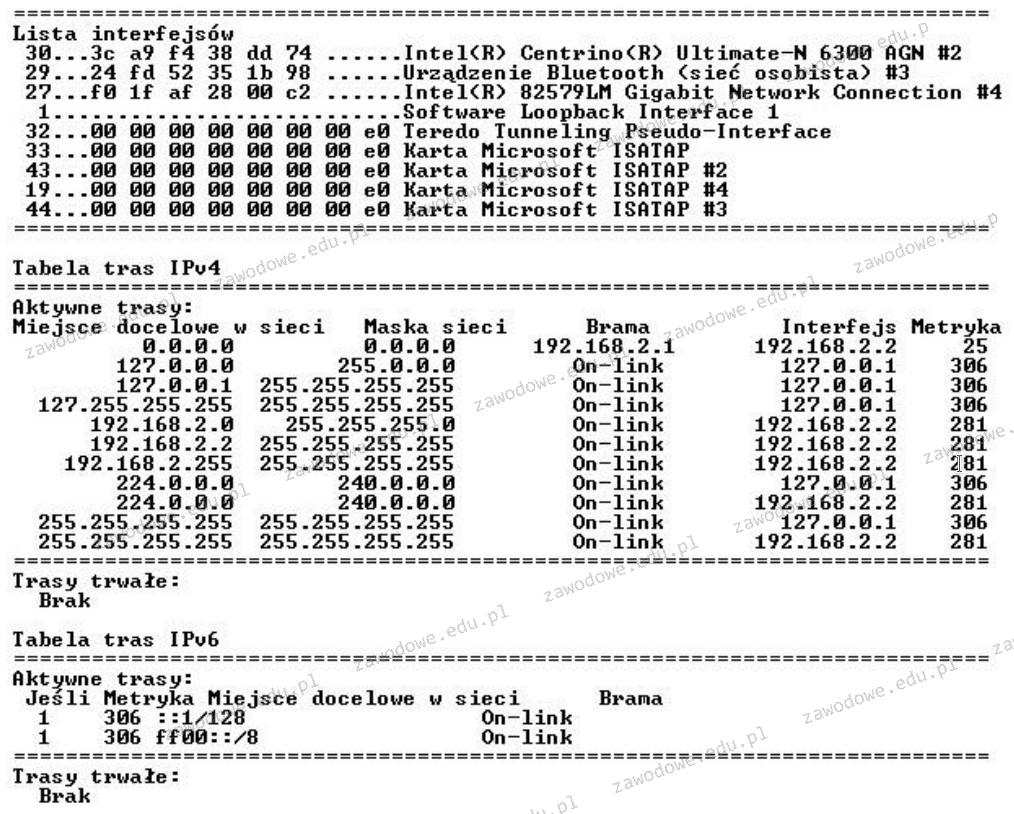

Jaki jest rezultat realizacji którego polecenia w systemie operacyjnym z rodziny Windows, przedstawiony na poniższym rysunku?

Czym jest postcardware?

Topologia fizyczna, w której wszystkie urządzenia końcowe są bezpośrednio połączone z jednym punktem centralnym, takim jak koncentrator lub switch, to topologia

Sprawdzenie ilości wolnego miejsca na dysku twardym w systemie Linux umożliwia polecenie

W którym z rejestrów wewnętrznych procesora są przechowywane dodatkowe informacje o wyniku realizowanej operacji?

Emisja dźwięków: jednego długiego oraz dwóch krótkich przez BIOS firmy AMI wskazuje na