Pytanie 1

Oprogramowanie, które pozwala na interakcję pomiędzy kartą sieciową a systemem operacyjnym, to

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Oprogramowanie, które pozwala na interakcję pomiędzy kartą sieciową a systemem operacyjnym, to

Rozmiar pliku wynosi 2 KiB. Co to oznacza?

Płyta główna z gniazdem G2 będzie kompatybilna z procesorem

Użytkownik uszkodził płytę główną z gniazdem procesora AM2. Uszkodzoną płytę można zastąpić, bez konieczności wymiany procesora i pamięci, modelem z gniazdem

Jaką czynność konserwacyjną należy wykonywać przy użytkowaniu skanera płaskiego?

Jakim złączem zasilany jest wewnętrzny dysk twardy typu IDE?

Układ cyfrowy wykonujący operację logiczną koniunkcji opiera się na bramce logicznej

Złącze widoczne na obrazku pozwala na podłączenie

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Możliwość odzyskania listy kontaktów z telefonu komórkowego działającego na systemie Android występuje, gdy użytkownik wcześniej przeprowadził synchronizację danych urządzenia z Google Drive przy użyciu

Zgodnie z normą 802.3u technologia sieci FastEthernet 100Base-FX stosuje

Określ, jaki jest rezultat wykonania powyższego polecenia.

| netsh advfirewall firewall add rule name="Open" dir=in action=deny protocol=TCP localport=53 |

Protokół stosowany do rozgłaszania w grupie, dzięki któremu hosty informują o swoim członkostwie, to

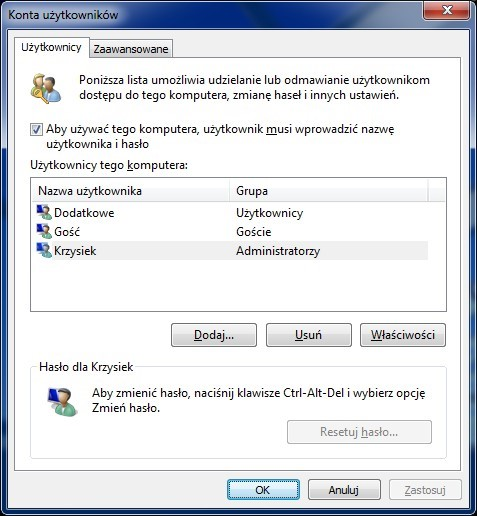

Aby uruchomić przedstawione narzędzie systemu Windows, należy użyć polecenia

Oprogramowanie diagnostyczne komputera pokazało komunikat NIC ERROR. Co ten komunikat wskazuje?

Jakie zakresy częstotliwości określa klasa EA?

Na rysunku ukazano diagram

Urządzenie typu Plug and Play, które jest ponownie podłączane do komputera, jest identyfikowane na podstawie

W topologii elementem centralnym jest switch

GRUB, LILO, NTLDR to

Który z wymienionych formatów płyt głównych charakteryzuje się najmniejszymi wymiarami?

Jakie medium transmisyjne powinno być użyte do połączenia dwóch punktów dystrybucyjnych oddalonych o 600m?

W jakim typie skanera stosuje się fotopowielacze?

Podaj polecenie w systemie Windows Server, które umożliwia usunięcie jednostki organizacyjnej z katalogu.

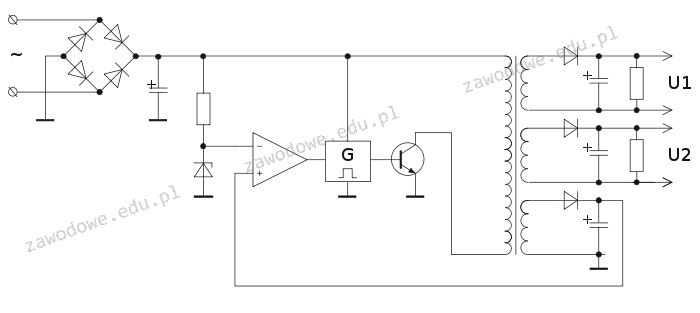

Na dołączonym obrazku pokazano działanie

Przygotowując ranking dostawców łączy internetowych należy zwrócić uwagę, aby jak najmniejsze wartości miały parametry

Usługa w systemie Windows Server, która umożliwia zdalną instalację systemów operacyjnych na komputerach zarządzanych przez serwer, to

Który instrument służy do pomiaru długości oraz tłumienności przewodów miedzianych?

Zjawisko, w którym pliki przechowywane na dysku twardym są umieszczane w nieprzylegających do siebie klastrach, nosi nazwę

Zasadniczym sposobem zabezpieczenia danych przechowywanych na serwerze jest

Jakie protokoły przesyłają cykliczne kopie tablic routingu do sąsiadującego rutera i NIE ZAWIERAJĄ pełnych informacji o dalekich ruterach?

Z informacji przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi

| 184 styki |

| 64-bitowa szyna danych |

| Pojemność 1024 MB |

| Przepustowość 3200 MB/s |

Podłączona mysz bezprzewodowa sprawia, że kursor na ekranie nie porusza się płynnie i „skacze”. Co może być przyczyną tego problemu?

Na ilustracji zobrazowano

Jakiego typu rozbudowa serwera wymaga zainstalowania dodatkowych sterowników?

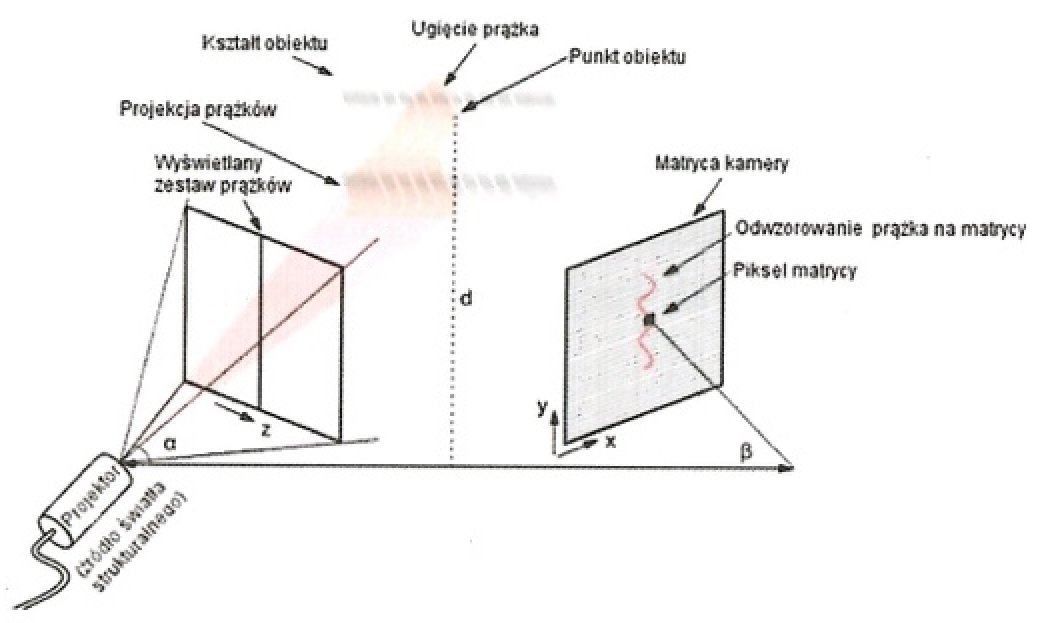

Zaprezentowany diagram ilustruje zasadę funkcjonowania skanera

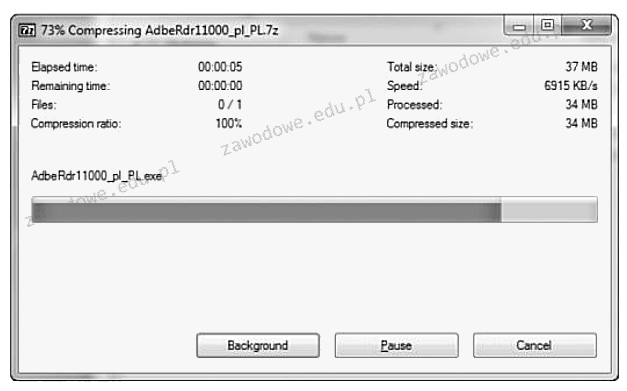

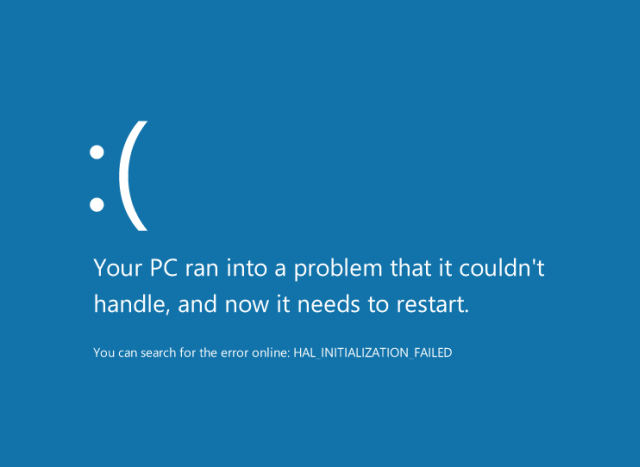

Zamieszczony komunikat tekstowy wyświetlony na ekranie komputera z zainstalowanym systemem Windows wskazuje na

NAT64 (Network Address Translation 64) to proces, który dokonuje mapowania adresów

Jak nazywa się kod kontrolny, który służy do wykrywania błędów oraz potwierdzania poprawności danych odbieranych przez stację końcową?

Ile urządzeń jest w stanie współpracować z portem IEEE1394?