Pytanie 1

Który układ mikroprocesora jest odpowiedzialny między innymi za pobieranie rozkazów z pamięci oraz generowanie sygnałów sterujących?

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

Który układ mikroprocesora jest odpowiedzialny między innymi za pobieranie rozkazów z pamięci oraz generowanie sygnałów sterujących?

Aby podłączyć dysk z interfejsem SAS, konieczne jest użycie kabla przedstawionego na ilustracji

Na komputerze, na którym zainstalowane są dwa systemy – Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows drugi system przestaje się uruchamiać. Aby ponownie umożliwić uruchamianie systemu Linux oraz aby zachować wszystkie dane i ustawienia w nim zawarte, co należy zrobić?

Który adres IP jest najwyższy w sieci 196.10.20.0/26?

Który protokół umożliwia rozproszoną wymianę i ściąganie plików?

Wskaż procesor współpracujący z przedstawioną płytą główną.

Który z dynamicznych protokołów rutingu został stworzony jako protokół bramy zewnętrznej do łączenia różnych dostawców usług internetowych?

Użytkownik drukarki samodzielnie i poprawnie napełnił pojemnik z tonerem. Po jego zamontowaniu drukarka nie podejmuje się próby drukowania. Co może być przyczyną tej usterki?

W metodzie dostępu do medium CSMA/CD (Carrier Sense Multiple Access with Collision Detection) stacja, która planuje rozpocząć transmisję, nasłuchuje, czy w sieci występuje aktywność, a następnie

Aby zweryfikować w systemie Windows działanie nowo zainstalowanej drukarki, co należy zrobić?

Układy sekwencyjne stworzone z grupy przerzutników, najczęściej synchronicznych typu D, które mają na celu przechowywanie danych, to

Czym jest dziedziczenie uprawnień?

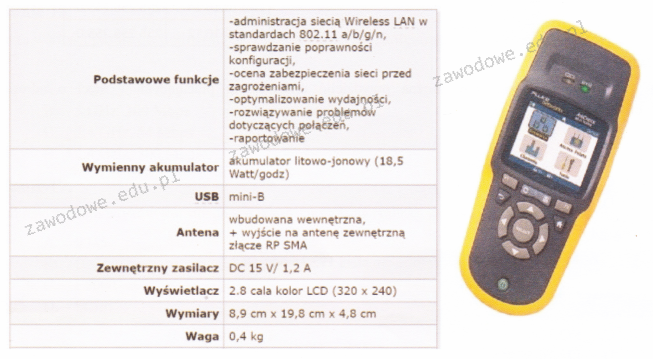

Jakie urządzenie diagnostyczne jest pokazane na ilustracji oraz opisane w specyfikacji zawartej w tabeli?

W sieciach opartych na standardzie, jaką metodę dostępu do medium wykorzystuje CSMA/CA?

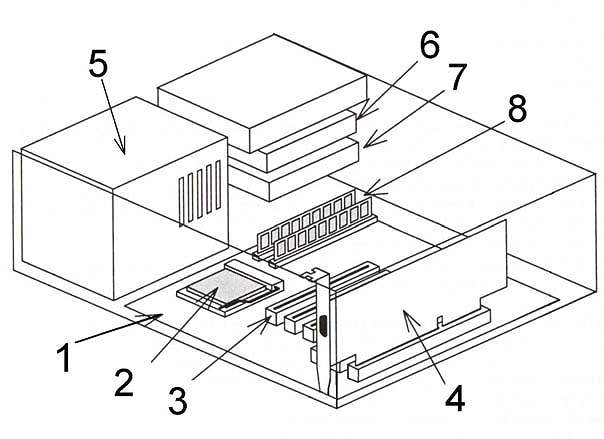

Na ilustracji karta rozszerzeń jest oznaczona numerem

Jaka jest maksymalna prędkość transferu danych w sieci lokalnej, w której zastosowano przewód UTP kat.5e do budowy okablowania strukturalnego?

Adres MAC (Medium Access Control Address) to sprzętowy identyfikator karty sieciowej Ethernet w warstwie modelu OSI

Przedstawiony zestaw komputerowy jest niekompletny. Który element nie został uwzględniony w tabeli, a jest niezbędny do prawidłowego działania zestawu i należy go dodać?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Cooler Master obudowa komputerowa CM Force 500W czarna |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, TRAY/OEM |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Jaki będzie wynik operacji odejmowania dwóch liczb szesnastkowych: 60Aₕ – 3BFₕ?

System S.M.A.R.T jest stworzony do kontrolowania działania i identyfikacji usterek

Jaki protokół sygnalizacyjny jest wykorzystywany w technologii VoIP?

Kable światłowodowe nie są szeroko używane w lokalnych sieciach komputerowych z powodu

W systemie Linux komendą, która jednocześnie podnosi uprawnienia dla procesu uruchamianego z terminala, jest

Symbol zaprezentowany powyżej, używany w dokumentacji technicznej, wskazuje na

Programem w systemie Linux, który umożliwia nadzorowanie systemu za pomocą zcentralizowanego mechanizmu, jest narzędzie

Jakie jest oprogramowanie serwerowe dla systemu Linux, które pozwala na współdziałanie z grupami roboczymi oraz domenami Windows?

Do dynamicznej obsługi sprzętu w Linuxie jest stosowany system

W systemie Linux uprawnienia pliku wynoszą 541. Właściciel ma możliwość:

Na wyświetlaczu drukarki wyświetlił się komunikat "PAPER JAM". W celu usunięcia problemu, najpierw należy

Jakie urządzenie jest używane do pomiaru napięcia w zasilaczu?

W pierwszym oktecie adresów IPv4 klasy B znajdują się liczby mieszczące się w przedziale

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie urządzenie wykorzystuje się do łączenia lokalnej sieci bezprzewodowej z siecią kablową?

W systemie Linux do śledzenia wykorzystania procesora, pamięci, procesów oraz obciążenia systemu wykorzystuje się polecenie

Rodzaj przesyłania danych do jednego lub wielu komputerów jednocześnie, w którym odbiorcy są postrzegani przez nadawcę jako jedyny zbiorczy odbiorca, to

Protokół ARP (Address Resolution Protocol) służy do konwersji adresu IP na

Wynikiem dodawania liczb \( 33_{(8)} \) oraz \( 71_{(8)} \) jest liczba

Jaką najwyższą liczbę urządzeń można przypisać w sieci z adresacją IPv4 klasy C?

Adres IP jest zapisany jako cztery grupy liczb, które są oddzielone kropkami

Zgodnie z normą PN-EN 50174, maksymalna długość kabla poziomego kategorii 6 pomiędzy punktem abonenckim a punktem dystrybucji w panelu krosowym wynosi