Pytanie 1

Według modelu TCP/IP protokoły DNS, FTP i SMTP są przypisane do warstwy

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Według modelu TCP/IP protokoły DNS, FTP i SMTP są przypisane do warstwy

Program Mozilla Firefox jest udostępniany na zasadach licencji

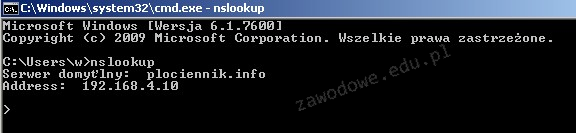

W terminalu systemu operacyjnego wydano komendę nslookup. Jakie dane zostały uzyskane?

Aby uzyskać listę procesów aktualnie działających w systemie Linux, należy użyć polecenia

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie polecenie w systemie operacyjnym Windows służy do wyświetlenia konfiguracji interfejsów sieciowych?

Martwy piksel, będący defektem monitorów LCD, to punkt, który trwa niezmiennie w kolorze

Karta dźwiękowa, która pozwala na odtwarzanie plików w formacie MP3, powinna być zaopatrzona w układ

Który z poniższych protokołów nie jest wykorzystywany do konfiguracji wirtualnej sieci prywatnej?

Czym jest parametr, który określa, o ile moc sygnału w danej parze przewodów zmniejszy się po przejściu przez cały tor kablowy?

W jakim protokole komunikacyjnym adres nadawcy ma długość 128 bitów?

Atak informatyczny, który polega na wyłudzaniu wrażliwych danych osobowych poprzez udawanie zaufanej osoby lub instytucji, nazywamy

Zasilacz UPS o mocy nominalnej 480 W nie powinien być używany do zasilania

Jakie urządzenie należy wykorzystać do zestawienia komputerów w sieci przewodowej o strukturze gwiazdy?

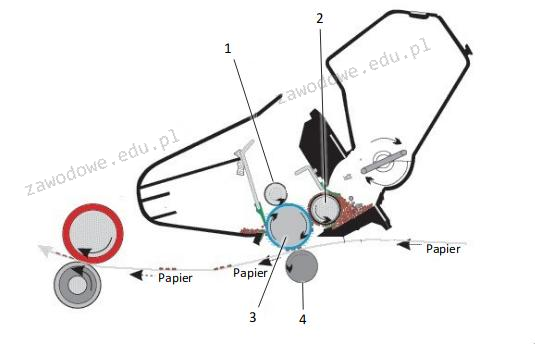

Bęben światłoczuły stanowi kluczowy element w funkcjonowaniu drukarki

W systemie Windows do wyświetlenia treści pliku tekstowego służy polecenie

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

Adapter USB do LPT może być użyty w przypadku braku kompatybilności złączy podczas podłączania starszych urządzeń

Do automatycznej synchronizacji dokumentów redagowanych przez kilka osób w tym samym czasie, należy użyć

Dysk zewnętrzny 3,5" o pojemności 5 TB, używany do archiwizacji lub wykonywania kopii zapasowych, wyposażony jest w obudowę z czterema interfejsami komunikacyjnymi do wyboru. Który z tych interfejsów powinien być użyty do podłączenia do komputera, aby uzyskać najwyższą prędkość transferu?

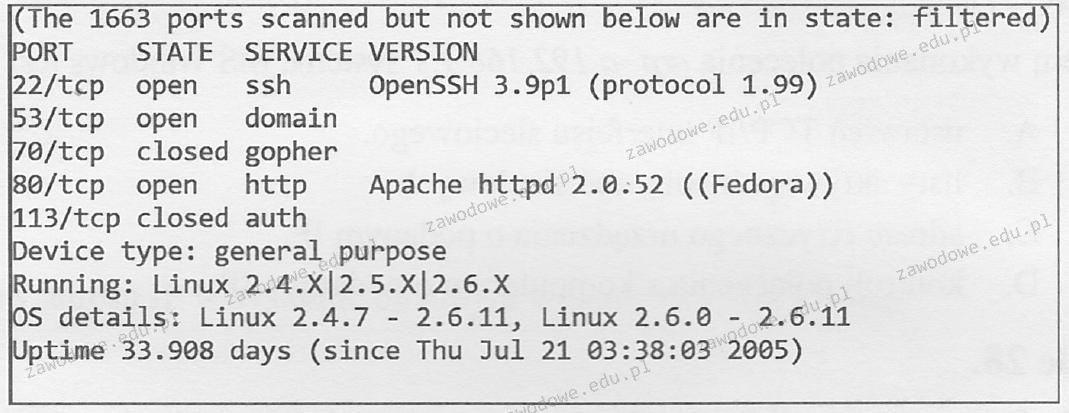

Jaki program został wykorzystany w systemie Linux do szybkiego skanowania sieci?

Który z komponentów nie jest zgodny z płytą główną MSI A320M Pro-VD-S socket AM4, 1 x PCI-Ex16, 2 x PCI-Ex1, 4 x SATA III, 2 x DDR4- maks. 32 GB, 1 x D-SUB, 1x DVI-D, ATX?

Jak nazywa się translacja adresów źródłowych w systemie NAT routera, która zapewnia komputerom w sieci lokalnej dostęp do internetu?

W systemie Linux, aby wyświetlić informację o nazwie bieżącego katalogu roboczego, należy zastosować polecenie

Jakie urządzenie powinno być użyte do segmentacji domeny rozgłoszeniowej?

Liczba 45H w systemie ósemkowym wyraża się jako

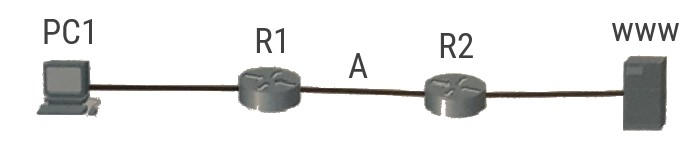

Ramka danych przesyłanych z komputera PC1 do serwera www znajduje się pomiędzy ruterem R1 a ruterem R2 (punkt A). Jakie adresy są w niej zawarte?

Norma TIA/EIA-568-B.2 definiuje szczegóły dotyczące parametrów transmisji

Jednym ze sposobów na ograniczenie dostępu do sieci bezprzewodowej dla nieuprawnionych osób jest

Czym dokonuje się przekształcenia kodu źródłowego w program do wykonania?

W sieciach bezprzewodowych typu Ad-Hoc IBSS (Independent Basic Service Set) wykorzystywana jest topologia fizyczna

Liczba 22 umieszczona w adresie http://www.adres_serwera.pl:22 wskazuje na numer

W systemie Linux komenda tty pozwala na

Określenie najlepszej trasy dla połączenia w sieci to

Procesory AMD z gniazdem AM2+ będą prawidłowo funkcjonować na płycie głównej, która ma podstawkę socket

Znak handlowy dla produktów certyfikowanych według standardów IEEE 802.11 to

Z jakiego oprogramowania NIE można skorzystać, aby przywrócić dane w systemie Windows na podstawie wcześniej wykonanej kopii?

Urządzeniem, które przekształca otrzymane ramki w sygnały przesyłane później w sieci komputerowej, jest

Na schemacie ilustrującym konstrukcję drukarki, w której toner jest nierównomiernie dostarczany do bębna, należy wskazać wałek magnetyczny oznaczony numerem

Protokół transportowy bez połączenia w modelu ISO/OSI to