Pytanie 1

Standard IEEE 802.11b dotyczy sieci

Wynik: 15/40 punktów (37,5%)

Wymagane minimum: 20 punktów (50%)

Standard IEEE 802.11b dotyczy sieci

Urządzenie sieciowe działające w trzeciej warstwie modelu ISO/OSI, obsługujące adresy IP, to

Urządzenie warstwy dystrybucji, które umożliwia komunikację pomiędzy różnymi sieciami, to

Jakie polecenie w systemie Linux umożliwia wyświetlenie identyfikatora użytkownika?

Podczas pracy dysk twardy wydaje stukanie, a uruchamianie systemu oraz odczyt danych są znacznie spowolnione. W celu naprawienia tej awarii, po wykonaniu kopii zapasowej danych na zewnętrznym nośniku należy

Aby w systemie Windows nadać użytkownikowi możliwość zmiany czasu systemowego, potrzebna jest przystawka

Jakie polecenie należy wykorzystać w systemie Windows, aby usunąć bufor nazw domenowych?

Lokalny komputer posiada adres 192.168.0.5. Po otwarciu strony internetowej z tego urządzenia, która rozpoznaje adresy w sieci, wyświetla się informacja, że jego adres to 195.182.130.24. Co to oznacza?

Aktywacja opcji OCR podczas ustawiania skanera umożliwia

Sieć komputerowa, która obejmuje wyłącznie urządzenia jednej organizacji, w której dostępne są usługi realizowane przez serwery w sieci LAN, takie jak strony WWW czy poczta elektroniczna to

W systemie Windows, gdzie można ustalić wymagania dotyczące złożoności hasła?

Jak można przywrócić domyślne ustawienia płyty głównej, gdy nie ma możliwości uruchomienia BIOS Setup?

Tester strukturalnego okablowania umożliwia weryfikację

Zbiór zasad określających metodę wymiany danych w sieci to

Który z poniższych protokołów jest używany do bezpiecznego przesyłania danych w sieci?

Kabel typu skrętka, w którym pojedyncza para żył jest pokryta folią, a całość kabla jest osłonięta ekranem z folii i siatki, oznacza się symbolem

Aby połączyć projektor multimedialny z komputerem, nie można zastosować złącza

Jak nazywa się jednostka przeprowadzająca obliczenia stałoprzecinkowe?

Zarządzaniem czasem procesora dla różnych zadań zajmuje się

Urządzenie, które łączy różne segmenty sieci i przekazuje ramki pomiędzy nimi, wybierając odpowiedni port docelowy dla przesyłanych ramek, to

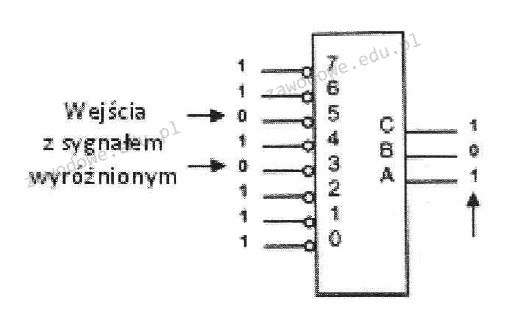

Na ilustracji przedstawiono symbol urządzenia cyfrowego

Aby skopiować folder c:\test wraz ze wszystkimi podfolderami na przenośny dysk f:\ w systemie Windows 7, jakie polecenie należy zastosować?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

W modelu RGB, kolor w systemie szesnastkowym przedstawia się w ten sposób: ABCDEF. Wartość natężenia koloru niebieskiego w tym zapisie odpowiada liczbie dziesiętnej

Natychmiast po dostrzeżeniu utraty istotnych plików na dysku twardym, użytkownik powinien

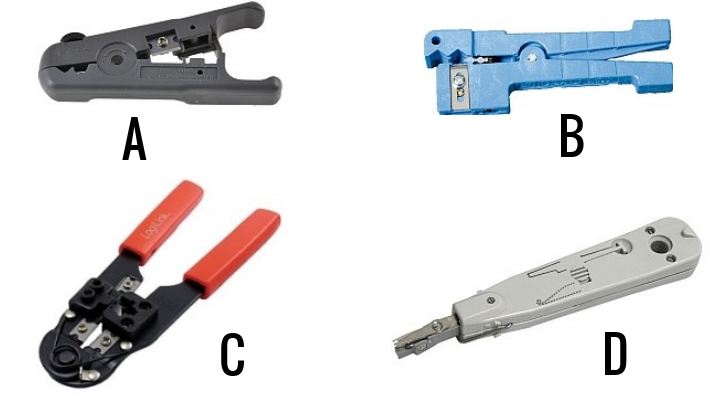

Jakie narzędzie wykorzystuje się do przytwierdzania kabla w module Keystone?

Jakie polecenie w systemie Linux pozwala na zarządzanie uprawnieniami do plików oraz katalogów?

Monitor CRT jest podłączany do karty graficznej przy użyciu złącza

Jaką konfigurację sieciową może posiadać komputer, który należy do tej samej sieci LAN co komputer z adresem 192.168.1.10/24?

Który poziom macierzy RAID zapisuje dane jednocześnie na wielu dyskach jako jedno urządzenie?

Jaki instrument jest wykorzystywany do sprawdzania zasilaczy komputerowych?

Okablowanie wertykalne w sieci strukturalnej łączy

Przedstawiony na ilustracji symbol oznacza

Wykonanie polecenia net use Z:192.168.20.2data /delete spowoduje?

Po uruchomieniu komputera, procedura POST wskazuje 512 MB RAM. Natomiast w ogólnych właściwościach systemu operacyjnego Windows wyświetla się wartość 480 MB RAM. Jakie są powody tej różnicy?

W usłudze, jaką funkcję pełni protokół RDP?

Jaką nazwę powinien mieć identyfikator, aby urządzenia w sieci mogły działać w danej sieci bezprzewodowej?

W tabeli zaprezentowano specyfikacje czterech twardych dysków. Dysk, który oferuje najwyższą średnią prędkość odczytu danych, to

| Pojemność | 320 GB | 320 GB | 320 GB | 320 GB |

| Liczba talerzy | 2 | 3 | 2 | 2 |

| Liczba głowic | 4 | 6 | 4 | 4 |

| Prędkość obrotowa | 7200 obr./min | 7200 obr./min | 7200 obr./min | 7200 obr./min |

| Pamięć podręczna | 16 MB | 16 MB | 16 MB | 16 MB |

| Czas dostępu | 8.3 ms | 8.9 ms | 8.5 ms | 8.6 ms |

| Interfejs | SATA II | SATA II | SATA II | SATA II |

| Obsługa NCQ | TAK | NIE | TAK | TAK |

| Dysk | A. | B. | C. | D. |

Jakiego typu wkrętak należy użyć do wypięcia dysku twardego mocowanego w laptopie za pomocą podanych śrub?

Do kategorii oprogramowania określanego jako malware (z ang. malicious software) nie zalicza się oprogramowanie typu: