Pytanie 1

Jaką maksymalną liczbę hostów można przypisać w lokalnej sieci, dysponując jedną klasą C adresów IPv4?

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Jaką maksymalną liczbę hostów można przypisać w lokalnej sieci, dysponując jedną klasą C adresów IPv4?

Jaki protokół sieciowy używa portu 53?

AC-72-89-17-6E-B2 to adres MAC karty sieciowej zapisany w formacie

Aby osiągnąć wysoką jakość połączeń głosowych VoIP kosztem innych przesyłanych informacji, konieczne jest włączenie i skonfigurowanie na routerze usługi

Aby określić długość prefiksu w adresie IPv4, należy ustalić

W dokumentacji jednego z komponentów komputera zawarto informację, że urządzenie obsługuje OpenGL. Jakiego elementu dotyczy ta dokumentacja?

Które złącze powinna posiadać karta graficzna, aby można było bezpośrednio ją połączyć z telewizorem LCD wyposażonym wyłącznie w analogowe złącze do podłączenia komputera?

W systemie Windows ochrona polegająca na ostrzeganiu przed uruchomieniem nierozpoznanych aplikacji i plików pobranych z Internetu jest realizowana przez

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Programem wiersza poleceń w systemie Windows, który umożliwia kompresję oraz dekompresję plików i folderów, jest aplikacja

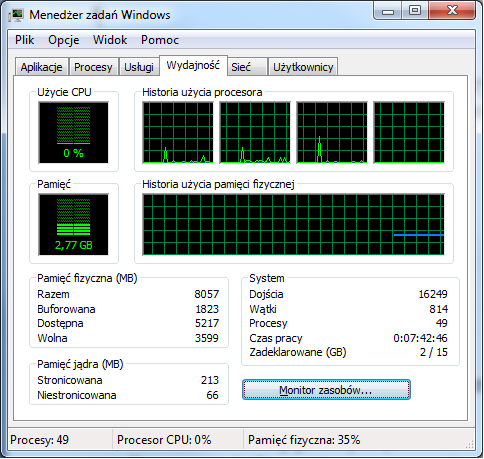

W systemie Windows do uruchomienia przedstawionego narzędzia należy użyć polecenia

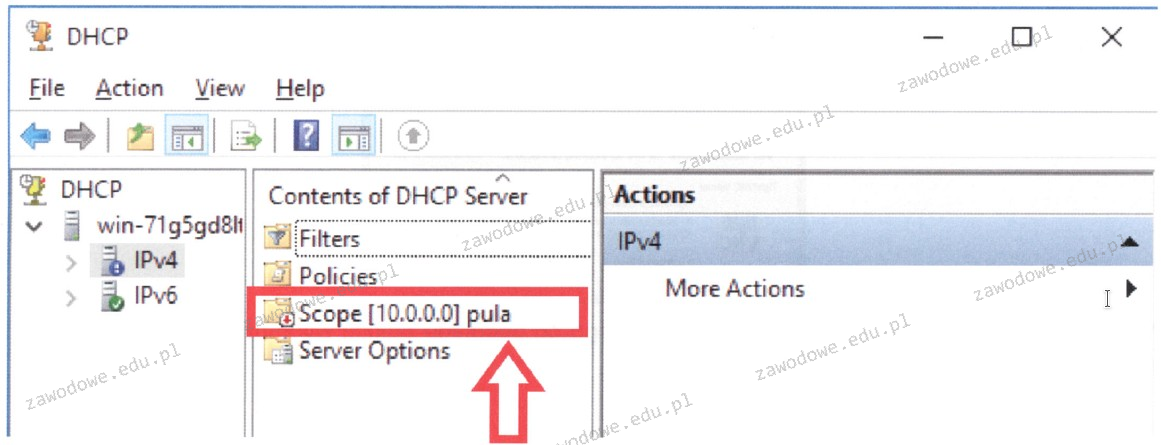

W systemie serwerowym Windows widoczny jest zakres adresów IPv4. Ikona umieszczona obok jego nazwy sugeruje, że

Aby podłączyć 6 komputerów do sieci przy użyciu światłowodu, potrzebny jest kabel z co najmniej taką ilością włókien:

Jakie napięcie jest obniżane z 230 V w zasilaczu komputerowym w standardzie ATX dla różnych podzespołów komputera?

Sprzęt używany w sieciach komputerowych, posiadający dedykowane oprogramowanie do blokowania nieautoryzowanego dostępu do sieci, to

Oblicz całkowity koszt kabla UTP Cat 6, który służy do połączenia 5 punktów abonenckich z punktem dystrybucyjnym, wiedząc, że średnia długość między punktem abonenckim a punktem dystrybucyjnym wynosi 8m oraz że cena brutto za 1m kabla to 1zł. W obliczeniach uwzględnij dodatkowy zapas 2m kabla dla każdego punktu abonenckiego.

Adres komórki pamięci został podany w kodzie binarnym 1110001110010100. Jak zapisuje się ten adres w systemie szesnastkowym?

Jakie polecenie w systemie Windows należy użyć, aby ustalić liczbę ruterów pośrednich znajdujących się pomiędzy hostem źródłowym a celem?

W systemie Linux komendą, która jednocześnie podnosi uprawnienia dla procesu uruchamianego z terminala, jest

Czym jest patchcord?

Który z poniższych mechanizmów zagwarantuje najwyższy poziom ochrony w sieciach bezprzewodowych opartych na standardzie 802.11n?

Jaką standardową wartość maksymalnej odległości można zastosować pomiędzy urządzeniami sieciowymi, które są ze sobą połączone przewodem UTP kat.5e?

W którym modelu płyty głównej można zamontować procesor o podanych parametrach?

| Intel Core i7-4790 3,6 GHz 8MB cache s. 1150 Box |

Lokalny komputer posiada adres 192.168.0.5. Po otwarciu strony internetowej z tego urządzenia, która rozpoznaje adresy w sieci, wyświetla się informacja, że jego adres to 195.182.130.24. Co to oznacza?

Zasadniczym sposobem zabezpieczenia danych przechowywanych na serwerze jest

NIEWŁAŚCIWE podłączenie taśmy sygnałowej do napędu dyskietek skutkuje

Ile bitów minimum będzie wymaganych w systemie binarnym do zapisania liczby szesnastkowej 110ₕ?

W systemie Linux program, który odpowiada aplikacji chkdsk z Windows, to

W systemie Windows można zweryfikować parametry karty graficznej, używając następującego polecenia

W którym typie macierzy, wszystkie fizyczne dyski są postrzegane jako jeden dysk logiczny?

Gniazdo w sieciach komputerowych, które jednoznacznie identyfikuje dany proces na urządzeniu, stanowi kombinację

Po wykonaniu instalacji z domyślnymi parametrami system Windows XP NIE OBSŁUGUJE formatu systemu plików

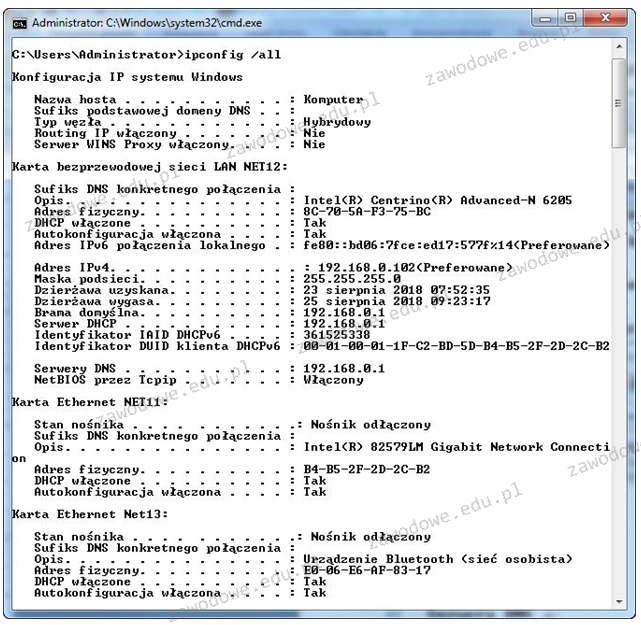

Analizując przedstawione wyniki konfiguracji zainstalowanych kart sieciowych na komputerze, można zauważyć, że

Nazwa licencji oprogramowania komputerowego, które jest dystrybuowane bezpłatnie, lecz z ograniczoną przez twórcę funkcjonalnością w porównaniu do pełnej, płatnej wersji, gdzie po upływie 30 dni zaczynają się wyświetlać reklamy oraz przypomnienia o konieczności rejestracji, to

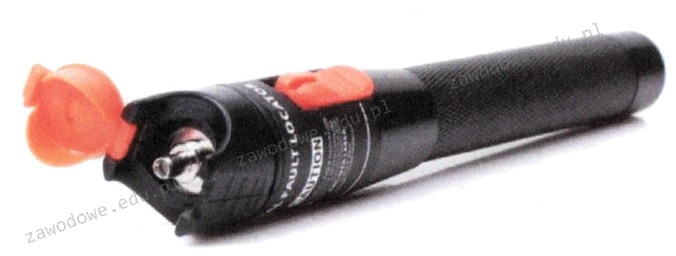

Zaprezentowane narzędzie jest wykorzystywane do

Przedstawiony moduł pamięci należy zamontować na płycie głównej w gnieździe

Informacja zawarta na ilustracji może wskazywać na

Jakie oprogramowanie jest wykorzystywane do dynamicznej obsługi urządzeń w systemie Linux?

Wartość liczby dziesiętnej 128(d) w systemie heksadecymalnym wyniesie

W systemie Linux uruchomiono skrypt z czterema argumentami. Jak można uzyskać dostęp do listy wszystkich wartości w skrypcie?