Pytanie 1

Jaką liczbę bitów posiada adres logiczny IPv6?

Wynik: 7/40 punktów (17,5%)

Wymagane minimum: 20 punktów (50%)

Jaką liczbę bitów posiada adres logiczny IPv6?

Jaką komendę należy wykorzystać, aby uzyskać informację o rekordzie MX dla podanej domeny?

Po przeanalizowaniu wyników testu dysku twardego, jakie czynności powinny zostać wykonane, aby zwiększyć jego wydajność?

| Wolumin (C:) | ||

| Rozmiar woluminu | = | 39,06 GB |

| Rozmiar klastra | = | 4 KB |

| Zajęte miejsce | = | 27,48 GB |

| Wolne miejsce | = | 11,58 GB |

| Procent wolnego miejsca | = | 29 % |

| Fragmentacja woluminu | ||

| Fragmentacja całkowita | = | 15 % |

| Fragmentacja plików | = | 31 % |

| Fragmentacja wolnego miejsca | = | 0 % |

Jeżeli podczas uruchamiania systemu BIOS od AWARD komputer wydał długi sygnał oraz dwa krótkie, co to oznacza?

Wskaż zewnętrzny protokół rutingu?

Czym jest klaster komputerowy?

W systemie Linux narzędzie top pozwala na

Urządzenie sieciowe nazywane mostem (ang. bridge) to:

Pierwszą usługą, która jest instalowana na serwerze, to usługa domenowa w Active Directory. W trakcie instalacji kreator automatycznie poprosi o zainstalowanie usługi serwera.

Thunderbolt to interfejs

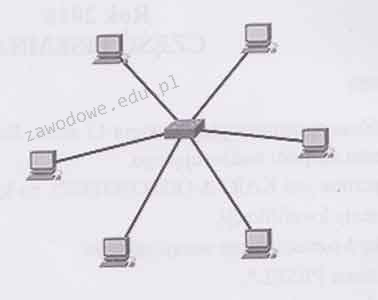

Schemat ilustruje fizyczną strukturę

Jakie są prędkości przesyłu danych w sieciach FDDI (ang. Fiber Distributed Data Interface) wykorzystujących technologię światłowodową?

Kondygnacyjny punkt dystrybucyjny jest połączony za pomocą poziomego okablowania z

W nagłówku ramki standardu IEEE 802.3, który należy do warstwy łącza danych, znajduje się

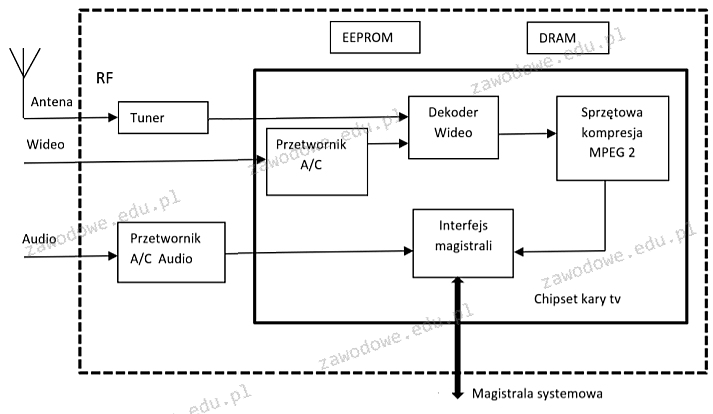

Na ilustracji zaprezentowano schemat blokowy karty

Jaką wartość dziesiętną ma liczba FF w systemie szesnastkowym?

Jaki skrót odpowiada poniższej masce podsieci: 255.255.248.0?

Na stronie wydrukowanej w drukarce atramentowej pojawiają się smugi, kropki, kleksy i plamy. Aby rozwiązać problemy z jakością wydruku, należy

Jaki standard szyfrowania powinien być wybrany przy konfiguracji karty sieciowej, aby zabezpieczyć transmisję w sieci bezprzewodowej?

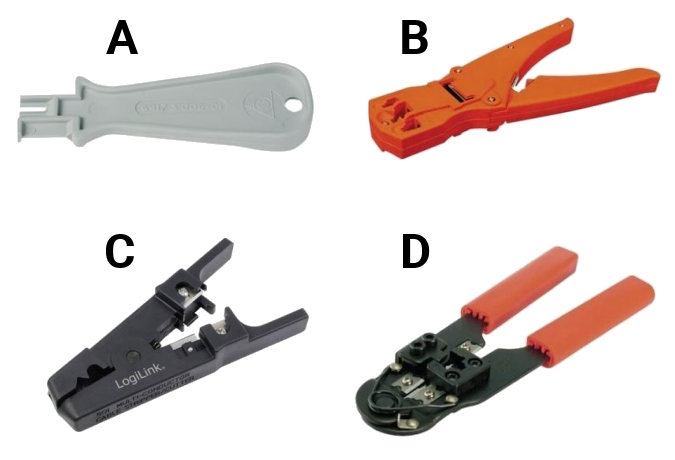

Na zdjęciu widać

Który rodzaj złącza nie występuje w instalacjach światłowodowych?

Jak nazywa się materiał używany w drukarkach 3D?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

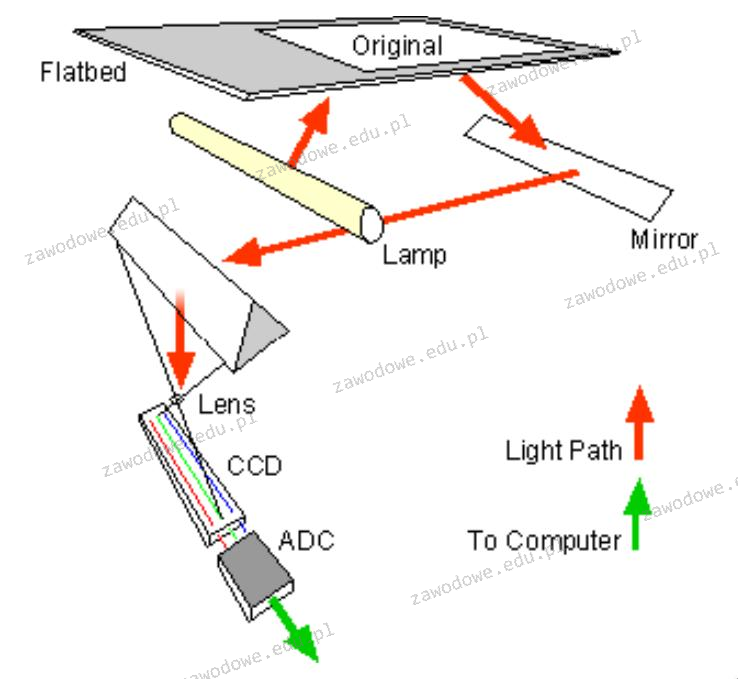

Ilustrowany schemat obrazuje zasadę funkcjonowania

Który z przyrządów służy do usuwania izolacji?

Co oznacza standard ACPI w BIOSie komputera?

Jakie czynności należy wykonać, aby przygotować nowego laptopa do użytkowania?

Jaką maksymalną liczbę kanałów z dostępnego pasma kanałów standardu 802.11b można stosować w Polsce?

Jaka jest nominalna moc wyjściowa (ciągła) zasilacza o parametrach zapisanych w tabeli?

| Napięcie wyjściowe | +5 V | +3.3 V | +12 V1 | +12 V2 | -12 V | +5 VSB |

| Prąd wyjściowy | 18,0 A | 22,0 A | 18,0 A | 17,0 A | 0,3 A | 2,5 A |

| Moc wyjściowa | 120 W | 336W | 3,6 W | 12,5 W |

Jakie medium transmisyjne nosi nazwę 100BaseTX i jaka jest maksymalna prędkość danych, która może być w nim osiągnięta?

Jakie polecenie należy wykorzystać, aby w terminalu pokazać przedstawione informacje o systemie Linux?

Arch Linux 2.6.33-ARCH (myhost) (tty1)

myhost login: root

Password:

[root@myhost ~]#

Linux myhost 2.6.33-ARCH #1 SMP PREEMPT Thu May 13 12:06:25 CEST 2010 i686 Intel

(R) Pentium(R) 4 CPU 2.80GHz GenuineIntel GNU/LinuxUkład cyfrowy wykonujący operację logiczną koniunkcji opiera się na bramce logicznej

Jakie oprogramowanie jest wykorzystywane do dynamicznej obsługi urządzeń w systemie Linux?

Jaki protokół powinien być ustawiony w switchu sieciowym, aby uniknąć występowania zjawiska broadcast storm?

Protokół ARP (Address Resolution Protocol) pozwala na przypisanie logicznych adresów warstwy sieciowej do rzeczywistych adresów warstwy

Jakie urządzenie należy wykorzystać do zestawienia komputerów w sieci przewodowej o strukturze gwiazdy?

Która z tras jest oznaczona literą R w tabeli routingu?

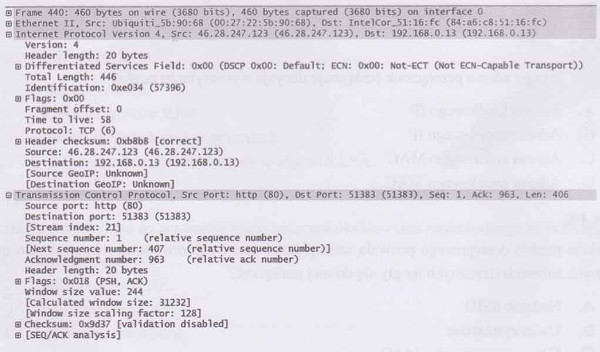

Na podstawie analizy pakietów sieciowych, określ adres IP oraz numer portu, z którego urządzenie otrzymuje odpowiedź?

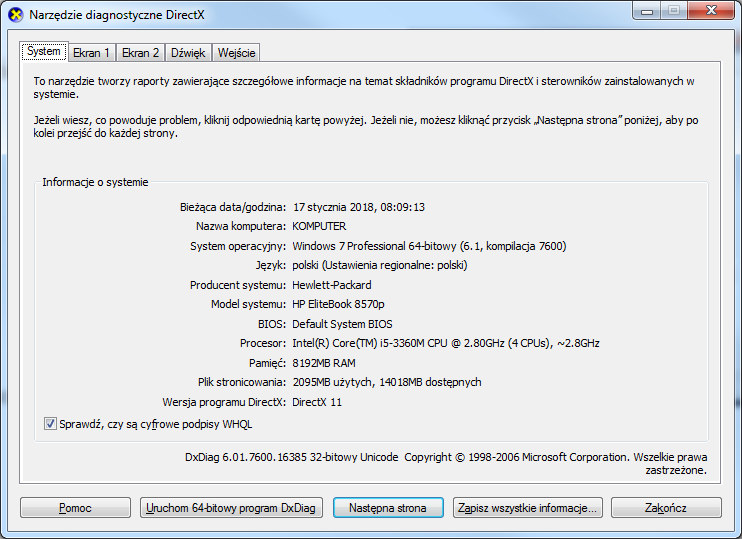

Aby uruchomić przedstawione narzędzie systemu Windows, należy użyć polecenia

Klient przyniósł do serwisu uszkodzony sprzęt komputerowy. W trakcie procedury odbioru sprzętu, przed rozpoczęciem jego naprawy, serwisant powinien