Pytanie 1

Aby utworzyć kontroler domeny w systemach z rodziny Windows Server na serwerze lokalnym, konieczne jest zainstalowanie roli

Wynik: 11/40 punktów (27,5%)

Wymagane minimum: 20 punktów (50%)

Aby utworzyć kontroler domeny w systemach z rodziny Windows Server na serwerze lokalnym, konieczne jest zainstalowanie roli

Jakie narzędzie należy zastosować do podłączenia zaszycia kabla w module Keystone?

Który standard w sieciach LAN określa dostęp do medium poprzez wykorzystanie tokenu?

Jaką jednostką określa się szybkość przesyłania danych w sieciach komputerowych?

Zestaw dodatkowy, który zawiera strzykawkę z cieczą, igłę oraz rękawice ochronne, jest przeznaczony do napełniania pojemników z medium drukującym w drukarkach

Co to jest urządzenie sieciowe most (ang. bridge)?

Aby załadować projekt wydruku bezpośrednio z komputera do drukarki 3D, której parametry przedstawiono w tabeli, można użyć złącza

| Technologia pracy | FDM (Fused Deposition Modeling) |

| Głowica drukująca | Podwójny ekstruder z unikalnym systemem unoszenia dyszy i wymiennymi modułami drukującymi (PrintCore) |

| Średnica filamentu | 2,85 mm |

| Platforma drukowania | Szklana, podgrzewana |

| Temperatura platformy | 20°C – 100°C |

| Temperatura dyszy | 180°C – 280°C |

| Łączność | WiFi, Ethernet, USB |

| Rozpoznawanie materiału | Skaner NFC |

Liczba 10011001100 w systemie heksadecymalnym przedstawia się jako

Jakie jest główne zadanie programu Wireshark?

Aby uzyskać adres IPv4, za pomocą usługi DHCP, komputer kliencki wysyła żądania z portu

Wykonanie polecenia perfmon w terminalu systemu Windows spowoduje

Na ilustracji ukazany jest komunikat systemowy. Jakie kroki powinien podjąć użytkownik, aby naprawić błąd?

Administrator powinien podzielić adres 10.0.0.0/16 na 4 jednorodne podsieci zawierające równą liczbę hostów. Jaką maskę będą miały te podsieci?

Element trwale zainstalowany, w którym znajduje się zakończenie poziomego okablowania strukturalnego abonenta, to

Gdzie w systemie Linux umieszczane są pliki specjalne urządzeń, które są tworzone podczas instalacji sterowników?

Okablowanie wertykalne w sieci strukturalnej łączy

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

W systemie Windows przypadkowo usunięto konto użytkownika, ale katalog domowy pozostał. Czy możliwe jest odzyskanie niezaszyfrowanych danych z katalogu domowego tego użytkownika?

Termin określający zdolność do rozbudowy sieci to

Do wykonania końcówek kabla UTP wykorzystuje się wtyczkę

Jaki adres stanowi adres rozgłoszeniowy dla hosta o IP 171.25.172.29 oraz masce sieci 255.255.0.0?

Symbol błyskawicy pokazany na rysunku jest używany do oznaczania złącza

Zadania systemu operacyjnego nie obejmują

Jak nazywa się protokół używany do przesyłania wiadomości e-mail?

Do efektywnego zrealizowania macierzy RAID 1 wymagane jest minimum

Jakie zakresy częstotliwości określa klasa EA?

Jaką usługę należy zainstalować na systemie Linux, aby umożliwić bezpieczny zdalny dostęp?

Wskaż złącze, które nie jest obecne w zasilaczach ATX?

W normie PN-EN 50174 nie znajdują się wytyczne dotyczące

Interfejs SATA 2 (3Gb/s) oferuje prędkość transferu

Przy zmianach w rejestrze Windows w celu zapewnienia bezpieczeństwa należy najpierw

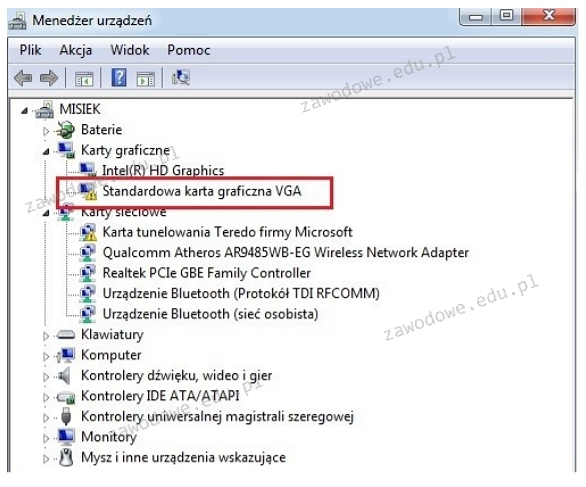

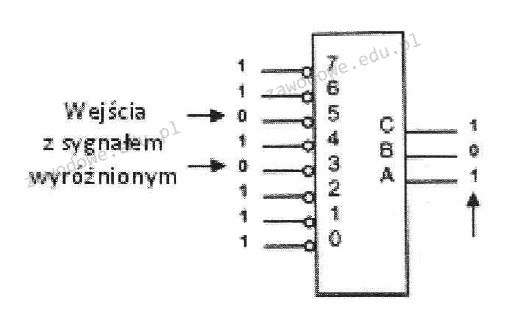

Na ilustracji przedstawiono symbol urządzenia cyfrowego

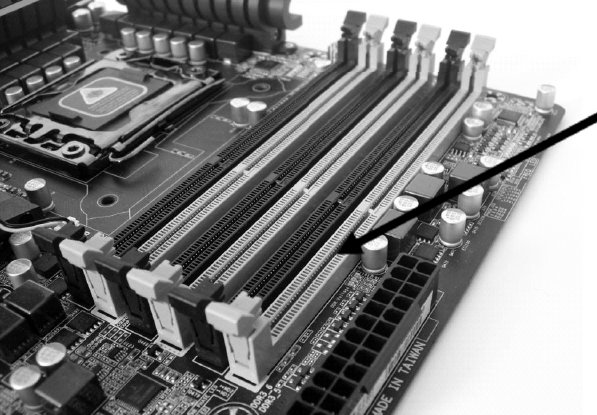

Jaki typ pamięci powinien być umieszczony na płycie głównej komputera w miejscu, które wskazuje strzałka?

Interfejs UDMA to interfejs

Z jakim protokołem związane są terminy "Sequence number" oraz "Acknowledgment number"?

W którym modelu płyty głównej można zamontować procesor o podanych parametrach?

| Intel Core i7-4790 3,6 GHz 8MB cache s. 1150 Box |

Informacje ogólne dotyczące zdarzeń systemowych w systemie Linux są zapisywane w

Zamianę uszkodzonych kondensatorów w karcie graficznej umożliwi

Kiedy użytkownik systemu Windows wybiera opcję przywrócenia do określonego punktu, które pliki utworzone po tym punkcie nie będą podlegać zmianom w wyniku tej operacji?

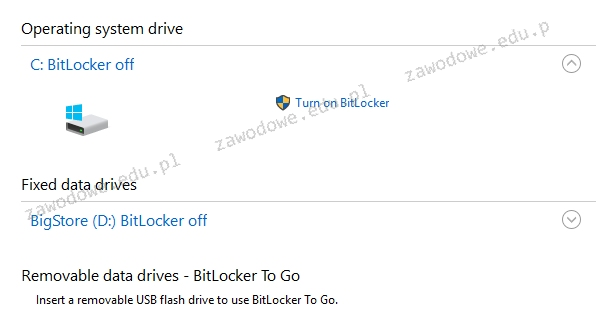

Prezentowane wbudowane narzędzie systemów Windows w wersji Enterprise lub Ultimate jest przeznaczone do