Pytanie 1

W lokalnej sieci uruchomiono serwer odpowiedzialny za przydzielanie dynamicznych adresów IP. Jaką usługę należy aktywować na tym serwerze?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

W lokalnej sieci uruchomiono serwer odpowiedzialny za przydzielanie dynamicznych adresów IP. Jaką usługę należy aktywować na tym serwerze?

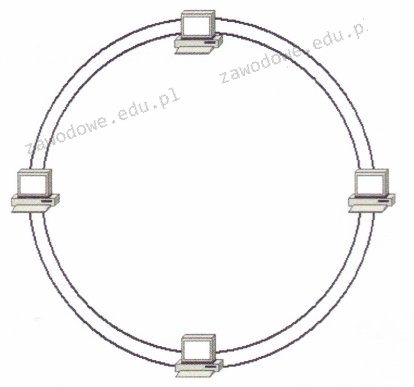

Jaką topologię fizyczną sieci komputerowej przedstawia rysunek?

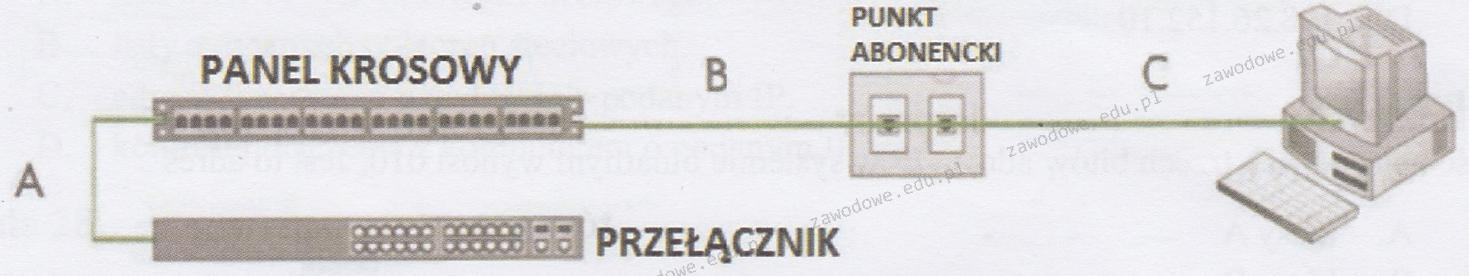

Według normy PN-EN 50174 maksymalna całkowita długość kabla połączeniowego między punktem abonenckim a komputerem oraz kabla krosowniczego A+C) wynosi

Karta dźwiękowa, która pozwala na odtwarzanie plików w formacie MP3, powinna być zaopatrzona w układ

GRUB, LILO, NTLDR to

Na początku procesu uruchamiania sprzętowego komputera, wykonywany jest test

W systemie Linux komenda tty pozwala na

Jakie polecenie uruchamia edytor polityk grup w systemach z rodziny Windows Server?

Który protokół umożliwia rozproszoną wymianę i ściąganie plików?

W której warstwie modelu odniesienia ISO/OSI działają protokoły IP oraz ICMP?

Podczas wyboru zasilacza do komputera kluczowe znaczenie

Która norma odnosi się do okablowania strukturalnego?

Który z poniższych zapisów reprezentuje adres strony internetowej oraz przypisany do niego port?

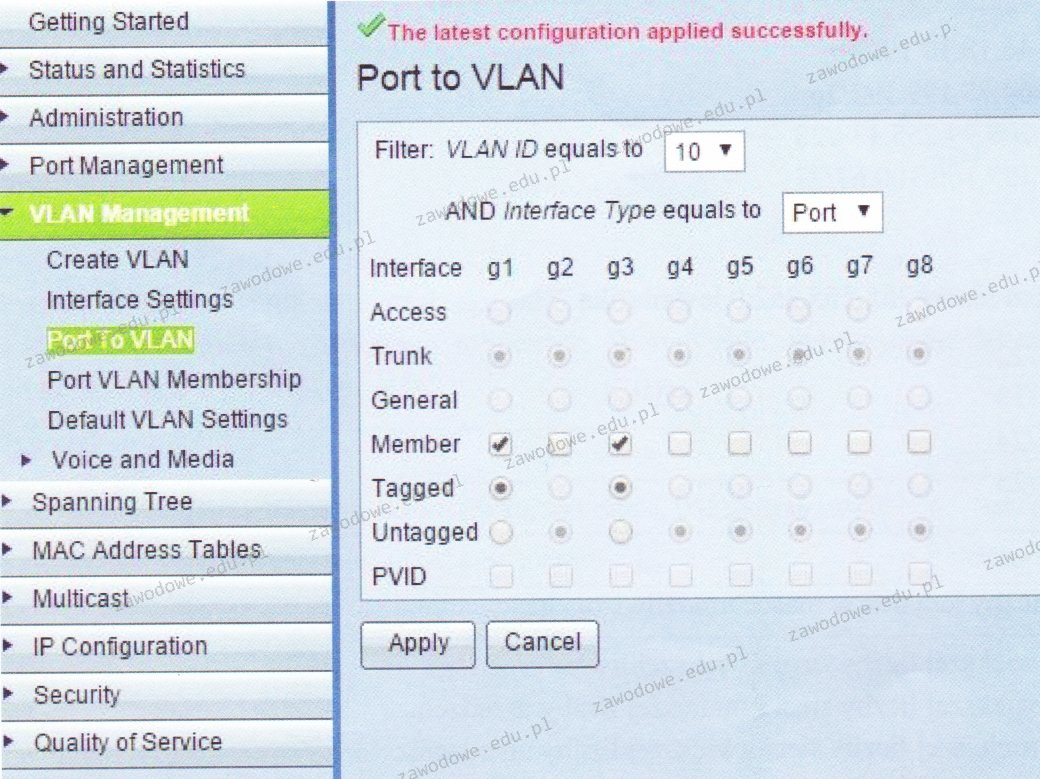

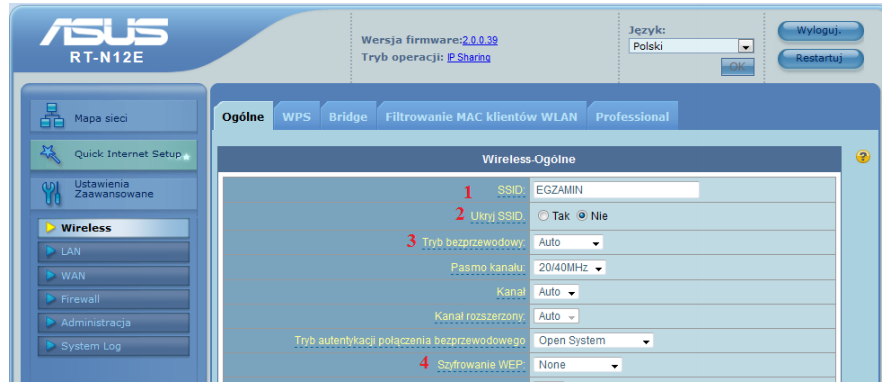

Na ilustracji przedstawiona jest konfiguracja

Aby połączyć projektor multimedialny z komputerem, złącze, którego NIEDOZWOLONO użyć to

Program iftop działający w systemie Linux ma na celu

W celu doboru właściwej aktualizacji oprogramowania dla punktu dostępowego można skorzystać z identyfikacji

Diagnostykę systemu Linux można przeprowadzić za pomocą komendy

| Thread(s) per core: | 1 |

| Core(s) per socket: | 4 |

| Socket(s): | 1 |

| NUMA node(s): | 1 |

Ile sieci obejmują adresy IPv4 pokazane w tabeli?

| Adres IPv4 | Maska sieci |

|---|---|

| 10.10.10.10 | 255.255.0.0 |

| 10.10.20.10 | 255.255.0.0 |

| 10.10.20.20 | 255.255.0.0 |

| 10.10.30.30 | 255.255.0.0 |

| 10.20.10.10 | 255.255.0.0 |

| 10.20.20.10 | 255.255.0.0 |

| 10.20.20.30 | 255.255.0.0 |

Zanim przystąpimy do prac serwisowych dotyczących modyfikacji rejestru systemu Windows, konieczne jest wykonanie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Który z adresów IPv4 jest odpowiedni do ustawienia interfejsu serwera DNS zarejestrowanego w lokalnych domenach?

W komputerach stacjonarnych zamontowane są karty sieciowe Ethernet 10/100/1000 z gniazdem RJ45. Jakie medium transmisyjne powinno się zastosować w celu zbudowania sieci komputerowej zapewniającej najwyższą przepustowość?

Internet Relay Chat (IRC) to protokół wykorzystywany do

W modelu RGB, kolor w systemie szesnastkowym przedstawia się w ten sposób: ABCDEF. Wartość natężenia koloru niebieskiego w tym zapisie odpowiada liczbie dziesiętnej

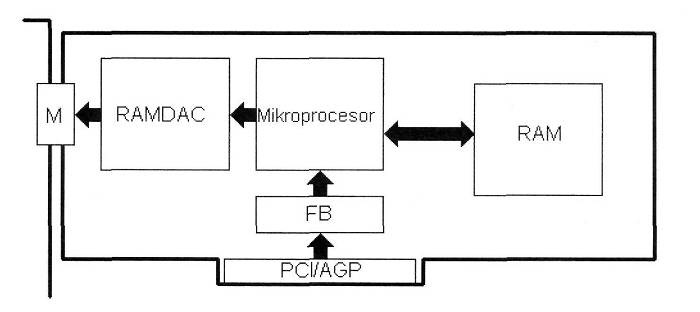

Na schemacie blokowym funkcjonalny blok RAMDAC ilustruje

W biurze rachunkowym znajduje się sześć komputerów w jednym pomieszczeniu, połączonych kablem UTP Cat 5e z koncentratorem. Pracownicy korzystający z tych komputerów muszą mieć możliwość drukowania bardzo dużej ilości dokumentów monochromatycznych (powyżej 5 tys. stron miesięcznie). Aby zminimalizować koszty zakupu i eksploatacji sprzętu, najlepszym wyborem będzie:

Który aplet w panelu sterowania systemu Windows 7 pozwala na ograniczenie czasu, jaki użytkownik spędza przed komputerem?

Wskaż cechę platformy wirtualizacji Hyper-V.

Program do odzyskiwania danych, stosowany w warunkach domowych, umożliwia przywrócenie danych z dysku twardego w sytuacji

Menedżer urządzeń w systemie Windows pozwala na wykrycie

W systemie Linux polecenie chown służy do

Magistrala komunikacyjna PCI ver. 2.2 (Peripheral Component Interconnect) jest standardem magistrali, zgodnie z którym szyna danych ma maksymalną szerokość

Czy bęben światłoczuły znajduje zastosowanie w drukarkach?

W systemie Windows do wyświetlenia treści pliku tekstowego służy polecenie

Aby stworzyć las w strukturze AD DS (Active Directory Domain Services), konieczne jest utworzenie przynajmniej

Który z protokołów umożliwia terminalowe połączenie ze zdalnymi urządzeniami, zapewniając jednocześnie transfer danych w zaszyfrowanej formie?

Aby zablokować widoczność identyfikatora sieci Wi-Fi, konieczne jest dokonanie zmian w ustawieniach rutera w sekcji oznaczonej numerem

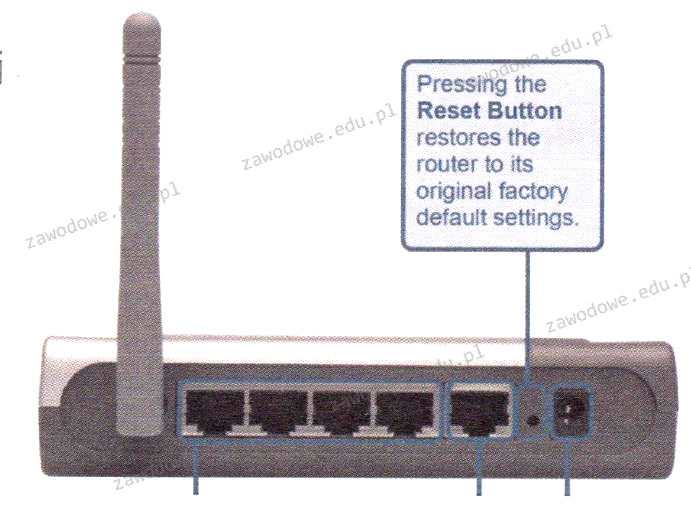

Przycisk znajdujący się na obudowie rutera, którego charakterystyka zamieszczona jest w ramce, służy do

Protokół transportowy bezpołączeniowy to