Pytanie 1

Element trwale zainstalowany, w którym znajduje się zakończenie poziomego okablowania strukturalnego abonenta, to

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Element trwale zainstalowany, w którym znajduje się zakończenie poziomego okablowania strukturalnego abonenta, to

Jakie medium transmisyjne powinno być użyte do połączenia dwóch punktów dystrybucyjnych oddalonych od siebie o 600m?

Na ilustracji widoczny jest symbol graficzny

Jaką liczbę punktów abonenckich (2 x RJ45) zgodnie z wytycznymi normy PN-EN 50167 powinno się zainstalować w biurze o powierzchni 49 m2?

Napięcie dostarczane do poszczególnych elementów komputera w zasilaczu komputerowym w standardzie ATX jest zmniejszane z wartości 230V między innymi do wartości

Jakie są przyczyny wyświetlenia na ekranie komputera komunikatu o wykryciu konfliktu adresów IP?

Aby zredukować kluczowe zagrożenia związane z bezpieczeństwem podczas pracy na komputerze podłączonym do sieci Internet, należy przede wszystkim

Nośniki informacji, takie jak dyski twarde, zapisują dane w jednostkach zwanych sektorami, które mają wielkość

W systemie Linux komenda ps wyświetli

Administrator systemu Windows zauważył znaczne spowolnienie działania komputera spowodowane niską ilością dostępnej pamięci RAM. W celu zidentyfikowania programu, który zużywa jej najwięcej, powinien skorzystać z narzędzia

Jaki protokół warstwy aplikacji jest wykorzystywany do zarządzania urządzeniami sieciowymi poprzez sieć?

Protokołem umożliwiającym bezpołączeniowe przesyłanie datagramów jest

Jak nazywa się seria procesorów produkowanych przez firmę Intel, charakteryzująca się małymi wymiarami oraz niskim zużyciem energii, zaprojektowana z myślą o urządzeniach mobilnych?

Jakie urządzenie powinno być użyte do połączenia komputerów w układzie gwiazdowym?

Aby zapewnić bezpieczną komunikację terminalową z serwerem, powinno się skorzystać z połączenia z użyciem protokołu

Brak danych dotyczących parzystości liczby lub znaku rezultatu operacji w ALU może sugerować usterki w funkcjonowaniu

Tryb pracy portu równoległego, bazujący na magistrali ISA, umożliwiający transfer danych do 2,4 MB/s, dedykowany dla skanerów i urządzeń wielofunkcyjnych, to

Aby zabezpieczyć system przed oprogramowaniem mającym możliwość reprodukcji, konieczne jest zainstalowanie

Symbol "LGA 775" obecny w dokumentacji technicznej płyty głównej wskazuje na typ gniazda dla procesorów:

Podczas realizacji projektu sieci komputerowej, pierwszym krokiem powinno być

Z wykorzystaniem polecenia dxdiag uruchomionego z linii komend systemu Windows można

Proces, który uniemożliwia całkowicie odzyskanie danych z dysku twardego, to

Aby zwiększyć wydajność komputera, można zainstalować procesor obsługujący technologię Hyper-Threading, która pozwala na

Najbardziej rozwinięty tryb funkcjonowania portu równoległego zgodnego z normą IEEE-1284, który tworzy dwukierunkową szeregę 8-bitową zdolną do przesyłania zarówno danych, jak i adresów z maksymalną prędkością transmisji wynoszącą 2,3 MB/s oraz umożliwia podłączenie do 64 urządzeń, to

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie polecenie powinno być użyte do obserwacji lokalnych połączeń?

W ramce przedstawiono treść jednego z plików w systemie operacyjnym MS Windows. Jest to plik

| [boot loader] Time out=30 Default=Multi(0)disk(0)rdisk(0)partition(1)WINDOWS [operating system] Multi(0)disk(0)rdisk(0)partition(1)WINDOWS="Microsoft Windows XP Home Edition"/ fastdetect/NoExecute=OptOut |

Który z podanych adresów IP v.4 należy do klasy C?

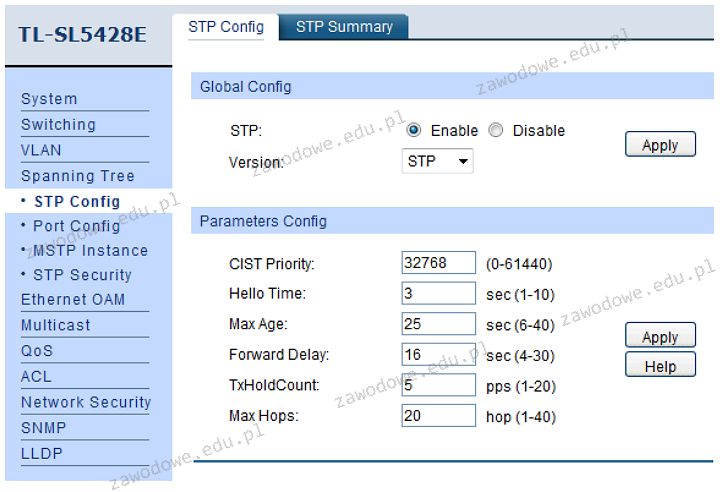

Analizując zrzut ekranu prezentujący ustawienia przełącznika, można zauważyć, że

W systemie Windows Professional aby ustawić czas dostępności dla drukarki, należy skorzystać z zakładki

Oblicz całkowity koszt kabla UTP Cat 6, który służy do połączenia 5 punktów abonenckich z punktem dystrybucyjnym, wiedząc, że średnia długość między punktem abonenckim a punktem dystrybucyjnym wynosi 8m oraz że cena brutto za 1m kabla to 1zł. W obliczeniach uwzględnij dodatkowy zapas 2m kabla dla każdego punktu abonenckiego.

System S.M.A.R.T. jest wykorzystywany do nadzorowania działania oraz identyfikacji usterek

Jakie aktywne urządzenie pozwoli na nawiązanie połączenia z lokalną siecią dla 15 komputerów, drukarki sieciowej oraz rutera, wykorzystując kabel UTP?

Jaka wartość dziesiętna została zapisana na jednym bajcie w kodzie znak – moduł: 1 1111111?

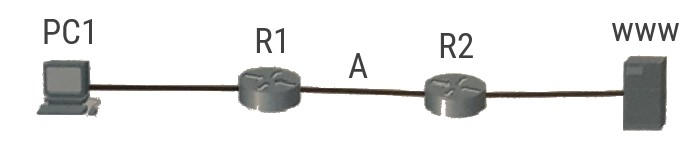

Ramka danych przesyłanych z komputera PC1 do serwera www znajduje się pomiędzy ruterem R1 a ruterem R2 (punkt A). Jakie adresy są w niej zawarte?

Jakie miejsce nie jest zalecane do przechowywania kopii zapasowej danych z dysku twardego komputera?

Planowana sieć należy do kategorii C. Została ona podzielona na 4 podsieci, z których każda obsługuje 62 urządzenia. Która z poniższych masek będzie odpowiednia do tego zadania?

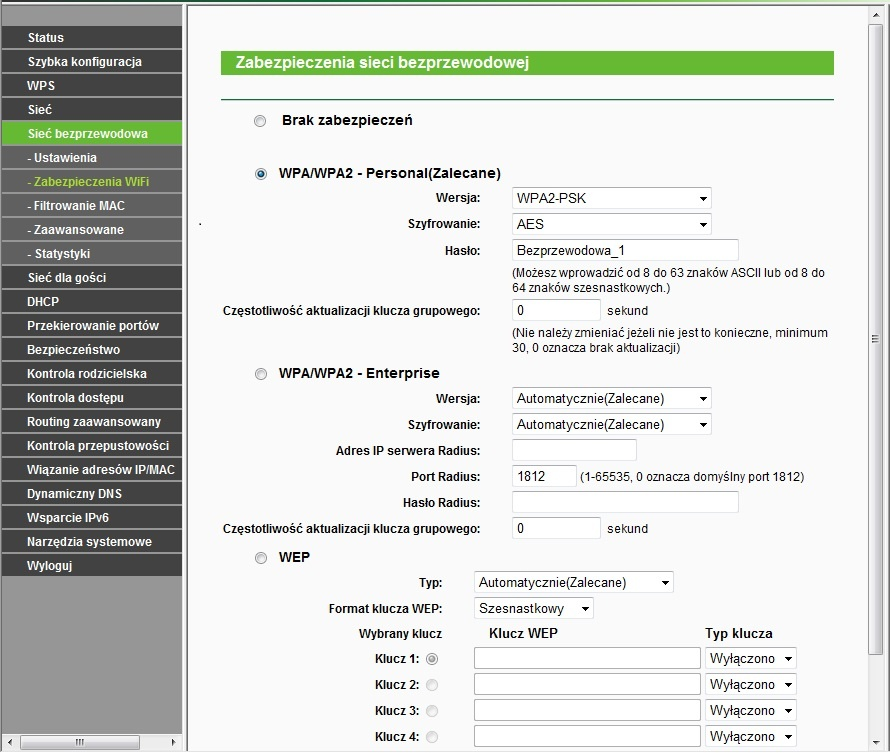

Na ilustracji przedstawiono konfigurację dostępu do sieci bezprzewodowej, która dotyczy

Który typ drukarki stosuje metodę, w której stały barwnik jest przenoszony z taśmy na papier odporny na wysoką temperaturę?

Modułem pamięci RAM, kompatybilnym z płytą główną GIGABYTE GA-X99- ULTRA GAMING/ X99/ 8x DDR4 2133, ECC, max 128GB/ 4x PCI-E 16x/ RAID/ USB 3.1/ S-2011-V3/ATX, jest pamięć