Pytanie 1

Urządzenie do rejestracji bioelektrycznych potencjałów mięśniowych to

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Urządzenie do rejestracji bioelektrycznych potencjałów mięśniowych to

W dokumentacji sieci centralnego monitoringu zapisano, że sieć jest wykonana w standardzie 802.11 Do montażu takiej sieci są wymagane urządzenia wykorzystujące

Które urządzenie medyczne wspomaga lub zastępuje mięśnie pacjenta w oddychaniu?

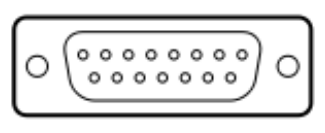

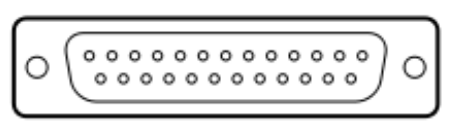

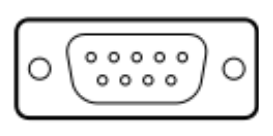

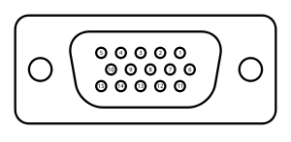

Zgodnie z przedstawionym opisem, gniazdo interfejsu służące do podłączenia audiometru ze stanowiskiem komputerowym przedstawione jest na rysunku

| Opis: |

| − 125 Hz ÷ 8.000 Hz − -10 dB do 120 dB HL na wyjściu − połączenie z komputerem PC – interfejs RS232 − połączenie z drukarką laserową − połączenie z drukarką atramentową |

Narzędzie przedstawione na rysunku służy do

Usterka programowa uniemożliwia uruchomienie systemu Windows. W celu diagnozy i usunięcia usterki wskazane jest

Który system bazodanowy uniemożliwia bezpłatne zastosowanie komercyjne?

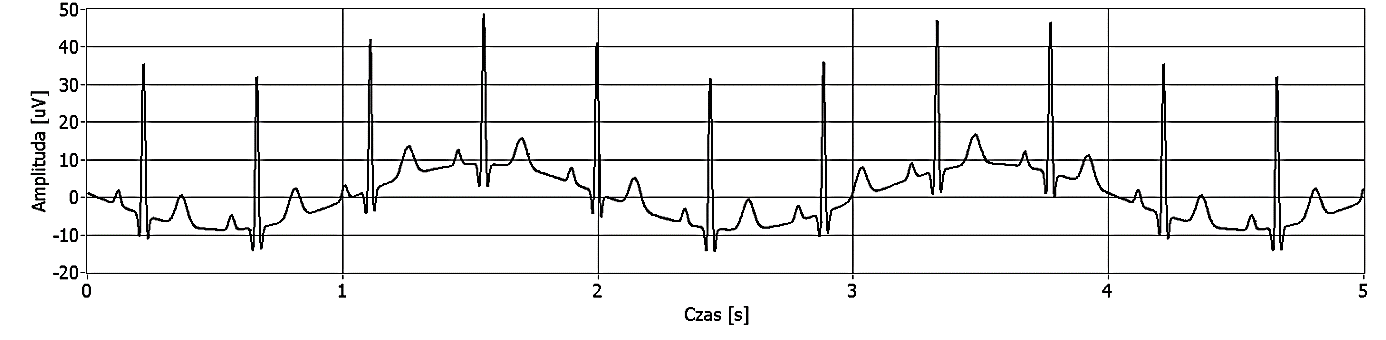

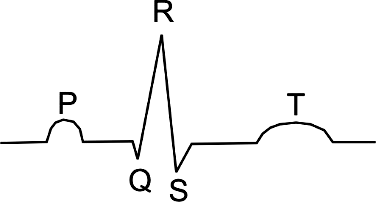

Z elektrokardiogramu wynika, że rytm serca rejestrowany i wskazywany przez elektrokardiograf wynosi

Najważniejszą cechą pamięci operacyjnych serwerowych jest ich niezawodność, dlatego powinny być wyposażone w mechanizm kontroli błędów określany skrótem

W dokumentacji testera aparatury medycznej podano następujące informacje:

|

W celu archiwizacji danych w systemie Linux wymagane jest utworzenie archiwum. Korzystając z zamieszczonej w ramce pomocy dobierz odpowiednie polecenie.

| -c, --create | utworzenie nowego archiwum |

| -z, --gzip | filtrowanie archiwum przez gzip |

| -v, --verbose | wypisywanie szczegółów o przetwarzanych plikach |

| -f, --file=ARCHIWUM | użycie pliku lub urządzenia ARCHIWUM |

| -x, --extract | rozpakowanie plików z archiwum |

| -t, --list | wypisanie zawartości archiwum |

| -r, --append | dołączenie plików na końcu archiwum |

| -u, --update | dołączenie tylko plików nowszych niż kopie w archiwum |

Które działanie nie odnosi się do podstawowej funkcji komputera?

Aby dodać nowe konto „rejestracja” w systemie Windows, należy wykorzystać polecenie

Materiałem eksploatacyjnym w drukarce laserowej jest

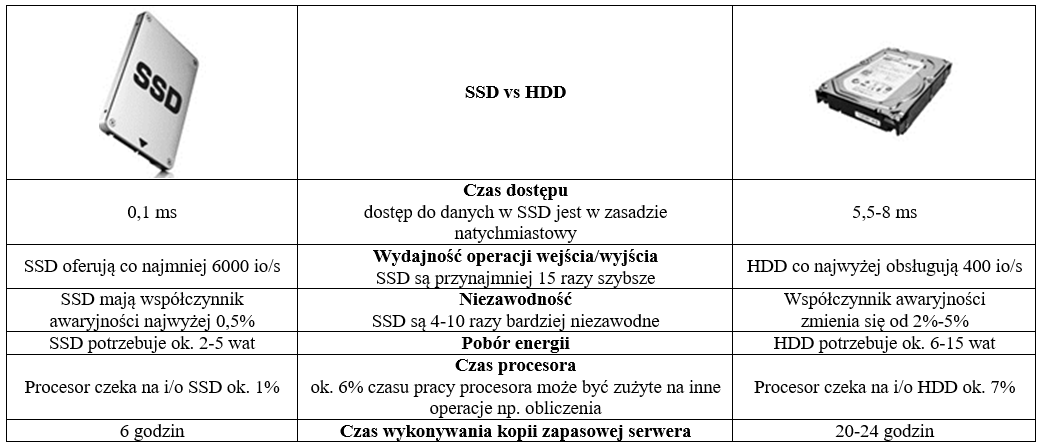

W tabeli zestawiono parametry pamięci półprzewodnikowej i pamięci magnetycznej. Zastosowanie którego rodzaju pamięci umożliwi szybszą pracę komputera?

Fale mózgowe alfa, beta, gamma, delta i theta są rejestrowane w

Który z przedstawionych przyrządów służy do testowania połączeń w sieci LAN?

Wymianą informacji pomiędzy układami znajdującymi się na płycie głównej komputera steruje

Czujnik tensometryczny i sonda ultradźwiękowa są elementami aparatu

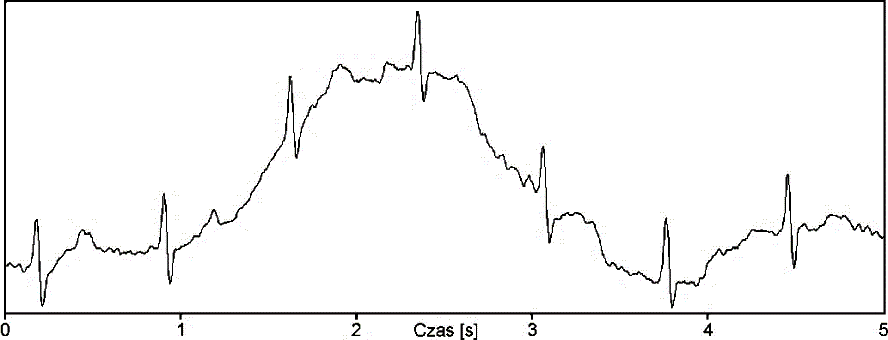

Podczas testowania elektrokardiografu otrzymano przedstawiony przebieg. Na jego podstawie stwierdzono, że nieprawidłowo działa filtr zakłóceń

Do badania przewodnictwa powietrznego i kostnego służy

Operacja warunkowa w większości języków programowania wysokiego poziomu zaczyna się słowem

Który system plików zapewnia największe bezpieczeństwo danych w systemie Windows?

Operacje stałoprzecinkowe w procesorze wykonuje jednostka oznaczona jako

W programowaniu obiektowym zmienne widoczne w ramach klasy oraz poza nią nazywane są

Który rodzaj promieniowania jonizującego jest całkowicie pochłaniany przez naskórek, nie docierając do głębszych warstw tkanek?

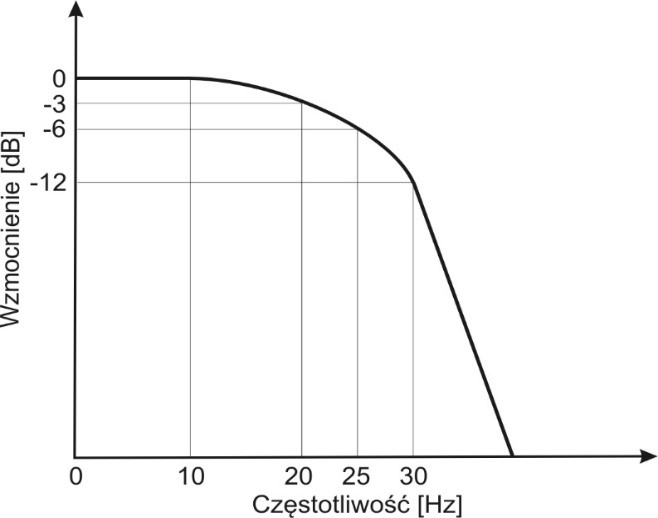

W urządzeniu medycznym wyznaczono charakterystykę filtru jak na rysunku. Jest to filtr

Który podzespół komputerowy posiada obudowę o zamieszczonej specyfikacji?

| Specyfikacja obudowy | |

|---|---|

| Obsługiwane gniazda | LGA775 |

| TCASE | 71,4°C |

| Wymiary obudowy | 37,5 mm x 37,5 mm |

| Rozmiar płytki półprzewodnikowej | 214 mm² |

| Liczba tranzystorów płytki półprzewodnikowej | 820 milion |

| Dostępne opcje obniżonej zawartości halogenków | Patrz MDDS |

Przedstawiony fragment dokumentacji dotyczy

Częstotliwość: 2.0-10.0MHz; Tryb obrazowania: B, B/B, B/M, M, 4B; Dynamiczne 4-stopniowe ogniskowanie; |

Parametr CL (czas opóźnienia, jaki upływa między wysłaniem przez kontroler RAM żądania dostępu do kolumny pamięci a otrzymaniem danych z tej kolumny) jest wyrażany w

Struktura anatomiczna człowieka, która jest nazywana krytyczną ze względu na szczególną wrażliwość na zewnętrzne promieniowanie jonizujące, to

W opisanym programie zostaną wykonane 4

for (i=0;i<=3;i++) suma=suma+i; |

Urządzenie, którego dotyczy fragment podanej specyfikacji, jest przystosowane do

| ■ Architektura sieci LAN: | Wireless IEEE 802.11ac, Wireless IEEE 802.11a, Wireless IEEE 802.11b, Wireless IEEE 802.11g, Wireless IEEE 802.11n |

| ■ Dodatkowe informacje: | PoE, RJ-45 Serial |

| ■ Typ urządzenia: | Bezprzewodowy kontroler |

| ■ Typ złącza anteny zewnętrznej: | 3x3 MIMO |

Które polecenie SQL pozwoli na utworzenie tabeli pacjentów w bazie przychodnia?

Które polecenie w systemie Windows tworzy folder Dane?

W dokumencie urządzenia elektroniki medycznej podano następujące informacje:

Interfejs obrazu DICOM • Maksymalna szybkość przesyłania wg standardu Ethernet: 100 Mb/s. • Szybkość przesyłania obrazów: 2 MB/s. Interfejs RIS/CIS zgodny z DICOM • Maksymalna szybkość przesyłania wg standardu Ethernet: 100 Mb/s. |

Która część narządu wzroku rejestruje światło widzialne?

W sygnale elektrokardiograficznym za repolaryzację mięśnia komór odpowiada załamek

Który system plików pozwala na szyfrowanie danych w systemie Windows?

Pod wpływem zwiększenia natężenia promieniowania widzialnego (bodźca świetlnego) źrenica zdrowego oka ludzkiego