Pytanie 1

Aby zmierzyć tłumienie światłowodowego łącza w dwóch zakresach długości fal 1310 nm i 1550 nm, należy zastosować

Wynik: 13/40 punktów (32,5%)

Wymagane minimum: 20 punktów (50%)

Aby zmierzyć tłumienie światłowodowego łącza w dwóch zakresach długości fal 1310 nm i 1550 nm, należy zastosować

Awaria drukarki igłowej może być spowodowana uszkodzeniem

Proces aktualizacji systemów operacyjnych ma na celu przede wszystkim

Jakie polecenie należy zastosować w systemach operacyjnych z rodziny Windows, aby ustawić plik w trybie tylko do odczytu?

Podaj domyślny port używany do przesyłania poleceń w serwerze FTP

Topologia fizyczna sieci, w której wykorzystywane są fale radiowe jako medium transmisyjne, nosi nazwę topologii

Które środowisko graficzne przeznaczone dla systemu Linux charakteryzuje się najmniejszymi wymaganiami parametrów pamięci RAM?

Która topologia fizyczna umożliwia nadmiarowe połączenia pomiędzy urządzeniami w sieci?

Aby uzyskać informacje na temat aktualnie działających procesów w systemie Linux, można użyć polecenia

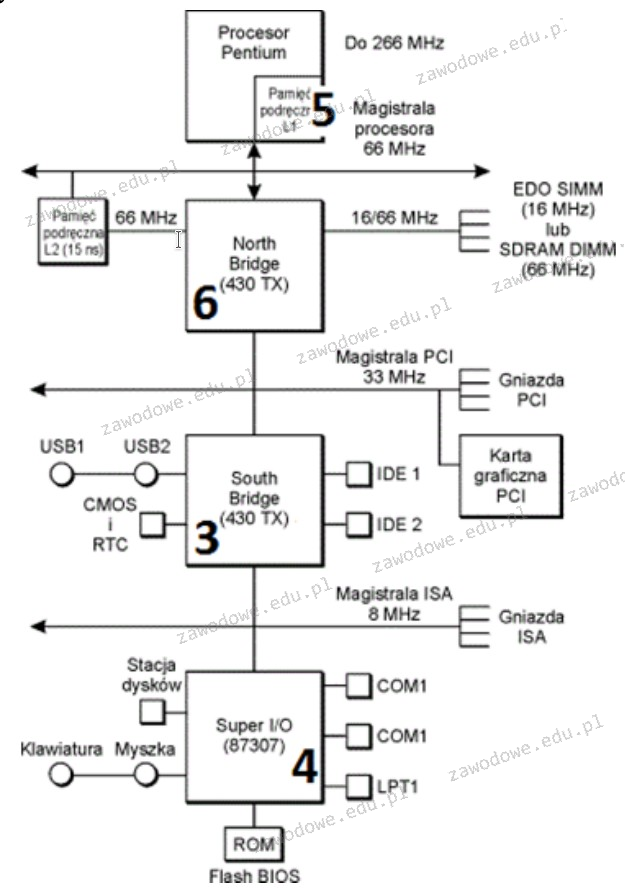

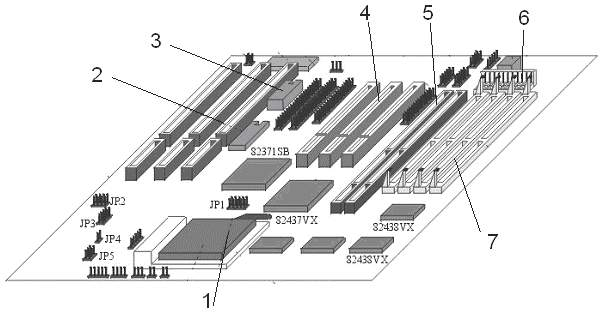

Część płyty głównej, która odpowiada za transmisję danych pomiędzy mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej, jest oznaczona na rysunku numerem

Na ilustracji widoczna jest pamięć operacyjna

Scandisk to narzędzie, które wykorzystuje się do

Jaki jest standard 1000Base-T?

Symbole i oznaczenia znajdujące się na zamieszczonej tabliczce znamionowej podzespołu informują między innymi o tym, że produkt jest

Trudności w systemie operacyjnym Windows wynikające z konfliktów dotyczących zasobów sprzętowych, takich jak przydział pamięci, przerwań IRQ oraz kanałów DMA, najłatwiej zidentyfikować za pomocą narzędzia

Jakie materiały eksploatacyjne wykorzystuje się w rzutniku multimedialnym?

Do dynamicznej obsługi sprzętu w Linuxie jest stosowany system

Aby uniknąć różnic w kolorystyce pomiędzy zeskanowanymi zdjęciami na wyświetlaczu komputera a ich oryginałami, konieczne jest przeprowadzenie

Aby poprawić niezawodność i efektywność przesyłu danych na serwerze, należy

Po dokonaniu eksportu klucza HKCU stworzona zostanie kopia rejestru zawierająca dane o konfiguracji

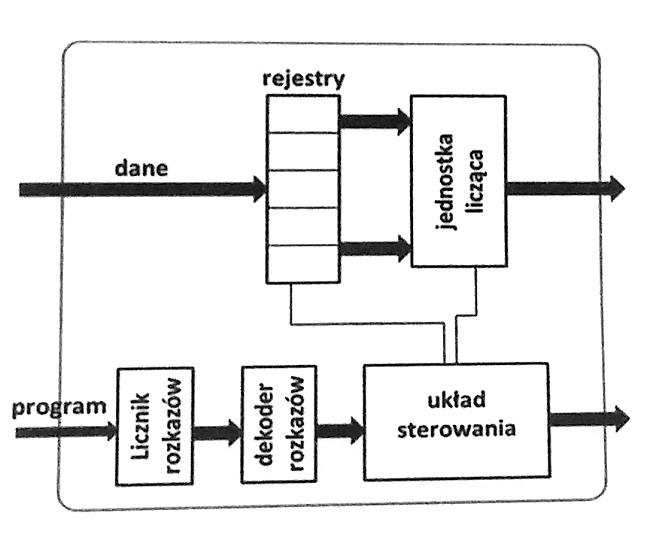

Rejestry przedstawione na diagramie procesora mają zadanie

Jakie jest wynikiem dodawania liczb binarnych 1001101 oraz 11001 w systemie dwójkowym?

Jakim procesem jest nieodwracalne usunięcie możliwości odzyskania danych z hard dysku?

Jakie jest oznaczenie sieci, w której funkcjonuje host o IP 10.10.10.6 klasy A?

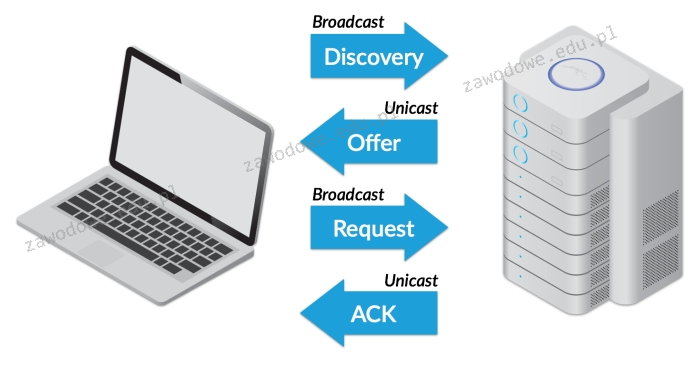

Którego protokołu działanie zostało zaprezentowane na diagramie?

Podczas zmiany ustawień rejestru Windows w celu zapewnienia bezpieczeństwa operacji, na początku należy

Brak odpowiedzi na to pytanie.

Jak nazywa się rodzaj licencji, który sprawia, że program jest w pełni funkcjonalny, ale można go uruchomić jedynie określoną, niewielką liczbę razy od momentu instalacji?

Brak odpowiedzi na to pytanie.

Jakie procesory można wykorzystać w zestawie komputerowym z płytą główną wyposażoną w gniazdo procesora typu Socket AM3?

Brak odpowiedzi na to pytanie.

Jaki adres IPv4 wykorzystuje się do testowania protokołów TCP/IP na jednym hoście?

Brak odpowiedzi na to pytanie.

Numer 22 umieszczony w adresie http://www.adres_serwera.pl:22 wskazuje na

Brak odpowiedzi na to pytanie.

Jakie urządzenie powinno się zastosować do przeprowadzenia testu POST dla komponentów płyty głównej?

Brak odpowiedzi na to pytanie.

Który protokół jest wykorzystywany do konwersji między adresami IP publicznymi a prywatnymi?

Brak odpowiedzi na to pytanie.

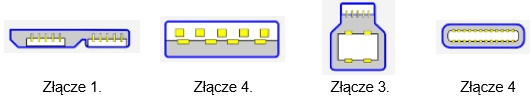

Na ilustracji zaprezentowano końcówkę kabla

Brak odpowiedzi na to pytanie.

Wskaż kształt złącza USB typu C.

Brak odpowiedzi na to pytanie.

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Brak odpowiedzi na to pytanie.

Wskaż sygnał informujący o błędzie karty graficznej w komputerze z BIOS POST od firmy AWARD?

Brak odpowiedzi na to pytanie.

Jakie protokoły są klasyfikowane jako protokoły transportowe w modelu ISO/OSI?

Brak odpowiedzi na to pytanie.

W technologii Ethernet protokół dostępu do medium CSMA/CD jest metodą z

Brak odpowiedzi na to pytanie.

Na schemacie płyty głównej port PCI oznaczony jest numerem

Brak odpowiedzi na to pytanie.

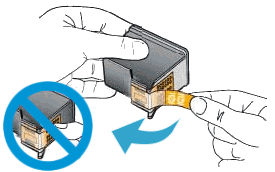

Przedstawiona czynność jest związana z eksploatacją drukarki

Brak odpowiedzi na to pytanie.