Pytanie 1

W dokumentacji technicznej głośnika komputerowego oznaczenie "10 W" dotyczy jego

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

W dokumentacji technicznej głośnika komputerowego oznaczenie "10 W" dotyczy jego

Najkrótszy czas dostępu charakteryzuje się

Rozmiar plamki na ekranie monitora LCD wynosi

Proces aktualizacji systemów operacyjnych ma na celu przede wszystkim

Czy bęben światłoczuły znajduje zastosowanie w drukarkach?

Monolityczne jądro (kernel) występuje w którym systemie?

Czym jest kopia różnicowa?

Programem w systemie Linux, który umożliwia nadzorowanie systemu za pomocą zcentralizowanego mechanizmu, jest narzędzie

W systemie Windows odpowiednikiem macierzy RAID1 jest wolumin

Co oznacza oznaczenie kabla skrętkowego S/FTP?

Który protokół zamienia adresy IP na adresy MAC, używane w sieciach Ethernet?

Jaką maskę podsieci należy wybrać dla sieci numer 1 oraz sieci numer 2, aby urządzenia z podanymi adresami mogły komunikować się w swoich podsieciach?

| sieć nr 1 | sieć nr 2 | |

|---|---|---|

| 1 | 10.12.0.12 | 10.16.12.5 |

| 2 | 10.12.12.5 | 10.16.12.12 |

| 3 | 10.12.5.12 | 10.16.12.10 |

| 4 | 10.12.5.18 | 10.16.12.16 |

| 5 | 10.12.16.5 | 10.16.12.20 |

W jaki sposób powinny być skonfigurowane uprawnienia dostępu w systemie Linux, aby tylko właściciel mógł wprowadzać zmiany w wybranym katalogu?

Który z poniższych protokołów funkcjonuje w warstwie aplikacji?

Jakie polecenie trzeba wydać w systemie Windows, aby zweryfikować tabelę mapowania adresów IP na adresy MAC wykorzystywane przez protokół ARP?

Jakie urządzenie służy do połączenia 6 komputerów w ramach sieci lokalnej?

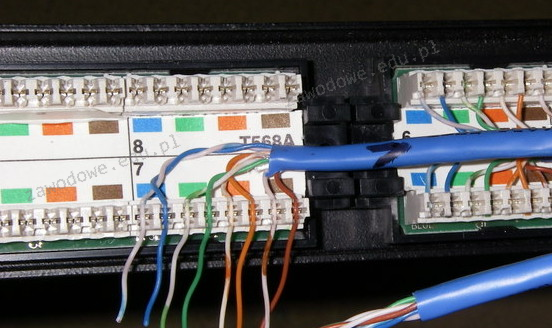

Na ilustracji widać patchpanel - panel krosowy kategorii 5E bez ekranowania, który posiada złącze szczelinowe typu LSA. Jakie narzędzie należy zastosować do wkładania kabli w te złącza?

Który z wymienionych protokołów umożliwia nawiązanie szyfrowanego połączenia z witryną internetową?

Co oznacza skrót WAN?

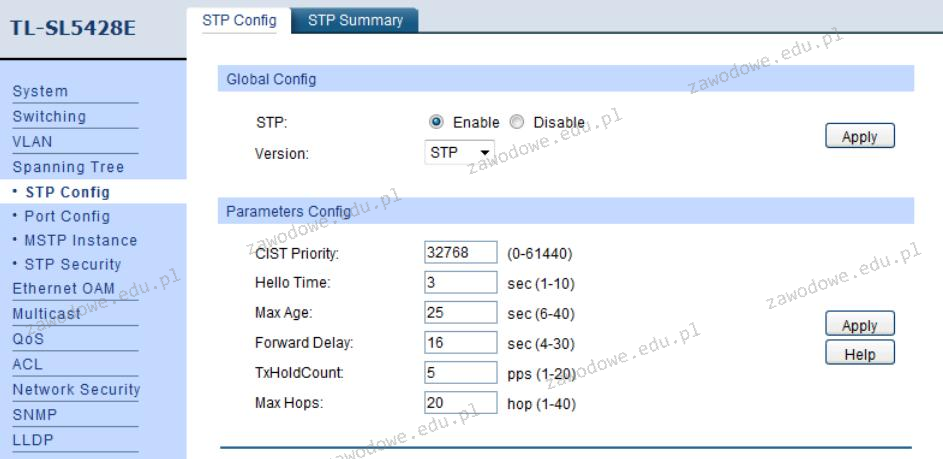

Na podstawie zrzutu ekranu ilustrującego ustawienia przełącznika można wnioskować, że

Polecenie to zostało wydane przez Administratora systemu operacyjnego w trakcie ręcznej konfiguracji sieciowego interfejsu. Wynikiem wykonania tego polecenia jest ```netsh interface ip set address name="Glowna" static 151.10.10.2 255.255.0.0 151.10.0.1```

W sieci lokalnej, aby chronić urządzenia sieciowe przed przepięciami oraz różnicami napięć, które mogą wystąpić w trakcie burzy lub innych wyładowań atmosferycznych, należy zastosować

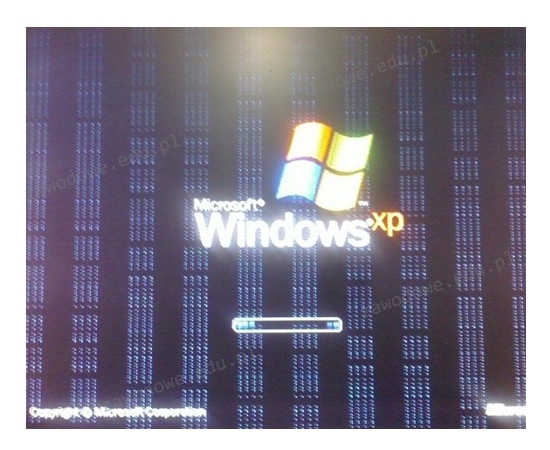

Usterka zaprezentowana na ilustracji, widoczna na monitorze, nie może być spowodowana przez

Wykorzystanie polecenia net accounts w konsoli systemu Windows, które ustawia maksymalny okres ważności hasła, wymaga zastosowania opcji

Jednym z rezultatów realizacji podanego polecenia jest

| sudo passwd -n 1 -x 5 test |

Rejestry procesora są resetowane poprzez

Jakie jest główne zadanie programu Wireshark?

Gdy w przeglądarce internetowej wpiszemy adres HTTP, pojawia się błąd "403 Forbidden", co oznacza, że

Jak nazywa się topologia fizyczna sieci, która wykorzystuje fale radiowe jako medium transmisyjne?

Zanim przystąpimy do prac serwisowych dotyczących modyfikacji rejestru systemu Windows, konieczne jest wykonanie

Osoba korzystająca z komputera, która testuje łączność sieciową używając polecenia ping, uzyskała wynik przedstawiony na rysunku. Jakie może być źródło braku reakcji serwera przy pierwszej próbie, zakładając, że adres domeny wp.pl to 212.77.100.101?

Który system plików powinien być wybrany podczas instalacji Linuxa, aby umożliwić ustalanie uprawnień dla plików i katalogów?

Do jakich celów powinno się aktywować funkcję RMON (Remote Network Monitoring) w przełączniku?

Aby wymusić na użytkownikach lokalnych systemów z rodziny Windows Server regularną zmianę haseł oraz stosowanie haseł o odpowiedniej długości, które spełniają kryteria złożoności, należy ustawić

Aby uzyskać największą prędkość przepływu danych w przypadku, gdy domowy ruter pracuje w paśmie częstotliwości 5 GHz, do notebooka powinno się zamontować bezprzewodową kartę sieciową pracującą w standardzie

W specyfikacji głośników komputerowych producent mógł podać informację, że maksymalne pasmo przenoszenia wynosi

Do bezprzewodowego przesyłania danych pomiędzy dwoma urządzeniami, z wykorzystaniem fal radiowych w paśmie ISM 2,4 GHz, służy interfejs

Menedżer urządzeń w systemie Windows pozwala na wykrycie

Adres IP komputera wyrażony sekwencją 172.16.0.1 jest zapisany w systemie

Która lokalizacja umożliwia utworzenie kopii zapasowej dysku systemowego Windows 11?