Pytanie 1

Na którym z zewnętrznych nośników danych nie dojdzie do przeniknięcia wirusa podczas przeglądania jego zawartości?

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Na którym z zewnętrznych nośników danych nie dojdzie do przeniknięcia wirusa podczas przeglądania jego zawartości?

Błąd typu STOP Error (Blue Screen) w systemie Windows, który wiąże się z odniesieniem się systemu do niepoprawnych danych w pamięci RAM, to

Co należy zrobić przed przystąpieniem do prac serwisowych związanych z edytowaniem rejestru systemu Windows?

Podczas przetwarzania pakietów danych w sieci, wartość pola TTL (ang. Time To Live) jest modyfikowana za każdym razem, gdy pakiet przechodzi przez ruter. Jaką wartość tego pola należy ustawić, aby ruter skasował pakiet?

Jakie urządzenie pozwala na połączenie lokalnej sieci komputerowej z Internetem?

Jakie właściwości topologii fizycznej sieci zostały przedstawione w poniższej ramce?

Zidentyfikowanie głównego rekordu rozruchowego, który uruchamia system z aktywnej partycji, jest możliwe dzięki

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aby poprawić niezawodność i efektywność przesyłu danych na serwerze, należy

W systemie Linux, żeby ustawić domyślny katalog domowy dla nowych użytkowników na katalog /users/home/new, konieczne jest użycie polecenia

Termin gorącego podłączenia (hot-plug) wskazuje, że podłączane urządzenie działa

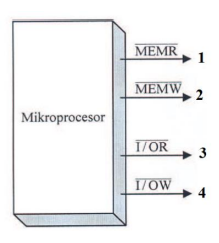

Sygnał kontrolny generowany przez procesor, umożliwiający zapis do urządzeń wejściowych i wyjściowych, został na diagramie oznaczony numerem

Aby kontrolować ilość transferu w sieci, administrator powinien zastosować program rodzaju

Jakie urządzenie umożliwia połączenie sieci lokalnej z siecią rozległą?

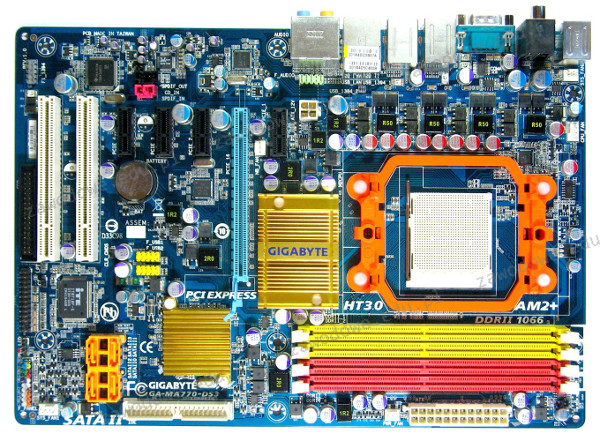

Jakie złącze umożliwia przesył danych między przedstawioną na ilustracji płytą główną a urządzeniem zewnętrznym, nie dostarczając jednocześnie zasilania do tego urządzenia przez interfejs?

Który interfejs pozwala na korzystanie ze sterowników oraz oprogramowania systemu operacyjnego, umożliwiając m.in. przesył danych pomiędzy pamięcią systemową a dyskiem SATA?

Elementem, który umożliwia wymianę informacji pomiędzy procesorem a magistralą PCI-E, jest

Na podstawie wskazanego cennika oblicz, jaki będzie łączny koszt brutto jednego podwójnego natynkowego gniazda abonenckiego w wersji dwumodułowej?

| Lp. | Nazwa | j.m. | Cena jednostkowa brutto |

|---|---|---|---|

| 1. | Puszka natynkowa 45x45mm dwumodułowa | szt. | 4,00 zł |

| 2. | Ramka + suport 45x45mm dwumodułowa | szt. | 4,00 zł |

| 3. | Adapter 22,5x45mm do modułu keystone | szt. | 3,00 zł |

| 4. | Moduł keystone RJ45 kategorii 5e | szt. | 7,00 zł |

Po zauważeniu przypadkowego skasowania istotnych danych na dysku, najlepszym sposobem na odzyskanie usuniętych plików jest

Dysk zewnętrzny 3,5" o pojemności 5 TB, używany do archiwizacji lub wykonywania kopii zapasowych, wyposażony jest w obudowę z czterema interfejsami komunikacyjnymi do wyboru. Który z tych interfejsów powinien być użyty do podłączenia do komputera, aby uzyskać najwyższą prędkość transferu?

Interfejs SATA 2 (3Gb/s) oferuje prędkość transferu

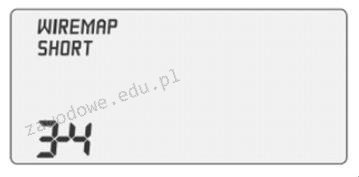

Na rysunku ukazano rezultat testu okablowania. Jakie jest znaczenie uzyskanego wyniku pomiaru?

Najbardziej rozwinięty tryb funkcjonowania portu równoległego zgodnego z normą IEEE-1284, który tworzy dwukierunkową szeregę 8-bitową zdolną do przesyłania zarówno danych, jak i adresów z maksymalną prędkością transmisji wynoszącą 2,3 MB/s oraz umożliwia podłączenie do 64 urządzeń, to

Funkcja Intel Turbo Boost w mikroprocesorze umożliwia

Kluczowe znaczenie przy tworzeniu stacji roboczej dla wielu wirtualnych maszyn ma

Aby zabezpieczyć system przed atakami typu phishing, nie zaleca się

Niekorzystną właściwością macierzy RAID 0 jest

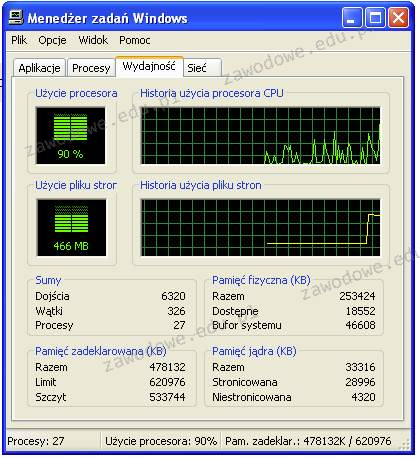

Przyglądając się przedstawionemu obrazkowi, można dostrzec, że deklarowany limit pamięci wynosi 620976 KB. Zauważamy również, że zainstalowana pamięć fizyczna w badanym systemie jest mniejsza niż pamięć zadeklarowana. Który typ pamięci wpływa na podniesienie limitu pamięci zadeklarowanej powyżej rozmiaru zainstalowanej pamięci fizycznej?

Który z protokołów funkcjonuje w warstwie aplikacji modelu ISO/OSI, umożliwiając wymianę informacji kontrolnych między urządzeniami sieciowymi?

Adres IP (ang. Internet Protocol Address) to

Zestaw komputerowy, który został przedstawiony, jest niepełny. Który z elementów nie został wymieniony w tabeli, a jest kluczowy dla prawidłowego funkcjonowania zestawu?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Zalman Obudowa R1 Midi Tower bez PSU, USB 3.0 |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, BOX |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

W interfejsie graficznym systemów Ubuntu lub SuSE Linux, aby zainstalować aktualizacje programów systemowych, można zastosować aplikacje

Do czego służy oprogramowanie Microsoft Hyper-V?

Na wyświetlaczu drukarki widnieje komunikat "PAPER JAM". Aby zlikwidować problem, należy w pierwszej kolejności

Jaką maskę domyślną mają adresy IP klasy B?

AppLocker to funkcjonalność dostępna w systemach Windows Server, która umożliwia

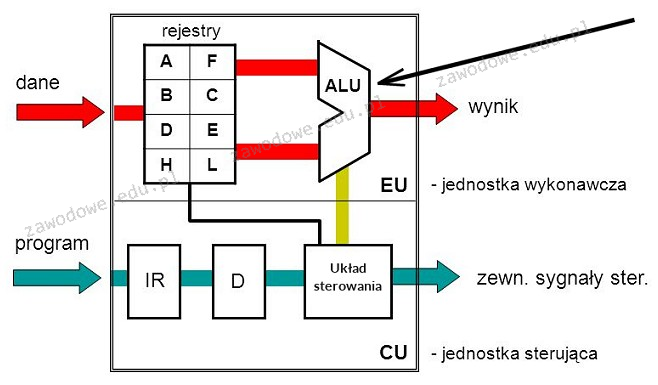

Na diagramie mikroprocesora blok wskazany strzałką pełni rolę

Polecenie to zostało wydane przez Administratora systemu operacyjnego w trakcie ręcznej konfiguracji sieciowego interfejsu. Wynikiem wykonania tego polecenia jest ```netsh interface ip set address name="Glowna" static 151.10.10.2 255.255.0.0 151.10.0.1```

Która z podanych właściwości kabla koncentrycznego RG-58 sprawia, że obecnie nie jest on używany do tworzenia lokalnych sieci komputerowych?

Industry Standard Architecture to norma magistrali, według której szerokość szyny danych wynosi