Pytanie 1

Po wykonaniu eksportu klucza HKCR zostanie zapisana kopia rejestru, zawierająca informacje dotyczące konfiguracji

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Po wykonaniu eksportu klucza HKCR zostanie zapisana kopia rejestru, zawierająca informacje dotyczące konfiguracji

Po stwierdzeniu przypadkowego usunięcia ważnych danych na dysku twardym, aby odzyskać usunięte pliki, najlepiej

Po zauważeniu przypadkowego skasowania istotnych danych na dysku, najlepszym sposobem na odzyskanie usuniętych plików jest

Po dokonaniu eksportu klucza HKCU powstanie kopia rejestru zawierająca dane dotyczące ustawień

W dokumentacji przedstawiono typ systemu plików

| „Zaawansowany system plików zapewniający wydajność, bezpieczeństwo, niezawodność i zaawansowane funkcje niespotykane w żadnej wersji systemu FAT. Na przykład dzięki standardowemu rejestrowaniu transakcji i technikom odzyskiwania danych system gwarantuje spójność woluminów. W przypadku awarii system wykorzystuje plik dziennika i informacje kontrolne do przywrócenia spójności systemu plików." |

Przed rozpoczęciem instalacji sterownika dla urządzenia peryferyjnego system Windows powinien weryfikować, czy dany sterownik ma podpis

Jak skonfigurować dziennik w systemie Windows Server, aby rejestrować zarówno udane, jak i nieudane próby logowania użytkowników oraz działania na zasobach dyskowych?

Jakie porty powinny być odblokowane w firewallu komputera, aby uzyskać dostęp do zainstalowanej usługi FTP?

Aby zapobiec uszkodzeniu sprzętu w trakcie modernizacji laptopa polegającej na wymianie modułów pamięci RAM, należy

Jednym z zaleceń w zakresie ochrony przed wirusami jest przeprowadzanie skanowania całego systemu. W związku z tym należy skanować komputer

Które systemy operacyjne są atakowane przez wirusa MS Blaster?

W systemie Windows mechanizm ostrzegający przed uruchamianiem nieznanych aplikacji oraz plików pobranych z Internetu funkcjonuje dzięki

Nawiązywanie szyfrowanych połączeń pomiędzy hostami w sieci publicznej Internet, wykorzystywane w kontekście VPN (Virtual Private Network), to

Jaki protokół umożliwia terminalowe połączenie zdalne z urządzeniami, zapewniając przy tym transfer danych w sposób zaszyfrowany?

Aby chronić systemy sieciowe przed atakami z zewnątrz, należy zastosować

Użytkownicy dysków SSD powinni unikać wykonywania następujących działań konserwacyjnych

Jaką funkcję pełni punkt dostępowy, aby zabezpieczyć sieć bezprzewodową w taki sposób, aby jedynie urządzenia z wybranymi adresami MAC mogły się do niej łączyć?

Niekorzystną właściwością macierzy RAID 0 jest

Jakie miejsce nie jest zalecane do przechowywania kopii zapasowej danych z dysku twardego komputera?

Do jakiej grupy w systemie Windows Server 2008 powinien być przypisany użytkownik odpowiedzialny jedynie za archiwizację danych zgromadzonych na dysku serwera?

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie otrzymał zadanie podziału aktualnej lokalnej sieci komputerowej na 16 podsieci. Obecna sieć posiada adres IP 192.168.20.0 i maskę 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

Symbole i oznaczenia znajdujące się na zamieszczonej tabliczce znamionowej podzespołu informują między innymi o tym, że produkt jest

Najefektywniejszym zabezpieczeniem danych firmy, której siedziby znajdują się w różnych, odległych od siebie lokalizacjach, jest zastosowanie

Bezpośrednio po usunięciu istotnych plików z dysku twardego, użytkownik powinien

W systemie Windows 7 program Cipher.exe w trybie poleceń jest używany do

Aby zabezpieczyć system przed atakami z sieci nazywanymi phishingiem, nie powinno się

Polecenie tar w systemie Linux służy do

Osoba korzystająca z lokalnej sieci musi mieć możliwość dostępu do dokumentów umieszczonych na serwerze. W tym celu powinna

W systemach Windows XP Pro/Windows Vista Business/Windows 7 Pro/Windows 8 Pro, funkcją zapewniającą ochronę danych dla użytkowników dzielących ten sam komputer, których informacje mogą być wykorzystywane wyłącznie przez nich, jest

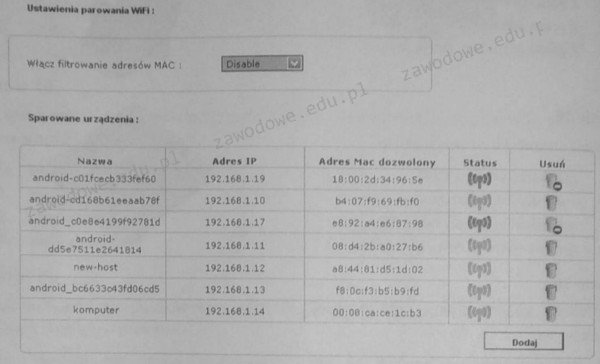

Schemat ilustruje ustawienia urządzenia WiFi. Wskaż, które z poniższych stwierdzeń na temat tej konfiguracji jest prawdziwe?

Natychmiast po dostrzeżeniu utraty istotnych plików na dysku twardym, użytkownik powinien

Na którym z zewnętrznych nośników danych nie dojdzie do przeniknięcia wirusa podczas przeglądania jego zawartości?

Czym jest dziedziczenie uprawnień?

Adware to program komputerowy

Jakie działanie może skutkować nieodwracalną utratą danych w przypadku awarii systemu plików?

Która z kopii w trakcie archiwizacji plików pozostawia ślad archiwizacji?

Litera S w protokole FTPS oznacza zabezpieczenie danych podczas ich przesyłania poprzez

W komputerze połączonym z Internetem, w oprogramowaniu antywirusowym aktualizację bazy wirusów powinno się przeprowadzać minimum

Które z poniższych zdań charakteryzuje protokół SSH (Secure Shell)?

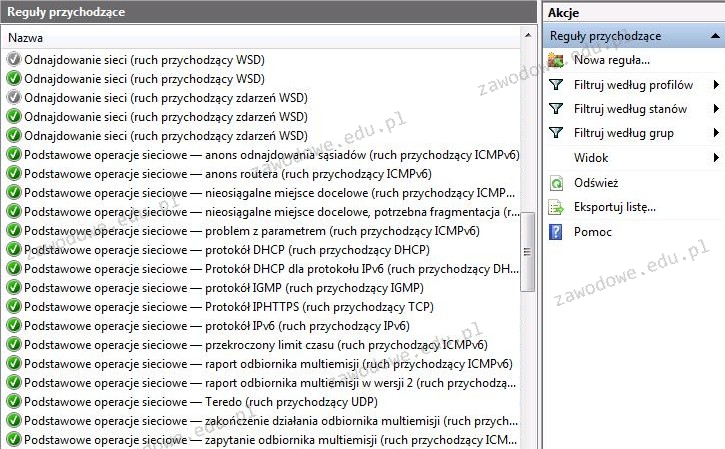

Zrzut ekranu ilustruje aplikację