Pytanie 1

Jaki rodzaj portu może być wykorzystany do podłączenia zewnętrznego dysku do laptopa?

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

Jaki rodzaj portu może być wykorzystany do podłączenia zewnętrznego dysku do laptopa?

Programy antywirusowe mogą efektywnie zabezpieczać komputer. Istotne jest, aby wybrać możliwość uruchamiania aplikacji razem z komputerem oraz opcję

Gdy użytkownik zauważy, że ważne pliki zniknęły z dysku twardego, powinien

Poprawę jakości skanowania można osiągnąć poprzez zmianę

W pierwszym oktecie adresów IPv4 klasy B znajdują się liczby mieszczące się w przedziale

Który z interfejsów umożliwia transfer danych zarówno w formacie cyfrowym, jak i analogowym pomiędzy komputerem a wyświetlaczem?

Ile podsieci tworzą komputery z adresami: 192.168.5.12/25, 192.168.5.50/25, 192.168.5.200/25, 192.158.5.250/25?

W przedsiębiorstwie trzeba było zreperować 5 komputerów i serwer. Czas potrzebny na naprawę każdego z komputerów wyniósł 1,5 godziny, a serwera 2,5 godziny. Stawka za usługę to 100,00 zł za roboczogodzinę, a do tego doliczany jest podatek VAT w wysokości 23%. Jaka kwota brutto będzie należna za tę usługę?

Jakie polecenie w systemie Linux pokazuje czas działania systemu oraz jego średnie obciążenie?

Do wymiany uszkodzonych kondensatorów w karcie graficznej potrzebne jest

Port AGP służy do łączenia

W specyfikacji IEEE 802.3af opisano technologię dostarczania energii elektrycznej do różnych urządzeń sieciowych jako

Jaką rolę pełni usługa NAT działająca na ruterze?

Jakie urządzenie aktywne pozwoli na podłączenie do sieci lokalnej za pomocą kabla UTP 15 komputerów, drukarki sieciowej oraz rutera?

Komputer z adresem IP 192.168.5.165 oraz maską podsieci 255.255.255.192 funkcjonuje w sieci o adresie

Jakie funkcje posiada program tar?

Który z protokołów nie działa w warstwie aplikacji modelu ISO/OSI?

Komenda dsadd pozwala na

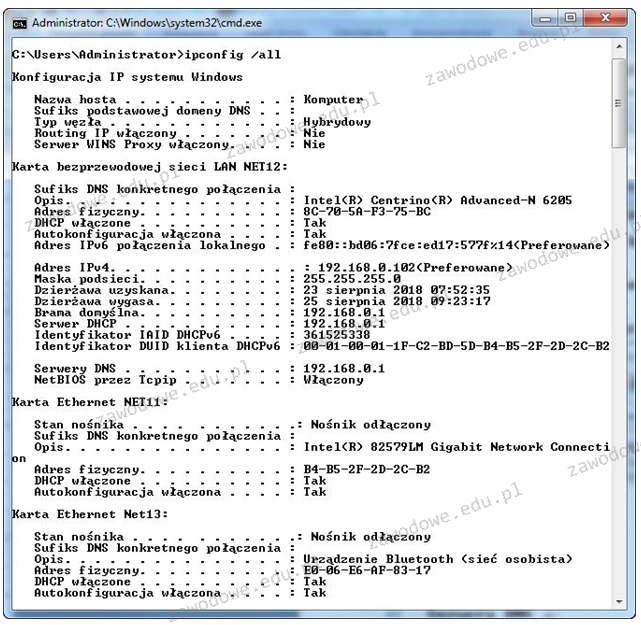

Analizując przedstawione wyniki konfiguracji zainstalowanych kart sieciowych na komputerze, można zauważyć, że

Nośniki danych, które są odporne na zakłócenia elektromagnetyczne oraz atmosferyczne, to

Wartość liczby 1100112 zapisanej w systemie dziesiętnym wynosi

Jakim protokołem posługujemy się do przesyłania dokumentów hipertekstowych?

Postcardware to typ

Programem służącym do archiwizacji danych w systemie Linux jest

Zamontowany w notebooku trackpoint jest urządzeniem wejściowym reagującym na

Która z poniższych czynności konserwacyjnych jest specyficzna tylko dla drukarki laserowej?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Który z poniższych mechanizmów zapewni najwyższy stopień ochrony sieci bezprzewodowych w standardzie 802.11n?

Protokół SNMP (Simple Network Management Protocol) służy do

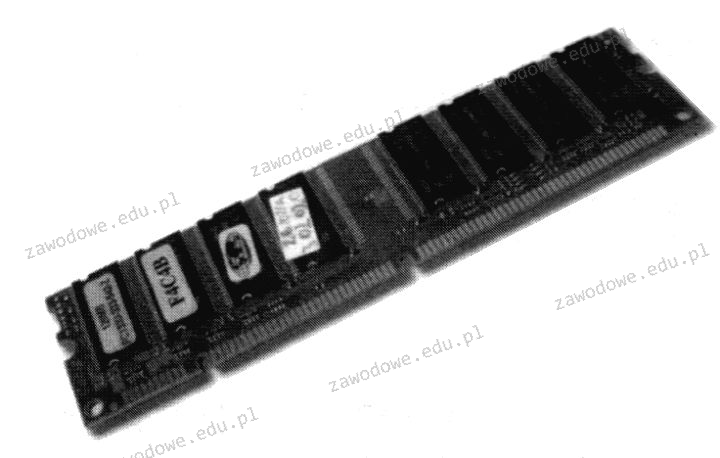

Na fotografii ukazana jest pamięć o 168 stykach

Odmianą pamięci, która zapewnia tylko odczyt i może być usunięta przy użyciu światła ultrafioletowego, jest pamięć

Który z poniższych interfejsów komputerowych stosuje transmisję równoległą do przesyłania danych?

Jaki protokół stworzony przez IBM służy do udostępniania plików w architekturze klient-serwer oraz do współdzielenia zasobów z sieciami Microsoft w systemach operacyjnych LINUX i UNIX?

Jakie miejsce nie jest zalecane do przechowywania kopii zapasowej danych z dysku twardego komputera?

W systemach operacyjnych Windows konto użytkownika, które ma najwyższe domyślne uprawnienia, należy do grupy

Unity Tweak Tool oraz narzędzia dostrajania to elementy systemu Linux, które mają na celu

Aby umożliwić diagnozę systemu operacyjnego Windows oraz utworzyć plik zawierający listę wszystkich zaczytywanych sterowników, należy uruchomić system w trybie

Zjawisko przenikania, które ma miejsce w sieciach komputerowych, polega na

Technologia, która umożliwia szerokopasmowy dostęp do Internetu z różnymi prędkościami pobierania i wysyłania danych, to

Który z protokołów służy do synchronizacji czasu?