Pytanie 1

Aby zmienić istniejące konto użytkownika przy użyciu polecenia net user oraz wymusić reset hasła po kolejnej sesji logowania użytkownika, jaki parametr należy dodać do tego polecenia?

Wynik: 13/40 punktów (32,5%)

Wymagane minimum: 20 punktów (50%)

Aby zmienić istniejące konto użytkownika przy użyciu polecenia net user oraz wymusić reset hasła po kolejnej sesji logowania użytkownika, jaki parametr należy dodać do tego polecenia?

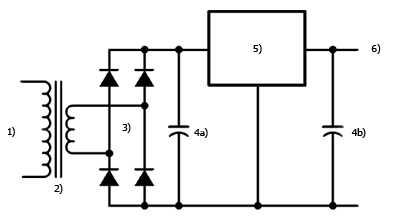

Na schemacie blokowym przedstawiającym zasadę działania zasilacza liniowego numerem 5) oznaczono

Cienki klient (thin client) korzysta z protokołu

Do wykonania obrazu dysku twardego można użyć programu

W systemie Linux polecenie touch jest używane do

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

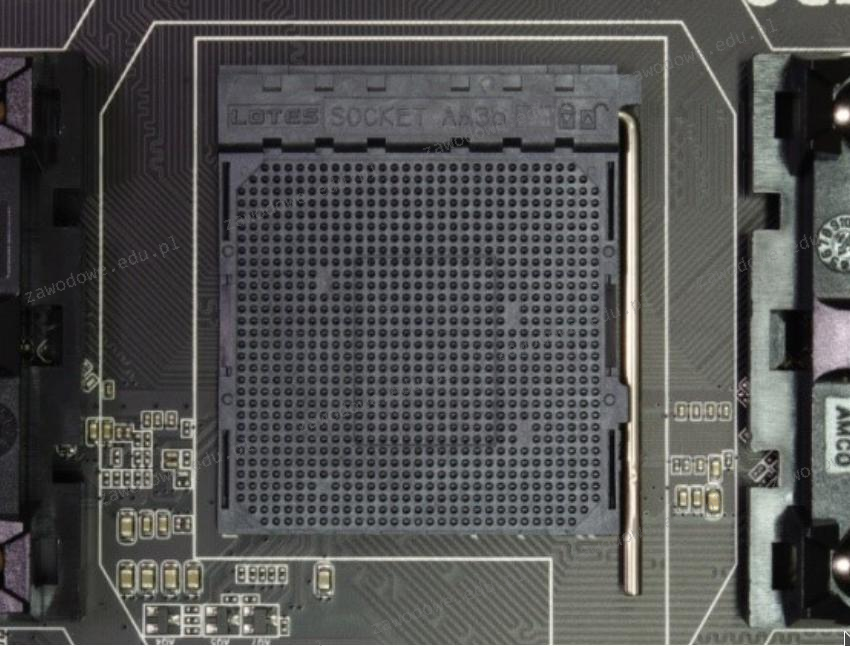

Na płycie głównej z gniazdem pokazanym na fotografii możliwe jest zainstalowanie procesora

Algorytm wykorzystywany do weryfikacji, czy ramka Ethernet jest wolna od błędów, to

Adres fizyczny karty sieciowej AC-72-89-17-6E-B2 jest zapisany w formacie

Klient dostarczył niesprawny sprzęt komputerowy do serwisu. Serwisant w trakcie procedury przyjęcia sprzętu, lecz przed przystąpieniem do jego naprawy, powinien

Informacje ogólne dotyczące zdarzeń systemowych w systemie Linux są zapisywane w

Jakie oznaczenie powinien mieć komputer, aby mógł zostać sprzedany na terenie Polski, zgodnie z Dyrektywami Rady Europy?

Jakie jest najwyższe możliwe tempo odczytu płyt CD-R w urządzeniu o oznaczeniu x48?

Protokół transportowy bez połączenia w modelu ISO/OSI to

Aby zainstalować usługę Active Directory w systemie Windows Server, konieczne jest uprzednie zainstalowanie oraz skonfigurowanie serwera

Serwis serwerowy, który pozwala na udostępnianie usług drukowania w systemie Linux oraz plików dla stacji roboczych Windows, to

W systemie binarnym liczba szesnastkowa 29A będzie przedstawiona jako:

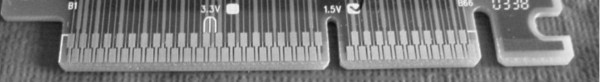

Na ilustracji przedstawiono fragment karty graficznej ze złączem

Jak nazywa się seria procesorów produkowanych przez firmę Intel, charakteryzująca się małymi wymiarami oraz niskim zużyciem energii, zaprojektowana z myślą o urządzeniach mobilnych?

W systemie Linux komenda tty pozwala na

Użycie polecenia net accounts w Wierszu poleceń systemu Windows, które ustawia maksymalny czas ważności hasła, wymaga zastosowania opcji

Jak ustawić w systemie Windows Server 2008 parametry protokołu TCP/IP karty sieciowej, aby komputer mógł jednocześnie funkcjonować w dwóch sieciach lokalnych o różnych adresach IP?

Procesory AMD z gniazdem AM2+ będą prawidłowo funkcjonować na płycie głównej, która ma podstawkę socket

Najefektywniejszym zabezpieczeniem danych firmy, której siedziby znajdują się w różnych, odległych od siebie lokalizacjach, jest zastosowanie

Który z trybów nie jest dostępny dla narzędzia powiększenia w systemie Windows?

Usługi na serwerze są konfigurowane za pomocą

Jaką operację można wykonać podczas konfiguracji przełącznika CISCO w interfejsie CLI, nie przechodząc do trybu uprzywilejowanego, w zakresie dostępu widocznym w ramce?

| Switch> |

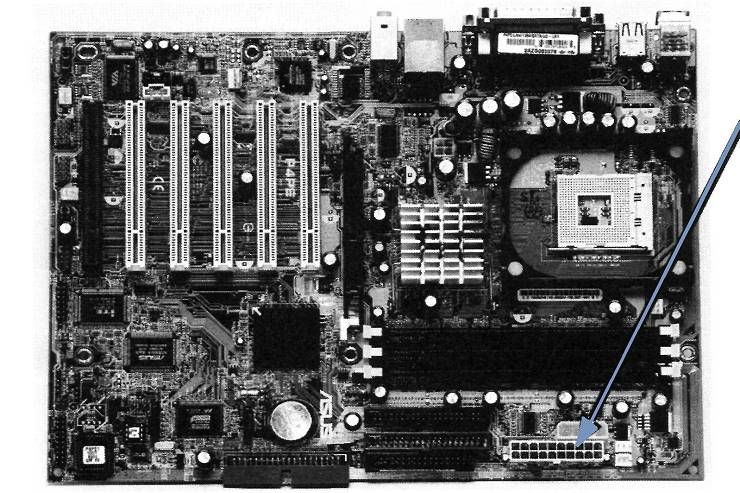

Na zdjęciu widać płytę główną komputera. Strzałka wskazuje na

W tabeli przedstawiono pobór mocy poszczególnych podzespołów zestawu komputerowego. Zestaw składa się z:

- płyty głównej,

- procesora,

- 2 modułów pamięci DDR3,

- dysku twardego SSD,

- dysku twardego z prędkością obrotową 7200,

- karty graficznej,

- napędu optycznego,

- myszy i klawiatury,

- wentylatora.

Który zasilacz należy zastosować dla przedstawionego zestawu komputerowego, uwzględniając co najmniej 20% rezerwy poboru mocy?

| Podzespół | Pobór mocy [W] | Podzespół | Pobór mocy [W] |

|---|---|---|---|

| Procesor Intel i5 | 60 | Płyta główna | 35 |

| Moduł pamięci DDR3 | 6 | Karta graficzna | 310 |

| Moduł pamięci DDR2 | 3 | Dysk twardy SSD | 7 |

| Monitor LCD | 80 | Dysk twardy 7200 obr./min | 16 |

| Wentylator | 5 | Dysk twardy 5400 obr./min | 12 |

| Mysz i klawiatura | 2 | Napęd optyczny | 30 |

Która z konfiguracji RAID opiera się na replikacji danych pomiędzy dwoma lub większą liczbą dysków fizycznych?

Użytkownik systemu Windows może logować się na każdym komputerze w sieci, korzystając z profilu, który jest przechowywany na serwerze i może być zmieniany przez użytkownika. Jak nazywa się ten profil?

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

RAMDAC konwerter przekształca sygnał

W systemie Linux plik ma przypisane uprawnienia 765. Jakie działania może wykonać grupa związana z tym plikiem?

Demon serwera Samba pozwala na udostępnianie plików oraz drukarek w sieci

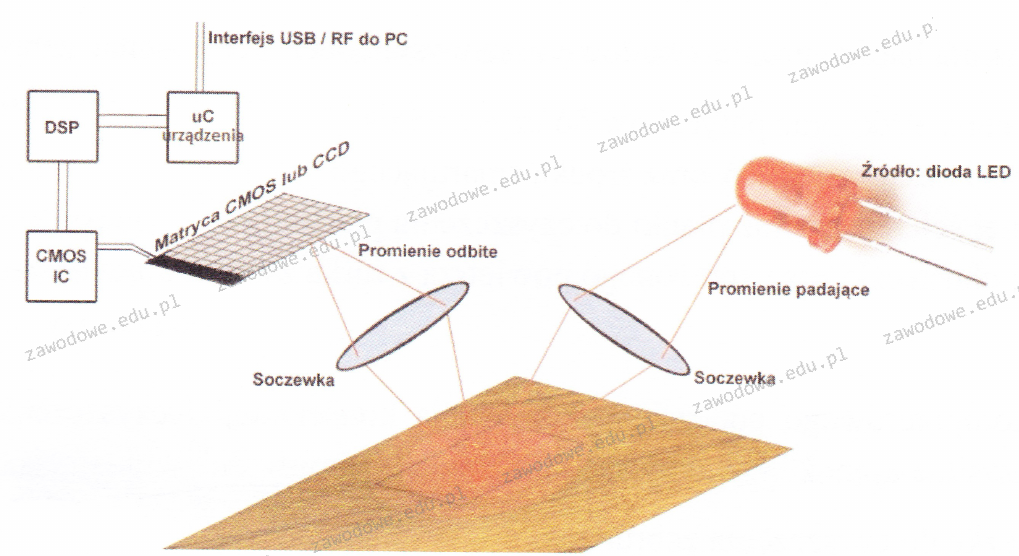

Zilustrowany schemat przedstawia zasadę funkcjonowania

Odnalezienie głównego rekordu rozruchowego, wczytującego system z aktywnej partycji umożliwia

Jaki będzie rezultat odejmowania dwóch liczb zapisanych w systemie heksadecymalnym 60Ah - 3BFh?

Mysz komputerowa z interfejsem bluetooth pracującym w klasie 2 ma teoretyczny zasięg do

Jakie oprogramowanie jest wykorzystywane do dynamicznej obsługi urządzeń w systemie Linux?