Pytanie 1

W systemie Linux komenda cd ~ umożliwia

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

W systemie Linux komenda cd ~ umożliwia

Jak nazywa się rodzaj licencji, który sprawia, że program jest w pełni funkcjonalny, ale można go uruchomić jedynie określoną, niewielką liczbę razy od momentu instalacji?

W systemie Windows, aby udostępnić folder jako ukryty, należy na końcu nazwy udostępniania umieścić znak

Osoba korzystająca z systemu Windows zdecydowała się na przywrócenie systemu do określonego punktu. Które pliki utworzone po tym punkcie NIE zostaną zmienione w wyniku tej operacji?

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się działania usuwania starych plików oraz dodawania nowych plików, doświadcza

Jaki protokół stosują komputery, aby informować router o zamiarze dołączenia do lub opuszczenia konkretnej grupy multicastowej?

Który standard IEEE 802.3 powinien być użyty w sytuacji z zakłóceniami elektromagnetycznymi, jeżeli odległość między punktem dystrybucyjnym a punktem abonenckim wynosi 200 m?

Jakie polecenie w systemie Windows służy do analizowania ścieżki, jaką pokonują pakiety w sieci?

Który z podanych adresów IP należy do klasy A?

Jakie urządzenie pozwala na podłączenie drukarki, która nie ma karty sieciowej, do lokalnej sieci komputerowej?

System S.M.A.R.T. jest używany do nadzorowania funkcjonowania i identyfikowania problemów

Jaki typ rozbudowy serwera wymaga zainstalowania dodatkowych sterowników?

Adres IP 192.168.2.0/24 podzielono na cztery różne podsieci. Jaką maskę mają te nowe podsieci?

Jakiego narzędzia należy użyć do zakończenia końcówek kabla UTP w module keystone z złączami typu 110?

Tryb użytkownika w przełączniku CISCO (User EXEC Mode) umożliwia

Który z protokołów umożliwia bezpieczne połączenie klienta z zachowaniem anonimowości z witryną internetową banku?

W systemie Linux komenda ps wyświetli

Jakie zadanie pełni router?

Płyta główna serwerowa potrzebuje pamięci z rejestrem do prawidłowego funkcjonowania. Który z poniższych modułów pamięci będzie zgodny z tą płytą?

Ile maksymalnie hostów można przydzielić w sieci o masce 255.255.255.192?

Który typ rekordu w bazie DNS (Domain Name System) umożliwia ustalenie aliasu dla rekordu A?

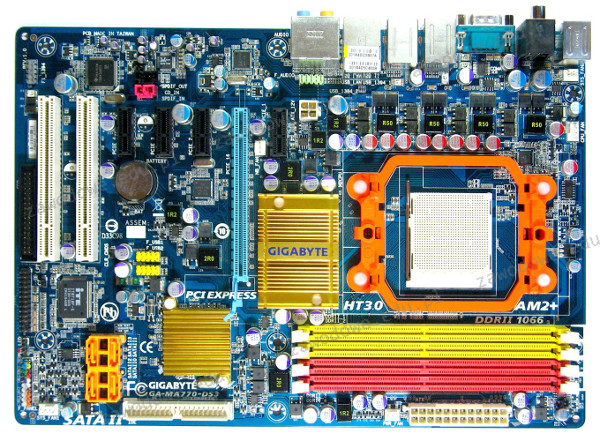

Jakie złącze umożliwia przesył danych między przedstawioną na ilustracji płytą główną a urządzeniem zewnętrznym, nie dostarczając jednocześnie zasilania do tego urządzenia przez interfejs?

Jakie narzędzie należy zastosować w systemie Windows, aby skonfigurować właściwości wszystkich zainstalowanych urządzeń lub wyświetlić ich listę?

Zainstalowanie w komputerze wskazanej karty pozwoli na

Jaką maksymalną długość kabla typu skrętka pomiędzy panelem krosowniczym a gniazdem abonenckim przewiduje norma PN-EN 50174-2?

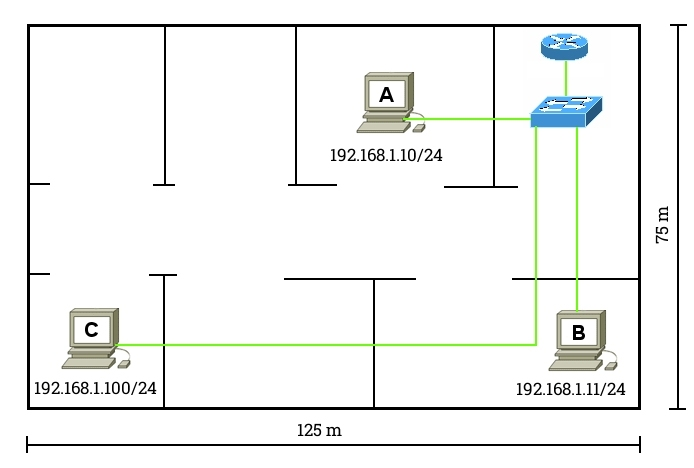

Na schemacie pokazano sieć LAN wykorzystującą okablowanie kategorii 6. Stacja robocza C nie może nawiązać połączenia z siecią. Jaki problem warstwy fizycznej może być przyczyną braku komunikacji?

Jakie urządzenie powinno się zastosować do przeprowadzenia testu POST dla komponentów płyty głównej?

Do dynamicznej obsługi sprzętu w Linuxie jest stosowany system

W systemie Windows powiązanie rozszerzeń plików z odpowiednimi programami realizuje się za pomocą polecenia

W specyfikacji IEEE 802.3af opisano technologię dostarczania energii elektrycznej do różnych urządzeń sieciowych jako

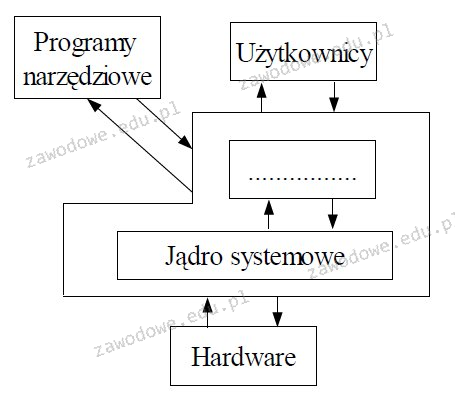

Jaki termin powinien zostać umieszczony w miejscu z kropkami na schemacie blokowym przedstawiającym strukturę systemu operacyjnego?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Na stronie wydrukowanej przez drukarkę laserową występują jaśniejsze i ciemniejsze fragmenty. W celu usunięcia problemów z jakością oraz nieciągłościami w wydruku, należy

Jeden długi oraz dwa krótkie sygnały dźwiękowe BIOS POST od firm AMI i AWARD wskazują na wystąpienie błędu

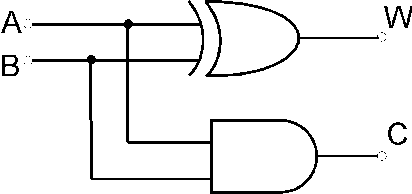

Wynikiem działania przedstawionego układu logicznego po podaniu na wejściach A i B sygnałów logicznych A=1 i B=1 są wartości logiczne:

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

W systemie Windows po wykonaniu polecenia systeminfo nie otrzyma się informacji o

Jakie urządzenie pracuje w warstwie łącza danych i umożliwia integrację segmentów sieci o różnych architekturach?

W przypadku dłuższego nieużytkowania drukarki atramentowej, pojemniki z tuszem powinny

Jakość skanowania można poprawić poprzez zmianę