Pytanie 1

Uruchomienie systemu Windows w trybie debugowania pozwala na

Wynik: 13/40 punktów (32,5%)

Wymagane minimum: 20 punktów (50%)

Uruchomienie systemu Windows w trybie debugowania pozwala na

Do czego służy polecenie 'ping' w systemie operacyjnym?

Pierwszym krokiem koniecznym do ochrony rutera przed nieautoryzowanym dostępem do jego panelu konfiguracyjnego jest

Jakiego protokołu używa polecenie ping?

Graficzny symbol pokazany na ilustracji oznacza

Jak nazywa się zestaw usług internetowych dla systemów operacyjnych Microsoft Windows, który pozwala na działanie jako serwer FTP i serwer WWW?

Jakie oprogramowanie można wykorzystać do wykrywania problemów w pamięciach RAM?

Dobrze zaplanowana sieć komputerowa powinna pozwalać na rozbudowę, co oznacza, że musi charakteryzować się

Informacje ogólne dotyczące zdarzeń systemowych w systemie Linux są zapisywane w

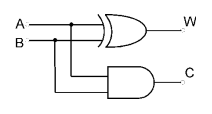

Jakie wartości logiczne otrzymamy w wyniku działania podanego układu logicznego, gdy na wejścia A i B wprowadzimy sygnały A=1 oraz B=1?

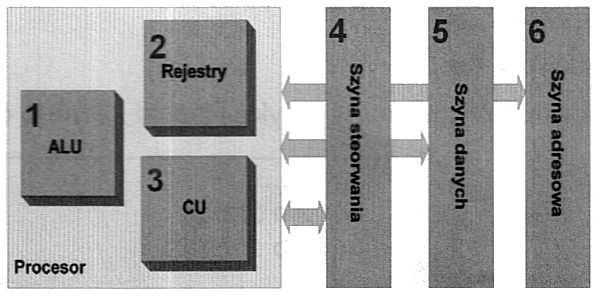

Na diagramie element odpowiedzialny za dekodowanie poleceń jest oznaczony liczbą

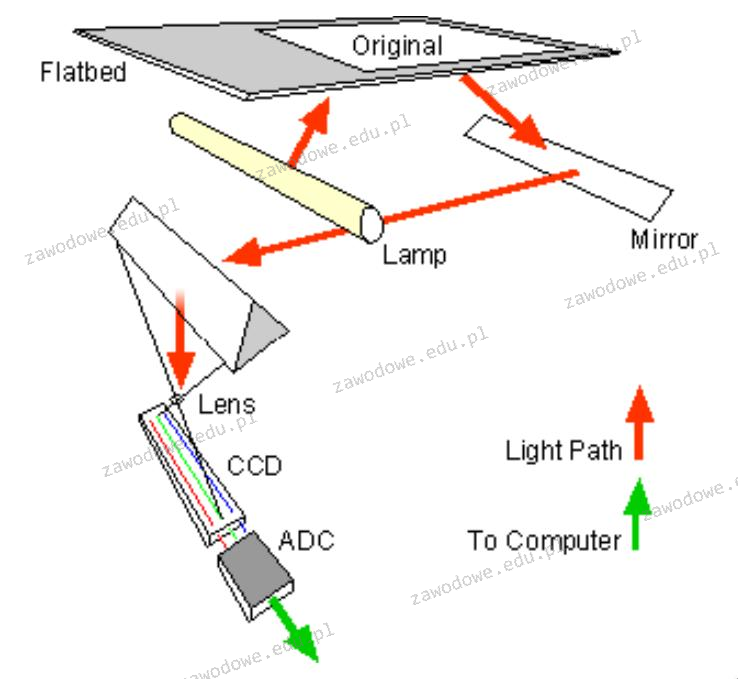

Ilustrowany schemat obrazuje zasadę funkcjonowania

Zgodnie z podanym cennikiem, przeciętny koszt zakupu wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

Zamiana taśmy barwiącej wiąże się z eksploatacją drukarki

Jakie narzędzie jest używane w systemie Windows do przywracania właściwych wersji plików systemowych?

Który standard IEEE 802.3 powinien być użyty w sytuacji z zakłóceniami elektromagnetycznymi, jeżeli odległość między punktem dystrybucyjnym a punktem abonenckim wynosi 200 m?

Który z systemów operacyjnych przeznaczonych do sieci jest dostępny na zasadach licencji GNU?

Korzystając z polecenia taskmgr, użytkownik systemu Windows może

Jakie napięcie zasilające mają pamięci DDR2?

Przed dokonaniem zakupu komponentu komputera lub urządzenia peryferyjnego na platformach aukcyjnych, warto zweryfikować, czy nabywane urządzenie ma wymagany w Polsce certyfikat

Wykonanie polecenia attrib +h +s +r przykład.txt w konsoli systemu Windows spowoduje

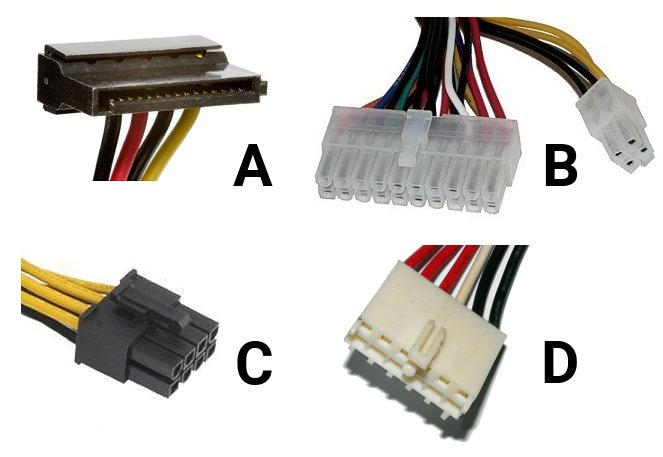

Wskaż rodzaj wtyczki zasilającej, którą należy podłączyć do napędu optycznego podczas montażu komputera.

Które z poniższych stwierdzeń na temat protokołu DHCP jest poprawne?

Aby serwerowa płyta główna mogła działać poprawnie, potrzebuje pamięci z rejestrem. Który z poniższych modułów pamięci będzie z nią zgodny?

Określ rezultat wykonania zamieszczonego polecenia

| net user Test /expires:12/09/20 |

Aby zobaczyć datę w systemie Linux, można skorzystać z komendy

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue press DEL to setup. Naciśnięcie klawisza DEL spowoduje

Który z podanych adresów IP należy do klasy A?

Wykonanie komendy NET USER GRACZ * /ADD w wierszu poleceń systemu Windows spowoduje

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Tester strukturalnego okablowania umożliwia weryfikację

Do jakich celów powinno się aktywować funkcję RMON (Remote Network Monitoring) w przełączniku?

W jakiej usłudze wykorzystywany jest protokół RDP?

W systemie Linux komendą, która jednocześnie podnosi uprawnienia dla procesu uruchamianego z terminala, jest

W jakich jednostkach opisuje się przesłuch zbliżny NEXT?

Jakim interfejsem można osiągnąć przesył danych o maksymalnej przepustowości 6Gb/s?

Aby chronić konto użytkownika przed nieautoryzowanymi zmianami w systemie Windows 7, 8 lub 10, które wymagają uprawnień administratora, należy ustawić

Nie wykorzystuje się do zdalnego kierowania stacjami roboczymi

W doborze zasilacza do komputera kluczowe znaczenie

EN IEC 60276:2019 to przykład oznaczenia normy