Pytanie 1

Według normy PN-EN 50174 maksymalna długość trasy kabla poziomego kategorii 6 pomiędzy punktem abonenckim a punktem rozdzielczym w panelu krosowym wynosi

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Według normy PN-EN 50174 maksymalna długość trasy kabla poziomego kategorii 6 pomiędzy punktem abonenckim a punktem rozdzielczym w panelu krosowym wynosi

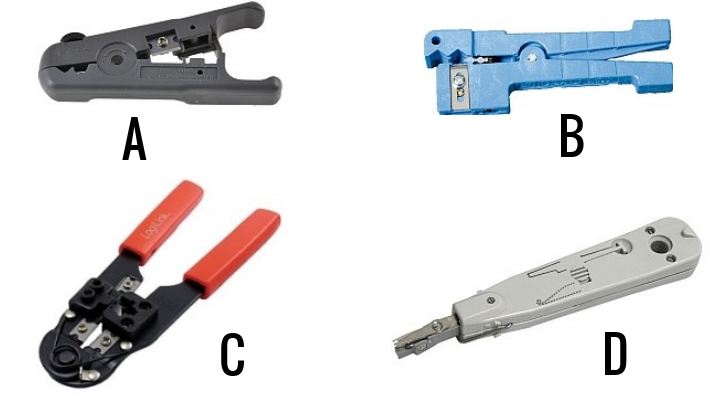

Jakie narzędzie wykorzystuje się do przytwierdzania kabla w module Keystone?

Jaka liczba hostów może być podłączona w sieci o adresie 192.168.1.128/29?

Rysunek obrazuje zasadę działania drukarki

Najefektywniejszym zabezpieczeniem danych firmy, której siedziby znajdują się w różnych, odległych od siebie lokalizacjach, jest zastosowanie

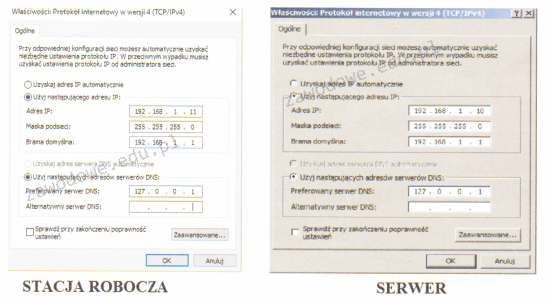

Na rysunku widać ustawienia protokołu TCP/IP serwera oraz komputera roboczego. Na serwerze działa rola serwera DNS. Wykonanie polecenia ping www.cke.edu.pl na serwerze zwraca wynik pozytywny, natomiast na stacji roboczej wynik jest negatywny. Co należy zmienić, aby usługa DNS na stacji pracowała poprawnie?

Skrypt o nazwie wykonaj w systemie Linux zawiera: echo -n "To jest pewien parametr " echo $? Wykonanie poleceń znajdujących się w pliku spowoduje wyświetlenie podanego tekstu oraz

Granice dla obszaru kolizyjnego nie są określane przez porty urządzeń takich jak

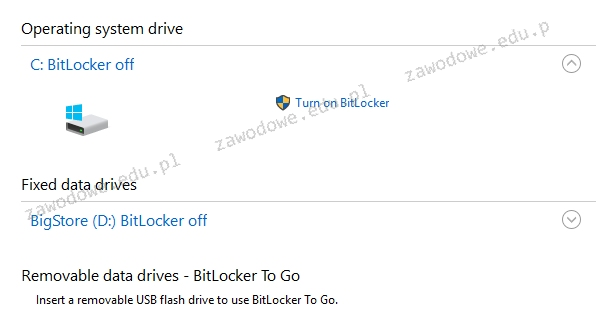

Prezentowane wbudowane narzędzie systemów Windows w wersji Enterprise lub Ultimate jest przeznaczone do

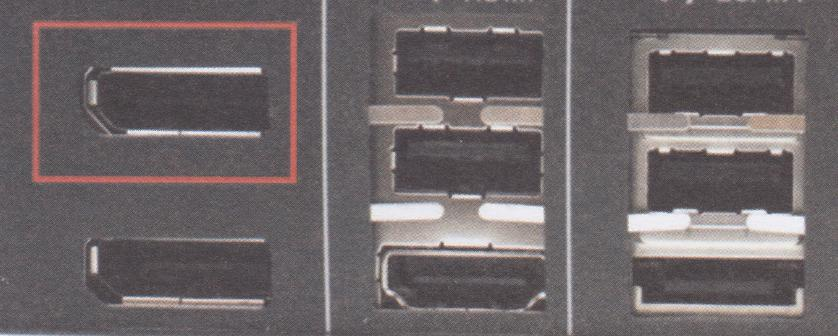

Na ilustracji, złącze monitora zaznaczone czerwoną ramką, będzie kompatybilne z płytą główną, która ma interfejs

Przedstawiony panel tylny płyty głównej jest wyposażony między innymi w interfejsy:

Relacja między ładunkiem zmagazynowanym na przewodniku a potencjałem tego przewodnika wskazuje na jego

Licencja obejmująca oprogramowanie układowe, umieszczone na stałe w sprzętowej części systemu komputerowego, to

Narzędzie systemu Windows wykorzystywane do interpretacji poleceń, stosujące logikę obiektową oraz cmdlety, to

Jakie medium transmisyjne powinno być użyte do połączenia dwóch punktów dystrybucyjnych oddalonych od siebie o 600m?

Jakie złącze jest potrzebne do podłączenia zasilania do CD-ROM?

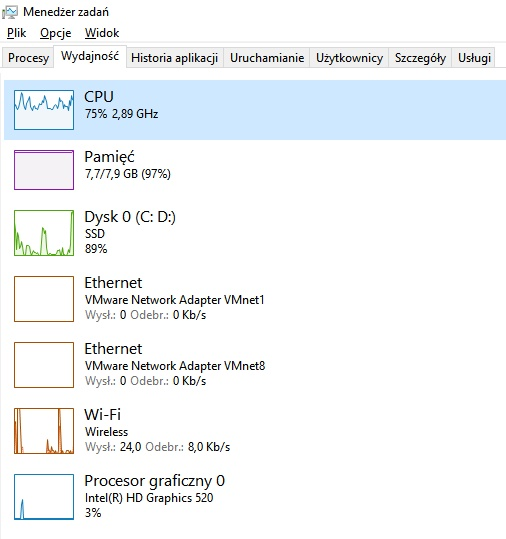

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Magistrala PCI-Express do przesyłania danych stosuje metodę komunikacyjną

Urządzenie sieciowe nazywane mostem (ang. bridge) to:

W systemie Linux komenda tty pozwala na

Jakiego typu tablicę partycji trzeba wybrać, aby stworzyć partycję o pojemności 3TB na dysku twardym?

Układ cyfrowy wykonujący operację logiczną koniunkcji opiera się na bramce logicznej

W załączonej ramce przedstawiono opis technologii

| Technologia ta to rewolucyjna i nowatorska platforma, która pozwala na inteligentne skalowanie wydajności podsystemu graficznego poprzez łączenie mocy kilku kart graficznych NVIDIA pracujących na płycie głównej. Dzięki wykorzystaniu zastrzeżonych algorytmów oraz wbudowanej w każdy z procesorów graficznych NVIDIA dedykowanej logiki sterującej, która odpowiada za skalowanie wydajności, technologia ta zapewnia do 2 razy (w przypadku dwóch kart) lub 2,8 razy (w przypadku trzech kart) wyższą wydajność niż w przypadku korzystania z pojedynczej karty graficznej. |

Jakie narzędzie w systemie Windows pozwala na kontrolowanie stanu sprzętu, aktualizowanie sterowników oraz rozwiązywanie problemów z urządzeniami?

Narzędzie używane do przechwytywania oraz analizy danych przesyłanych w sieci, to

Jaka jest maska dla adresu IP 192.168.1.10/8?

W specyfikacji technicznej płyty głównej znajduje się zapis Supports up to Athlon XP 3000+ processor. Co to oznacza w kontekście obsługi procesorów przez tę płytę główną?

Partycja, na której zainstalowany jest system operacyjny, określana jest jako partycja

Jakie urządzenie powinno być użyte do połączenia komputerów w układzie gwiazdowym?

Drukarka została zainstalowana w systemie Windows. Aby ustawić między innymi domyślną orientację wydruku, liczbę stron na arkusz oraz kolorystykę, podczas jej konfiguracji należy skorzystać z opcji

Industry Standard Architecture to norma magistrali, według której szerokość szyny danych wynosi

Na ilustracji widoczne jest urządzenie służące do

Rozmiar pliku wynosi 2 KiB. Co to oznacza?

Mamy do czynienia z siecią o adresie 192.168.100.0/24. Ile podsieci można utworzyć, stosując maskę 255.255.255.224?

Jakie narzędzie wykorzystuje się do połączenia pigtaila z włóknami światłowodowymi?

Który z symboli wskazuje na zastrzeżenie praw autorskich?

Na podstawie zaprezentowanego cennika oblicz, jaki będzie całkowity koszt jednego dwumodułowego podwójnego gniazda abonenckiego montowanego na powierzchni.

| Lp. | Nazwa | j.m. | Cena jednostkowa brutto |

|---|---|---|---|

| 1. | Puszka natynkowa 45x45 mm dwumodułowa | szt. | 4,00 zł |

| 2. | Ramka + suport 45x45 mm dwumodułowa | szt. | 4,00 zł |

| 3. | Adapter 22,5x45 mm do modułu keystone | szt. | 3,00 zł |

| 4. | Moduł keystone RJ45 kategorii 5e | szt. | 7,00 zł |

Narzędzie, które chroni przed nieautoryzowanym dostępem do sieci lokalnej, to

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?