Pytanie 1

Podanie nieprawidłowych napięć do płyty głównej może skutkować

Wynik: 31/40 punktów (77,5%)

Wymagane minimum: 20 punktów (50%)

Podanie nieprawidłowych napięć do płyty głównej może skutkować

Czym jest licencja OEM?

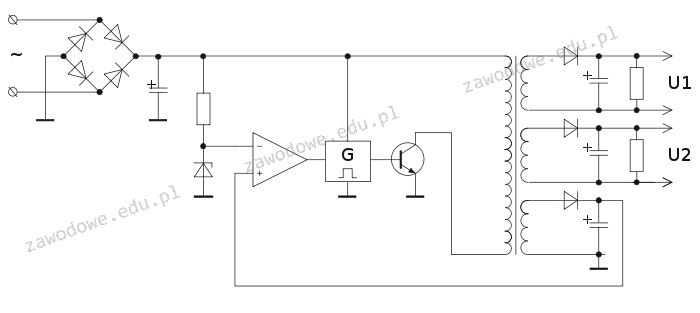

Na rysunku ukazano diagram

Funkcja diff w systemie Linux pozwala na

Jakie jest nominalne wyjście mocy (ciągłe) zasilacza o parametrach przedstawionych w tabeli?

| Napięcie wyjściowe | +5 V | +3.3 V | +12 V1 | +12 V2 | -12 V | +5 VSB |

|---|---|---|---|---|---|---|

| Prąd wyjściowy | 18,0 A | 22,0 A | 18,0 A | 17,0 A | 0,3 A | 2,5 A |

| Moc wyjściowa | 120 W | 336 W | 3,6 W | 12,5 W |

Wydruk z drukarki igłowej realizowany jest z zastosowaniem zestawu stalowych igieł w liczbie

Na ilustracji ukazano złącze zasilające

Na nowym urządzeniu komputerowym program antywirusowy powinien zostać zainstalowany

Zjawisko crosstalk, które występuje w sieciach komputerowych, polega na

Wskaż nośnik, który w sieciach komputerowych umożliwia najszybszą wymianę danych?

W systemie Windows Professional aby ustawić czas dostępności dla drukarki, należy skorzystać z zakładki

Komputer zarejestrowany w domenie Active Directory nie ma możliwości połączenia się z kontrolerem domeny, na którym znajduje się profil użytkownika. Jaki rodzaj profilu użytkownika zostanie utworzony na tym urządzeniu?

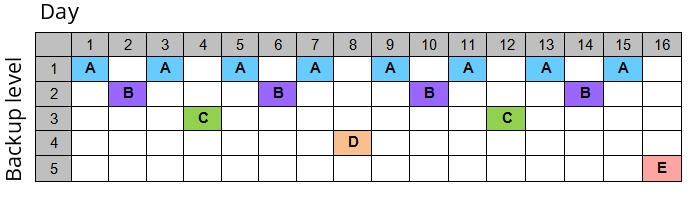

Strategia przedstawiona w diagramie dla tworzenia kopii zapasowych na nośnikach jest znana jako

Kondygnacyjny punkt dystrybucji jest połączony z

Kluczowe znaczenie przy tworzeniu stacji roboczej, na której ma funkcjonować wiele maszyn wirtualnych, ma:

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakim protokołem komunikacyjnym w warstwie transportowej, który zapewnia niezawodność przesyłania pakietów, jest protokół

Program iftop działający w systemie Linux ma na celu

Jakie polecenie w systemie Linux rozpoczyna weryfikację dysku oraz pozwala na usunięcie jego usterek?

Polecenie grep w systemie Linux pozwala na

Która norma w Polsce definiuje zasady dotyczące okablowania strukturalnego?

Jaki protokół jest stosowany do przesyłania danych w warstwie transportowej modelu ISO/OSI?

Pamięć oznaczona jako PC3200 nie jest kompatybilna z magistralą

To narzędzie może być wykorzystane do

Jakie polecenie służy do przeprowadzania aktualizacji systemu operacyjnego Linux korzystającego z baz RPM?

Jaką minimalną ilość pamięci RAM powinien mieć komputer, aby zainstalować 32-bitowy system operacyjny Windows 7 i móc efektywnie korzystać z trybu graficznego?

Granice domeny kolizyjnej nie są określane przez porty takich urządzeń jak

Jakie oprogramowanie jest używane do archiwizacji danych w systemie Linux?

Zarządzanie pasmem (ang. bandwidth control) w switchu to funkcjonalność

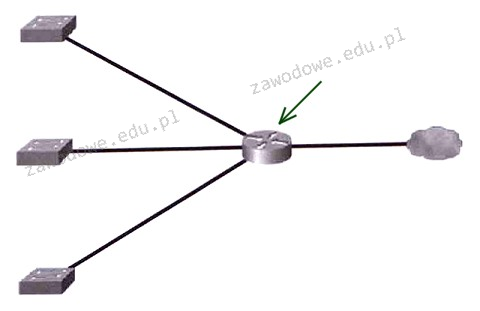

Jaki symbol urządzenia jest pokazany przez strzałkę na rysunku?

Obudowa oraz wyświetlacz drukarki fotograficznej są mocno zabrudzone. Jakie środki należy zastosować, aby je oczyścić bez ryzyka uszkodzenia?

Który z wymienionych parametrów procesora AMD APU A10 5700 3400 nie ma bezpośredniego wpływu na jego wydajność?

| Częstotliwość | 3400 MHz |

| Proces technologiczny | 32 nm |

| Architektura | 64 bit |

| Ilość rdzeni | 4 |

| Ilość wątków | 4 |

| Pojemność pamięci L1 (instrukcje) | 2x64 kB |

| Pojemność pamięci L1 (dane) | 4x16 kB |

| Pojemność Pamięci L2 | 2x2 MB |

Aby w systemie Linux wykonać kopię zapasową określonych plików, należy wprowadzić w terminalu polecenie programu

Wykonanie na komputerze z systemem Windows poleceń ipconfig /release oraz ipconfig /renew umożliwia weryfikację, czy usługa w sieci działa poprawnie

Karta rozszerzeń przedstawiona na zdjęciu dysponuje systemem chłodzenia

Sprzętem, który umożliwia wycinanie wzorów oraz grawerowanie w różnych materiałach, takich jak drewno, szkło i metal, jest ploter

Jaką rolę należy przypisać serwerowi z rodziny Windows Server, aby mógł świadczyć usługi rutingu?

Konwencja zapisu ścieżki do udziału sieciowego zgodna z UNC (Universal Naming Convention) ma postać

Sprzęt, na którym można skonfigurować sieć VLAN, to

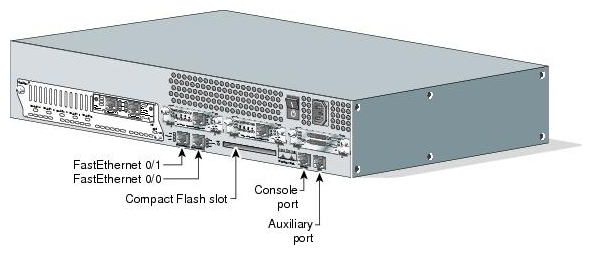

Urządzenie sieciowe, które widoczna jest na ilustracji, to