Pytanie 1

Aby poprawić niezawodność i efektywność przesyłu danych na serwerze, należy

Wynik: 10/40 punktów (25,0%)

Wymagane minimum: 20 punktów (50%)

Aby poprawić niezawodność i efektywność przesyłu danych na serwerze, należy

Usterka zaprezentowana na ilustracji, widoczna na monitorze, nie może być spowodowana przez

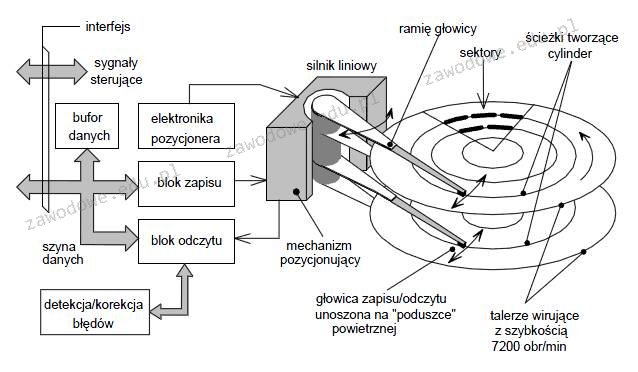

Schemat blokowy ilustruje

W systemie Windows przypadkowo zlikwidowano konto użytkownika, lecz katalog domowy pozostał nietknięty. Czy możliwe jest odzyskanie nieszyfrowanych danych z katalogu domowego tego użytkownika?

Połączenia typu point-to-point, realizowane za pośrednictwem publicznej infrastruktury telekomunikacyjnej, oznacza się skrótem

Zasada dostępu do medium CSMA/CA jest wykorzystywana w sieci o specyfikacji

Urządzenie typu Plug and Play, które jest ponownie podłączane do komputera, jest identyfikowane na podstawie

Wtyczka zasilająca SATA ma uszkodzony żółty przewód. Jakie to niesie za sobą konsekwencje dla napięcia na złączu?

Użytkownik systemu Windows wybrał opcję powrót do punktu przywracania. Które pliki powstałe po wybranym punkcie nie zostaną naruszone przez tę akcję?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Urządzenie elektryczne lub elektroniczne, które zostało zużyte i posiada znak widoczny na ilustracji, powinno być

Ile hostów można zaadresować w sieci o adresie 172.16.3.96/28?

Aby możliwe było zorganizowanie pracy w wydzielonych logicznie mniejszych podsieciach w sieci komputerowej, należy ustawić w przełączniku

Urządzenie sieciowe działające w drugiej warstwie modelu OSI, które przesyła sygnał do portu połączonego z urządzeniem odbierającym dane na podstawie analizy adresów MAC nadawcy i odbiorcy, to

Komputer A, który musi wysłać dane do komputera B znajdującego się w sieci z innym adresem IP, najpierw przekazuje pakiety do adresu IP

Aby zmierzyć tłumienie łącza światłowodowego w dwóch zakresach transmisyjnych 1310nm oraz 1550nm, powinno się zastosować

Aby stworzyć archiwum danych w systemie operacyjnym Ubuntu, należy użyć programu

Nie jest możliwe wykonywanie okresowych kopii zapasowych dysków serwera na nośnikach wymiennych typu

System operacyjny został poddany atakowi przez oprogramowanie szpiegujące. Po usunięciu problemów, aby zapobiec przyszłym atakom, należy

Aby wyświetlić przedstawioną informację o systemie Linux w terminalu, należy użyć polecenia

To narzędzie może być wykorzystane do

Przedstawione na ilustracji narzędzie służy do

Taśma drukarska stanowi kluczowy materiał eksploatacyjny w przypadku drukarki

W celu zapewnienia jakości usługi QoS, w przełącznikach warstwy dostępu stosowany jest mechanizm

Co oznacza zapis 192.168.1/24 w kontekście maski podsieci?

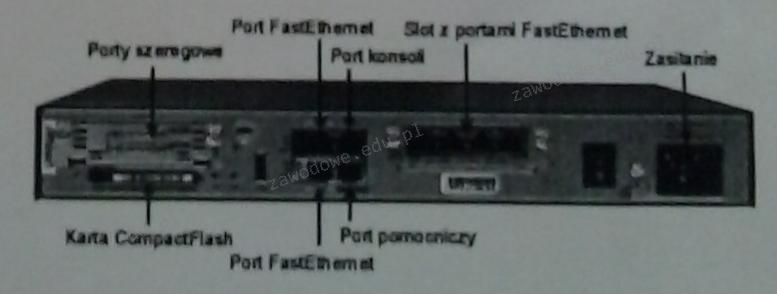

Na ilustracji przedstawiono urządzenie sieciowe, którym jest

Jak nazywa się protokół oparty na architekturze klient-serwer oraz modelu żądanie-odpowiedź, wykorzystywany do przesyłania plików?

Która przystawka MMC systemu Windows umożliwia przegląd systemowego Dziennika zdarzeń?

Aby system operacyjny mógł szybciej uzyskiwać dostęp do plików zapisanych na dysku twardym, konieczne jest wykonanie

Przedmiot widoczny na ilustracji to

Nośniki informacji, takie jak dysk twardy, gromadzą dane w jednostkach określanych jako sektory, których rozmiar wynosi

Jakim portem domyślnie odbywa się przesyłanie poleceń (command) serwera FTP?

W oznaczeniu procesora INTEL CORE i7-4790 liczba 4 wskazuje na

Jakie urządzenie wskazujące działa w reakcji na zmiany pojemności elektrycznej?

W systemie Windows do instalacji aktualizacji oraz przywracania sterowników urządzeń należy użyć przystawki

Który z systemów operacyjnych przeznaczonych do sieci jest dostępny na zasadach licencji GNU?

Zastosowanie programu firewall ma na celu ochronę

Na komputerze z zainstalowanymi systemami operacyjnymi Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows, drugi system przestaje się uruchamiać. Aby przywrócić możliwość uruchamiania systemu Linux oraz zachować dane i ustawienia w nim zgromadzone, co należy zrobić?

Jaką postać ma liczba dziesiętna 512 w systemie binarnym?

Jaką rolę pełni usługa NAT działająca na ruterze?