Pytanie 1

Ile maksymalnie podstawowych partycji możemy stworzyć na dysku twardym używając MBR?

Wynik: 14/40 punktów (35,0%)

Wymagane minimum: 20 punktów (50%)

Ile maksymalnie podstawowych partycji możemy stworzyć na dysku twardym używając MBR?

Jaki typ plików powinien być stworzony w systemie operacyjnym, aby zautomatyzować najczęściej wykonywane zadania, takie jak kopiowanie, utworzenie pliku lub folderu?

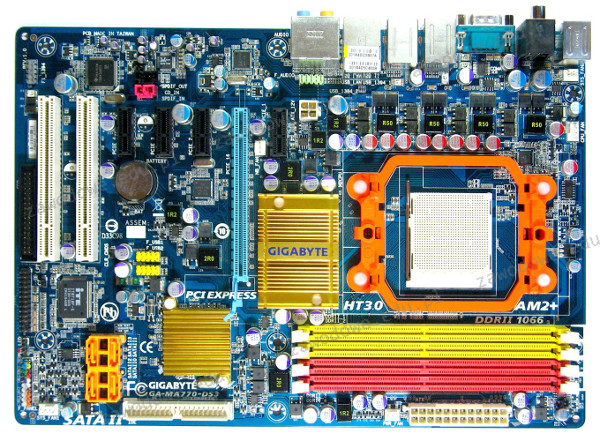

Jakie złącze umożliwia przesył danych między przedstawioną na ilustracji płytą główną a urządzeniem zewnętrznym, nie dostarczając jednocześnie zasilania do tego urządzenia przez interfejs?

Do przechowywania fragmentów dużych plików programów i danych, które nie mieszczą się w pamięci, wykorzystuje się

Programem w systemie Linux, który umożliwia nadzorowanie systemu za pomocą zcentralizowanego mechanizmu, jest narzędzie

Użytkownik planuje instalację 32-bitowego systemu operacyjnego Windows 7. Jaka jest minimalna ilość pamięci RAM, którą powinien mieć komputer, aby system mógł działać w trybie graficznym?

W systemie Ubuntu, które polecenie umożliwia bieżące monitorowanie działających procesów i aplikacji?

Czym wyróżniają się procesory CISC?

Poprawę jakości skanowania można osiągnąć poprzez zmianę

Który interfejs pozwala na korzystanie ze sterowników oraz oprogramowania systemu operacyjnego, umożliwiając m.in. przesył danych pomiędzy pamięcią systemową a dyskiem SATA?

Który z wymienionych formatów płyt głównych charakteryzuje się najmniejszymi wymiarami?

Jakie protokoły są właściwe dla warstwy internetowej w modelu TCP/IP?

Jednym ze sposobów na ograniczenie dostępu do sieci bezprzewodowej dla nieuprawnionych osób jest

Zgodnie z normą PN-EN 50174, poziome okablowanie w systemie strukturalnym to segment okablowania pomiędzy

Samodzielną strukturą sieci WLAN jest

W systemach Windows, aby określić, w którym miejscu w sieci zatrzymał się pakiet, stosuje się komendę

Zachowanie kopii często odwiedzanych witryn oraz zwiększenie ochrony przez filtrowanie pewnych treści witryn internetowych można osiągnąć dzięki

Brak odpowiedzi na to pytanie.

Jakie polecenie powinien wydać root w systemie Ubuntu Linux, aby przeprowadzić aktualizację wszystkich pakietów (całego systemu) do najnowszej wersji z zainstalowaniem nowego jądra?

W systemie Linux program, który odpowiada aplikacji chkdsk z Windows, to

Narzędziem do zarządzania usługami katalogowymi w systemach Windows Server, które umożliwia przeniesienie komputerów do jednostki organizacyjnej wskazanej przez administratora, jest polecenie

Wskaź zestaw do diagnostyki logicznych układów elektronicznych umiejscowionych na płycie głównej komputera, który nie reaguje na próby uruchomienia zasilania?

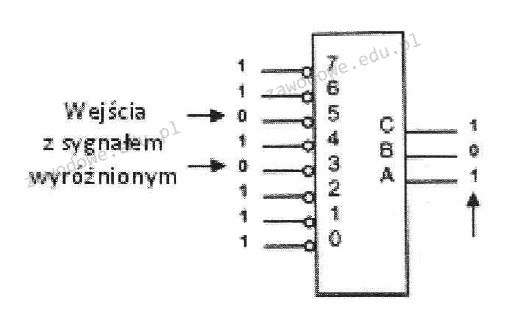

Na ilustracji przedstawiono symbol urządzenia cyfrowego

Jak nazywa się pamięć podręczna?

Port AGP służy do łączenia

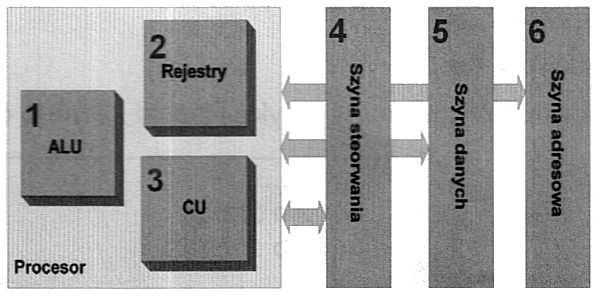

Na diagramie element odpowiedzialny za dekodowanie poleceń jest oznaczony liczbą

Które medium transmisyjne umożliwia izolację galwaniczną pomiędzy systemami przesyłu danych?

Jan, użytkownik, nie ma możliwości zmiany właściciela drukarki w systemie Windows. Aby zyskał taką opcję, konieczne jest nadanie mu w ustawieniach zabezpieczeń prawa do

Z analizy oznaczenia pamięci DDR3 PC3-16000 można wywnioskować, że ta pamięć:

Farad to jednostka

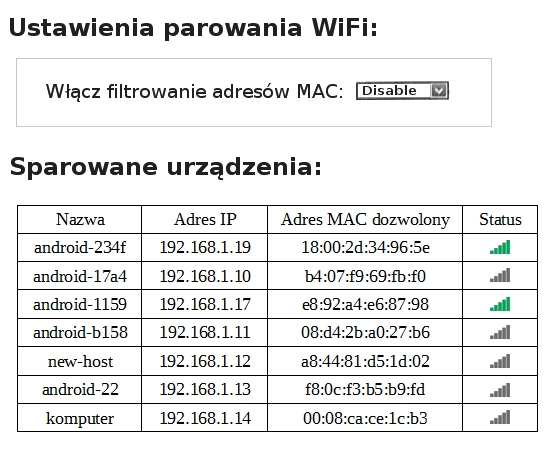

Na rysunku przedstawiono konfigurację urządzenia WiFi. Wskaż, które z poniższych stwierdzeń dotyczących tej konfiguracji jest poprawne?

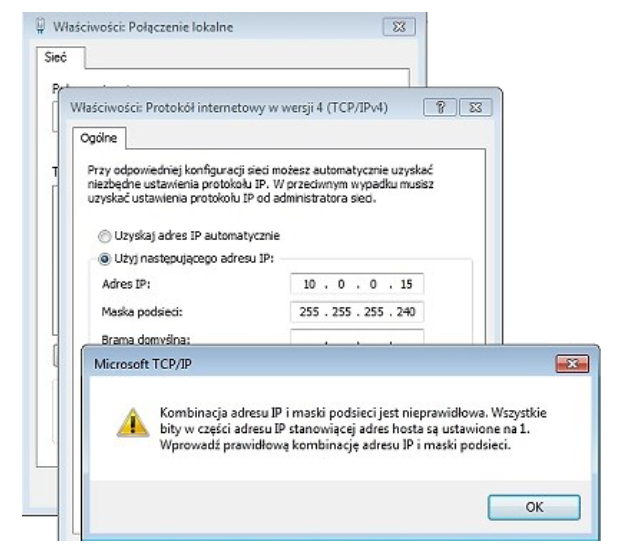

Na ilustracji widoczny jest komunikat, który pojawia się po wprowadzeniu adresu IP podczas ustawiania połączenia sieciowego na komputerze. Adres IP podany przez administratora to adres IP

Trzech użytkowników komputera z systemem operacyjnym Windows XP Pro posiada swoje foldery z dokumentami w głównym katalogu dysku C:. Na dysku znajduje się system plików NTFS. Użytkownicy mają utworzone konta z ograniczonymi uprawnieniami. Jak można zabezpieczyć folder każdego z użytkowników, aby inni nie mieli możliwości modyfikacji jego zawartości?

Który system plików powinien być wybrany podczas instalacji Linuxa, aby umożliwić ustalanie uprawnień dla plików i katalogów?

Tworzenie zaszyfrowanych połączeń pomiędzy hostami przez publiczną sieć Internet, wykorzystywane w rozwiązaniach VPN (Virtual Private Network), to

Emisja przez BIOS firmy AMI jednego długiego oraz dwóch krótkich sygnałów dźwiękowych oznacza

Do czego służy polecenie 'ping' w systemie operacyjnym?

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

Złocenie styków złącz HDMI ma na celu

Rozkaz procesora, przetwarzający informację i zamieniający ją na wynik, należy do grupy rozkazów

Aby serwer z systemem Linux mógł udostępniać pliki i drukarki komputerom klienckim z systemem Windows, należy zainstalować na nim