Pytanie 1

Metoda diagnostyczna, w której rejestruje się rozpad radioizotopu wprowadzonego do organizmu, to

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Metoda diagnostyczna, w której rejestruje się rozpad radioizotopu wprowadzonego do organizmu, to

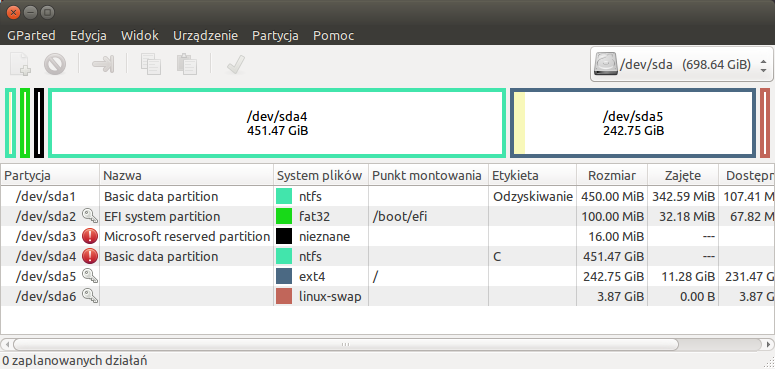

Ile dysków i z jakim interfejsem zostało wykazanych na zrzucie programu GParted?

Które urządzenie medyczne wspomaga lub zastępuje mięśnie pacjenta w oddychaniu?

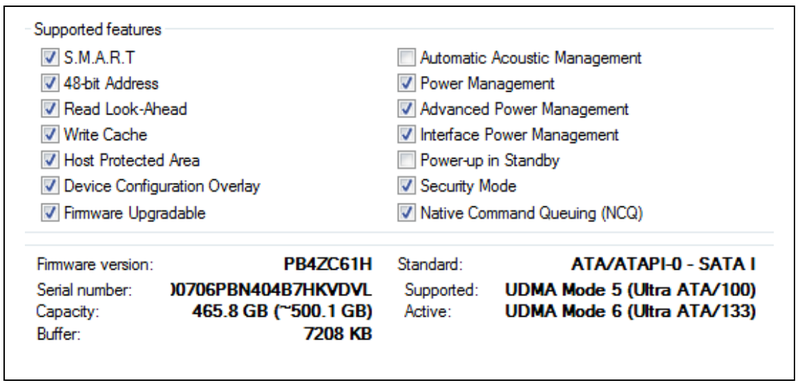

Urządzenie, którego dotyczy fragment podanej specyfikacji, jest przystosowane do

| ■ Architektura sieci LAN: | Wireless IEEE 802.11ac, Wireless IEEE 802.11a, Wireless IEEE 802.11b, Wireless IEEE 802.11g, Wireless IEEE 802.11n |

| ■ Dodatkowe informacje: | PoE, RJ-45 Serial |

| ■ Typ urządzenia: | Bezprzewodowy kontroler |

| ■ Typ złącza anteny zewnętrznej: | 3x3 MIMO |

Na zdjęciu RTG najjaśniejsze pole stanowi tkanka kostna, przez którą promieniowanie rentgenowskie jest

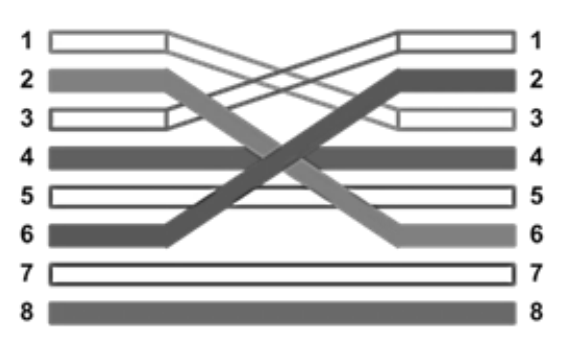

Przedstawiony na rysunku kabel krosowany jest wykorzystany do połączenia

Przedstawiony zrzut ekranu prezentuje parametry

Aby dodać nowe konto „rejestracja” w systemie Windows, należy wykorzystać polecenie

Sterowniki klawiatury, magistral i przerwań są elementami

Który system montażu urządzeń przedstawiono na rysunku?

Na rysunku przedstawiono przyrząd, którym przeprowadza się test i kontrolę

W jakim celu stosuje się Standard HL7 (Health Level Seven)?

W celu archiwizacji danych w systemie Windows, jest wymagane kopiowanie z katalogu źródłowego (kat_zrodlowy) do katalogu docelowego (kat_docelowy). Do kopiowania danych należy użyć polecenia

Który system plików pozwala na szyfrowanie danych w systemie Windows?

Który system bazodanowy uniemożliwia bezpłatne zastosowanie komercyjne?

Które polecenie SQL pozwoli na utworzenie tabeli pacjentów w bazie przychodnia?

Zaćma fotochemiczna jest wywołana promieniowaniem

Ilość jodu-131 podana pacjentowi w terapii tarczycy zmniejszy się o połowę po

Membrana półprzepuszczalna jest podstawowym elementem

Dla której wartości z wymienionych rezystancji, zastosowanie układu poprawnie mierzonego prądu zapewnia najmniejszy błąd pomiaru?

Którą metodę montażu należy zastosować w celu zakończenia przewodu zasilającego końcówkami przedstawionymi na fotografii?

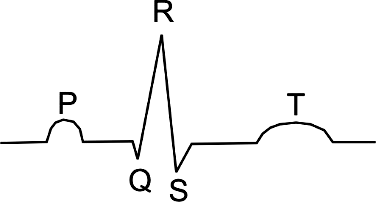

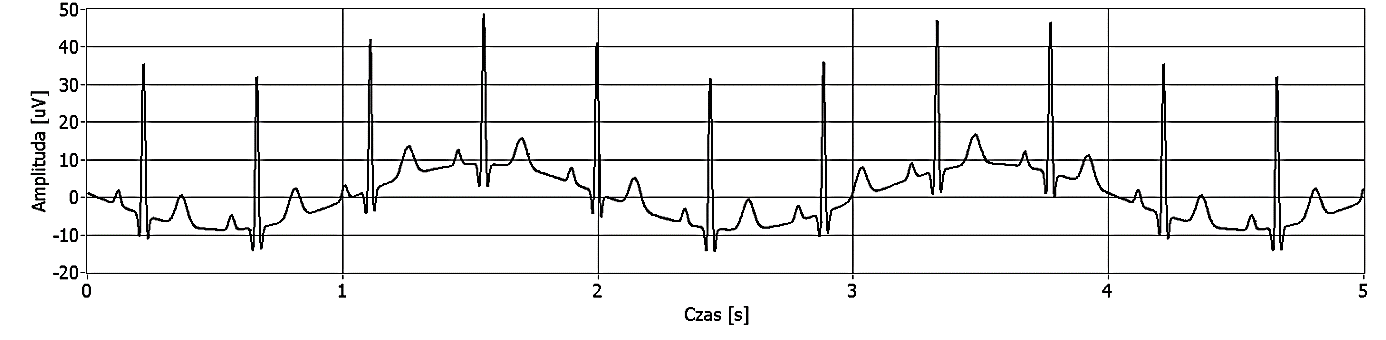

Podczas testowania elektrokardiografu otrzymano przedstawiony przebieg. Na jego podstawie stwierdzono, że nieprawidłowo działa filtr zakłóceń

Aby zapobiec utracie danych w programie obsługi przychodni, należy codziennie wykonywać

W programowaniu obiektowym zmienne widoczne w ramach klasy oraz poza nią nazywane są

Jaki format danych należy zastosować do archiwizacji, kompresji i szyfrowania danych?

Przedstawione na rysunku i opisane w ramce narzędzie służy do ściągania izolacji

| Stripper posiada trzy otwory. Pierwszy pozwala na ściągnięcie płaszcza 250 μm do 125 μm. Drugi otwór przeznaczony jest do ściągania powłoki 900 μm do płaszcza o średnicy 250 μm. Trzeci służy do ściągania powłoki z kabli o średnicy 2 mm ÷ 3 mm do ścisłej tuby o średnicy 900 μm. |

Katalog /dev w Linuxie zawiera pliki

W tabeli przedstawiono fragment dokumentacji testera

| Zakres | ±500 mm Hg 20 °C |

| Dokładność | ±1% odczytu + 0.5 mm Hg) |

| Zakres | 80, 94 bpm (synch. z EKG) |

| Dokładność sygnału | ±1% |

| Inwazyjne: | |

| Statyczne ciśnienie | -10, -5, 0, 20, 40, 50, 60, 80, 100, 150, 160, 200, 240, 250, 300, 320, 400 mm Hg |

| Dokładność | ±(1% zakresu ±1mm Hg) or ±(2% nastawy + 2mm Hg) |

| Impedancja | 300 Ohm (±10% dokładności) |

| Czułość | 5 do 40 μV/V/mm Hg |

Jaki powinien być ustawiony adres maski podsieci, aby umożliwiał podłączenie maksymalnie 30 urządzeń?

Pojedynczy zapis w medycznej bazie danych, zawierający informację na temat jednego pacjenta, nazywa się

| id | imię | nazwisko | adres |

|---|---|---|---|

| 2354 | Konrad | Marek | ul. Kwiatowa15 Krzywodrogi |

| 2355 | Jakub | Warek | ul. Leśna 23 Krzywodrogi |

| 2356 | Krzysztof | Jurek | ul. Polna 14 Krzywodrogi |

W celu wyszukania błędów w programie wykorzystuje się

W opisanym programie zostaną wykonane 4

for (i=0;i<=3;i++) suma=suma+i; |

Która tkanka najsilniej pochłania fale ultradźwiękowe?

Wybierz narzędzie służące do zamocowania przedstawionej na rysunku końcówki kompresyjnej F na kablu koncentrycznym.

Jak nazywa się terapia stosowana w przypadku niewydolności nerek, polegająca na oczyszczaniu krwi ze zbędnych składników przemiany materii?

Pod wpływem bodźca świetlnego, dźwiękowego lub czuciowego mózg generuje elektryczne potencjały wywołane rejestrowane przez

Z przedstawionego zrzutu wynika, że na dyskach zastosowano partycjonowanie

Który aparat, za pomocą poleceń głosowych i wizualnych, prowadzi ratownika przez procedurę bezpiecznej defibrylacji w zatrzymaniu krążenia?

Aby zainstalować brakujące oprogramowanie w systemie z rodziny Linux należy wykorzystać polecenie

W sygnale elektrokardiograficznym za repolaryzację mięśnia komór odpowiada załamek