Pytanie 1

W celu podłączenia monitora do systemu wizualizacji obrazów wymagany jest interfejs Display Port. Ile takich interfejsów posiada karta graficzna przedstawiona na rysunku?

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

W celu podłączenia monitora do systemu wizualizacji obrazów wymagany jest interfejs Display Port. Ile takich interfejsów posiada karta graficzna przedstawiona na rysunku?

Wysłanie obrazów z urządzenia diagnostycznego do serwera PACS odbywa się zgodnie ze standardem

Które urządzenie medyczne wspomaga lub zastępuje mięśnie pacjenta w oddychaniu?

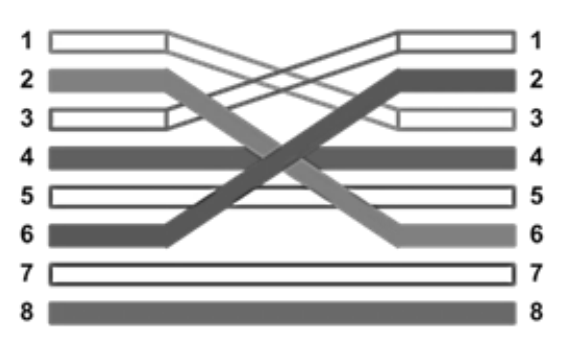

Przedstawiony na rysunku kabel krosowany jest wykorzystany do połączenia

Brak odpowiedzi na to pytanie.

Zestaw przedstawiony na rysunku przeznaczony jest do przeprowadzania testu aparatu

Który zasilacz pozwala na tymczasowe utrzymanie zasilania akumulatorowego w razie braku zasilania sieciowego?

W dokumentacji elektrokardiografu znajduje się informacja o wyposażeniu aparatu w filtry cyfrowe 50 Hz, 35 Hz i filtr antydriftowy. Które zakłócenia eliminuje z sygnału EKG filtr 50 Hz?

Największą zdolność pochłaniania promieniowania rentgenowskiego o energii 60–160 keV wykazuje tkanka

Procesor GPU jest odpowiedzialny za wykonywanie operacji obliczeniowych w karcie

Prezentacja A, B, M jest charakterystyczna dla badania

Czujnik tensometryczny i sonda ultradźwiękowa są elementami aparatu

Brak odpowiedzi na to pytanie.

Ile elektrod wykorzystuje się podczas wykonywania standardowego badania EKG przy pomocy 12 odprowadzeń?

Technologie SLI i CrossFire pozwalają na podłączenie dwóch kart

Do kruszenia kamieni w pęcherzu moczowym stosowane są fale

Aby usunąć katalog w systemie Windows należy wykonać polecenie

Zaćma fotochemiczna jest wywoływana promieniowaniem

Na którym rysunku przedstawiony jest interfejs zapewniający najwyższą prędkość transferu urządzeń elektroniki medycznej?

Które oznaczenie określa zapis elektryczny aktywności mózgu?

Rysunek przedstawia wynik działania polecenia ipconfig urządzenia w sieci LAN. Który adres rutera umożliwia dostęp tego urządzenia do sieci WAN?

Zapis w dokumentacji kardiotokografu „prezentacja sygnału FHR” dotyczy

Na rysunku przedstawiono przyrząd, którym przeprowadza się test i kontrolę

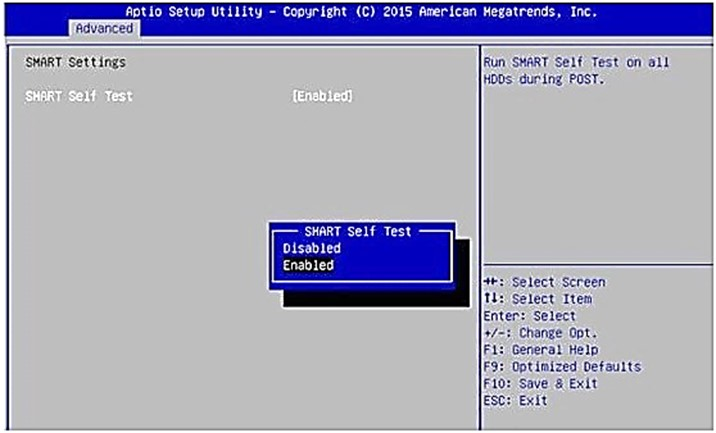

Jaką funkcję pełni przedstawiona na rysunku procedura BIOS?

Który rozdzielacz sygnału należy zastosować w celu wykorzystania jednego przewodu U/UTP5e do podłączenia dwóch urządzeń do sieci LAN?

Która magistrala służy do szeregowej transmisji danych?

Aby dodać nowe konto „rejestracja” w systemie Windows, należy wykorzystać polecenie

Brak odpowiedzi na to pytanie.

Z przedstawionej dokumentacji pamięci wynika że jest ona przeznaczona do

rodzaj pamięci : SO-DIMM standard : DDR3-1333 (PC3-10600) pojemność pojedynczego modułu : 4 GB |

Które polecenie SQL pozwoli na utworzenie tabeli pacjentów w bazie przychodnia?

W systemie bazodanowym wymagane jest dodatkowe sprzętowe zabezpieczenie danych przed ich utratą. Która macierz dyskowa pozwala uodpornić się na utratę danych w przypadku awarii wszystkich dysków poza jednym?

Brak odpowiedzi na to pytanie.

Dla sieci o adresie 192.150.160.0/26 pula adresów IP dla urządzeń w tej sieci zawiera się w zakresie

Zjawisko polegające na zmianie częstotliwości fali odbitej od poruszającego się obiektu jest wykorzystywane w

W jakim celu stosuje się Standard HL7 (Health Level Seven)?

Dla której wartości z wymienionych rezystancji, zastosowanie układu poprawnie mierzonego prądu zapewnia najmniejszy błąd pomiaru?

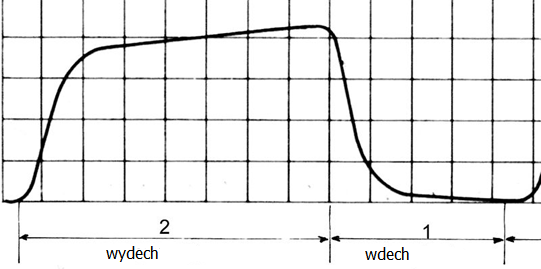

Stężenie którego gazu z wydychanego powietrza prezentuje kapnogram?

Które ustawienie należy wybrać na multimetrze w celu pomiaru napięcia 12 V w obwodzie prądu stałego?

Który system montażu urządzeń przedstawiono na rysunku?

Znak ~ na początku ciągu znaków w systemach uniksowych oznacza

Jakie jest przeznaczenie drukarki, której dotyczy zamieszczony fragment specyfikacji?

| Głowica drukująca | 24-igłowa |

| Średnica przewodu | 0,2 mm |

| Kierunek druku | Dwukierunkowe/bezkierunkowe drukowanie |

| Rozdzielczość grafiki | Maks. 360 (wys.) x 360 (szer.) dpi |

| Szybkość drukowania | High Speed Draft: 607 znaków/s, tryb Utility: 485 znaków/s, tryb Near Letter Quality: 245 znaków/s, Letter Quality: 165 znaków/s |

| Gęstość przesunięć wierszy | 4,23 mm (1/6"), 3,18 mm (1/8"), n x 0,42 mm (m/60") (m=0-127), n x 0,14 mm (n/180") (n=0-255), n x 0,12 mm (n/216") (n=0-255), n x 0,07 mm (n/360") (n=0-255) |

| Szybkość podajnika | 10 cali na sekundę |

| Pobieranie papieru | Ręczne (góra), traktor pchający (góra), traktor pchający (tył), traktor pchający (dół), podajnik pojedynczych arkuszy (tył) |

| Gęstość znaków | High Speed Draft: 10,0 zn./cal 18,0 zn./cal Jakość użytkowa: 10,0 zn./cal 12,0 zn./cal 15,0 zn./cal 17,1 zn./cal 20 zn./cal Tryb Near Letter Quality: 10,0 zn./cal 12,0 zn./cal 15,0 zn./cal 17,1 zn./cal 20,0 zn./cal Tryb Letter Quality: 10 zn./cal 12 zn./cal 15 zn./cal 17,1 zn./cal 20 zn./cal, proporcjonalnie |

| Szerokość druku | 136 zn./linia przy ANK 10 zn./cal |

Z przedstawionego zrzutu wynika, że na dyskach zastosowano partycjonowanie

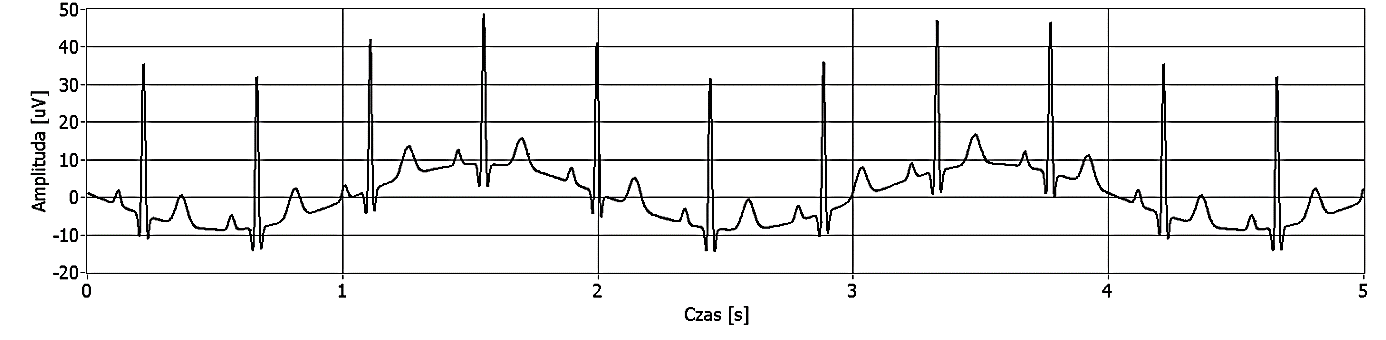

Podczas testowania elektrokardiografu otrzymano przedstawiony przebieg. Na jego podstawie stwierdzono, że nieprawidłowo działa filtr zakłóceń

W urządzeniu medycznym wyznaczono charakterystykę filtru jak na rysunku. Jest to filtr