Pytanie 1

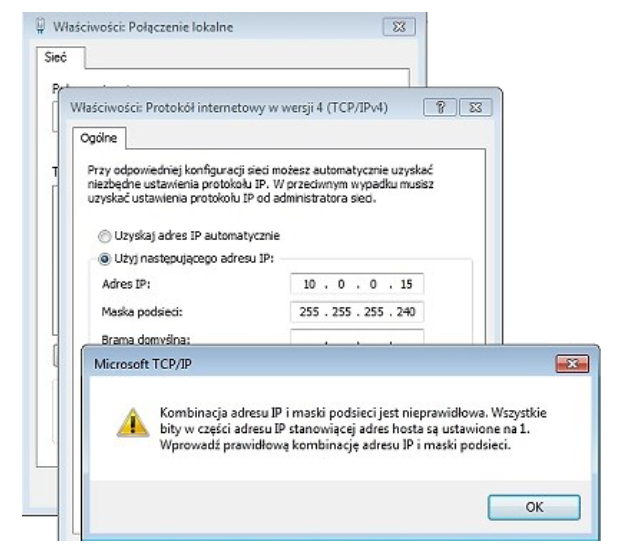

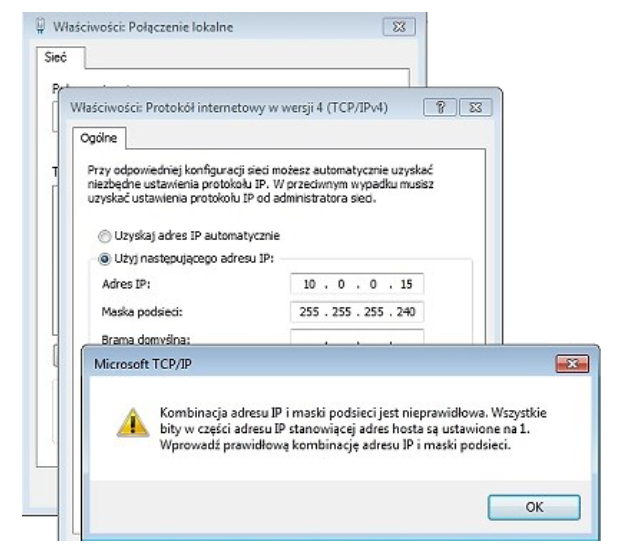

Na ilustracji widoczny jest komunikat, który pojawia się po wprowadzeniu adresu IP podczas ustawiania połączenia sieciowego na komputerze. Adres IP podany przez administratora to adres IP

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Na ilustracji widoczny jest komunikat, który pojawia się po wprowadzeniu adresu IP podczas ustawiania połączenia sieciowego na komputerze. Adres IP podany przez administratora to adres IP

Jaką licencję musi mieć oprogramowanie, aby użytkownik mógł wprowadzać w nim zmiany?

Kable światłowodowe nie są szeroko używane w lokalnych sieciach komputerowych z powodu

Urządzenie, które zamienia otrzymane ramki na sygnały przesyłane w sieci komputerowej, to

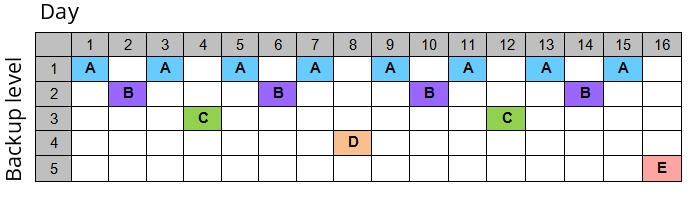

Strategia przedstawiona w diagramie dla tworzenia kopii zapasowych na nośnikach jest znana jako

Trudności w systemie operacyjnym Windows wynikające z konfliktów dotyczących zasobów sprzętowych, takich jak przydział pamięci, przerwań IRQ oraz kanałów DMA, najłatwiej zidentyfikować za pomocą narzędzia

Narzędzie systemu Windows wykorzystywane do interpretacji poleceń, stosujące logikę obiektową oraz cmdlety, to

Aby możliwe było skierowanie wydruku na twardy dysk, konieczne jest w ustawieniach drukarki wybranie opcji drukowania do portu

Jakie oprogramowanie jest zabronione do użytku na sprzęcie instytucji rządowych lub edukacyjnych?

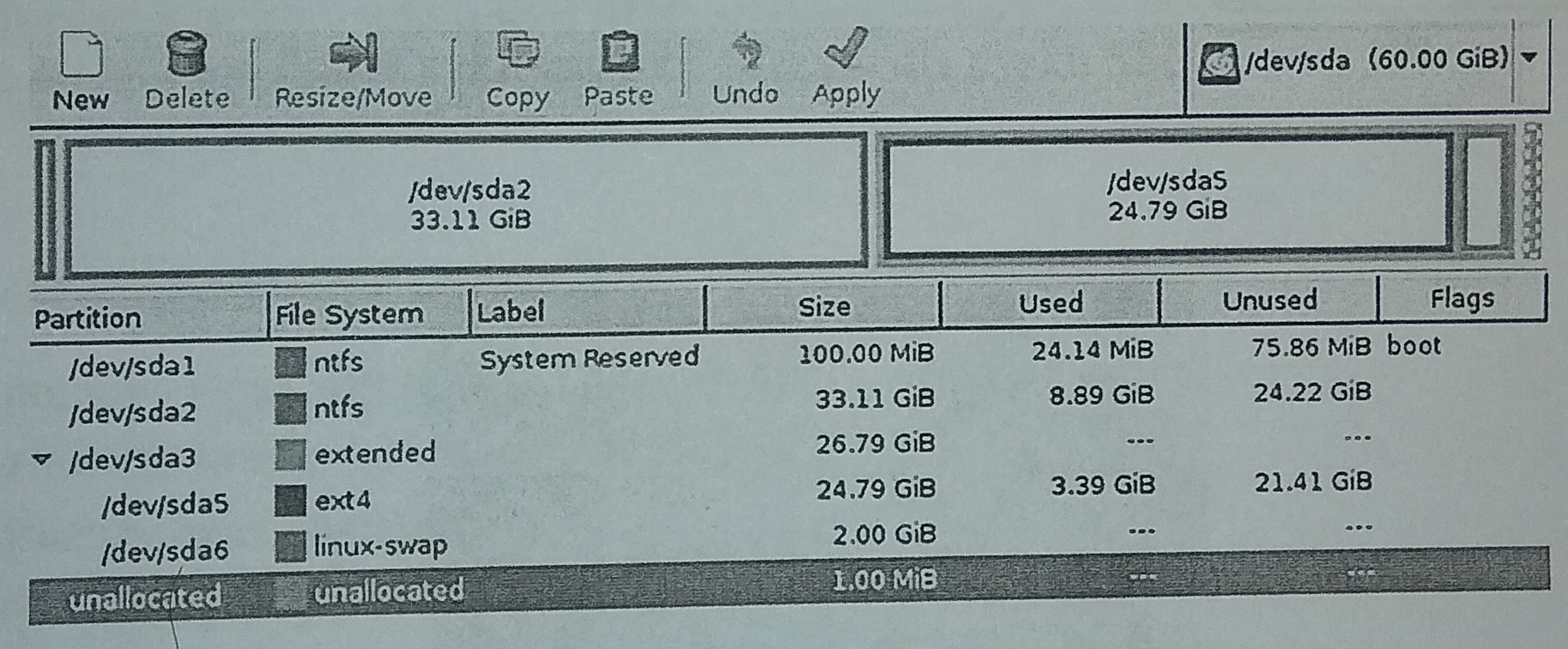

Zdiagnostykowane wyniki wykonania polecenia systemu Linux odnoszą się do ```/dev/sda: Timing cached reads: 18100 MB in 2.00 seconds = 9056.95 MB/sec```

W sieci komputerowej działającej pod systemem Linux do udostępniania drukarek można zastosować serwer

Jednym z metod ograniczenia dostępu do sieci bezprzewodowej dla osób nieuprawnionych jest

Do bezprzewodowego przesyłania danych pomiędzy dwoma urządzeniami, z wykorzystaniem fal radiowych w paśmie ISM 2,4 GHz, służy interfejs

Na schemacie przedstawiono sieć o strukturze

Plik ma wielkość 2 KiB. Co to oznacza?

Jakie polecenie należy wykorzystać, aby zmienić właściciela pliku w systemie Linux?

Który protokół zamienia adresy IP na adresy MAC, używane w sieciach Ethernet?

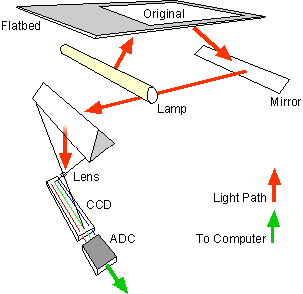

Urządzenie przedstawione na obrazie jest przeznaczone do

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Port zgodny z standardem RS-232, działający w trybie asynchronicznym, to

W jakiej technologii produkcji projektorów stosowany jest system mikroskopijnych luster, przy czym każde z nich odpowiada jednemu pikselowi wyświetlanego obrazu?

Błędy systemu operacyjnego Windows spowodowane przez konflikty zasobów sprzętowych, takie jak przydział pamięci, przydział przerwań IRQ i kanałów DMA, najłatwiej jest wykryć za pomocą narzędzia

Oblicz całkowity koszt materiałów potrzebnych do zbudowania sieci w topologii gwiazdy dla 3 komputerów z kartami sieciowymi, używając kabli o długości 2 m. Ceny materiałów są wskazane w tabeli.

| Nazwa elementu | Cena jednostkowa brutto |

|---|---|

| przełącznik | 80 zł |

| wtyk RJ-45 | 1 zł |

| przewód typu „skrętka" | 1 zł za 1 metr |

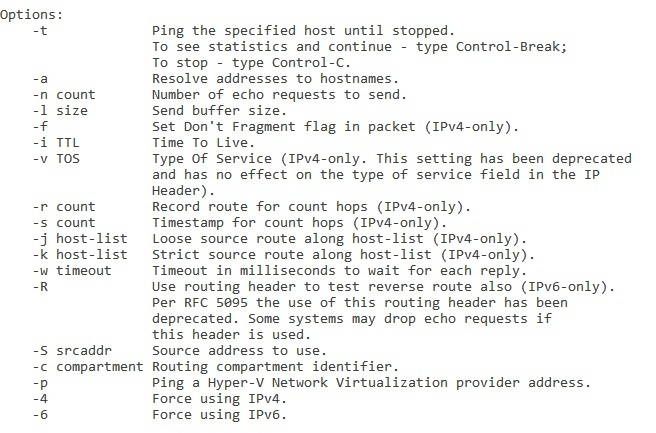

Aby wyświetlić przedstawione opcje polecenia ping, należy w wierszu polecenia systemu Windows zapisać

Jakim interfejsem można uzyskać transmisję danych o maksymalnej przepustowości 6 Gb/s?

Menedżer urządzeń w systemie Windows pozwala na wykrycie

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

Jakie zagrożenie nie jest eliminowane przez program firewall?

W systemie Windows, po dezaktywacji domyślnego konta administratora i ponownym uruchomieniu komputera

Przedstawiony schemat przedstawia zasadę działania

Domyślny port, na którym działa usługa "Pulpit zdalny", to

Który z podanych programów pozwoli na stworzenie technicznego rysunku ilustrującego plan instalacji logicznej sieci lokalnej w budynku?

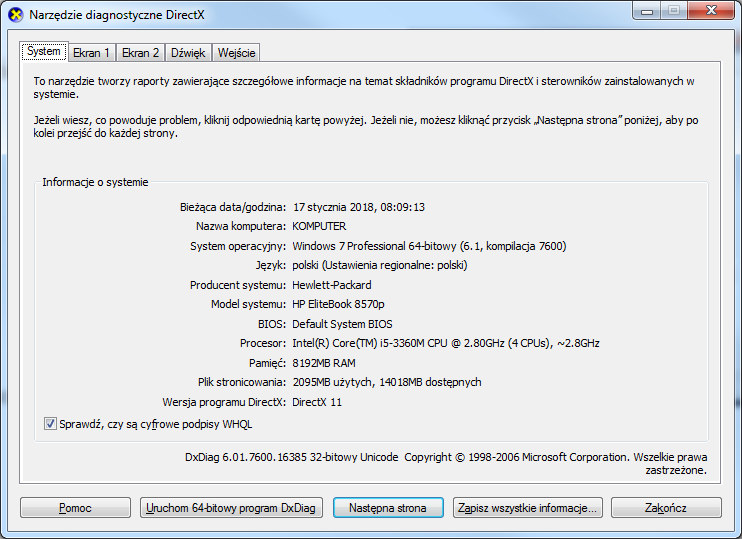

Aby uruchomić przedstawione narzędzie systemu Windows, należy użyć polecenia

Jakie polecenie jest wysyłane do serwera DHCP, aby zwolnić wszystkie adresy przypisane do interfejsów sieciowych?

Analiza danych wyświetlonych przez program umożliwia stwierdzenie, że

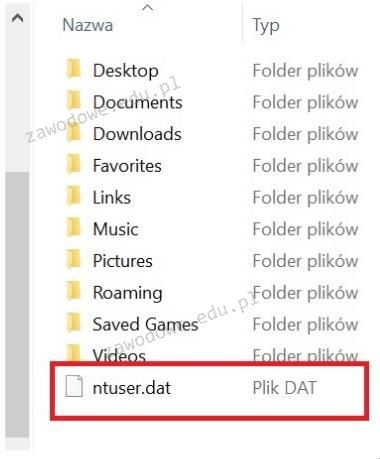

Aby zmienić profil na obowiązkowy, trzeba zmodyfikować rozszerzenie pliku ntuser.dat na

Jakie jest zadanie programu Wireshark?

Moduł funkcjonalny, który nie znajduje się w kartach dźwiękowych, to skrót

Proces zapisywania kluczy rejestru do pliku określamy jako

Aby zidentyfikować, który program najbardziej obciąża CPU w systemie Windows, należy otworzyć program