Pytanie 1

Jaki protokół służy komputerom do informowania rutera o przynależności do konkretnej grupy multicastowej?

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Jaki protokół służy komputerom do informowania rutera o przynależności do konkretnej grupy multicastowej?

Ilustracja przedstawia rodzaj pamięci

Na dysku należy umieścić 100 tysięcy oddzielnych plików, z których każdy ma rozmiar 2570 bajtów. W takim przypadku, zapisane pliki będą zajmować najmniej miejsca na dysku z jednostką alokacji wynoszącą

W systemie Linux do obsługi tablic partycji można zastosować komendę

Użytkownik systemu Linux, który pragnie usunąć konto innej osoby wraz z jej katalogiem domowym, powinien użyć polecenia

Wykonanie polecenia net localgroup w systemie Windows spowoduje

Która z licencji umożliwia korzystanie przez każdego użytkownika z programu bez ograniczeń wynikających z autorskich praw majątkowych?

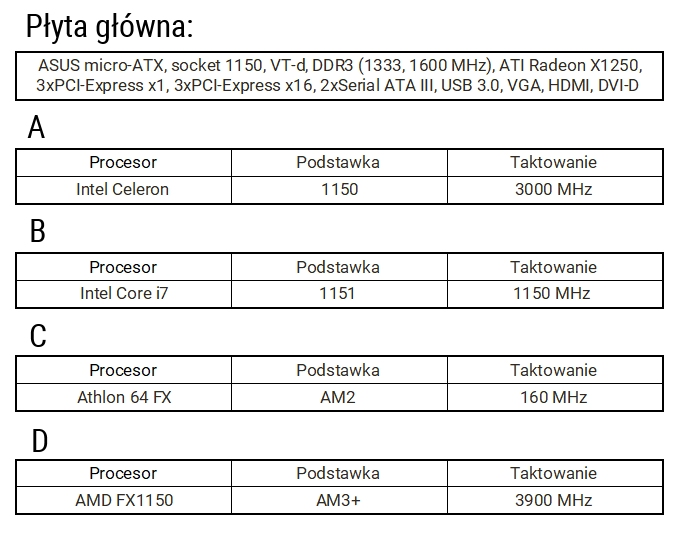

Jaki procesor pasuje do płyty głównej o podanej specyfikacji?

Jaki adres IPv4 identyfikuje urządzenie funkcjonujące w sieci o adresie 14.36.64.0/20?

Aby zmienić ustawienia konfiguracyjne Menu Start oraz paska zadań w systemie Windows, która przystawka powinna być wykorzystana?

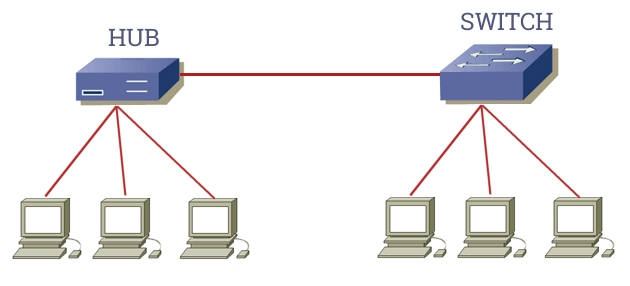

Ile kolizji domenowych występuje w sieci przedstawionej na ilustracji?

Usterka zaprezentowana na ilustracji, widoczna na monitorze, nie może być spowodowana przez

Informacje ogólne na temat zdarzeń systemowych w systemie Linux są zapisywane w

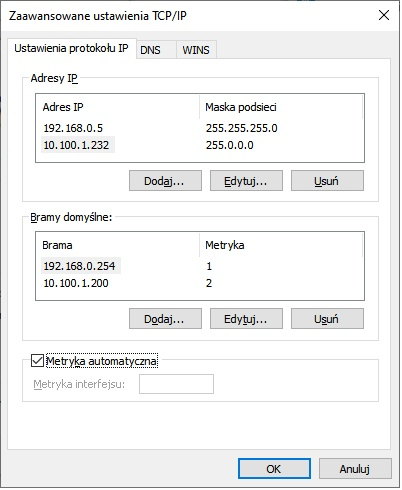

Na podstawie przedstawionej na ilustracji konfiguracji, w przypadku, gdy komputer żąda połączenia z inną siecią, w pierwszej kolejności dane zostaną wysłane do urządzenia o adresie

Wydanie w systemie Windows komendy ```ATTRIB -S +H TEST.TXT``` spowoduje

Komputer stracił łączność z siecią. Jakie działanie powinno być podjęte w pierwszej kolejności, aby naprawić problem?

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?

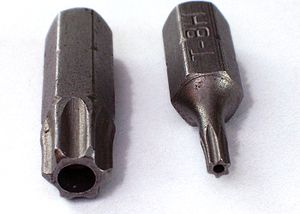

Na ilustracji przedstawiono końcówkę wkrętaka typu

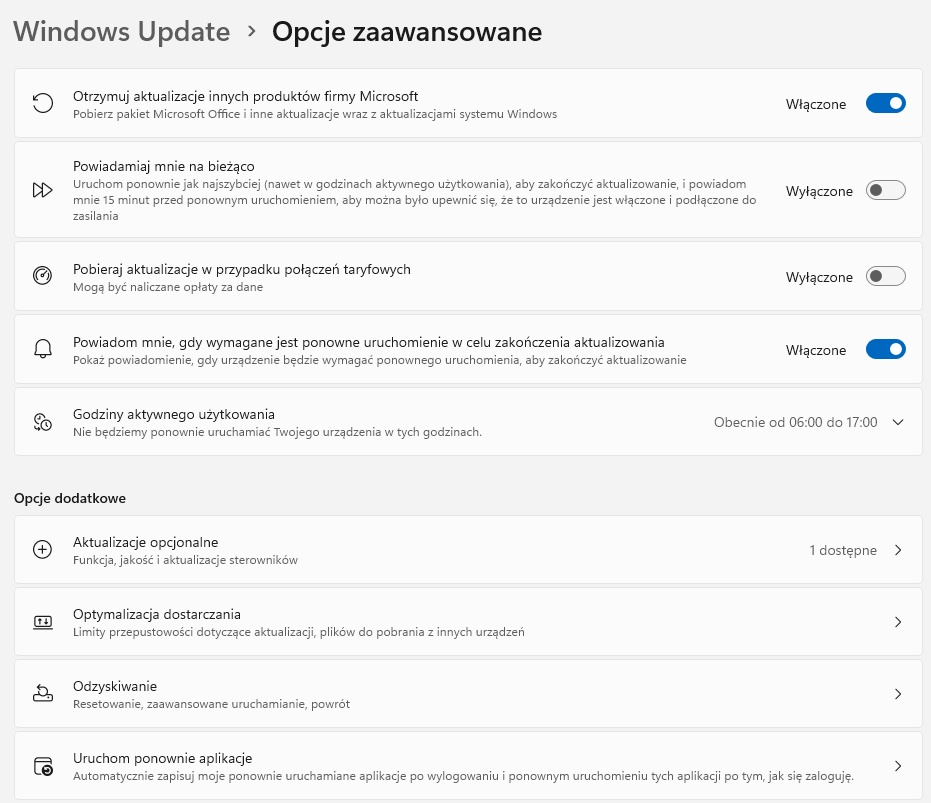

Biorąc pod uwagę konfigurację wykonywaną na ilustracji, administrator po zainstalowaniu systemu operacyjnego uznał za istotne, aby

Wskaż standard interfejsu stosowanego do przewodowego połączenia dwóch urządzeń.

Który z poniższych adresów IPv4 należy do klasy C?

Dysk twardy podczas pracy stuka i można zaobserwować bardzo powolne uruchamianie systemu oraz odczytywanie danych. Aby naprawić tę usterkę, po zabezpieczeniu danych na nośniku zewnętrznym należy

Oprogramowanie, które pozwala na interakcję pomiędzy kartą sieciową a systemem operacyjnym, to

Pamięć podręczna Intel Smart Cache, która znajduje się w procesorach wielordzeniowych, takich jak Intel Core Duo, to pamięć

Aby użytkownik systemu Linux mógł sprawdzić zawartość katalogu, wyświetlając pliki i katalogi, oprócz polecenia ls może skorzystać z polecenia

W trakcie konserwacji oraz czyszczenia drukarki laserowej, która jest odłączona od zasilania, pracownik serwisu komputerowego może zastosować jako środek ochrony osobistej

Wykonanie na komputerze z systemem Windows kolejno poleceń ```ipconfig /release``` oraz ```ipconfig /renew``` umożliwi zweryfikowanie, czy usługa w sieci funkcjonuje poprawnie

Podaj polecenie w systemie Windows Server, które umożliwia usunięcie jednostki organizacyjnej z katalogu.

Czym jest NAS?

Zapis #102816 oznacza reprezentację w systemie

W systemie Linux uruchomiono skrypt z czterema argumentami. Jak można uzyskać dostęp do listy wszystkich wartości w skrypcie?

Sieć lokalna posiada adres IP 192.168.0.0/25. Który adres IP odpowiada stacji roboczej w tej sieci?

Odmianą pamięci, która zapewnia tylko odczyt i może być usunięta przy użyciu światła ultrafioletowego, jest pamięć

Urządzenie przedstawione na ilustracji, wraz z podanymi danymi technicznymi, może być zastosowane do pomiarów systemów okablowania

Planując pierwsze uruchomienie i konfigurację rutera, należy w pierwszej kolejności

Jakiego typu transmisję danych przesyłanych za pomocą interfejsu komputera osobistego pokazano na ilustracji?

| Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit stopu |

Aby zweryfikować indeks stabilności systemu Windows Server, należy zastosować narzędzie

Jakie urządzenie pozwala na podłączenie drukarki, która nie ma karty sieciowej, do lokalnej sieci komputerowej?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

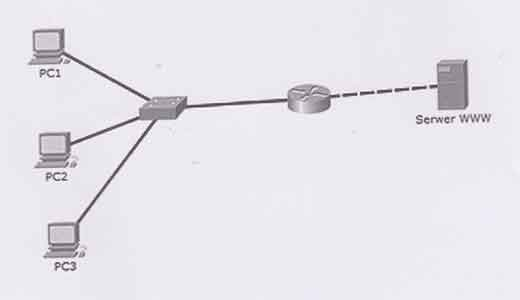

Użytkownicy w sieci lokalnej mogą się komunikować między sobą, lecz nie mają możliwości połączenia z serwerem WWW. Wynik polecenia ping z komputerów do bramy jest pozytywny. Który element sieci nie może być źródłem problemu?