Pytanie 1

Wskaż właściwą formę maski

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Wskaż właściwą formę maski

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

Aby zapewnić maksymalną ochronę danych przy użyciu dokładnie 3 dysków, powinny one być przechowywane w macierzy RAID

Jakie protokoły są używane w komunikacji między hostem a serwerem WWW po wpisaniu URL w przeglądarkę internetową hosta?

Jakie jest odpowiadające adresowi 194.136.20.35 w systemie dziesiętnym przedstawienie w systemie binarnym?

Aby powiększyć lub zmniejszyć rozmiar ikony na pulpicie, trzeba obracać rolką myszki, trzymając jednocześnie klawisz

Najlepszym sposobem na zabezpieczenie domowej sieci Wi-Fi jest

Jaką funkcję pełni polecenie tee w systemie Linux?

W systemie Linux polecenie touch jest używane do

Aby zamontować przedstawioną kartę graficzną, potrzebna jest płyta główna posiadająca złącze

Na ilustracji przedstawiona jest karta

Drukarka do zdjęć ma mocno zabrudzoną obudowę oraz ekran. Aby oczyścić zanieczyszczenia bez ryzyka ich uszkodzenia, należy zastosować

Które z poniższych stwierdzeń jest prawdziwe w odniesieniu do przedstawionej konfiguracji serwisu DHCP w systemie Linux?

Mysz komputerowa z interfejsem bluetooth pracującym w klasie 2 ma teoretyczny zasięg do

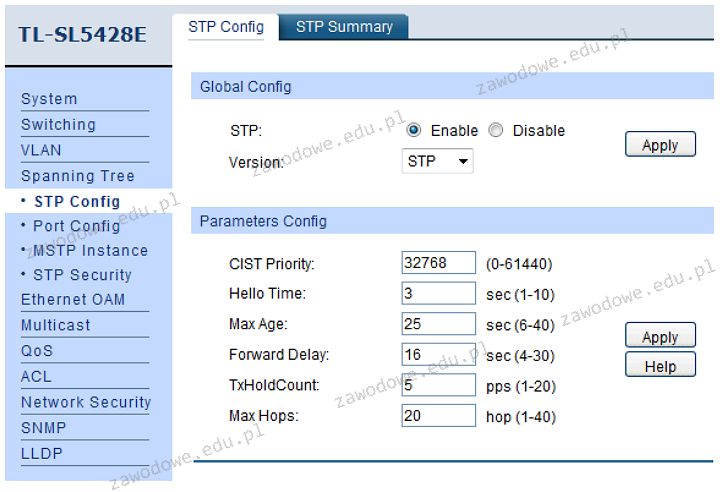

Analizując zrzut ekranu prezentujący ustawienia przełącznika, można zauważyć, że

Która norma w Polsce definiuje zasady dotyczące okablowania strukturalnego?

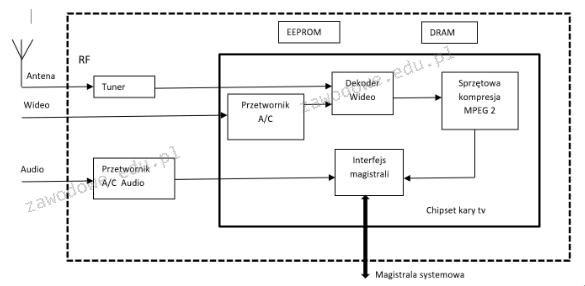

Na ilustracji przedstawiono diagram blokowy karty

Jakie informacje można uzyskać dzięki programowi Wireshark?

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona

Wprowadzając w wierszu poleceń systemu Windows Server komendę convert, można wykonać

Zestaw narzędzi do instalacji okablowania miedzianego typu "skrętka" w sieci komputerowej powinien obejmować:

Która z grup w systemie Windows Server ma najniższe uprawnienia?

Oblicz koszt realizacji okablowania strukturalnego od 5 punktów abonenckich do panelu krosowego, wliczając wykonanie kabli łączących dla stacji roboczych. Użyto przy tym 50 m skrętki UTP. Każdy punkt abonencki posiada 2 gniazda typu RJ45.

| Materiał | Jednostka | Cena |

|---|---|---|

| Gniazdo podtynkowe 45x45, bez ramki, UTP 2xRJ45 kat.5e | szt. | 17 zł |

| UTP kabel kat.5e PVC 4PR 305m | karton | 305 zł |

| RJ wtyk UTP kat.5e beznarzędziowy | szt. | 6 zł |

Jakie polecenie w systemie Linux pozwala na wyświetlenie informacji o bieżącej godzinie, czasie pracy systemu oraz liczbie użytkowników zalogowanych do systemu?

Wartość liczby 1100112 zapisanej w systemie dziesiętnym wynosi

Jakim elementem sieci SIP jest telefon IP?

Ile sieci obejmują komputery z adresami IP przedstawionymi w tabeli oraz standardową maską sieci?

| Komputer 1 | 172.16.15.5 |

| Komputer 2 | 172.18.15.6 |

| Komputer 3 | 172.18.16.7 |

| Komputer 4 | 172.20.16.8 |

| Komputer 5 | 172.20.16.9 |

| Komputer 6 | 172.21.15.10 |

Zastąpienie koncentratorów przełącznikami w sieci Ethernet doprowadzi do

Analiza tłumienia w kablowym systemie przesyłowym umożliwia ustalenie

Licencja grupowa na oprogramowanie Microsoft należy do typu

Włączenie systemu Windows w trybie debugowania umożliwia

Jaką funkcję serwera trzeba dodać w systemach z rodziny Windows Server, aby było możliwe utworzenie nowej witryny FTP?

W systemie Linux, co oznacza znak "~" w ścieżce dostępu do plików?

Jakość skanowania można poprawić poprzez zmianę

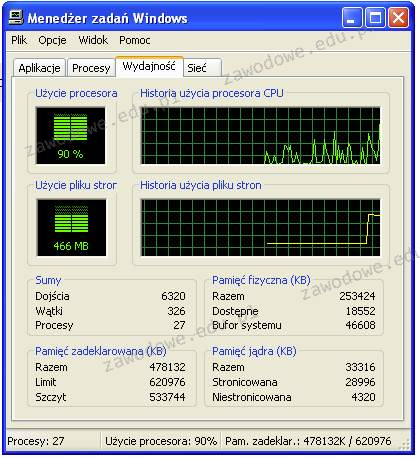

Przyglądając się przedstawionemu obrazkowi, można dostrzec, że deklarowany limit pamięci wynosi 620976 KB. Zauważamy również, że zainstalowana pamięć fizyczna w badanym systemie jest mniejsza niż pamięć zadeklarowana. Który typ pamięci wpływa na podniesienie limitu pamięci zadeklarowanej powyżej rozmiaru zainstalowanej pamięci fizycznej?

Przedstawione na ilustracji narzędzie służy do

Aby uzyskać na ekranie monitora odświeżanie obrazu 85 razy w ciągu sekundy, trzeba częstotliwość jego odświeżania ustawić na

Aby zminimalizować wpływ zakłóceń elektromagnetycznych na przesyłany sygnał w projektowanej sieci komputerowej, co należy zastosować?

Wynikiem wykonania komendy arp -a 192.168.1.1 w systemie MS Windows jest pokazanie