Pytanie 1

Jaki protokół warstwy aplikacji jest wykorzystywany do zarządzania urządzeniami sieciowymi poprzez sieć?

Wynik: 31/40 punktów (77,5%)

Wymagane minimum: 20 punktów (50%)

Jaki protokół warstwy aplikacji jest wykorzystywany do zarządzania urządzeniami sieciowymi poprzez sieć?

Komputer jest połączony z myszą bezprzewodową, a kursor w trakcie używania nie porusza się płynnie, tylko "skacze" po ekranie. Możliwą przyczyną awarii urządzenia może być

Zaprezentowany komunikat jest rezultatem wykonania następującego polecenia

C:\Windows NT_SERVICE\TrustedInstaller:(F)

NT_SERVICE\TrustedInstaller:(CI)(IO)(F)

ZARZĄDZANIE NT\SYSTEM:(M)

ZARZĄDZANIE NT\SYSTEM:(OI)(CI)(IO)(F)

BUILTIN\Administratorzy:(M)

BUILTIN\Administratorzy:(OI)(CI)(IO)(F)

BUILTIN\Użytkownicy:(RX)

BUILTIN\Użytkownicy:(OI)(CI)(IO)(GR,GE)

TWÓRCA-WŁAŚCICIEL:(OI)(CI)(IO)(F)

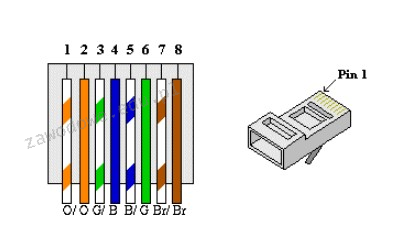

Na rysunku przedstawiono schemat ethernetowego połączenia niekrosowanych, ośmiopinowych złączy 8P8C. Jaką nazwę nosi ten schemat?

Aby zmierzyć moc zużywaną przez komputer, należy zastosować

Złośliwe oprogramowanie, które rejestruje klawisze naciskane przez użytkownika w systemie operacyjnym, to

Skrót MAN odnosi się do rodzaju sieci

Komputer prawdopodobnie jest zainfekowany wirusem typu boot. Jakie działanie umożliwi usunięcie wirusa w najbardziej nieinwazyjny sposób dla systemu operacyjnego?

Podczas pracy wskaźnik przewodowej myszy optycznej nie reaguje na przesuwanie urządzenia po padzie, dopiero po odpowiednim ułożeniu myszy kursor zaczyna zmieniać położenie. Objawy te wskazują na uszkodzenie

Zasady dotyczące filtracji ruchu w firewallu są ustalane w postaci

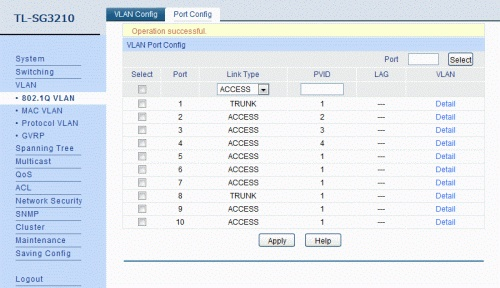

Na ilustracji przedstawiono konfigurację przełącznika z utworzonymi sieciami VLAN. Którymi portami można przesyłać oznaczone ramki z różnych sieci VLAN?

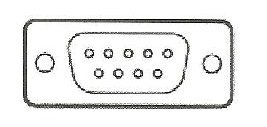

Na ilustracji przedstawiono złącze

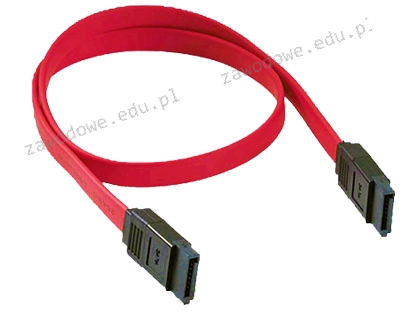

Na ilustracji przedstawiono przewód z wtykami

Na stabilność obrazu w monitorach CRT istotny wpływ ma

Każdorazowo automatycznie szyfrowany staje się plik, który został zaszyfrowany przez użytkownika za pomocą systemu NTFS 5.0, w momencie

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

Po przeprowadzeniu diagnostyki komputera stwierdzono, że temperatura pracy karty graficznej z wyjściami HDMI oraz D-SUB, umieszczonej w gnieździe PCI Express stacjonarnego komputera, wynosi 87°C. W takiej sytuacji serwisant powinien

Poprzez użycie opisanego urządzenia możliwe jest wykonanie diagnostyki działania

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora wysyła sygnał do komputera, co pozwala na określenie pozycji kursora?

Serwer zajmuje się rozgłaszaniem drukarek w sieci, organizowaniem zadań do wydruku oraz przydzielaniem uprawnień do korzystania z drukarek

Nie można uruchomić systemu Windows z powodu błędu oprogramowania. Jak można przeprowadzić diagnozę i usunąć ten błąd w jak najmniej inwazyjny sposób?

Aby skonfigurować usługę rutingu w systemie Windows Serwer, należy zainstalować rolę

Wartość liczby BACA w systemie heksadecymalnym to liczba

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie złącze na płycie głównej komputera jest przeznaczone do zamontowania karty graficznej widocznej na powyższym obrazie?

Klawiatura QWERTY, która pozwala na wprowadzanie znaków typowych dla języka polskiego, nazywana jest także klawiaturą

Materiałem eksploatacyjnym, stosowanym w rzutniku multimedialnym, jest

Planując pierwsze uruchomienie i konfigurację rutera, należy w pierwszej kolejności

Systemy operacyjne należące do rodziny Linux są dystrybuowane na mocy licencji

Jak najlepiej chronić zgromadzone dane przed ich odczytem w przypadku kradzieży komputera?

W systemach operacyjnych z rodziny Windows, funkcja EFS umożliwia ochronę danych poprzez ich

Jak brzmi nazwa klucza rejestru w systemie Windows, w którym zapisane są relacje między typami plików a aplikacjami, które je obsługują?

W sieciach bezprzewodowych typu Ad-Hoc IBSS (Independent Basic Service Set) wykorzystywana jest topologia fizyczna

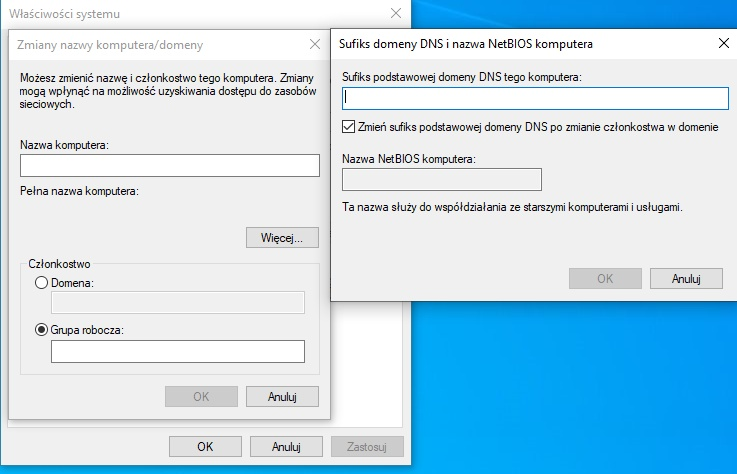

Aby podłączyć stację roboczą z zainstalowanym systemem Windows do domeny zst.local należy

Czym dokonuje się przekształcenia kodu źródłowego w program do wykonania?

Rekord startowy dysku twardego w komputerze to

Obecnie pamięci podręczne drugiego poziomu procesora (ang. "L-2 cache") są zbudowane z układów pamięci

Płyta główna z gniazdem G2 będzie kompatybilna z procesorem

Podaj adres rozgłoszeniowy sieci, do której przynależy host o adresie 88.89.90.91/6?

Interfejs SATA 2 (3 Gb/s) gwarantuje prędkość transferu