Pytanie 1

Sprzęt, na którym można skonfigurować sieć VLAN, to

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Sprzęt, na którym można skonfigurować sieć VLAN, to

Prawo majątkowe przysługujące twórcy programu komputerowego

Jakie czynności należy wykonać, aby przygotować nowego laptopa do użytkowania?

Wartość wyrażana w decybelach, będąca różnicą pomiędzy mocą sygnału przekazywanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej to

GRUB, LILO, NTLDR to

W dwóch sąsiadujących pomieszczeniach pewnej firmy występują znaczne zakłócenia elektromagnetyczne. Aby zapewnić maksymalną przepustowość w istniejącej sieci LAN, jakie medium transmisyjne powinno być użyte?

Jaką pojemność ma dwuwarstwowa płyta Blu-ray?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

W celu zainstalowania systemu openSUSE oraz dostosowania jego ustawień, można skorzystać z narzędzia

Zbiór zasad określających metodę wymiany danych w sieci to

Podstawowy rekord uruchamiający na dysku twardym to

Przypisanie licencji oprogramowania do pojedynczego komputera lub jego komponentów stanowi charakterystykę licencji

Aby przeprowadzić rezerwację adresów IP w systemie Windows Server na podstawie fizycznych adresów MAC urządzeń, konieczne jest skonfigurowanie usługi

Narzędzie używane do przechwytywania oraz analizy danych przesyłanych w sieci, to

Którego wbudowanego narzędzia w systemie Windows 8 Pro można użyć do szyfrowania danych?

Użytkownik napotyka trudności przy uruchamianiu systemu Windows. W celu rozwiązania tego problemu, skorzystał z narzędzia System Image Recovery, które

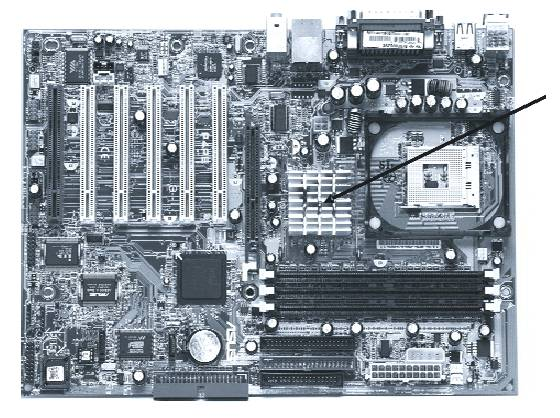

Na ilustracji pokazano płytę główną komputera. Strzałką wskazano

Program Mozilla Firefox jest udostępniany na zasadach licencji

Pierwsze trzy bity adresu IP w formacie binarnym mają wartość 010. Jaką klasę reprezentuje ten adres?

Aby uzyskać największą prędkość przepływu danych w przypadku, gdy domowy ruter pracuje w paśmie częstotliwości 5 GHz, do notebooka powinno się zamontować bezprzewodową kartę sieciową pracującą w standardzie

Co oznacza oznaczenie kabla skrętkowego U/FTP?

Które medium transmisyjne charakteryzuje się najmniejszym ryzykiem narażenia na zakłócenia elektromagnetyczne przesyłanego sygnału?

W których nośnikach pamięci masowej jedną z najczęstszych przyczyn uszkodzeń jest uszkodzenie powierzchni?

Narzędzie pokazane na ilustracji jest używane do weryfikacji

Aby poprawić wydajność procesora serii Intel za pomocą 'podkręcania' (ang. overclocking), należy użyć procesora oznaczonego

Ustawienia wszystkich kont użytkowników na komputerze znajdują się w gałęzi rejestru oznaczonej akronimem

Aby oczyścić zablokowane dysze kartridża drukarki atramentowej, co należy zrobić?

Mysz komputerowa z interfejsem bluetooth pracującym w klasie 2 ma teoretyczny zasięg do

Ustawienia przedstawione na diagramie dotyczą

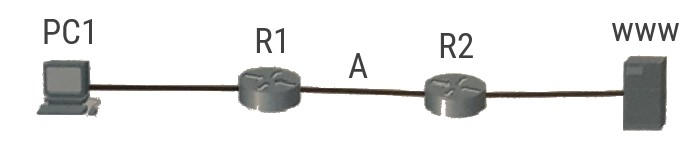

Ramka danych przesyłanych z komputera PC1 do serwera www znajduje się pomiędzy ruterem R1 a ruterem R2 (punkt A). Jakie adresy są w niej zawarte?

Która z usług musi być aktywna na ruterze, aby mógł on modyfikować adresy IP źródłowe oraz docelowe podczas przekazywania pakietów pomiędzy różnymi sieciami?

W systemie Linux, aby wyszukać wszystkie pliki z rozszerzeniem txt, które znajdują się w katalogu /home/user i zaczynają się na literę a lub literę b lub literę c, należy wydać polecenie

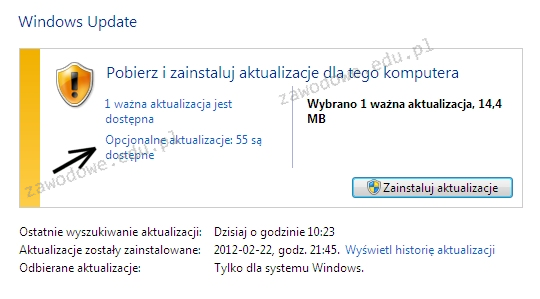

Jeżeli użytkownik zaznaczy opcję wskazaną za pomocą strzałki, będzie miał możliwość instalacji aktualizacji

Jakie polecenie w systemie Linux przyzna pełne uprawnienia wszystkim użytkownikom do zasobów?

Przedstawiony listing zawiera polecenia umożliwiające:

Switch>enable Switch#configure terminal Switch(config)#interface range fastEthernet 0/1-10 Switch(config-if-range)#switchport access vlan 10 Switch(config-if-range)#exit

Komputer A, który potrzebuje przesłać dane do komputera B działającego w sieci z innym adresem IP, najpierw wysyła pakiety do adresu IP

Który z protokołów NIE jest używany do ustawiania wirtualnej sieci prywatnej?

Jak wiele domen kolizyjnych oraz rozgłoszeniowych można dostrzec na schemacie?

Aby w edytorze Regedit przywrócić stan rejestru systemowego za pomocą wcześniej utworzonej kopii zapasowej, należy użyć funkcji

Zamiana taśmy barwiącej jest związana z eksploatacją drukarki