Pytanie 1

Według specyfikacji JEDEC, napięcie zasilania dla modułów pamięci RAM DDR3L wynosi

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Według specyfikacji JEDEC, napięcie zasilania dla modułów pamięci RAM DDR3L wynosi

Jakie polecenie powinno być użyte do obserwacji lokalnych połączeń?

Płyta główna wyposażona w gniazdo G2 będzie współpracowała z procesorem

Wykonanie na komputerze z systemem Windows poleceń ipconfig /release oraz ipconfig /renew umożliwia weryfikację, czy usługa w sieci działa poprawnie

Tryb użytkownika w przełączniku CISCO (User EXEC Mode) umożliwia

Jakie parametry można śledzić w przypadku urządzenia przy pomocy S.M.A.R.T.?

Która karta graficzna nie będzie kompatybilna z monitorem, który posiada złącza pokazane na zdjęciu, przy założeniu, że do podłączenia monitora nie użyjemy adaptera?

Aby oczyścić zablokowane dysze kartridża drukarki atramentowej, co należy zrobić?

Podanie nieprawidłowych napięć do płyty głównej może skutkować

Którego narzędzia można użyć, aby prześledzić trasę, którą pokonują pakiety w sieciach?

Jakie oprogramowanie służy do sprawdzania sterowników w systemie Windows?

Jaki adres IP został przypisany do hosta na interfejsie sieciowym eth0?

[root@ipv6 tspc]# ifconfig

eth0 Link encap:Ethernet HWaddr 00:A0:C9:89:02:F8

inet addr:128.171.104.26 Bcast:128.171.104.255 Mask:255.255.255.0

inet6 addr: fe80::2a0:c9ff:fe89:2f8/10 Scope:Link

UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1

RX packets:663940 errors:0 dropped:0 overruns:0 frame:0

TX packets:67717 errors:0 dropped:0 overruns:0 carrier:0

collisions:7797 txqueuelen:100

RX bytes:234400485 (223.5 Mb) TX bytes:17743338 (16.9 Mb)

Interrupt:10 Base address:0xef80

lo Link encap:Local Loopback

inet addr:127.0.0.1 Mask:255.0.0.0

inet6 addr: ::1/128 Scope:Host

UP LOOPBACK RUNNING MTU:16436 Metric:1

RX packets:3070 errors:0 dropped:0 overruns:0 frame:0

TX packets:3070 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:153813 (150.2 Kb) TX bytes:153813 (150.2 Kb)

sit1 Link encap:IPv6-in-IPv4

inet6 addr: 3ffe:b80:2:482::2/64 Scope:Global

inet6 addr: fe80::80ab:681a/10 Scope:Link

UP POINTOPOINT RUNNING NOARP MTU:1480 Metric:1

RX packets:82 errors:0 dropped:0 overruns:0 frame:0

TX packets:78 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:8921 (8.7 Kb) TX bytes:8607 (8.4 Kb)Aby poprawić organizację plików na dysku i przyspieszyć działanie systemu, co należy zrobić?

Aby sprawdzić, czy zainstalowana karta graficzna w komputerze jest przegrzewana, użytkownik ma możliwość użycia programu

W strukturze sieciowej zaleca się umiejscowienie jednego punktu abonenckiego na powierzchni wynoszącej

Która z kart graficznych nie będzie kompatybilna z monitorem, posiadającym złącza pokazane na ilustracji (zakładając, że nie można użyć adaptera do jego podłączenia)?

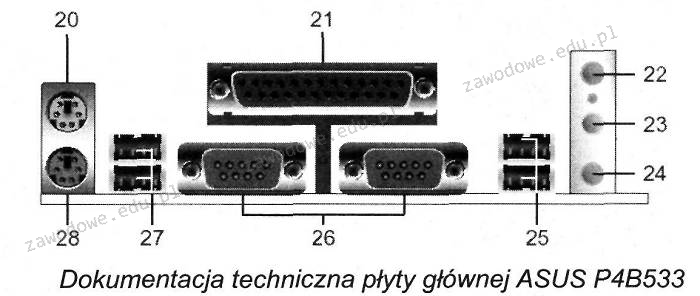

Na zaprezentowanej płycie głównej komputera złącza oznaczono cyframi 25 i 27

Jaki adres stanowi adres rozgłoszeniowy dla hosta o IP 171.25.172.29 oraz masce sieci 255.255.0.0?

Do sprawdzenia, czy w okablowaniu występują odwrócone pary przewodów, stosowany jest test

Natychmiast po usunięciu ważnych plików na dysku twardym użytkownik powinien

Najczęstszą przyczyną niskiej jakości wydruku z drukarki laserowej, która objawia się widocznym rozmazywaniem tonera, jest

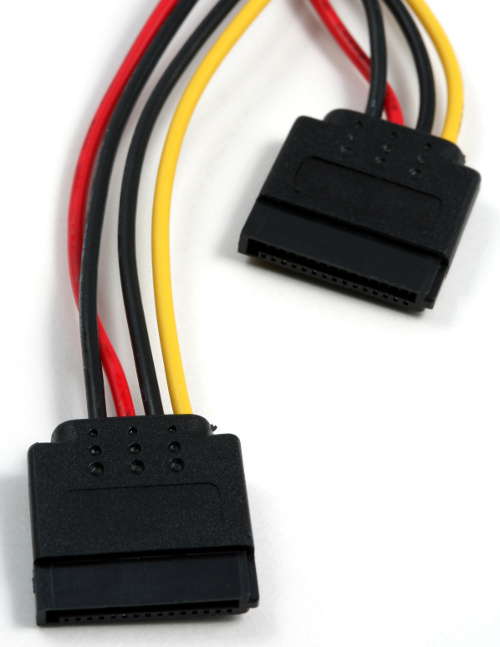

Jakie złącze jest potrzebne do podłączenia zasilania do CD-ROM?

ACPI to interfejs, który umożliwia

Aby zweryfikować połączenia kabla U/UTP Cat. 5e w systemie okablowania strukturalnego, jakiego urządzenia należy użyć?

Nierówne wydruki lub bladości w druku podczas korzystania z drukarki laserowej mogą sugerować

Na przedstawionym zdjęciu złącza pozwalają na

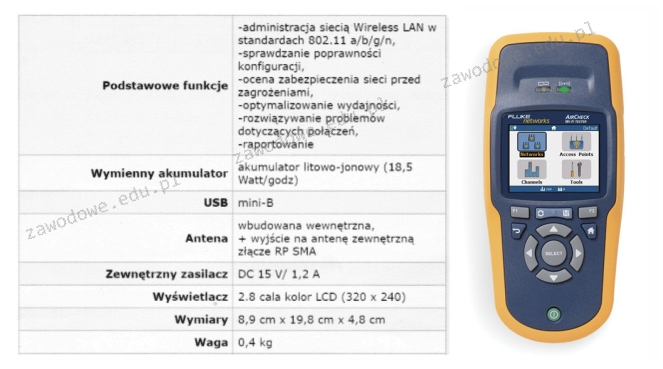

Jakie urządzenie diagnostyczne zostało zaprezentowane na ilustracji oraz opisane w specyfikacji zawartej w tabeli?

Zastosowanie programu Wireshark polega na

Zgodnie z zamieszczonym cennikiem, średni koszt wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

Rysunek obrazuje zasadę działania drukarki

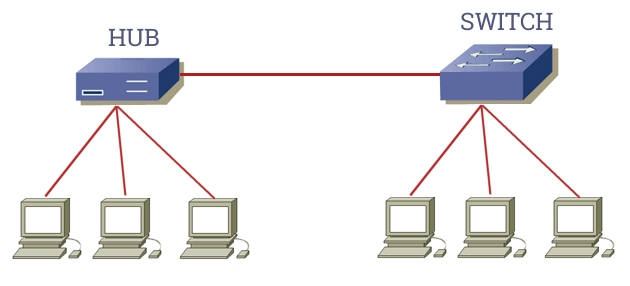

Ile kolizji domenowych występuje w sieci przedstawionej na ilustracji?

Jakie polecenie umożliwia śledzenie drogi datagramu IP do miejsca docelowego?

W złączu zasilania SATA uszkodzeniu uległ żółty kabel. Jakie to ma konsekwencje dla napięcia, które nie jest przesyłane?

W dokumentacji technicznej efektywność głośnika podłączonego do komputera wyraża się w jednostce

Narzędzie przedstawione do nadzorowania sieci LAN to

C:\Users\egzamin>nmap localhost Starting Nmap 7.80 ( https://nmap.org ) at 2019-11-26 20:23 ?rodkowoeuropejski czas stand. Nmap scan report for localhost (127.0.0.1) Host is up (0.00s latency). Other addresses for localhost (not scanned): ::1 Not shown: 988 closed ports PORT STATE SERVICE 135/tcp open msrpc 445/tcp open microsoft-ds 1025/tcp open NFS-or-IIS 1026/tcp open LSA-or-nterm 1027/tcp open IIS 1029/tcp open ms-lsa 1030/tcp open iad1 1031/tcp open iad2 1044/tcp open dcutility 1234/tcp open hotline 2869/tcp open icslap 16992/tcp open amt-soap-http Nmap done: 1 IP address (1 host up) scanned in 0.94 seconds

Jaki jest adres rozgłoszeniowy w sieci, w której działa host z adresem IP 195.120.252.32 i maską podsieci 255.255.255.192?

Na stabilność wyświetlanego obrazu w monitorach CRT istotny wpływ ma

Ilustracja pokazuje rezultat testu sieci komputerowej za pomocą komendy

Emisja dźwięków: jednego długiego oraz dwóch krótkich przez BIOS firmy AMI wskazuje na

Wskaż procesor współpracujący z przedstawioną płytą główną.