Pytanie 1

W komputerach obsługujących wysokowydajne zadania serwerowe, konieczne jest użycie dysku z interfejsem

Wynik: 30/40 punktów (75,0%)

Wymagane minimum: 20 punktów (50%)

W komputerach obsługujących wysokowydajne zadania serwerowe, konieczne jest użycie dysku z interfejsem

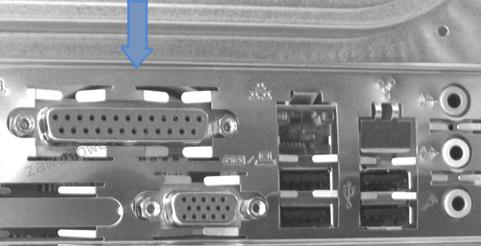

Na ilustracji, strzałka wskazuje na złącze interfejsu

Sieci lokalne o architekturze klient-serwer są definiowane przez to, że

W pierwszym oktecie adresów IPv4 klasy B znajdują się liczby mieszczące się w przedziale

Nawiązywanie szyfrowanych połączeń pomiędzy hostami w sieci publicznej Internet, wykorzystywane w kontekście VPN (Virtual Private Network), to

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Na zdjęciu ukazano złącze zasilające

Jakie parametry można śledzić w przypadku urządzenia przy pomocy S.M.A.R.T.?

Jednym z metod ograniczenia dostępu do sieci bezprzewodowej dla osób nieuprawnionych jest

Jaki protokół jest używany przez komendę ping?

Równoważnym zapisem 232 bajtów jest zapis

W jakim systemie występuje jądro hybrydowe (kernel)?

Aby zrealizować transfer danych pomiędzy siecią w pracowni a siecią ogólnoszkolną, która ma inną adresację IP, należy zastosować

Narzędzie przedstawione do nadzorowania sieci LAN to

C:\Users\egzamin>nmap localhost Starting Nmap 7.80 ( https://nmap.org ) at 2019-11-26 20:23 ?rodkowoeuropejski czas stand. Nmap scan report for localhost (127.0.0.1) Host is up (0.00s latency). Other addresses for localhost (not scanned): ::1 Not shown: 988 closed ports PORT STATE SERVICE 135/tcp open msrpc 445/tcp open microsoft-ds 1025/tcp open NFS-or-IIS 1026/tcp open LSA-or-nterm 1027/tcp open IIS 1029/tcp open ms-lsa 1030/tcp open iad1 1031/tcp open iad2 1044/tcp open dcutility 1234/tcp open hotline 2869/tcp open icslap 16992/tcp open amt-soap-http Nmap done: 1 IP address (1 host up) scanned in 0.94 seconds

Liczbie 16 bitowej 0011110010101110 wyrażonej w systemie binarnym odpowiada w systemie szesnastkowym liczba

Pierwszym krokiem, który należy podjąć, aby chronić ruter przed nieautoryzowanym dostępem do jego panelu administracyjnego, jest

Termin "PIO Mode" odnosi się do trybu operacyjnego

Jakie jest oprogramowanie serwerowe dla systemu Linux, które pozwala na współdziałanie z grupami roboczymi oraz domenami Windows?

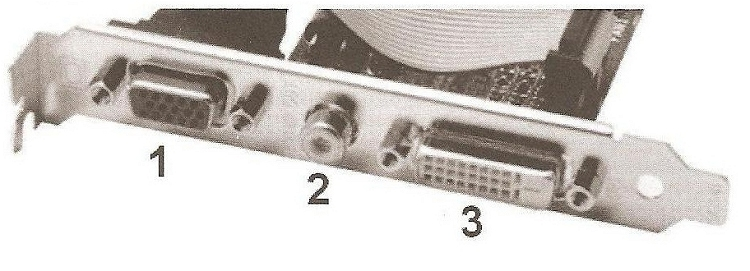

Na ilustracji pokazano porty karty graficznej. Które złącze jest cyfrowe?

Wskaż cechę platformy wirtualizacji Hyper-V.

Czym jest postcardware?

Jaki rodzaj dysków jest podłączany do złącza IDE na płycie głównej komputera?

Podczas testowania połączeń sieciowych za pomocą polecenia ping użytkownik otrzymał wyniki przedstawione na rysunku. Jakie może być źródło braku odpowiedzi serwera przy pierwszym teście, zakładając, że domena wp.pl ma adres 212.77.100.101?

C:\Users\uczen>ping wp.pl

Żądanie polecenia ping nie może znaleźć hosta wp.pl. Sprawdź nazwę i ponów próbe.

C:\Users\uczen>ping 212.77.100.101

Badanie 212.77.100.101 z 32 bajtami danych:

Odpowiedź z 212.77.100.101: bajtów=32 czas=19ms TTL=127

Odpowiedź z 212.77.100.101: bajtów=32 czas=35ms TTL=127

Odpowiedź z 212.77.100.101: bajtów=32 czas=40ms TTL=127

Odpowiedź z 212.77.100.101: bajtów=32 czas=20ms TTL=127

Statystyka badania ping dla 212.77.100.101:

Pakiety: Wysłane = 4, Odebrane = 4, Utracone = 0

(0% straty),

Szacunkowy czas błądzenia pakietów w millisekundach:

Minimum = 19 ms, Maksimum = 40 ms, Czas średni = 28 msJakie są skutki działania poniższego polecenia ```netsh advfirewall firewall add rule name="Open" dir=in action=deny protocol=TCP localport=53```?

W systemach operacyjnych Windows konto użytkownika, które ma najwyższe domyślne uprawnienia, należy do grupy

Analiza tłumienia w torze transmisyjnym na kablu umożliwia ustalenie

Zgodnie z aktualnymi normami BHP, zalecana odległość oczu od ekranu monitora powinna wynosić

Wartość liczby ABBA zapisana w systemie heksadecymalnym odpowiada w systemie binarnym liczbie

Komputer uzyskuje dostęp do Internetu za pośrednictwem sieci lokalnej. Gdy użytkownik wpisuje w przeglądarkę internetową adres www.wp.pl, nie może otworzyć strony WWW, natomiast podanie adresu IP, przykładowo 212.77.100.101, umożliwia otwarcie tej strony. Jakie mogą być tego powody?

Jakie urządzenie powinno być użyte do segmentacji domeny rozgłoszeniowej?

Wskaź zestaw wykorzystywany do diagnozowania logicznych systemów elektronicznych na płycie głównej komputera, który nie reaguje na próbę uruchomienia zasilania?

Na jakich portach brama sieciowa powinna umożliwiać ruch, aby klienci w sieci lokalnej mieli możliwość ściągania plików z serwera FTP?

Określenie najbardziej efektywnej trasy dla połączenia w sieci to

Złośliwe programy komputerowe, które potrafią replikować się same i wykorzystują luki w systemie operacyjnym, a także mają zdolność modyfikowania oraz uzupełniania swojej funkcjonalności, nazywamy

Jakie złącze, które pozwala na podłączenie monitora, znajduje się na karcie graficznej pokazanej na ilustracji?

Czym jest patchcord?

Wskaż procesor współpracujący z przedstawioną płytą główną.

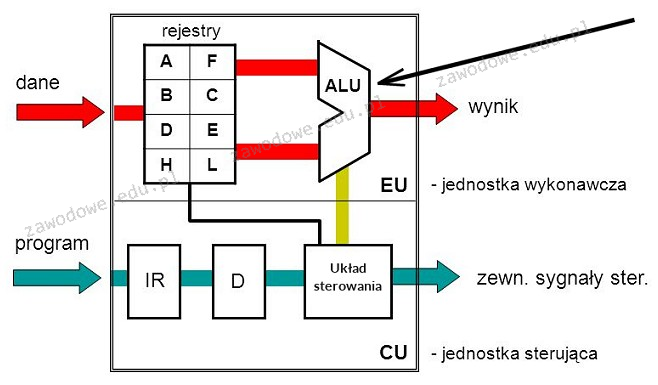

Na diagramie mikroprocesora blok wskazany strzałką pełni rolę

Przygotowując ranking dostawców łączy internetowych należy zwrócić uwagę, aby jak najmniejsze wartości miały parametry

Funkcja znana jako: "Pulpit zdalny" standardowo operuje na porcie

Brak odpowiedzi na to pytanie.