Pytanie 1

Magistrala PCI-Express do przesyłania danych stosuje metodę komunikacyjną

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Magistrala PCI-Express do przesyłania danych stosuje metodę komunikacyjną

Jakie urządzenie sieciowe zostało pokazane na diagramie sieciowym?

Impulsator pozwala na diagnozowanie uszkodzonych układów logicznych komputera między innymi poprzez

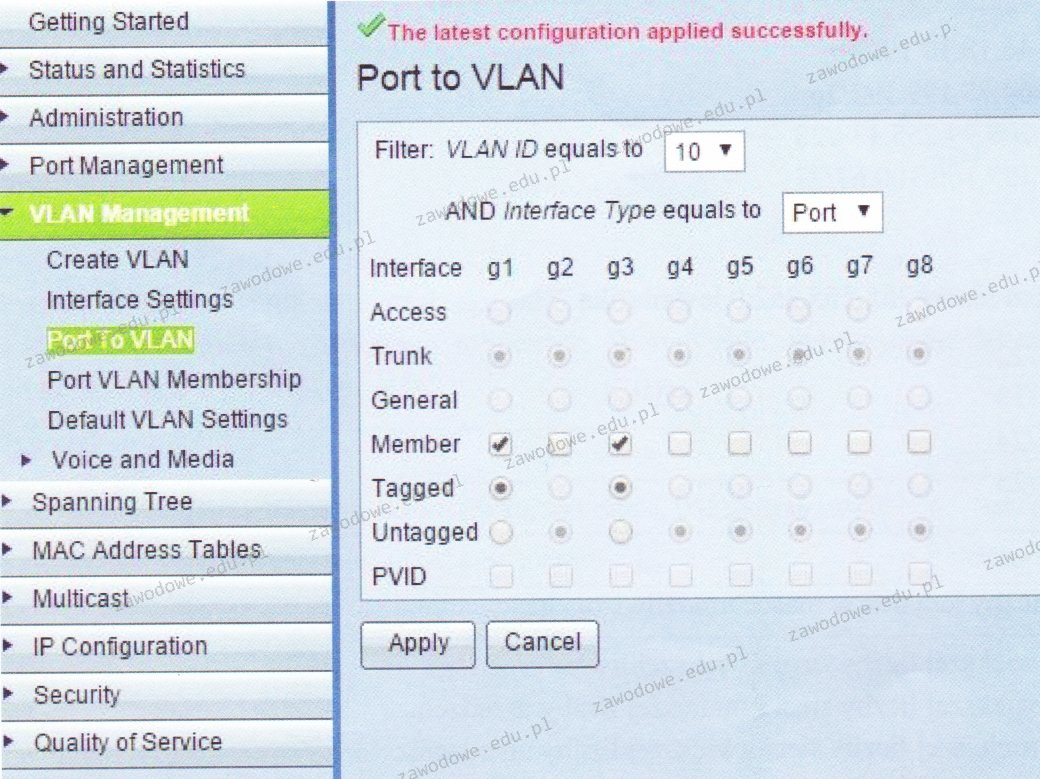

Na ilustracji przedstawiona jest konfiguracja

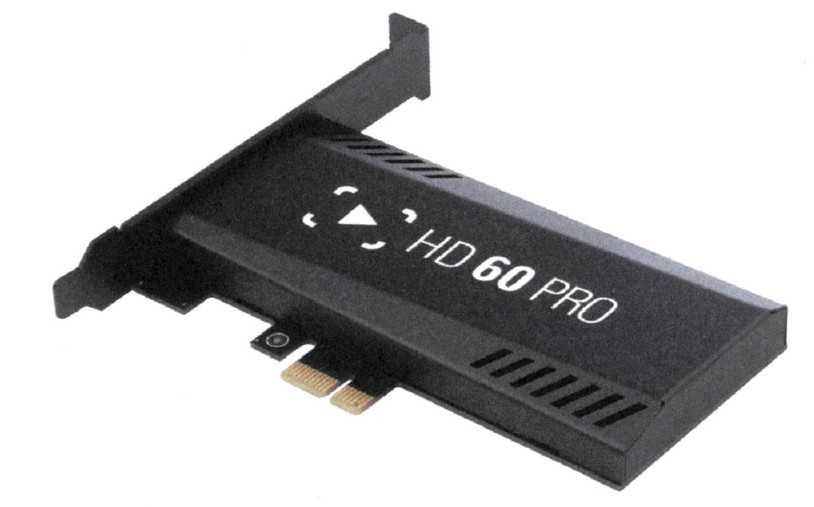

Karta do przechwytywania wideo, która została przedstawiona, będzie kompatybilna z płytą główną posiadającą port

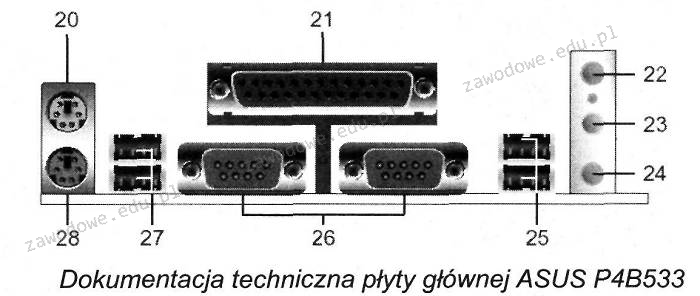

Na ilustracji przedstawiono tylną stronę

Aby zminimalizować ryzyko wyładowań elektrostatycznych podczas wymiany komponentów komputerowych, technik powinien wykorzystać

Co wskazuje oznaczenie danego procesora?

Materiałem eksploatacyjnym, stosowanym w rzutniku multimedialnym, jest

Symbol błyskawicy pokazany na rysunku jest używany do oznaczania złącza

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

Komputer K1 jest połączony z interfejsem G0 rutera, a komputer K2 z interfejsem G1 tego samego urządzenia. Na podstawie danych przedstawionych w tabeli, określ właściwy adres bramy dla komputera K2.

| Interfejs | Adres IP | Maska |

|---|---|---|

| G0 | 172.16.0.1 | 255.255.0.0 |

| G1 | 192.168.0.1 | 255.255.255.0 |

Jaką minimalną ilość pamięci RAM musi mieć komputer, aby móc uruchomić 64-bitowy system operacyjny Windows 7 w trybie graficznym?

W systemie binarnym liczba 3FC7 będzie zapisana w formie:

Jakie cechy posiadają procesory CISC?

Wartość sumy liczb binarnych 1010 i 111 zapisana w systemie dziesiętnym to

Zjawisko, w którym pliki przechowywane na dysku twardym są umieszczane w nieprzylegających do siebie klastrach, nosi nazwę

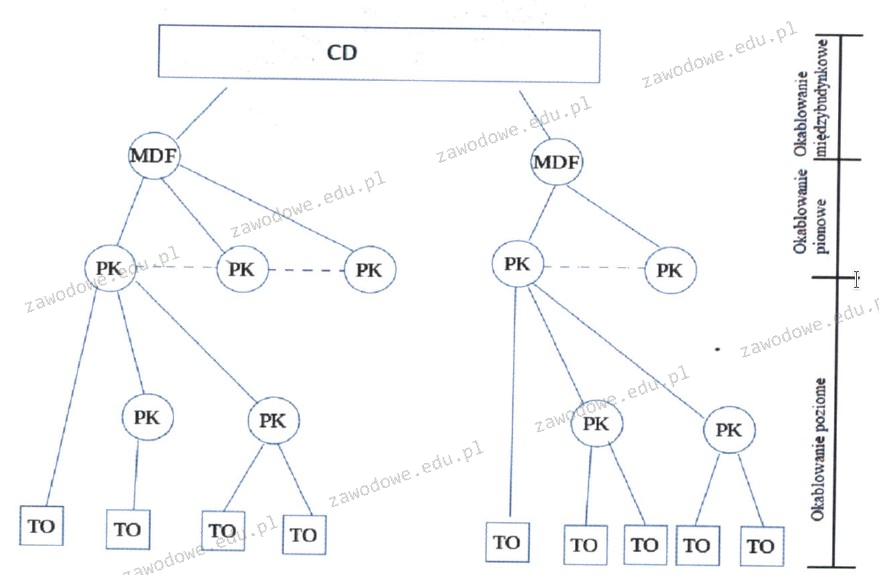

Na zaprezentowanym schemacie logicznym sieci przedstawiono

Zgodnie z normą TIA/EIA-568-B.1 kabel UTP 5e z przeplotem powstaje poprzez zamianę lokalizacji w wtyczce 8P8C następujących par żył (odpowiednio według kolorów):

W standardzie IEEE 802.3af metoda zasilania różnych urządzeń sieciowych została określona przez technologię

Program testujący wydajność sprzętu komputerowego to

Modułem pamięci RAM, kompatybilnym z płytą główną GIGABYTE GA-X99- ULTRA GAMING/ X99/ 8x DDR4 2133, ECC, max 128GB/ 4x PCI-E 16x/ RAID/ USB 3.1/ S-2011-V3/ATX, jest pamięć

Karta sieciowa przedstawiona na ilustracji jest w stanie przesyłać dane z maksymalną szybkością

Zestaw dodatkowy, który zawiera strzykawkę z cieczą, igłę oraz rękawice ochronne, jest przeznaczony do napełniania pojemników z medium drukującym w drukarkach

Jakie urządzenie powinno się wykorzystać, aby rozszerzyć zasięg sieci bezprzewodowej w obiekcie?

Urządzeniem, które przekształca otrzymane ramki w sygnały przesyłane później w sieci komputerowej, jest

Urządzenie, które łączy różne segmenty sieci i przekazuje ramki pomiędzy nimi, wybierając odpowiedni port docelowy dla przesyłanych ramek, to

Aby móc korzystać z telefonu PSTN do nawiązywania połączeń za pośrednictwem sieci komputerowej, należy go podłączyć do

Na zaprezentowanej płycie głównej komputera złącza oznaczono cyframi 25 i 27

Płyta główna wyposażona w gniazdo G2 będzie współpracowała z procesorem

Symbolika tego procesora wskazuje na

Element, który jest na stałe zainstalowany u abonenta i zawiera zakończenie poziomego okablowania strukturalnego, to

W komputerach stacjonarnych zamontowane są karty sieciowe Ethernet 10/100/1000 z gniazdem RJ45. Jakie medium transmisyjne powinno się zastosować w celu zbudowania sieci komputerowej zapewniającej najwyższą przepustowość?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wtyczka zaprezentowana na fotografii stanowi element obwodu elektrycznego zasilającego

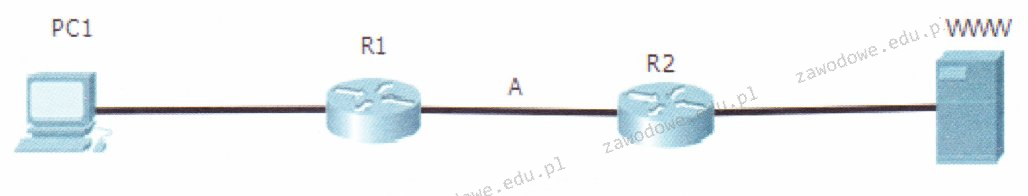

Ramka z informacjami przesyłanymi z komputera PC1 do serwera www znajduje się pomiędzy routerem R1 a routerem R2 w punkcie A). Jakie adresy są w niej zawarte?

Możliwą przyczyną usterki drukarki igłowej może być awaria

Które z poniższych wskazówek jest NIEWłaściwe w kontekście konserwacji skanera płaskiego?

Jakie oznaczenie nosi wtyk powszechnie znany jako RJ45?

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie