Pytanie 1

Obszary napromieniania w technice IMRT w trakcie wykonywania zabiegu radioterapeutycznego wyznacza

Wynik: 31/40 punktów (77,5%)

Wymagane minimum: 20 punktów (50%)

Obszary napromieniania w technice IMRT w trakcie wykonywania zabiegu radioterapeutycznego wyznacza

Do czego służy do symulator rentgenowski wykorzystywany w procesie radioterapii?

W radiografii mianem SID określa się

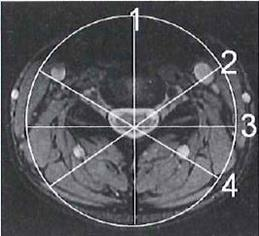

Na zamieszczonej rycinie przedstawiono

Testy podstawowe z zakresu geometrii pola rentgenowskiego, przeznaczone do sprawdzenia zgodności pola wiązki promieniowania rentgenowskiego z symulacją świetlną, są wykonywane raz

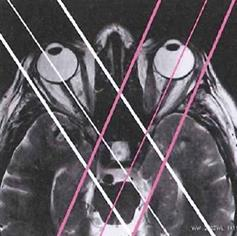

Na którym obrazie MR jest widoczne pasmo saturacji?

W obrazowaniu metodą rezonansu magnetycznego T1 oznacza czas

Więzka promieniowania X to

W badaniu PET stosuje się tylko radioizotopy emitujące

Brachyterapia polegająca na wielokrotnym wsuwaniu i wysuwaniu źródła promieniowania do tego samego aplikatora nosi nazwę

W radiografii mianem SID określa się

Wskaż roczną dawkę graniczną dla osób zatrudnionych w warunkach narażenia na promieniowanie jonizujące.

SPECT to

Dawka graniczna wyrażona jako dawka skuteczna (efektywna), dla osób zawodowo narażonych na działanie promieniowania jonizującego wynosi w ciągu roku kalendarzowego

Ile razy i jak zmieni się wartość natężenia promieniowania X przy zwiększeniu odległości OF ze 100 cm do 200 cm?

Które urządzenie zostało przedstawione na fotografii i w jakiej pracowni znajduje zastosowanie?

Parametr SNR w obrazowaniu MR oznacza

Radioizotopowa terapia medycyny nuklearnej polega na wprowadzeniu do tkanek lub narządów radiofarmaceutyku

Który parametr ekspozycji ma decydujący wpływ na kontrast obrazu rentgenowskiego?

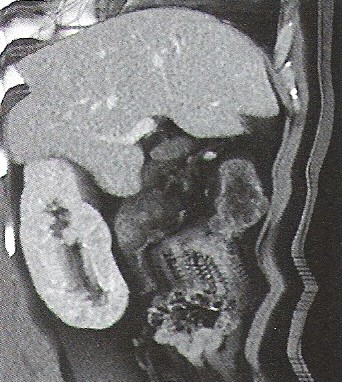

Na którym obrazie TK uwidoczniony jest artefakt spowodowany ruchami oddechowymi pacjenta?

Wiązka elektronów najczęściej stosowana jest do leczenia zmian nowotworowych w obrębie

Wysoką rozdzielczość przestrzenną obrazowania MR uzyskuje się przez

Podczas badania gammakamerą źródłem promieniowania jest

Fala głosowa rozchodzi się

Folia wzmacniająca umieszczona w kasecie rentgenowskiej emituje pod wpływem promieniowania X światło

Brachyterapia polega na napromieniowaniu pacjenta promieniowaniem

Największa wartość energii promieniowania stosowanego w radioterapii jest generowana przy użyciu

Podstawowym elementem diagnostycznym aparatury izotopowej wykorzystującej emisyjne metody pomiaru jest

Źródłem promieniowania protonowego stosowanego w radioterapii jest

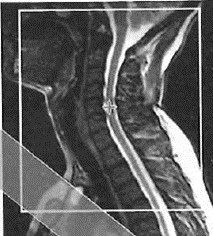

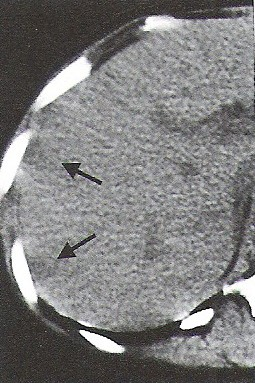

Która przyczyna spowodowała powstanie artefaktu widocznego na zamieszczonym obrazie MR?

Jakie wiązki promieniowania emituje medyczny akcelerator liniowy?

Czas połowicznego zaniku jest wykorzystywany

Wysoką rozdzielczość przestrzenną obrazowania MR uzyskuje się przez

W trakcie obrazowania metodą rezonansu magnetycznego wykorzystywane jest zjawisko wysyłania sygnału emitowanego przez

Które środki kontrastujące wykorzystywane są w diagnostyce rezonansem magnetycznym?

Teleradioterapia 4D na etapie planowania leczenia wykorzystuje obrazy

W metodzie RM (rezonansu magnetycznego) po umieszczeniu pacjenta w silnym, stałym polu magnetycznym dochodzi do oddziaływania

Zgodnie z obowiązującymi przepisami powierzchnia gabinetu rentgenowskiego, w którym jest zainstalowany zestaw rentgenowski do badań naczyniowych, powinna wynosić

W celu wyeliminowania zakłóceń obrazu MR przez sygnały pochodzące z tkanki tłuszczowej, stosuje się

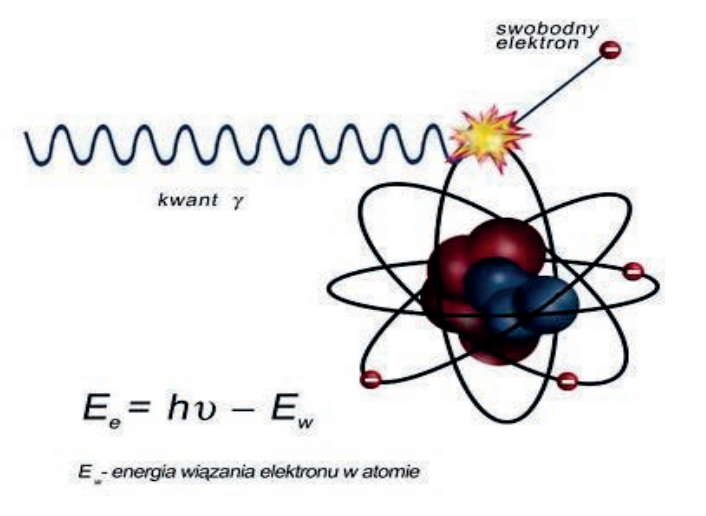

Emisja fali elektromagnetycznej występuje w procesie rozpadu promieniotwórczego