Pytanie 1

Jakie urządzenie wskazujące działa na podstawie zmian pojemności elektrycznej?

Wynik: 39/40 punktów (97,5%)

Wymagane minimum: 20 punktów (50%)

Jakie urządzenie wskazujące działa na podstawie zmian pojemności elektrycznej?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie składniki systemu komputerowego muszą być usuwane w wyspecjalizowanych zakładach przetwarzania ze względu na obecność niebezpiecznych substancji lub chemicznych pierwiastków?

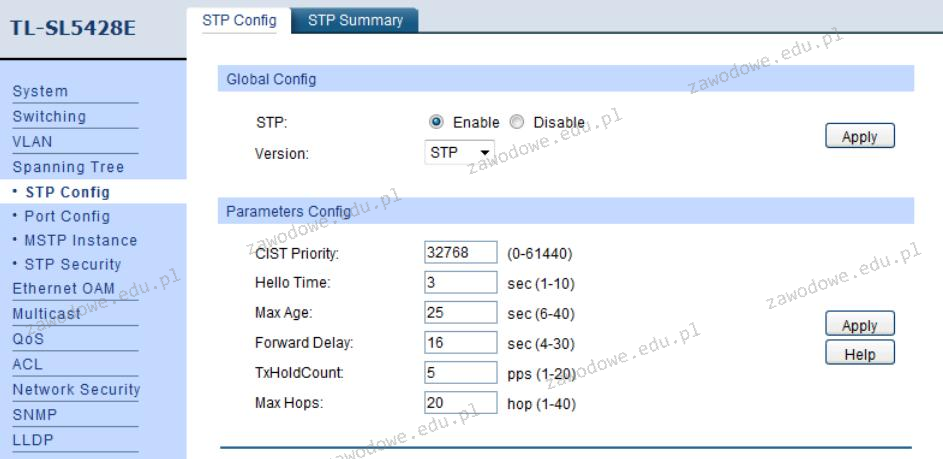

Na podstawie zrzutu ekranu ilustrującego ustawienia przełącznika można wnioskować, że

Urządzeniem wejściowym komputera, realizującym z najwyższą precyzją funkcje wskazujące w środowisku graficznym 3D, jest

Jak brzmi pełna wersja adresu IPv6 2001:0:db8::1410:80ab?

Wskaż zakres adresów hostów w sieci 172.16.4.0/24?

ACPI jest skrótem oznaczającym

Ile jest klawiszy funkcyjnych na klawiaturze w układzie QWERTY?

Jakie oprogramowanie można wykorzystać do wykrywania problemów w pamięciach RAM?

Podstawowym zadaniem mechanizmu Plug and Play jest:

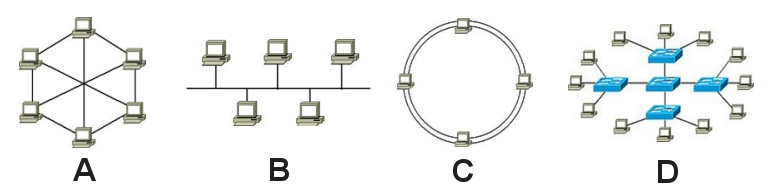

Który z rysunków ilustruje topologię sieci w układzie magistrali?

Jakie urządzenia dotyczą terminy SLI?

GRUB, LILO, NTLDR to

Firma Dyn, której serwery DNS zostały zaatakowane, przyznała, że część tego ataku … miała miejsce z użyciem różnych urządzeń podłączonych do sieci. Ekosystem kamer, czujników i kontrolerów określany ogólnie jako 'Internet rzeczy' został wykorzystany przez cyberprzestępców jako botnet − sieć maszyn-zombie. Jakiego rodzaju atak jest opisany w tym cytacie?

W systemie Linux do bieżącego monitorowania aktywnych procesów wykorzystuje się polecenie

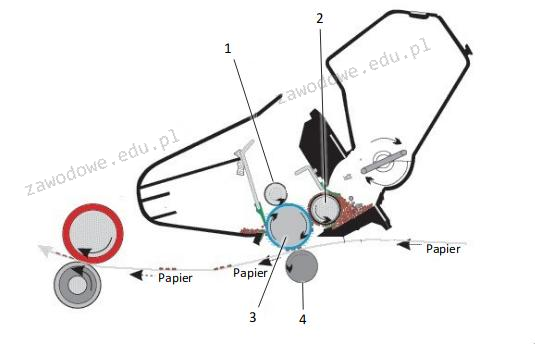

Na schemacie ilustrującym konstrukcję drukarki, w której toner jest nierównomiernie dostarczany do bębna, należy wskazać wałek magnetyczny oznaczony numerem

Która z poniższych wskazówek nie jest właściwa w kontekście konserwacji skanera płaskiego?

Jakie polecenie w systemie Windows przeznaczonym dla stacji roboczej umożliwia ustalenie wymagań logowania dla wszystkich użytkowników tej stacji?

Pracownik serwisu komputerowego podczas wykonywania konserwacji i czyszczenia drukarki laserowej, odłączonej od źródła zasilania, może wykorzystać jako środek ochrony indywidualnej

Instalacja systemów Linux oraz Windows 7 przebiegła bez żadnych problemów. Systemy zainstalowały się poprawnie z domyślnymi ustawieniami. Na tym samym komputerze, przy tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Który przyrząd należy wykorzystać do uzyskania wyników testu POST dla modułów płyty głównej?

Jakie urządzenia wyznaczają granice domeny rozgłoszeniowej?

Tworzenie obrazu dysku ma na celu

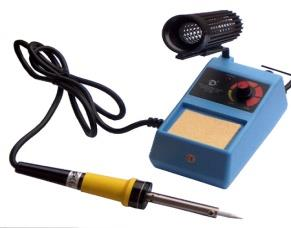

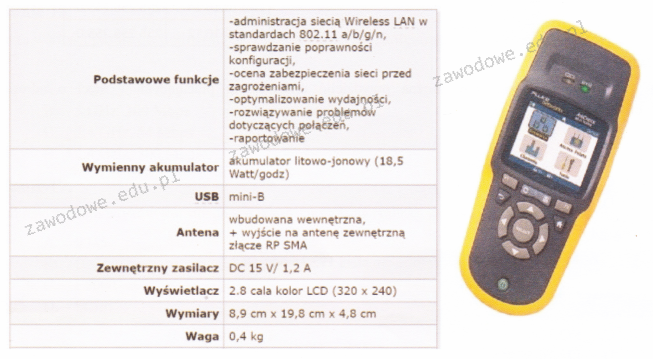

Jakie urządzenie diagnostyczne jest pokazane na ilustracji oraz opisane w specyfikacji zawartej w tabeli?

Jak należy rozmieszczać gniazda komputerowe RJ45 w odniesieniu do przestrzeni biurowej zgodnie z normą PN-EN 50174?

Aby wymusić na użytkownikach lokalnych systemów z rodziny Windows Server regularną zmianę hasła oraz stosowanie haseł o odpowiedniej długości i spełniających wymagania dotyczące złożoności, należy ustawić

W klasycznym adresowaniu, adres IP 74.100.7.8 przyporządkowany jest do

Protokół TCP (Transmission Control Protocol) funkcjonuje w trybie

Który z wymienionych składników stanowi element pasywny w sieci?

Rekord startowy dysku twardego w komputerze to

Aby przygotować do pracy skaner, którego opis zawarto w tabeli, należy w pierwszej kolejności

| Skaner przenośny IRIScanBook 3 |

| Bezprzewodowy, zasilany baterią i bardzo lekki. Można go przenosić w dowolne miejsce! |

| Idealny do skanowania książek, czasopism i gazet |

| Rozdzielczość skanowania 300/600/900 dpi |

| Prędkość skanowania: 2 sek. dla tekstów biało-czarnych / 3 sek. dla tekstów kolorowych |

| Bezpośrednie skanowanie do formatu PDF i JPEG |

| Zapis skanu na kartę microSD ™ (w zestawie) |

| Kolorowy ekran (do podglądu zeskanowanych obrazów) |

| 3 baterie alkaliczne AAA (w zestawie) |

Narzędziem systemu Linux OpenSUSE dedykowanym między innymi do zarządzania systemem jest

Jakie zagrożenia eliminują programy antyspyware?

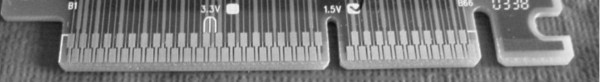

Na ilustracji przedstawiono fragment karty graficznej ze złączem

Czym jest dziedziczenie uprawnień?

Rejestry procesora są resetowane poprzez

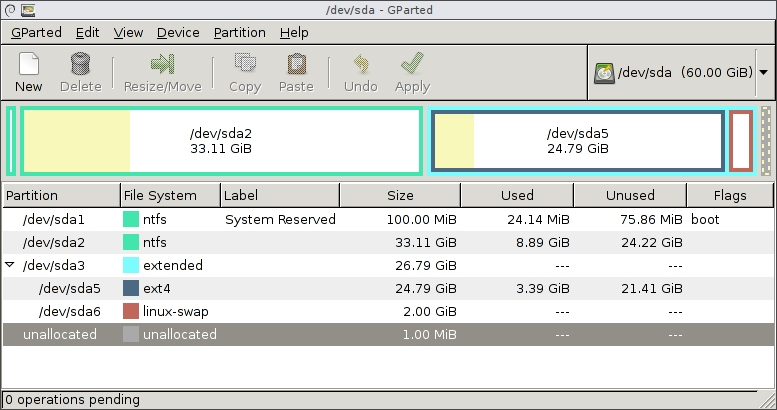

Badanie danych przedstawionych przez program umożliwia dojście do wniosku, że

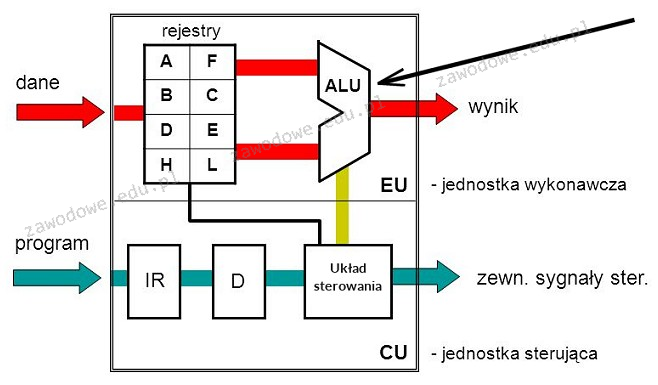

Na diagramie mikroprocesora blok wskazany strzałką pełni rolę

Program CHKDSK jest wykorzystywany do