Pytanie 1

Przy pomocy testów statycznych okablowania można zidentyfikować

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Przy pomocy testów statycznych okablowania można zidentyfikować

W ustawieniach haseł w systemie Windows Server aktywowano opcję, że hasło musi spełniać wymagania dotyczące złożoności. Z jakiej minimalnej liczby znaków musi składać się hasło użytkownika?

Jakie narzędzie powinno być użyte do uzyskania rezultatów testu POST dla komponentów płyty głównej?

Autorskie prawo osobiste twórcy do programu komputerowego

Wydruk z drukarki igłowej realizowany jest z zastosowaniem zestawu stalowych igieł w liczbie

Aby podnieść wydajność komputera w grach, karta graficzna Sapphire Radeon R9 FURY OC, 4GB HBM (4096 Bit), HDMI, DVI, 3xDP została wzbogacona o technologię

W dokumentacji płyty głównej znajduje się informacja "Wsparcie dla S/PDIF Out". Co to oznacza w kontekście tej płyty głównej?

Jaka jest nominalna moc wyjściowa (ciągła) zasilacza o parametrach zapisanych w tabeli?

| Napięcie wyjściowe | +5 V | +3.3 V | +12 V1 | +12 V2 | -12 V | +5 VSB |

| Prąd wyjściowy | 18,0 A | 22,0 A | 18,0 A | 17,0 A | 0,3 A | 2,5 A |

| Moc wyjściowa | 120 W | 336W | 3,6 W | 12,5 W |

Jak nazywa się pamięć podręczną procesora?

Jaka liczba hostów może być zaadresowana w podsieci z adresem 192.168.10.0/25?

Jaki jest główny cel stosowania maski podsieci?

Relacja między ładunkiem zmagazynowanym na przewodniku a potencjałem tego przewodnika wskazuje na jego

Jakie polecenie uruchamia edytor polityk grup w systemach z rodziny Windows Server?

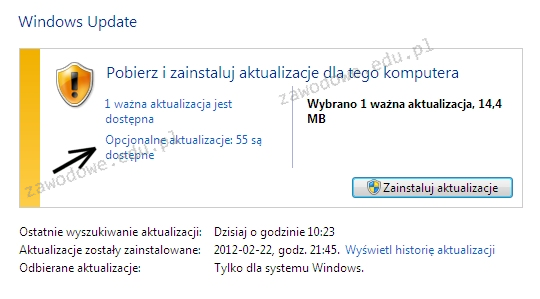

Jeżeli użytkownik zaznaczy opcję wskazaną za pomocą strzałki, będzie miał możliwość instalacji aktualizacji

Rodzaj ataku komputerowego, który polega na pozyskiwaniu wrażliwych informacji osobistych poprzez podszywanie się pod zaufaną osobę lub instytucję, to

Użytkownik systemu Windows napotyka komunikaty o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?

Aby uzyskać adres IPv4, za pomocą usługi DHCP, komputer kliencki wysyła żądania z portu

Który zakres adresów IPv4 jest poprawnie przypisany do danej klasy?

| Zakres adresów IPv4 | Klasa adresu IPv4 | |

|---|---|---|

| A. | 1.0.0.0 ÷ 127.255.255.255 | A |

| B. | 128.0.0.0 ÷ 191.255.255.255 | B |

| C. | 192.0.0.0 ÷ 232.255.255.255 | C |

| D. | 233.0.0.0 ÷ 239.255.255.255 | D |

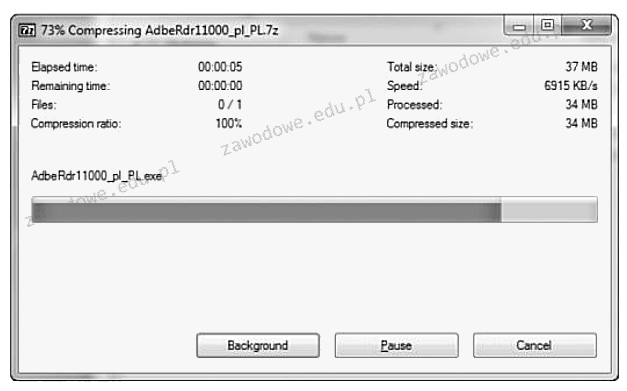

Na dołączonym obrazku pokazano działanie

Komputer wyposażony w BIOS firmy Award wygenerował komunikat o treści Primary/Secondary master/slave hard disk fail. Komunikat ten może oznaczać konieczność wymiany

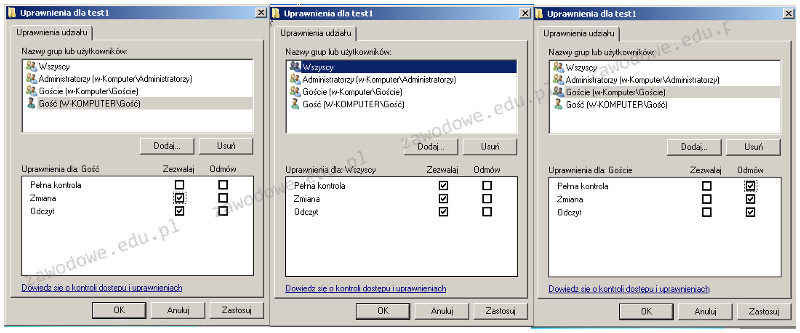

Użytkownik o nazwie Gość należy do grupy o nazwie Goście. Grupa Goście jest częścią grupy Wszyscy. Jakie ma uprawnienia użytkownik Gość w folderze test1?

Z jakim protokołem związane są terminy "Sequence number" oraz "Acknowledgment number"?

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona

Jak nazywa się materiał używany w drukarkach 3D?

Najmniejszy czas dostępu charakteryzuje się

Do czego służy mediakonwerter?

W systemie Linux prawa dostępu do katalogu są ustawione w formacie rwx--x--x. Jaką liczbę odpowiadają tę konfigurację praw?

Aby stworzyć las w strukturze katalogowej AD DS (Active Directory Domain Services), konieczne jest utworzenie przynajmniej

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Problemy z laptopem, objawiające się zmienionymi barwami lub brakiem określonego koloru na ekranie, mogą być spowodowane uszkodzeniem

Komputer lokalny dysponuje adresem 192.168.0.5. Po otwarciu strony internetowej z tego komputera, która rozpoznaje adresy w sieci, uzyskano informację, że adres komputera to 195.182.130.24. To oznacza, że

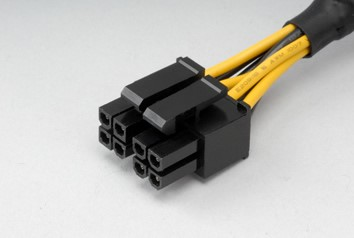

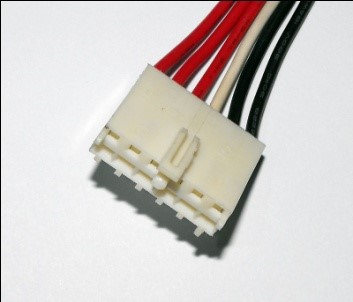

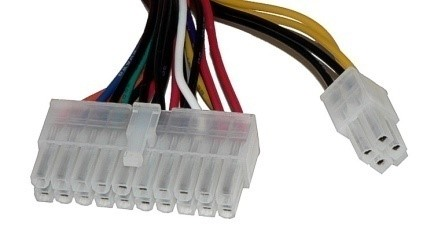

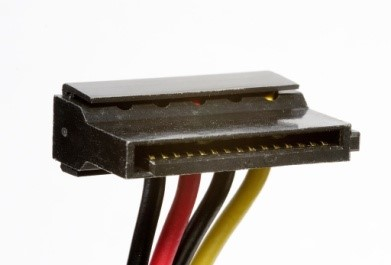

Wskaż wtyk zasilający, który podczas montażu zestawu komputerowego należy podłączyć do napędu optycznego.

Która struktura partycji pozwala na stworzenie do 128 partycji podstawowych na pojedynczym dysku?

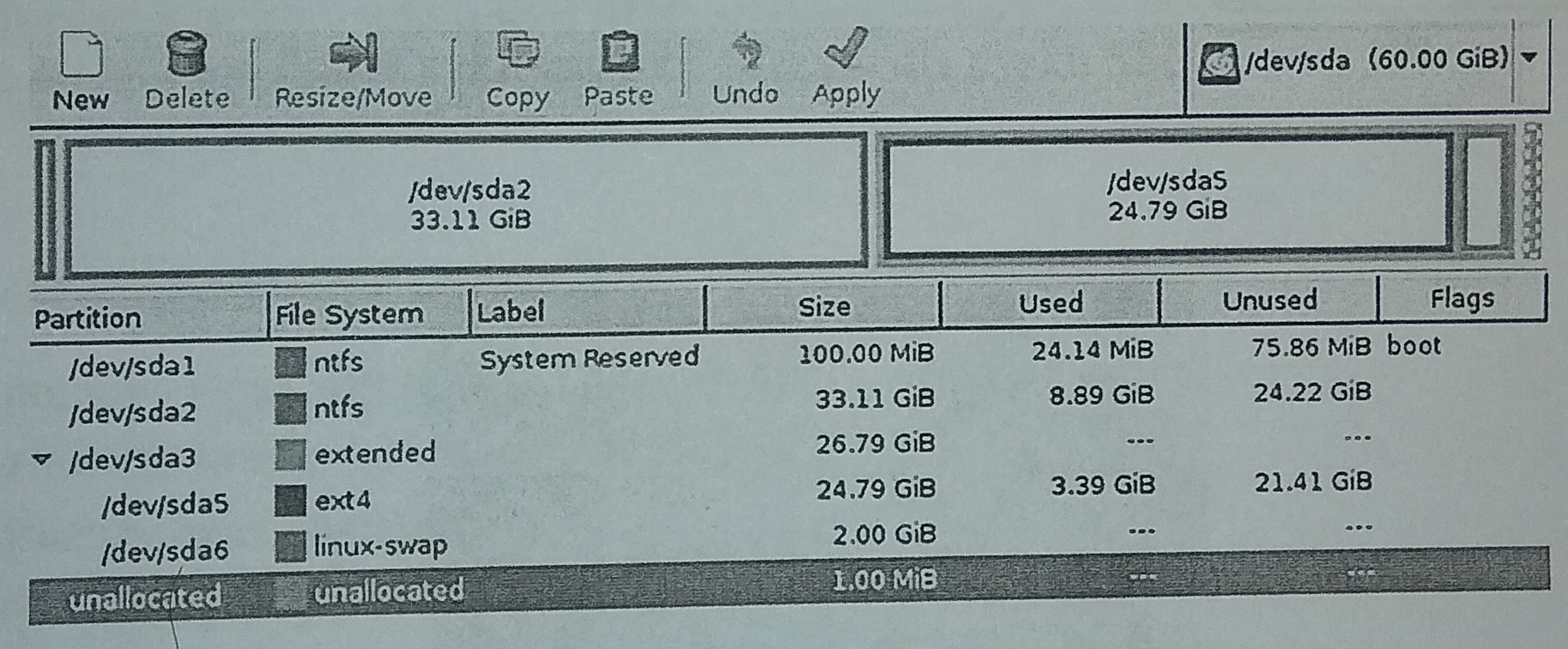

Analiza danych wyświetlonych przez program umożliwia stwierdzenie, że

Jaką maksymalną prędkość transferu danych umożliwia interfejs USB 3.0?

Układ na karcie graficznej, którego zadaniem jest zamiana cyfrowego sygnału generowanego poprzez kartę na sygnał analogowy, który może być wyświetlony poprzez monitor to

Do efektywnego zrealizowania macierzy RAID 1 wymagane jest minimum

Jakie urządzenie powinno być użyte do połączenia sprzętu peryferyjnego, które posiada bezprzewodowy interfejs komunikujący się za pomocą fal świetlnych w podczerwieni, z laptopem, który nie dysponuje takim interfejsem, lecz ma port USB?

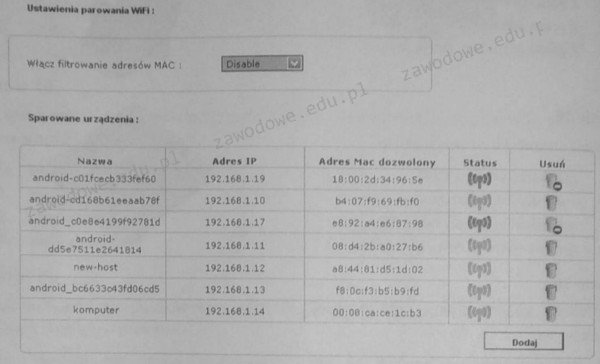

Schemat ilustruje ustawienia urządzenia WiFi. Wskaż, które z poniższych stwierdzeń na temat tej konfiguracji jest prawdziwe?

W standardzie Ethernet 100BaseTX konieczne jest użycie kabli skręconych