Pytanie 1

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Który standard w połączeniu z odpowiednią kategorią kabla skrętki jest skonfigurowany w taki sposób, aby umożliwiać maksymalny transfer danych?

ile bajtów odpowiada jednemu terabajtowi?

Podanie nieprawidłowych napięć do płyty głównej może skutkować

Jaką rolę należy przypisać serwerowi z rodziny Windows Server, aby mógł świadczyć usługi rutingu?

Jakie oprogramowanie można wykorzystać do wykrywania problemów w pamięciach RAM?

Adres IP urządzenia, zapisany jako sekwencja 172.16.0.1, jest przedstawiony w systemie

Ile podsieci obejmują komputery z adresami: 192.168.5.12/25, 192.168.5.200/25 oraz 192.158.5.250/25?

Adres komórki pamięci został podany w kodzie binarnym 1110001110010100. Jak zapisuje się ten adres w systemie szesnastkowym?

Najwyższą prędkość przesyłania danych w sieci bezprzewodowej można osiągnąć używając urządzeń o standardzie

Płyta główna serwerowa potrzebuje pamięci z rejestrem do prawidłowego funkcjonowania. Który z poniższych modułów pamięci będzie zgodny z tą płytą?

Jaką konfigurację sieciową może mieć komputer, który należy do tej samej sieci LAN, co komputer z adresem 10.8.1.10/24?

Notacja #102816 oznacza zapis w systemie liczbowym

W systemie Linux, aby wyszukać wszystkie pliki z rozszerzeniem txt, które znajdują się w katalogu /home/user i zaczynają się na literę a lub literę b lub literę c, należy wydać polecenie

Czym jest klaster komputerowy?

Która usługa opracowana przez Microsoft, pozwala na konwersję nazw komputerów na adresy URL?

Dane z HDD, którego sterownik silnika SM jest uszkodzony, można odzyskać

Podstawowym zadaniem mechanizmu Plug and Play jest:

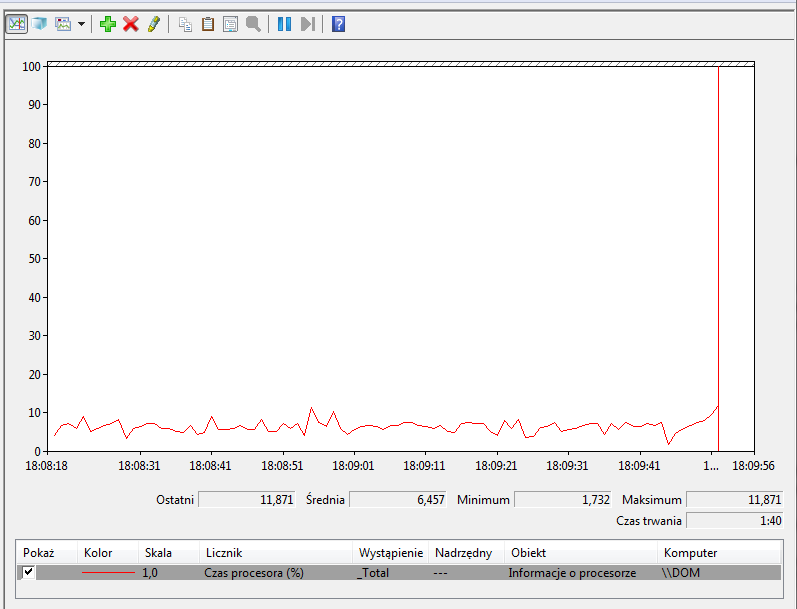

By uruchomić w systemie Windows oprogramowanie narzędziowe monitorujące wydajność komputera przedstawione na rysunku, należy uruchomić

W celu zapewnienia jakości usługi QoS, w przełącznikach warstwy dostępu stosowany jest mechanizm

Które bity w 48-bitowym adresie MAC identyfikują producenta?

Zjawisko crosstalk, które występuje w sieciach komputerowych, polega na

W celu kontrolowania przepustowości sieci, administrator powinien zastosować aplikację typu

Poprzez użycie polecenia ipconfig /flushdns można przeprowadzić konserwację urządzenia sieciowego, która polega na

Na podstawie danych przedstawionych w tabeli dotyczącej twardego dysku, ustal, który z wniosków jest poprawny?

Program do monitorowania, który umożliwia przechwytywanie, nagrywanie oraz dekodowanie różnych pakietów sieciowych to

Jaką rolę pełni serwer plików w sieciach komputerowych LAN?

Do konwersji kodu źródłowego na program wykonywalny używany jest

Na ilustracji pokazano część efektu działania programu przeznaczonego do testowania sieci. Sugeruje to użycie polecenia diagnostycznego w sieci

TCP 192.168.0.13:51614 bud02s23-in-f8:https ESTABLISHED TCP 192.168.0.13:51615 edge-star-mini-shv-01-ams3:https ESTABLISHED TCP 192.168.0.13:51617 93.184.220.29:http ESTABLISHED TCP 192.168.0.13:51619 93.184.220.29:http ESTABLISHED TCP 192.168.0.13:51620 93.184.220.29:http TIME_WAIT TCP 192.168.0.13:51621 bud02s23-in-f206:https TIME_WAIT TCP 192.168.0.13:51622 xx-fbcdn-shv-01-ams3:https ESTABLISHED TCP 192.168.0.13:51623 108.161.188.192:https ESTABLISHED TCP 192.168.0.13:51626 23.111.9.32:https TIME_WAIT TCP 192.168.0.13:51628 lg-in-f155:https ESTABLISHED TCP 192.168.0.13:51629 waw02s06-in-f68:https ESTABLISHED

W dokumentacji technicznej procesora Intel Xeon Processor E3-1220, producent przedstawia następujące dane: # rdzeni: 4 # wątków: 4 Częstotliwość zegara: 3.1 GHz Maksymalna częstotliwość Turbo: 3.4 GHz Intel Smart Cache: 8 MB DMI: 5 GT/s Zestaw instrukcji: 64 bit Rozszerzenia zestawu instrukcji: SSE4.1/4.2, AVX Opcje wbudowane: Nie Litografia: 32 nm Maksymalne TDP: 80 W. Co to oznacza dla Menedżera zadań systemu Windows, jeśli chodzi o historię użycia?

| # of Cores: | 4 |

| # of Threads: | 4 |

| Clock Speed: | 3.1 GHz |

| Max Turbo Frequency: | 3.4 GHz |

| Intel® Smart Cache: | 8 MB |

| DMI: | 5 GT/s |

| Instruction Set: | 64-bit |

| Instruction Set Extensions: | SSE4.1/4.2, AVX |

| Embedded Options Available: | No |

| Lithography: | 32 nm |

| Max TDP: | 80 W |

Dokument służący do zaprezentowania oferty cenowej dla inwestora dotyczącej wykonania robót instalacyjnych sieci komputerowej, to

Wskaż podzespół niekompatybilny z płytą główną o przedstawionych w tabeli parametrach.

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8x USB 2.0, S-AM3+ |

Wskaź 24-pinowe lub 29-pinowe złącze żeńskie, które jest w stanie przesyłać skompresowany sygnał cyfrowy do monitora?

Jak wygląda konwencja zapisu ścieżki do udziału w sieci, zgodna z UNC (Universal Naming Convention)?

Wydruk z drukarki igłowej realizowany jest z zastosowaniem zestawu stalowych igieł w liczbie

W systemie Linux, jakie polecenie służy do zmiany hasła użytkownika?

Programem w systemie Linux, który umożliwia nadzorowanie systemu za pomocą zcentralizowanego mechanizmu, jest narzędzie

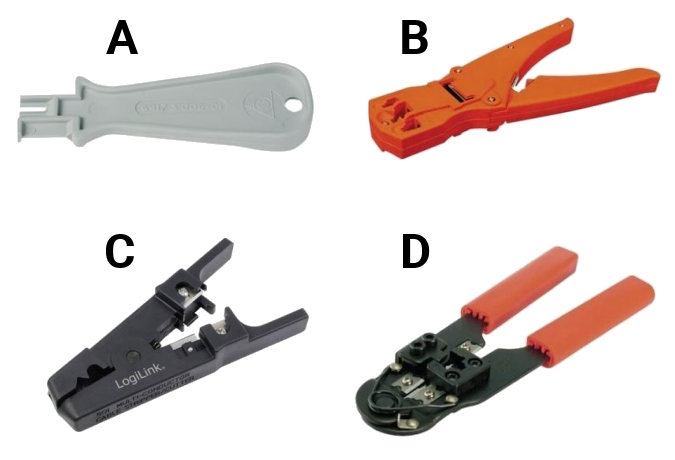

Który z przyrządów służy do usuwania izolacji?

Programem służącym do archiwizacji danych w systemie Linux jest

Moduł funkcjonalny, który nie znajduje się w kartach dźwiękowych, to skrót