Pytanie 1

Jakie urządzenia wyznaczają granice domeny rozgłoszeniowej?

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

Jakie urządzenia wyznaczają granice domeny rozgłoszeniowej?

Protokół SNMP (Simple Network Management Protocol) jest wykorzystywany do

W formacie plików NTFS, do zmiany nazwy pliku potrzebne jest uprawnienie

Narzędziem wiersza poleceń w systemie Windows, umożliwiającym zamianę tablicy partycji GPT na MBR, jest program

Ile elektronów jest zgromadzonych w matrycy LCD?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Natychmiast po dostrzeżeniu utraty istotnych plików na dysku twardym, użytkownik powinien

Wtyczka zasilająca SATA ma uszkodzony żółty przewód. Jakie to niesie za sobą konsekwencje dla napięcia na złączu?

Ile par kabli w standardzie 100Base-TX jest używanych do transmisji danych w obie strony?

W ramach zalecanych działań konserwacyjnych użytkownicy dysków SSD powinni unikać wykonywania

Transmisja w standardzie 100Base-T korzysta z kabli skrętkowych, które mają

Na przedstawionym schemacie urządzeniem, które łączy komputery, jest

Użycie którego z urządzeń może prowadzić do wzrostu liczby kolizji pakietów w sieci?

Użytkownik systemu Windows wybrał opcję powrót do punktu przywracania. Które pliki powstałe po wybranym punkcie nie zostaną naruszone przez tę akcję?

Jakie narzędzie jest używane do zakończenia skrętki wtykiem 8P8C?

Użytkownik uszkodził płytę główną z gniazdem procesora AM2. Uszkodzoną płytę można wymienić na model z gniazdem, nie zmieniając procesora i pamięci

Gdy wykonanie polecenia ping 127.0.0.1 nie przynosi żadnej odpowiedzi, to

Aby połączyć dwa przełączniki oddalone o 200 m i zapewnić minimalną przepustowość 200 Mbit/s, powinno się użyć

Komputer ma podłączoną mysz bezprzewodową, a kursor podczas pracy nie porusza się płynnie, „skacze” po ekranie. Przyczyną usterki urządzenia może być

Która edycja systemu operacyjnego Windows Server 2008 charakteryzuje się najmniej rozbudowanym interfejsem graficznym?

Który z protokołów jest używany do przesyłania plików na serwer?

Który z poniższych adresów IPv4 wraz z prefiksem reprezentuje adres sieci?

Jakie urządzenie można kontrolować pod kątem parametrów za pomocą S.M.A.R.T.?

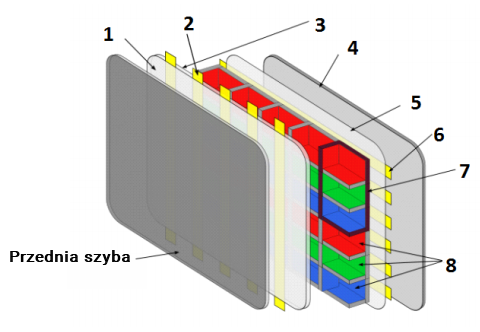

Na diagramie przedstawiającym zasadę funkcjonowania monitora plazmowego, oznaczenie numer 6 dotyczy

Jaką częstotliwość odświeżania należy ustawić, aby obraz na monitorze był odświeżany 85 razy na sekundę?

Jak sprawdzić, który z programów w systemie Windows generuje największe obciążenie dla procesora?

Jakie polecenie w systemie Linux umożliwia wyświetlenie identyfikatora użytkownika?

W systemie NTFS do zmiany nazwy pliku konieczne jest posiadanie uprawnienia

Aby przetestować funkcjonowanie serwera DNS w systemach Windows Server, można skorzystać z narzędzia nslookup. Jeśli w poleceniu podamy nazwę komputera, np. nslookup host.domena.com, to dojdzie do weryfikacji

W dokumentacji technicznej procesora Intel Xeon Processor E3-1220, producent przedstawia następujące dane: # rdzeni: 4 # wątków: 4 Częstotliwość zegara: 3.1 GHz Maksymalna częstotliwość Turbo: 3.4 GHz Intel Smart Cache: 8 MB DMI: 5 GT/s Zestaw instrukcji: 64 bit Rozszerzenia zestawu instrukcji: SSE4.1/4.2, AVX Opcje wbudowane: Nie Litografia: 32 nm Maksymalne TDP: 80 W. Co to oznacza dla Menedżera zadań systemu Windows, jeśli chodzi o historię użycia?

| # of Cores: | 4 |

| # of Threads: | 4 |

| Clock Speed: | 3.1 GHz |

| Max Turbo Frequency: | 3.4 GHz |

| Intel® Smart Cache: | 8 MB |

| DMI: | 5 GT/s |

| Instruction Set: | 64-bit |

| Instruction Set Extensions: | SSE4.1/4.2, AVX |

| Embedded Options Available: | No |

| Lithography: | 32 nm |

| Max TDP: | 80 W |

Zamieszczone atrybuty opisują rodzaj pamięci

| Maksymalne taktowanie | 1600 MHz |

| Przepustowość | PC12800 1600MHz |

| Opóźnienie | Cycle Latency CL 9,0 |

| Korekcja | Nie |

| Dual/Quad | Dual Channel |

| Radiator | Tak |

Aby skanera działał prawidłowo, należy

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można stwierdzić, że pamięć ta

Z analizy danych przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi 184 styki 64-bitowa magistrala danych Pojemność 1024 MB Przepustowość 3200 MB/s

Jak określa się typ licencji, który pozwala na pełne korzystanie z programu, lecz można go uruchomić tylko przez ograniczoną, niewielką liczbę razy od momentu instalacji?

Który port stosowany jest przez protokół FTP (File Transfer Protocol) do przesyłania danych?

Jakiego parametru wymaga konfiguracja serwera DHCP?

Jakie urządzenie sieciowe powinno zastąpić koncentrator, aby podzielić sieć LAN na cztery odrębne domeny kolizji?

Aby zminimalizować główne zagrożenia dotyczące bezpieczeństwa podczas pracy na komputerze podłączonym do sieci Internet, najpierw należy

Aby serwer mógł przesyłać dane w zakresach częstotliwości 2,4 GHz oraz 5 GHz, konieczne jest zainstalowanie w nim karty sieciowej działającej w standardzie